Opencv中使用Surf特征实现图像配准及对透视变换矩阵H的平移修正

图像配准需要将一张测试图片按照第二张基准图片的尺寸、角度等形态信息进行透视(仿射)变换匹配,本例通过Surf特征的定位和匹配实现图像配准。

配准流程:

- 1. 提取两幅图像的Surf特征

- 2. 对Surf特征进行匹配,找到最匹配的特征点对

- 3. 提取最优配对点的坐标,生成透视变换矩阵

- 4. 对测试图像经过透视变换,生成配准图像

以下是Opencv代码实现:

#include "highgui/highgui.hpp"

#include "opencv2/nonfree/nonfree.hpp"

#include "opencv2/legacy/legacy.hpp"

#include <iostream>

using namespace cv;

using namespace std;

int main(int argc,char *argv[])

{

Mat image01=imread(argv[1]);

Mat image02=imread(argv[2]);

imshow("原始测试图像",image01);

imshow("基准图像",image02);

//灰度图转换

Mat image1,image2;

cvtColor(image01,image1,CV_RGB2GRAY);

cvtColor(image02,image2,CV_RGB2GRAY);

//提取特征点

SurfFeatureDetector surfDetector(800); // 海塞矩阵阈值

vector<KeyPoint> keyPoint1,keyPoint2;

surfDetector.detect(image1,keyPoint1);

surfDetector.detect(image2,keyPoint2);

//特征点描述,为下边的特征点匹配做准备

SurfDescriptorExtractor SurfDescriptor;

Mat imageDesc1,imageDesc2;

SurfDescriptor.compute(image1,keyPoint1,imageDesc1);

SurfDescriptor.compute(image2,keyPoint2,imageDesc2);

//获得匹配特征点,并提取最优配对

FlannBasedMatcher matcher;

vector<DMatch> matchePoints;

matcher.match(imageDesc1,imageDesc2,matchePoints,Mat());

sort(matchePoints.begin(),matchePoints.end()); //特征点排序

//获取排在前N个的最优匹配特征点

vector<Point2f> imagePoints1,imagePoints2;

for(int i=0;i<10;i++)

{

imagePoints1.push_back(keyPoint1[matchePoints[i].queryIdx].pt);

imagePoints2.push_back(keyPoint2[matchePoints[i].trainIdx].pt);

}

//获取图像1到图像2的投影映射矩阵 尺寸为3*3

Mat homo=findHomography(imagePoints1,imagePoints2,CV_RANSAC);

////也可以使用getPerspectiveTransform方法获得透视变换矩阵,不过要求只能有4个点,效果稍差

//Mat homo=getPerspectiveTransform(imagePoints1,imagePoints2);

cout<<"变换矩阵为:\n"<<homo<<endl<<endl; //输出映射矩阵

//图像配准

Mat imageTransform1,imageTransform2;

warpPerspective(image01,imageTransform1,homo,Size(image02.cols,image02.rows));

imshow("经过透视矩阵变换后",imageTransform1);

waitKey();

return 0;

}测试图像:

配准基准(目标)图像:

配准效果:

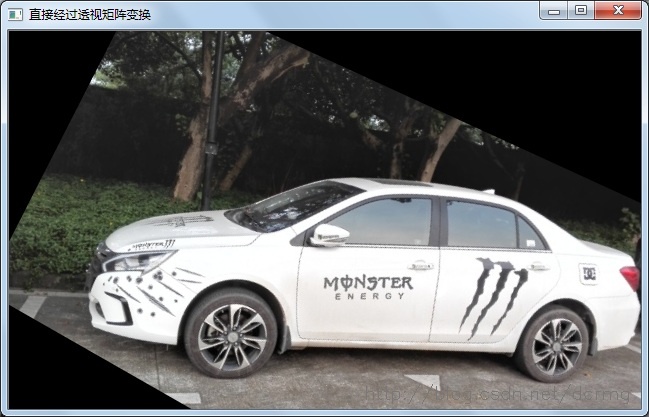

可以看到,使用Surf特征自动配准的效果还算可以,也不需要手动选取特征点,但是有点小遗憾是配准后原图的部分图像缺失了,如原始图像的左上角和左下角区域。

怎么解释这个现象呢?其实是因为原图像缺失部分经过透视矩阵变换后在新图像中位置坐标变成负的了,导致这部分直接被截取掉了。

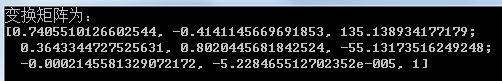

拿原始图像中的坐标为左上角的点(x0,y0)=(1,1)为例,本例中生成的透视变换矩阵H为:

经过矩阵H变换后目标图像的对应坐标为X(x,y):

所以变换后的目标点X(x,y)=(135/-4,-54/-4)= (-34,13) ,即x的坐标等于-34,小于零,所以直接被截取干掉了。

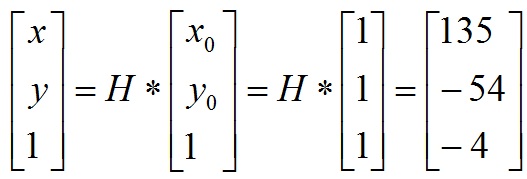

解决办法之一可以通过修正变换矩阵,对其加一个水平或垂直方向上的平移分量,保证变换后的目标坐标有一个偏移,偏移后的坐标大于0即可。其中H矩阵的第一行数据影响水平(x)方向的偏移,第二行数据影响垂直(y)方向的偏移。所以水平偏移需要修正H矩阵的第一行数据,垂直偏移需要修正H矩阵的第二行数据。

H矩阵数值的调整可以通过用一个3*3的矩阵相乘实现,水平方向的修正矩阵:

Mat adjustMat=(Mat_<double>(3,3)<<1.0,0,adjustValue,0,1.0,0,0,0,1.0);

垂直方向上的修正矩阵:

Mat adjustMat=(Mat_<double>(3,3)<<1.0,0,0,0,1.0,adjustValue,0,0,1.0);

水平和垂直两个方向上的修正矩阵:

Mat adjustMat=(Mat_<double>(3,3)<<1.0,0,adjustValue1,0,1.0,adjustValue2,0,0,1.0);

上边的修正(平移)系数adjustValue数值越大,在目标图像上坐标的偏移也就越大,大于零的adjustValue对应正方向上的平移,小于零的adjustValue对应负方向的平移。

以下是经过adjustMat矩阵修正过的H矩阵数据变化对比:

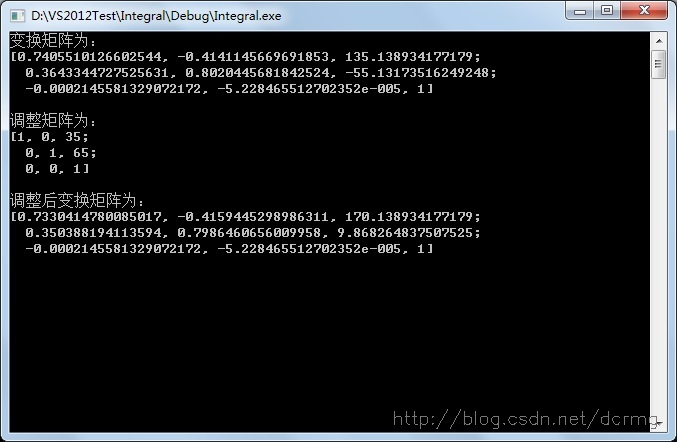

经过水平和垂直方向的平移修正之后的透视效果,两个角落区域的内容都可以显示出来了:

以下是对透视变换矩阵平移修正的完整代码,有兴趣可以参考试一试。

#include "highgui/highgui.hpp"

#include "opencv2/nonfree/nonfree.hpp"

#include "opencv2/legacy/legacy.hpp"

#include <iostream>

using namespace cv;

using namespace std;

int main(int argc,char *argv[])

{

Mat image01=imread(argv[1]);

Mat image02=imread(argv[2]);

imshow("原始测试图像",image01);

imshow("基准图像",image02);

//灰度图转换

Mat image1,image2;

cvtColor(image01,image1,CV_RGB2GRAY);

cvtColor(image02,image2,CV_RGB2GRAY);

//提取特征点

SurfFeatureDetector surfDetector(800); // 海塞矩阵阈值

vector<KeyPoint> keyPoint1,keyPoint2;

surfDetector.detect(image1,keyPoint1);

surfDetector.detect(image2,keyPoint2);

//特征点描述,为下边的特征点匹配做准备

SurfDescriptorExtractor SurfDescriptor;

Mat imageDesc1,imageDesc2;

SurfDescriptor.compute(image1,keyPoint1,imageDesc1);

SurfDescriptor.compute(image2,keyPoint2,imageDesc2);

//获得匹配特征点,并提取最优配对

FlannBasedMatcher matcher;

vector<DMatch> matchePoints;

matcher.match(imageDesc1,imageDesc2,matchePoints,Mat());

sort(matchePoints.begin(),matchePoints.end()); //特征点排序

//获取排在前N个的最优匹配特征点

vector<Point2f> imagePoints1,imagePoints2;

for(int i=0;i<10;i++)

{

imagePoints1.push_back(keyPoint1[matchePoints[i].queryIdx].pt);

imagePoints2.push_back(keyPoint2[matchePoints[i].trainIdx].pt);

}

//获取图像1到图像2的投影映射矩阵 尺寸为3*3

Mat homo=findHomography(imagePoints1,imagePoints2,CV_RANSAC);

////也可以使用getPerspectiveTransform方法获得透视变换矩阵,不过要求只能有4个点,效果稍差

//Mat homo=getPerspectiveTransform(imagePoints1,imagePoints2);

cout<<"变换矩阵为:\n"<<homo<<endl<<endl; //输出映射矩阵

double adjustValue=image1.cols;

Mat adjustMat=(Mat_<double>(3,3)<<1.0,0,35,0,1.0,65,0,0,1.0);

cout<<"调整矩阵为:\n"<<adjustMat<<endl<<endl;

cout<<"调整后变换矩阵为:\n"<<adjustMat*homo<<endl;

//图像配准

Mat imageTransform1,imageTransform2;

warpPerspective(image01,imageTransform1,homo,Size(image02.cols,image02.rows));

warpPerspective(image01,imageTransform2,adjustMat*homo,Size(image02.cols*1.3,image02.rows*1.8));

imshow("直接经过透视矩阵变换",imageTransform1);

imshow("经过平移修正后的透视矩阵变换",imageTransform2);

waitKey();

return 0;

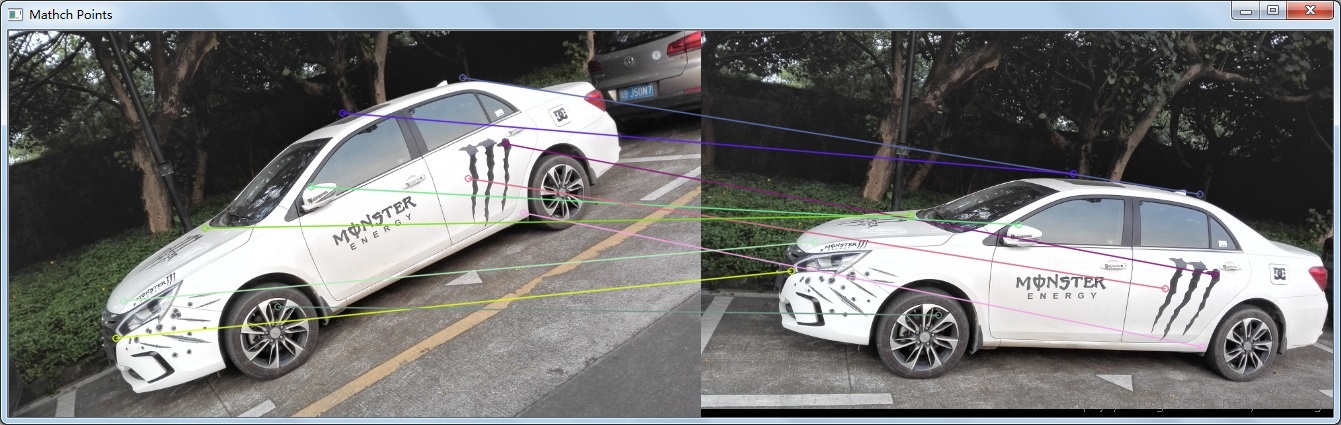

}顺便贴一下特征点的匹配效果:

Opencv中使用Surf特征实现图像配准及对透视变换矩阵H的平移修正的更多相关文章

- Opencv Sift和Surf特征实现图像无缝拼接生成全景图像

Sift和Surf算法实现两幅图像拼接的过程是一样的,主要分为4大部分: 1. 特征点提取和描述 2. 特征点配对,找到两幅图像中匹配点的位置 3. 通过配对点,生成变换矩阵,并对图像1应用变换矩阵生 ...

- 基于SURF特征的图像与视频拼接技术的研究和实现(一)

基于SURF特征的图像与视频拼接技术的研究和实现(一) 一直有计划研究实时图像拼接,但是直到最近拜读西电2013年张亚娟的<基于SURF特征的图像与视频拼接技术的研究和实现>,条 ...

- OpenCV中IplImage图像格式与BYTE图像数据的转换

最近在将Karlsruhe Institute of Technology的Andreas Geiger发表在ACCV2010上的Efficent Large-Scale Stereo Matchin ...

- OpenCV中的SURF算法介绍

SURF:speed up robust feature,翻译为快速鲁棒特征.首先就其中涉及到的特征点和描述符做一些简单的介绍: 特征点和描述符 特征点分为两类:狭义特征点和广义特征点.狭义特征点的位 ...

- 【OpenCV新手教程之十八】OpenCV仿射变换 & SURF特征点描写叙述合辑

本系列文章由@浅墨_毛星云 出品,转载请注明出处. 文章链接:http://blog.csdn.net/poem_qianmo/article/details/33320997 作者:毛星云(浅墨) ...

- OpenCV中基于Haar特征和级联分类器的人脸检测

使用机器学习的方法进行人脸检测的第一步需要训练人脸分类器,这是一个耗时耗力的过程,需要收集大量的正负样本,并且样本质量的好坏对结果影响巨大,如果样本没有处理好,再优秀的机器学习分类算法都是零. 今年3 ...

- OpenCV中基于HOG特征的行人检测

目前基于机器学习方法的行人检测的主流特征描述子之一是HOG(Histogram of Oriented Gradient, 方向梯度直方图).HOG特征是用于目标检测的特征描述子,它通过计算和统计图像 ...

- [OpenCV-Python] OpenCV 中图像特征提取与描述 部分 V (一)

部分 V图像特征提取与描述 OpenCV-Python 中文教程(搬运)目录 29 理解图像特征 目标本节我会试着帮你理解什么是图像特征,为什么图像特征很重要,为什么角点很重要等.29.1 解释 我相 ...

- OpenCV教程(47) sift特征和surf特征

在前面三篇教程中的几种角检测方法,比如harris角检测,都是旋转无关的,即使我们转动图像,依然能检测出角的位置,但是图像缩放后,harris角检测可能会失效,比如下面的图像,图像放大之前可 ...

随机推荐

- Redis原理(一)

基础和应用 1.Redis是远程调用技术的首字母缩写. 2.Redis可以用来做什么? Redis可以用来做缓存. 分布式锁 3.Redis的应用举例 记录帖子的点赞数.评论数和点击数.(使用HASH ...

- 修改shm,oracle11g需要扩大共享内存

作者:david_zhang@sh [转载时请以超链接形式标明文章] 链接:http://www.cnblogs.com/david-zhang-index/archive/2012/04/26/24 ...

- Cronolog 分割 Tomcat8 Catalina.out日志 (转)

默认情况下,tomcat的catalina.out日志文件是没有像其它日志一样,按日期进行分割,而是全部输出全部写入到一个catalina.out,这样日积月累就会造成.out日志越来越大,给管理造成 ...

- Android SimpleAdapter

1.MainActivity.java public class MainActivity extends Activity { private ListView listView; private ...

- UIViewController所有API的学习。

<欢迎大家加入iOS开发学习交流群:QQ529560119> /* UIViewController is a generic controller base class tha ...

- 安装filezilla client报错libgnutls版本旧

http://blog.csdn.net/mofabang/article/details/9212217

- 洛谷—— P1168 中位数

https://www.luogu.org/problem/show?pid=1168 题目描述 给出一个长度为N的非负整数序列A[i],对于所有1 ≤ k ≤ (N + 1) / 2,输出A[1], ...

- 在sublime text 3中安装中文支持 分类: C_OHTERS 2015-04-24 22:04 229人阅读 评论(0) 收藏

1.安装package control 使用control+~打开终端,然后输入以下内容并确定: import urllib.request,os;pf='Package Control.subli ...

- MM常用的双关语(男士必读)

我们还是当朋友好了 (其实你还是有多馀的利用价值)我想我真的不适合你(我根本就不喜欢你.)天气好冷喔,手都快结冰了 (快牵我的手吧,大木头!)我觉得我需要更多一点的空间 (我不太想看到你啦!)其实你人 ...

- Spring Boot初步认识

Spring Boot 来源及背后 Spring Boot开发始于 2013 年,伴随Spring4.0而生,2014 年 4 月发布 1.0.0 版本.当前版本1.4.0,http://projec ...