Spark操作parquet文件

package code.parquet import java.net.URI import org.apache.hadoop.conf.Configuration

import org.apache.hadoop.fs.{Path, FileSystem}

import org.apache.spark.sql.{SaveMode, SparkSession} /**

* Created by zhen on 2018/12/11.

*/

object ParquetIO {

// 指定hdfs根节点

private val hdfsRoot = "hdfs://172.20.32.163:8020"

// 获取HDFS路径

def getPath(path: String): Path = {

if (path.toLowerCase().startsWith("hdfs://")) {

new Path(path)

} else {

new Path(hdfsRoot + path)

}

}

def main(args: Array[String]) {

val spark = SparkSession.builder().appName("parquet").master("local[2]").getOrCreate()

spark.sparkContext.setLogLevel("WARN") // 设置日志级别为WARN

val fsUri = new URI(hdfsRoot)

val fs = FileSystem.get(fsUri, new Configuration())

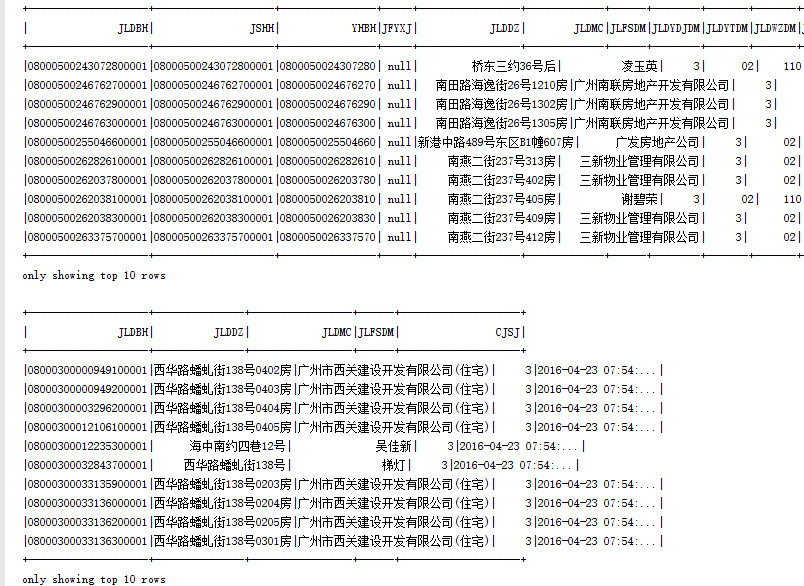

val path = hdfsRoot + "/YXFK/compute/KH_JLD"

val has = fs.exists(getPath(path))

if(has){

// 读取hdfs文件系统parquet数据

val dataFrame = spark.read.parquet(path)

dataFrame.show(10)

// 筛选,过滤数据

val result = dataFrame.select("JLDBH", "JLDDZ", "JLDMC", "JLFSDM", "CJSJ")

.filter("JLDDZ is not null AND JLFSDM = 3")

.sort("JLDBH")

result.show(10)

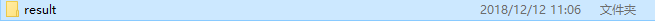

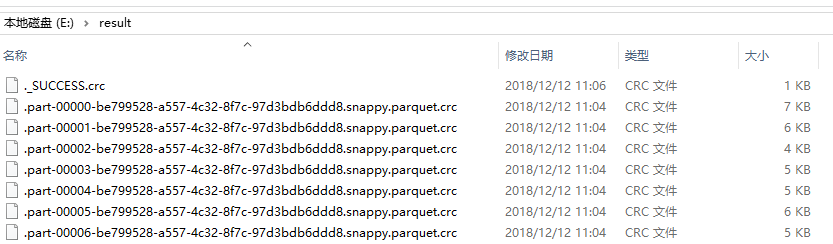

// 写入部分数据到本地

result.write.mode(SaveMode.Overwrite).parquet("E:\\result")

}

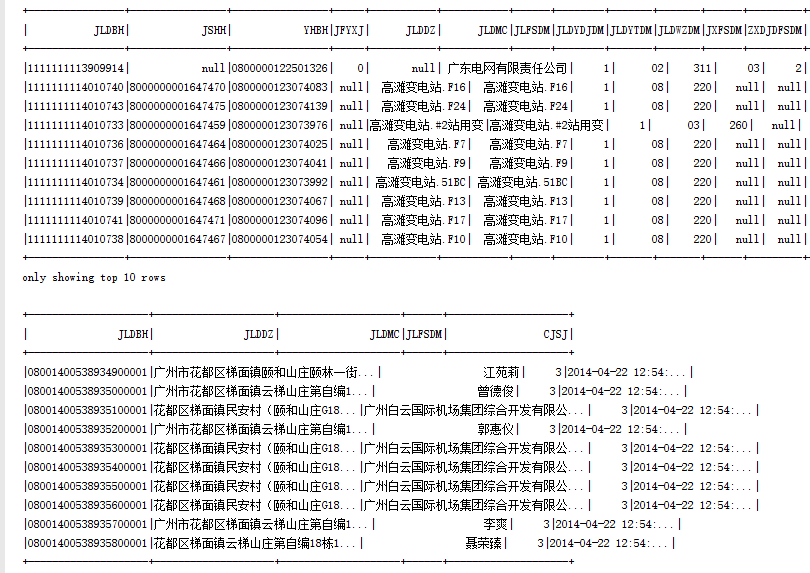

// 读取本地parquet数据

val localDataFrame = spark.read.parquet("E:\\jld.parquet")

localDataFrame.show(10)

// 读取写入数据验证

val resultSpace = spark.read.parquet("E:\\result")

resultSpace.show(10)

}

}

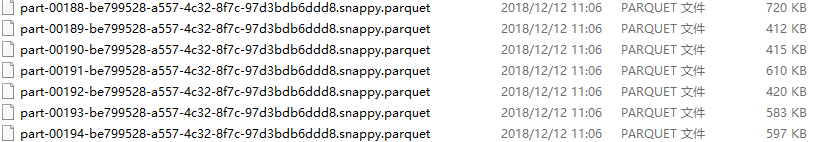

结果:

分析:Spark读取parquet数据默认为目录,因此可以只指定到你要读取的上级目录即可(本地模式除外),当保存为parquet时,会自动拆分,因此只能指定为上级目录。

Spark操作parquet文件的更多相关文章

- python读取hdfs上的parquet文件方式

在使用python做大数据和机器学习处理过程中,首先需要读取hdfs数据,对于常用格式数据一般比较容易读取,parquet略微特殊.从hdfs上使用python获取parquet格式数据的方法(当然也 ...

- Spark SQL读parquet文件及保存

import org.apache.spark.{SparkConf, SparkContext} import org.apache.spark.sql.{Row, SparkSession} im ...

- 大数据:Parquet文件存储格式

一.Parquet的组成 Parquet仅仅是一种存储格式,它是语言.平台无关的,并且不需要和任何一种数据处理框架绑定,目前能够和Parquet适配的组件包括下面这些,可以看出基本上通常使用的查询引擎 ...

- 大数据:Parquet文件存储格式【转】

一.Parquet的组成 Parquet仅仅是一种存储格式,它是语言.平台无关的,并且不需要和任何一种数据处理框架绑定,目前能够和Parquet适配的组件包括下面这些,可以看出基本上通常使用的查询引擎 ...

- Spark SQL 小文件问题处理

在生产中,无论是通过SQL语句或者Scala/Java等代码的方式使用Spark SQL处理数据,在Spark SQL写数据时,往往会遇到生成的小文件过多的问题,而管理这些大量的小文件,是一件非常头疼 ...

- Spark操作hbase

于Spark它是一个计算框架,于Spark环境,不仅支持单个文件操作,HDFS档,同时也可以使用Spark对Hbase操作. 从企业的数据源HBase取出.这涉及阅读hbase数据,在本文中尽快为了尽 ...

- scala读取parquet文件

import org.apache.spark.SparkConfimport org.apache.spark.SparkContextimport org.apache.spark.sql.SQL ...

- Spark操作实战

1. local模式 $SPARK_HOME/bin/spark-shell --master local import org.apache.log4j.{Level,Logger} // 导入ja ...

- 大数据学习day20-----spark03-----RDD编程实战案例(1 计算订单分类成交金额,2 将订单信息关联分类信息,并将这些数据存入Hbase中,3 使用Spark读取日志文件,根据Ip地址,查询地址对应的位置信息

1 RDD编程实战案例一 数据样例 字段说明: 其中cid中1代表手机,2代表家具,3代表服装 1.1 计算订单分类成交金额 需求:在给定的订单数据,根据订单的分类ID进行聚合,然后管理订单分类名称, ...

随机推荐

- spring-boot-starter大力出奇迹

一.前言 上篇文章我们已经聊了SpringBoot的启动过程中的各类扩展点,那么从http://start.spring.io上我们生成的demo项目中,到目前就剩下了maven工程的pom.xm ...

- leetcode — combination-sum

import java.util.ArrayList; import java.util.Arrays; import java.util.List; /** * Source : https://o ...

- Disconf源码分析之启动过程分析上(1)

Disconf的启动,主要是包括两次扫描和XML非注解式配置,总共分为上下两篇,上篇先主要介绍第一次静态扫描过程. 先从入口分析,通过Disconf帮助文档,可以看到xml必须添加如下配置. < ...

- Linux常用命令之帮助和用户管理命令

目录 1.帮助命令 一.获得命令或配置文件帮助信息:man 二.获得shell内置命令的帮助信息:help 三.获得命令的中文帮助信息:--help 2.用户管理命令 一.添加新用户:useradd ...

- Go语言的map如何判断key是否存在

判断方式为value,ok := map[key], ok为true则存在 package main import "fmt" func main() { demo := map[ ...

- python按引用赋值和深、浅拷贝

按引用赋值而不是拷贝副本 在python中,无论是直接的变量赋值,还是参数传递,都是按照引用进行赋值的. 在计算机语言中,有两种赋值方式:按引用赋值.按值赋值.其中按引用赋值也常称为按指针传值(当然, ...

- ES6 使用数据类型Set求交集、并集、差集

前言 ES6新增了数据类型Set,它是一种类似数组的数据结构.但它和数组的不同之处在于它的成员都是唯一的,也就是说可以用来去除数组重复成员. Set本身是一个构造函数用来生成Set数据结构. cons ...

- Linux服务器GlashFish的Domain管理

1.本文内容 Glassfish(V3.1)的Domain创建,删除,登陆,部署等 Linux客户端工具: SecureCRTPortable和 WinSCP (请自行下载) 2.1 新建Domain ...

- 32.QT-制作最强电压电阻表盘,可以自定义阴影效果,渐变颜色,图标,文字标签等-附带demo程序

由于上位机需要绘制电压电阻表盘,如下图所示: 后来,在网上找阿找,还是没找到满意的,索性自己来画控件算了,由于第一次画控件,所以花了我2天时间,才画好 效果图如下: 上图的所有颜色(包括滑动的渐变/单 ...

- spring boot @ResponseBody转换JSON 时 Date 类型处理方法,Jackson和FastJson两种方式,springboot 2.0.9配置fastjson不生效官方解决办法

spring boot @ResponseBody转换JSON 时 Date 类型处理方法 ,这里一共有两种不同解析方式(Jackson和FastJson两种方式,springboot我用的1.x的版 ...