Python3---爬虫---抓取百度贴吧

前言

该文章主要描述如何抓取百度贴吧内容。当然是简单爬虫实现功能,没有实现输入参数过滤等辅助功能,仅供小白学习。

修改时间:20191219

天象独行

import os,urllib.request,urllib.parse '''

测试要求:

1;输入吧名,首页,结束页进行爬虫。

2;创建一个以吧名为名字的文件夹,里面是每一页的html的内容,文件名格式:吧名_page.html

'''

url = "https://tieba.baidu.com/f?" ba_name = input("请输入需要下载的吧名: ")

home_page = int(input("请输入首页:"))

end_page = int(input("请输入结束页:"))

#创建一个路径变量:

path = "C:\\Users\\aaron\\Documents\\Python3-test"

os.makedirs(path)

'''

pn = 0 第一页

pn = 50 第二页

pn = 100 第三页

。。。。

pn = (n-1)*50 第n页

'''

for page in range(home_page,end_page+1):

#构造请求参数字典

data = {

"kw":ba_name,

"ie":"urt-8",

"pn":(page-1)*50

}

#构造请求hearders头

#构造请求参数

url_get = urllib.parse.urlencode(data)

#构造请求url

url_get = url + url_get

#请求url

request = urllib.request.urlopen(url_get)

#创建一个文件名

filename = ba_name + '_' + str(page) + '.html'

#拼接文件路径

filepath = path + '\\' + filename

print(filepath)

#写入内容

with open(filepath,'wb') as fp:

fp.write(request.read())

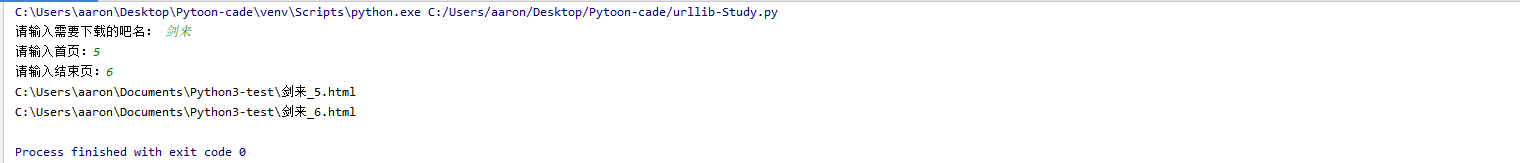

执行结果:

Python3---爬虫---抓取百度贴吧的更多相关文章

- 笔趣看小说Python3爬虫抓取

笔趣看小说Python3爬虫抓取 获取HTML信息 解析HTML信息 整合代码 获取HTML信息 # -*- coding:UTF-8 -*- import requests if __name__ ...

- 使用Python3爬虫抓取网页来下载小说

很多时候想看小说但是在网页上找不到资源,即使找到了资源也没有提供下载,小说当然是下载下来用手机看才爽快啦! 于是程序员的思维出来了,不能下载我就直接用爬虫把各个章节爬下来,存入一个txt文件中,这样, ...

- 关于Python3爬虫抓取网页Unicode

import urllib.requestresponse = urllib.request.urlopen('http://www.baidu.com')html = response.read() ...

- python3爬虫抓取智联招聘职位信息代码

上代码,有问题欢迎留言指出. # -*- coding: utf-8 -*- """ Created on Tue Aug 7 20:41:09 2018 @author ...

- Python3简单爬虫抓取网页图片

现在网上有很多python2写的爬虫抓取网页图片的实例,但不适用新手(新手都使用python3环境,不兼容python2), 所以我用Python3的语法写了一个简单抓取网页图片的实例,希望能够帮助到 ...

- Python爬虫之小试牛刀——使用Python抓取百度街景图像

之前用.Net做过一些自动化爬虫程序,听大牛们说使用python来写爬虫更便捷,按捺不住抽空试了一把,使用Python抓取百度街景影像. 这两天,武汉迎来了一个德国总理默克尔这位大人物,又刷了一把武汉 ...

- PHP网络爬虫实践:抓取百度搜索结果,并分析数据结构

百度的搜索引擎有反爬虫机制,我先直接用guzzle试试水.代码如下: <?php /** * Created by Benjiemin * Date: 2020/3/5 * Time: 14:5 ...

- python3 - 通过BeautifulSoup 4抓取百度百科人物相关链接

导入需要的模块 需要安装BeautifulSoup from urllib.request import urlopen, HTTPError, URLError from bs4 import Be ...

- Python抓取百度百科数据

前言 本文整理自慕课网<Python开发简单爬虫>,将会记录爬取百度百科"python"词条相关页面的整个过程. 抓取策略 确定目标:确定抓取哪个网站的哪些页面的哪部分 ...

- Python爬虫 - 爬取百度html代码前200行

Python爬虫 - 爬取百度html代码前200行 - 改进版, 增加了对字符串的.strip()处理 源代码如下: # 改进版, 增加了 .strip()方法的使用 # coding=utf-8 ...

随机推荐

- [译]OpenSSL Cookbook

记录个人学习过程吧,顺便翻译一下.另外,本文并不会包括原连接中的所有内容,仅包括个人在工作中会经常遇到的. 参考:OpenSSL Cookbook 前言 由于协议特性和实现的复杂性,有时很难确定安全服 ...

- (转)Polynomial interpolation 多项式插值

原文链接:https://blog.csdn.net/a19990412/article/details/87262531 扩展学习:https://www.sciencedirect.com/t ...

- java基础(1):java概述、jdk的安装、环境变量的配置、helloworld案例

1. Java开发环境搭建 1.1 java概述 众所周知Java是一门编程语言,编程语言就是用来编写软件的.那么使用Java到底能用来编写什么软件呢?你所熟知的很多软件都可以用Java来编写,例如: ...

- Cesium专栏-气象卫星云图动图(附源码下载)

Cesium Cesium 是一款面向三维地球和地图的,世界级的JavaScript开源产品.它提供了基于JavaScript语言的开发包,方便用户快速搭建一款零插件的虚拟地球Web应用,并在性能,精 ...

- [转]UiPath实践经验总结(二)

本文转自:https://www.cnblogs.com/ybyebo/p/10086473.html 1. UI操作容易受到各种意外的干扰,因此应该缩短UI操作阶段的总体时间.而为了缩短 ...

- iOS swift 带有attributeString的多行文本label

class AttributeStringGenerator { var attributeString: NSMutableAttributedString! var lineSpacing: CG ...

- Mysql—数据恢复

根据.frm和.ibd文件恢复表结构和数据

- Linux系统学习 八、SSH服务—SSH远程管理服务

1.SSH简介 ssh(安全外壳协议)是Secure Shell的缩写,是建立在应用层和传输层基础上的安全协议.传输的时候是经过加密的,防止信息泄露,比telnet(明文传递)要安全很多. ftp安装 ...

- 通过JTAG对比内核启动后text/rodata段内容

关键词:vmlinux.strip.dump._text.__end_rodata等等. 在日常的调试中,可能会在某些情况下踩到内核重要的数据,比如代码段或者rodata之类. 这种情况下,需要确认这 ...

- JUC-9-线程按序交替

package com.wf.zhang.juc; import java.util.concurrent.locks.Condition; import java.util.concurrent.l ...