Spark常用函数讲解之键值RDD转换

RDD:弹性分布式数据集,是一种特殊集合 ‚ 支持多种来源 ‚ 有容错机制 ‚ 可以被缓存 ‚ 支持并行操作,一个RDD代表一个分区里的数据集

RDD有两种操作算子:

Ation(执行):触发Spark作业的运行,真正触发转换算子的计算

本系列主要讲解Spark中常用的函数操作:

1.RDD基本转换

2.键-值RDD转换

3.Action操作篇

object MapValues {

def main(args: Array[String]) {

val conf = new SparkConf().setMaster("local").setAppName("map")

val sc = new SparkContext(conf)

val list = List(("mobin",22),("kpop",20),("lufei",23))

val rdd = sc.parallelize(list)

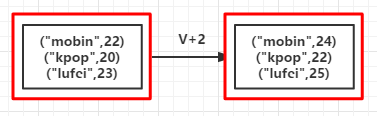

val mapValuesRDD = rdd.mapValues(_+2)

mapValuesRDD.foreach(println)

}

}

(mobin,)

(kpop,)

(lufei,)

//省略

val list = List(("mobin",22),("kpop",20),("lufei",23))

val rdd = sc.parallelize(list)

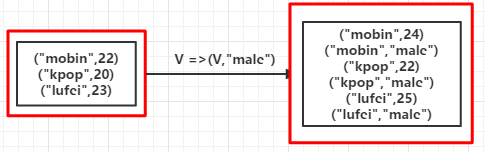

val mapValuesRDD = rdd.flatMapValues(x => Seq(x,"male"))

mapValuesRDD.foreach(println)

(mobin,)

(mobin,male)

(kpop,)

(kpop,male)

(lufei,)

(lufei,male)

(mobin,List(, male))

(kpop,List(, male))

(lufei,List(, male))

object CombineByKey {

def main(args: Array[String]) {

val conf = new SparkConf().setMaster("local").setAppName("combinByKey")

val sc = new SparkContext(conf)

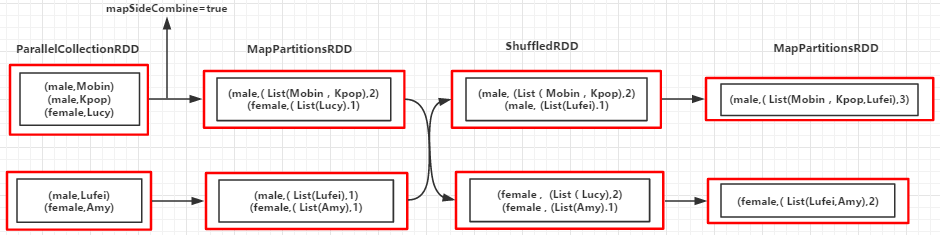

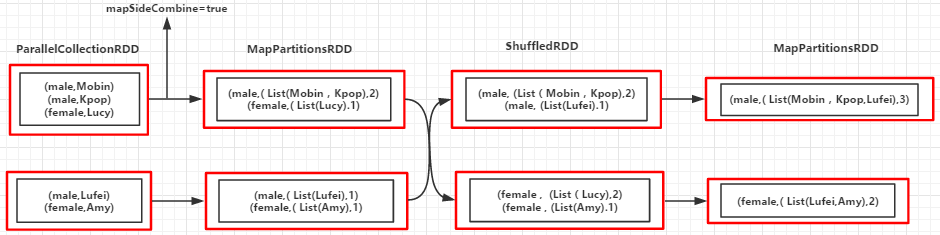

val people = List(("male", "Mobin"), ("male", "Kpop"), ("female", "Lucy"), ("male", "Lufei"), ("female", "Amy"))

val rdd = sc.parallelize(people)

val combinByKeyRDD = rdd.combineByKey(

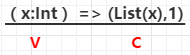

(x: String) => (List(x), 1),

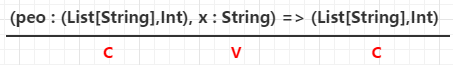

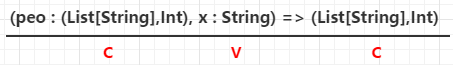

(peo: (List[String], Int), x : String) => (x :: peo._1, peo._2 + 1),

(sex1: (List[String], Int), sex2: (List[String], Int)) => (sex1._1 ::: sex2._1, sex1._2 + sex2._2))

combinByKeyRDD.foreach(println)

sc.stop()

}

}

(male,(List(Lufei, Kpop, Mobin),))

(female,(List(Amy, Lucy),))

Partition1:

K="male" --> ("male","Mobin") --> createCombiner("Mobin") => peo1 = ( List("Mobin") , )

K="male" --> ("male","Kpop") --> mergeValue(peo1,"Kpop") => peo2 = ( "Kpop" :: peo1_1 , + ) //Key相同调用mergeValue函数对值进行合并

K="female" --> ("female","Lucy") --> createCombiner("Lucy") => peo3 = ( List("Lucy") , ) Partition2:

K="male" --> ("male","Lufei") --> createCombiner("Lufei") => peo4 = ( List("Lufei") , )

K="female" --> ("female","Amy") --> createCombiner("Amy") => peo5 = ( List("Amy") , ) Merger Partition:

K="male" --> mergeCombiners(peo2,peo4) => (List(Lufei,Kpop,Mobin))

K="female" --> mergeCombiners(peo3,peo5) => (List(Amy,Lucy))

//省略

val people = List(("Mobin", 2), ("Mobin", 1), ("Lucy", 2), ("Amy", 1), ("Lucy", 3))

val rdd = sc.parallelize(people)

val foldByKeyRDD = rdd.foldByKey(2)(_+_)

foldByKeyRDD.foreach(println)

(Amy,)

(Mobin,)

(Lucy,)

//省略

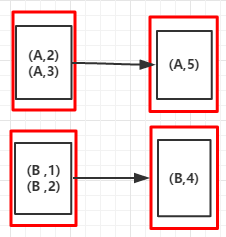

val arr = List(("A",3),("A",2),("B",1),("B",3))

val rdd = sc.parallelize(arr)

val reduceByKeyRDD = rdd.reduceByKey(_ +_)

reduceByKeyRDD.foreach(println)

sc.stop

(A,)

(A,)

//省略

val arr = List(("A",1),("B",2),("A",2),("B",3))

val rdd = sc.parallelize(arr)

val groupByKeyRDD = rdd.groupByKey()

groupByKeyRDD.foreach(println)

sc.stop

(B,CompactBuffer(, ))

(A,CompactBuffer(, ))

//省略sc

val arr = List(("A",1),("B",2),("A",2),("B",3))

val rdd = sc.parallelize(arr)

val sortByKeyRDD = rdd.sortByKey()

sortByKeyRDD.foreach(println)

sc.stop

(A,)

(A,)

(B,)

(B,)

//省略

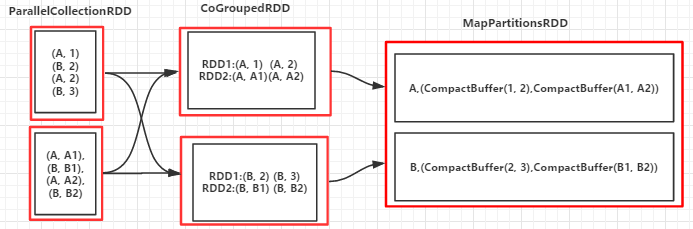

val arr = List(("A", 1), ("B", 2), ("A", 2), ("B", 3))

val arr1 = List(("A", "A1"), ("B", "B1"), ("A", "A2"), ("B", "B2"))

val rdd1 = sc.parallelize(arr, 3)

val rdd2 = sc.parallelize(arr1, 3)

val groupByKeyRDD = rdd1.cogroup(rdd2)

groupByKeyRDD.foreach(println)

sc.stop

(B,(CompactBuffer(, ),CompactBuffer(B1, B2)))

(A,(CompactBuffer(, ),CompactBuffer(A1, A2)))

//省略

val arr = List(("A", 1), ("B", 2), ("A", 2), ("B", 3))

val arr1 = List(("A", "A1"), ("B", "B1"), ("A", "A2"), ("B", "B2"))

val rdd = sc.parallelize(arr, 3)

val rdd1 = sc.parallelize(arr1, 3)

val groupByKeyRDD = rdd.join(rdd1)

groupByKeyRDD.foreach(println)

(B,(,B1))

(B,(,B2))

(B,(,B1))

(B,(,B2)) (A,(,A1))

(A,(,A2))

(A,(,A1))

(A,(,A2)

//省略

val arr = List(("A", 1), ("B", 2), ("A", 2), ("B", 3),("C",1))

val arr1 = List(("A", "A1"), ("B", "B1"), ("A", "A2"), ("B", "B2"))

val rdd = sc.parallelize(arr, 3)

val rdd1 = sc.parallelize(arr1, 3)

val leftOutJoinRDD = rdd.leftOuterJoin(rdd1)

leftOutJoinRDD .foreach(println)

sc.stop

(B,(,Some(B1)))

(B,(,Some(B2)))

(B,(,Some(B1)))

(B,(,Some(B2))) (C,(,None)) (A,(,Some(A1)))

(A,(,Some(A2)))

(A,(,Some(A1)))

(A,(,Some(A2)))

//省略

val arr = List(("A", 1), ("B", 2), ("A", 2), ("B", 3))

val arr1 = List(("A", "A1"), ("B", "B1"), ("A", "A2"), ("B", "B2"),("C","C1"))

val rdd = sc.parallelize(arr, 3)

val rdd1 = sc.parallelize(arr1, 3)

val rightOutJoinRDD = rdd.rightOuterJoin(rdd1)

rightOutJoinRDD.foreach(println)

sc.stop

(B,(Some(),B1))

(B,(Some(),B2))

(B,(Some(),B1))

(B,(Some(),B2)) (C,(None,C1)) (A,(Some(),A1))

(A,(Some(),A2))

(A,(Some(),A1))

(A,(Some(),A2))

Spark常用函数讲解之键值RDD转换的更多相关文章

- Spark常用函数讲解之Action操作

摘要: RDD:弹性分布式数据集,是一种特殊集合 ‚ 支持多种来源 ‚ 有容错机制 ‚ 可以被缓存 ‚ 支持并行操作,一个RDD代表一个分区里的数据集RDD有两种操作算子: Trans ...

- Spark之键值RDD转换(转载)

1.mapValus(fun):对[K,V]型数据中的V值map操作(例1):对每个的的年龄加2 object MapValues { def main(args: Array[String]) { ...

- Spark学习笔记3:键值对操作

键值对RDD通常用来进行聚合计算,Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为pair RDD.pair RDD提供了并行操作各个键或跨节点重新进行数据分组的操作接口. S ...

- spark 常用函数介绍(python)

以下是个人理解,一切以官网文档为准. http://spark.apache.org/docs/latest/api/python/pyspark.html 在开始之前,我先介绍一下,RDD是什么? ...

- spark入门(三)键值对操作

1 简述 Spark为包含键值对类型的RDD提供了一些专有的操作.这些RDD被称为PairRDD. 2 创建PairRDD 2.1 在sprk中,很多存储键值对的数据在读取时直接返回由其键值对数据组成 ...

- Spark常用函数(源码阅读六)

源码层面整理下我们常用的操作RDD数据处理与分析的函数,从而能更好的应用于工作中. 连接Hbase,读取hbase的过程,首先代码如下: def tableInitByTime(sc : SparkC ...

- 四、spark常用函数说明学习

1.parallelize 并行集合,切片数.默认为这个程序所分配到的资源的cpu核的个数. 查看大小:rdd.partitions.size sc.paraliel ...

- Opencv常用函数讲解

1.approxPolyDP(Mat(ps), poly, 5, true);//根据点集,拟合出多边形 2.fillConvexPoly(mask, Mat(ps), Scalar(255));根据 ...

- Spark函数详解系列之RDD基本转换

摘要: RDD:弹性分布式数据集,是一种特殊集合 ‚ 支持多种来源 ‚ 有容错机制 ‚ 可以被缓存 ‚ 支持并行操作,一个RDD代表一个分区里的数据集 RDD有两种操作算子: ...

随机推荐

- Hibernate入门之关系篇:多对一和一对多映射

关联关系映射,是对象映射关系中相对复杂的一种,但也是用处最多的一种,因为数据中的表不可能都是单独存在,彼此之间必定存在千丝万缕的联系,这也是关系型数据库的特征所在.同样关联关系的映射,也是对象关系映射 ...

- HDU 1027 Ignatius and the Princess II 选择序列题解

直接选择序列的方法解本题,可是最坏时间效率是O(n*n),故此不能达到0MS. 使用删除优化,那么就能够达到0MS了. 删除优化就是当须要删除数组中的元素为第一个元素的时候,那么就直接移动数组的头指针 ...

- QT5 r 加入qwtplot3d 三维库

qwtplot3d是基于QtOpenGL开发的,也是qwt库的三维库,我使用的是qwtplot3d-0.2.7.zip版本. 步骤跟编译qwt库一样(不明白可以看回前面写的一篇文章“Q ...

- docke 网络配置

一,docker 的bridge模式是和vmware中的nat模式类似的,但是如果想要弄成和vmwae中的bridge怎么办呢? 说明,bridge模式获取的Ip是与宿主机的ip是出于同一个网段的. ...

- VCS仿真 Dump Memory

VCS仿真 Dump Memory 两种方法 vcs联合verdi生成fsdb文件 vcs生成vpd文件 VCS联合verdi生成fsdb文件 1.testbench中加入如下语句: initial ...

- web并发访问的问题

一般的webapplication,可能会遇到这样的问题,你可以这样模拟:用浏览器开一个窗口,选中一条记录,编辑之,但是先不要保存,新开一个浏览器窗口,找到这条记录,删除之,然后再回到第一个窗口点击保 ...

- oracle学习笔记(二)表的查询

--oracle表的管理 --创建表 )); --删除表 drop table users; --创建表 ),xm ),sex ),birthday date,sal ,)); ),cnmae )); ...

- Unable to open log device '/dev/log/main': No such file or directory

在我们使用真机进行Android应用调试时,无法获得调试信息,错误提示如下:Unable to open log device '/dev/log/main': No such file or dir ...

- WCF Service端Inspector

问题 在使用WCF的过程中,有时候需要在service端截取client和service之间的消息来做一些如写log,检查message是否合法的操作. 那么如何才能实现呢? 解决方案 使用WCF提供 ...

- java递归删除指定目录下的文件和文件夹

public static boolean deleteFolder(String delDir) { File delFolder = new File(delDir); File[] delFil ...