爬虫_电影天堂 热映电影(xpath)

写了一天才写了不到100行。不过总归是按自己的思路完成了

import requests

from lxml import etree

import time BASE = 'http://www.dytt8.net'

def get_one_page(url):

headers = {'User-Agent': 'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.75 Safari/537.36'}

try: response = requests.get(url, headers=headers)

response.encoding = response.apparent_encoding

return response.text

except:

return 0 def parse_one_page_href(html):

str_hrefs = []

html_element = etree.HTML(html)

# //div[@class="co_content8"]/ul/table//a/@href

hrefs = html_element.xpath('//table[@class="tbspan"]//a/@href')

for href in hrefs:

href = BASE + href

str_hrefs.append(href)

return str_hrefs """

return

['http://www.dytt8.net/html/gndy/dyzz/20180731/57193.html',

'http://www.dytt8.net/html/gndy/dyzz/20180730/57192.html',

......

'http://www.dytt8.net/html/gndy/dyzz/20180702/57064.html',

'http://www.dytt8.net/html/gndy/dyzz/20180630/57056.html']

""" def get_all_pages(page_nums):

hrefs = []

for index in range(1, page_nums + 1):

url = 'http://www.dytt8.net/html/gndy/dyzz/list_23_' + str(index) + '.html'

html = get_one_page(url)

while html == 0:

time.sleep(3)

html = get_one_page(url)

hrefs.extend(parse_one_page_href(html))

return hrefs def get_detail(page_nums):

movie = []

hrefs = get_all_pages(page_nums)

for href in hrefs: #href: every page url

informations = {} response = requests.get(href)

response.encoding = response.apparent_encoding

html = response.text html_element = etree.HTML(html) title = html_element.xpath('//font[@color="#07519a"]/text()')[0]

informations['title'] = title image_src = html_element.xpath('//p//img/@src')

informations['image_src'] = image_src[0] download_url = html_element.xpath('//td[@bgcolor="#fdfddf"]/a/@href')

informations['download_url'] = download_url texts = html_element.xpath('//div[@id="Zoom"]//p/text()')

for index, text in enumerate(texts): if text.startswith('◎片 名'):

text = text.replace('◎片 名', '').strip()

informations['english_name'] = text elif text.startswith('◎产 地'):

text = text.replace('◎产 地', '').strip()

informations['location'] = text elif text.startswith('◎上映日期'):

text = text.replace('◎上映日期', '').strip()

informations['date'] = text elif text.startswith('◎片 长'):

text = text.replace('◎片 长', '').strip()

informations['time'] = text elif text.startswith('◎导 演'):

text = text.replace('◎导 演', '').strip()

informations['director'] = text elif text.startswith('◎主 演'):

text = text.replace('◎主 演', '').strip()

actors = []

actors.append(text)

for x in range(index+1, len(texts)):

actor = texts[x].strip()

if texts[x].startswith('◎简 介'):

break

actors.append(actor)

informations['actors'] = actors elif text.startswith('◎简 介 '):

text = text.replace('◎简 介 ', '').strip()

intros = []

# intros.append(text)

for x in range(index+1, len(texts)):

intro = texts[x].strip()

if texts[x].startswith('◎获奖情况'):

break

intros.append(intro)

informations['intros'] = intros

movie.append(informations)

return movie def main():

page_nums = 1 #

movie = get_detail(page_nums)

print(movie) if __name__ == '__main__':

main()

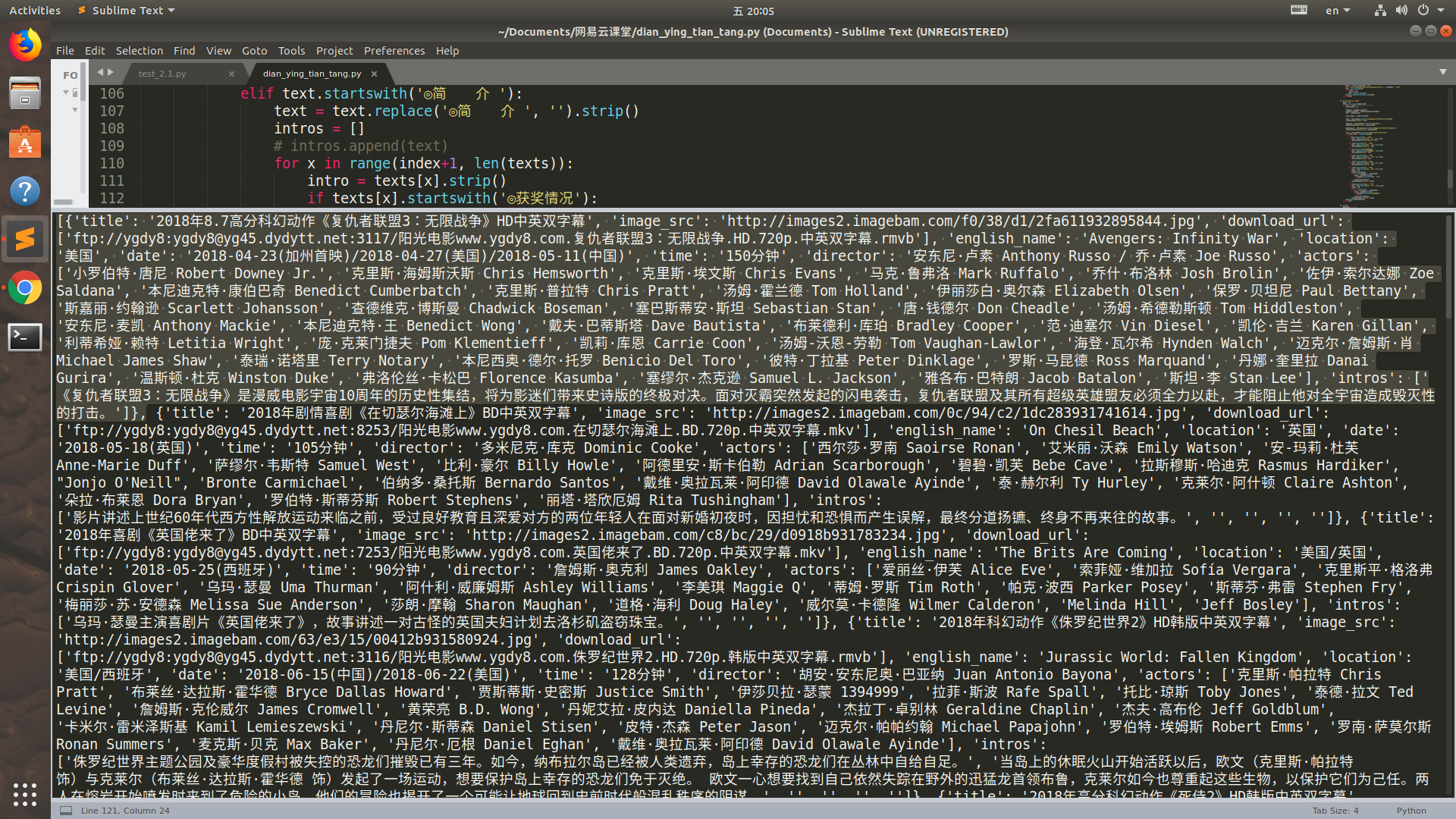

运行结果:(选中的是一部电影, 一页中有25部电影,网站里一共有176页)

感受到了代码的魅力了吗

爬虫_电影天堂 热映电影(xpath)的更多相关文章

- python爬虫——爬取淘票票正在热映电影

今天正好学习了一下python的爬虫,觉得收获蛮大的,所以写一篇博客帮助想学习爬虫的伙伴们. 这里我就以一个简单地爬取淘票票正在热映电影为例,介绍一下一个爬虫的完整流程. 首先,话不多说,上干货——源 ...

- Node.js 抓取电影天堂新上电影节目单及ftp链接

代码地址如下:http://www.demodashi.com/demo/12368.html 1 概述 本实例主要使用Node.js去抓取电影的节目单,方便大家使用下载. 2 node packag ...

- 爬虫_豆瓣全部正在热映电影 (xpath)

单纯地练习一下xpath import requests from lxml import etree def get_url(url): html = requests.get(url) retur ...

- python爬虫——词云分析最热门电影《后来的我们》

1 模块库使用说明 1.1 requests库 requests 是用Python语言编写,基于 urllib,采用 Apache2 Licensed 开源协议的 HTTP 库.它比 urllib 更 ...

- python利用requests和threading模块,实现多线程爬取电影天堂最新电影信息。

利用爬到的数据,基于Django搭建的一个最新电影信息网站: n1celll.xyz (用的花生壳动态域名解析,服务器在自己的电脑上,纯属自娱自乐哈.) 今天想利用所学知识来爬取电影天堂所有最新电影 ...

- LOL电影天堂下载攻略

LOL电影天堂&&飘花电影网下载攻略 CreateTime--2017年7月27日08:52:29Author:Marydon 以进击的巨人为例 下载地址:http://www.l ...

- Python多线程爬虫爬取电影天堂资源

最近花些时间学习了一下Python,并写了一个多线程的爬虫程序来获取电影天堂上资源的迅雷下载地址,代码已经上传到GitHub上了,需要的同学可以自行下载.刚开始学习python希望可以获得宝贵的意见. ...

- scrapy电影天堂实战(二)创建爬虫项目

公众号原文 创建数据库 我在上一篇笔记中已经创建了数据库,具体查看<scrapy电影天堂实战(一)创建数据库>,这篇笔记创建scrapy实例,先熟悉下要用到到xpath知识 用到的xpat ...

- 用python+selenium抓取豆瓣电影中的正在热映前12部电影并按评分排序

抓取豆瓣电影(http://movie.douban.com/nowplaying/chengdu/)中的正在热映前12部电影,并按照评分排序,保存至txt文件 #coding=utf-8 from ...

随机推荐

- ACM/ICPC 2018亚洲区预选赛北京赛站网络赛D-80 Days--------树状数组

题意就是说1-N个城市为一个环,最开始你手里有C块钱,问从1->N这些城市中,选择任意一个,然后按照顺序绕环一圈,进入每个城市会有a[i]元钱,出来每个城市会有b[i]个城市,问是否能保证经过每 ...

- Day9 Python基础之函数基础(七)

参考链接:https://www.cnblogs.com/yuanchenqi/articles/5828233.html 1.函数的定义 定义: 函数是指将一组语句的集合通过一个函数名封装起来,要想 ...

- 福州大学软件工程1816 | W班 第1次作业成绩排名

1.作业地址 第一次作业--准备篇 2.作业要求 (1)回想一下你初入大学时对计算机专业的畅想 当初你是如何做出选择计算机专业的决定的? 你认为过去两年中接触到的课程是否符合你对计算机专业的期待,为什 ...

- 爬虫——selenium基础

Selenium,自动化浏览器技术.主要用于web应用自动测试和自动完成web基本任务管理.官方网站:https://selenium-python.readthedocs.io/getting-st ...

- Linux查看硬件等基本参数

http://www.cnblogs.com/xd502djj/archive/2011/02/28/1967350.html

- http/https与websocket的ws/wss的关系以及通过Nginx的配置

http/https与websocket的ws/wss的关系 - 哒哒哒 - CSDN博客 https://blog.csdn.net/Garrettzxd/article/details/81674 ...

- iOS 10的两个坑

iOS 10出现白屏幕,其他机型不会. 一个bug 手机连上电脑,在电脑端的Safari里,看到了如下的错误: SyntaxError: Cannot declare a let variable t ...

- IdentityServer4【QuickStart】之使用ResourceOwnerPassword流程来保护API

使用ResourceOwnerPassword流程来保护API OAuth2.0中的ResourceOwnerPassword授权流程允许一个客户端发送username和password到token服 ...

- 源码追踪,解决Could not locate executable null\bin\winutils.exe in the Hadoop binaries.问题

在windows系统本地运行spark的wordcount程序,会出现一个异常,但不影响现有程序运行. >>提君博客原创 http://www.cnblogs.com/tijun/ & ...

- leetcode:Roman to Integer and Integer to Roman

2015-06-03 罗马数字以前接触过I到VIII比较多,直到遇见这个题目才知道更详细.阿拉伯数字和罗马数字之间的转换最重的是了解罗马数字的规则. 罗马数字规则:(总结) 1, 罗马数字共有7个,即 ...