入门大数据---Spark_Structured API的基本使用

一、创建DataFrame和Dataset

1.1 创建DataFrame

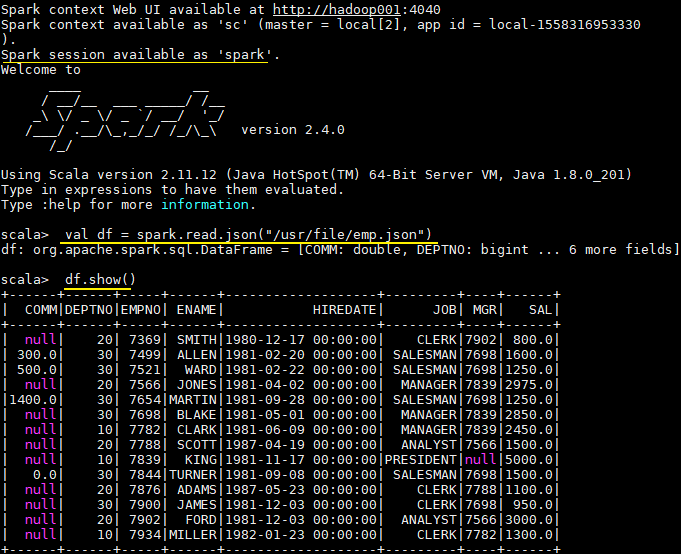

Spark 中所有功能的入口点是 SparkSession,可以使用 SparkSession.builder() 创建。创建后应用程序就可以从现有 RDD,Hive 表或 Spark 数据源创建 DataFrame。示例如下:

val spark = SparkSession.builder().appName("Spark-SQL").master("local[2]").getOrCreate()

val df = spark.read.json("/usr/file/json/emp.json")

df.show()

// 建议在进行 spark SQL 编程前导入下面的隐式转换,因为 DataFrames 和 dataSets 中很多操作都依赖了隐式转换

import spark.implicits._

可以使用 spark-shell 进行测试,需要注意的是 spark-shell 启动后会自动创建一个名为 spark 的 SparkSession,在命令行中可以直接引用即可:

1.2 创建Dataset

Spark 支持由内部数据集和外部数据集来创建 DataSet,其创建方式分别如下:

1. 由外部数据集创建

// 1.需要导入隐式转换

import spark.implicits._

// 2.创建 case class,等价于 Java Bean

case class Emp(ename: String, comm: Double, deptno: Long, empno: Long,

hiredate: String, job: String, mgr: Long, sal: Double)

// 3.由外部数据集创建 Datasets

val ds = spark.read.json("/usr/file/emp.json").as[Emp]

ds.show()

2. 由内部数据集创建

// 1.需要导入隐式转换

import spark.implicits._

// 2.创建 case class,等价于 Java Bean

case class Emp(ename: String, comm: Double, deptno: Long, empno: Long,

hiredate: String, job: String, mgr: Long, sal: Double)

// 3.由内部数据集创建 Datasets

val caseClassDS = Seq(Emp("ALLEN", 300.0, 30, 7499, "1981-02-20 00:00:00", "SALESMAN", 7698, 1600.0),

Emp("JONES", 300.0, 30, 7499, "1981-02-20 00:00:00", "SALESMAN", 7698, 1600.0))

.toDS()

caseClassDS.show()

1.3 由RDD创建DataFrame

Spark 支持两种方式把 RDD 转换为 DataFrame,分别是使用反射推断和指定 Schema 转换:

1. 使用反射推断

// 1.导入隐式转换

import spark.implicits._

// 2.创建部门类

case class Dept(deptno: Long, dname: String, loc: String)

// 3.创建 RDD 并转换为 dataSet

val rddToDS = spark.sparkContext

.textFile("/usr/file/dept.txt")

.map(_.split("\t"))

.map(line => Dept(line(0).trim.toLong, line(1), line(2)))

.toDS() // 如果调用 toDF() 则转换为 dataFrame

2. 以编程方式指定Schema

import org.apache.spark.sql.Row

import org.apache.spark.sql.types._

// 1.定义每个列的列类型

val fields = Array(StructField("deptno", LongType, nullable = true),

StructField("dname", StringType, nullable = true),

StructField("loc", StringType, nullable = true))

// 2.创建 schema

val schema = StructType(fields)

// 3.创建 RDD

val deptRDD = spark.sparkContext.textFile("/usr/file/dept.txt")

val rowRDD = deptRDD.map(_.split("\t")).map(line => Row(line(0).toLong, line(1), line(2)))

// 4.将 RDD 转换为 dataFrame

val deptDF = spark.createDataFrame(rowRDD, schema)

deptDF.show()

1.4 DataFrames与Datasets互相转换

Spark 提供了非常简单的转换方法用于 DataFrame 与 Dataset 间的互相转换,示例如下:

# DataFrames转Datasets

scala> df.as[Emp]

res1: org.apache.spark.sql.Dataset[Emp] = [COMM: double, DEPTNO: bigint ... 6 more fields]

# Datasets转DataFrames

scala> ds.toDF()

res2: org.apache.spark.sql.DataFrame = [COMM: double, DEPTNO: bigint ... 6 more fields]

二、Columns列操作

2.1 引用列

Spark 支持多种方法来构造和引用列,最简单的是使用 col() 或 column() 函数。

col("colName")

column("colName")

// 对于 Scala 语言而言,还可以使用$"myColumn"和'myColumn 这两种语法糖进行引用。

df.select($"ename", $"job").show()

df.select('ename, 'job).show()

2.2 新增列

// 基于已有列值新增列

df.withColumn("upSal",$"sal"+1000)

// 基于固定值新增列

df.withColumn("intCol",lit(1000))

2.3 删除列

// 支持删除多个列

df.drop("comm","job").show()

2.4 重命名列

df.withColumnRenamed("comm", "common").show()

需要说明的是新增,删除,重命名列都会产生新的 DataFrame,原来的 DataFrame 不会被改变。

三、使用Structured API进行基本查询

// 1.查询员工姓名及工作

df.select($"ename", $"job").show()

// 2.filter 查询工资大于 2000 的员工信息

df.filter($"sal" > 2000).show()

// 3.orderBy 按照部门编号降序,工资升序进行查询

df.orderBy(desc("deptno"), asc("sal")).show()

// 4.limit 查询工资最高的 3 名员工的信息

df.orderBy(desc("sal")).limit(3).show()

// 5.distinct 查询所有部门编号

df.select("deptno").distinct().show()

// 6.groupBy 分组统计部门人数

df.groupBy("deptno").count().show()

四、使用Spark SQL进行基本查询

4.1 Spark SQL基本使用

// 1.首先需要将 DataFrame 注册为临时视图

df.createOrReplaceTempView("emp")

// 2.查询员工姓名及工作

spark.sql("SELECT ename,job FROM emp").show()

// 3.查询工资大于 2000 的员工信息

spark.sql("SELECT * FROM emp where sal > 2000").show()

// 4.orderBy 按照部门编号降序,工资升序进行查询

spark.sql("SELECT * FROM emp ORDER BY deptno DESC,sal ASC").show()

// 5.limit 查询工资最高的 3 名员工的信息

spark.sql("SELECT * FROM emp ORDER BY sal DESC LIMIT 3").show()

// 6.distinct 查询所有部门编号

spark.sql("SELECT DISTINCT(deptno) FROM emp").show()

// 7.分组统计部门人数

spark.sql("SELECT deptno,count(ename) FROM emp group by deptno").show()

4.2 全局临时视图

上面使用 createOrReplaceTempView 创建的是会话临时视图,它的生命周期仅限于会话范围,会随会话的结束而结束。

你也可以使用 createGlobalTempView 创建全局临时视图,全局临时视图可以在所有会话之间共享,并直到整个 Spark 应用程序终止后才会消失。全局临时视图被定义在内置的 global_temp 数据库下,需要使用限定名称进行引用,如 SELECT * FROM global_temp.view1。

// 注册为全局临时视图

df.createGlobalTempView("gemp")

// 使用限定名称进行引用

spark.sql("SELECT ename,job FROM global_temp.gemp").show()

参考资料

Spark SQL, DataFrames and Datasets Guide > Getting Started

入门大数据---Spark_Structured API的基本使用的更多相关文章

- 入门大数据---Flink学习总括

第一节 初识 Flink 在数据激增的时代,催生出了一批计算框架.最早期比较流行的有MapReduce,然后有Spark,直到现在越来越多的公司采用Flink处理.Flink相对前两个框架真正做到了高 ...

- 入门大数据---SparkSQL外部数据源

一.简介 1.1 多数据源支持 Spark 支持以下六个核心数据源,同时 Spark 社区还提供了多达上百种数据源的读取方式,能够满足绝大部分使用场景. CSV JSON Parquet ORC JD ...

- 入门大数据---Hadoop是什么?

简单概括:Hadoop是由Apache组织使用Java语言开发的一款应对大数据存储和计算的分布式开源框架. Hadoop的起源 2003-2004年,Google公布了部分GFS和MapReduce思 ...

- 入门大数据---Kylin是什么?

一.Kylin是什么? Apache Kylin是一个开源的.分布式的分析型数据仓库,提供Hadoop/Spark 上的SQL查询接口及多维度分析(OLAP)能力以支持超大规模的数据,最初由eBay开 ...

- 入门大数据---Spark_Streaming整合Flume

一.简介 Apache Flume 是一个分布式,高可用的数据收集系统,可以从不同的数据源收集数据,经过聚合后发送到分布式计算框架或者存储系统中.Spark Straming 提供了以下两种方式用于 ...

- 入门大数据---MapReduce-API操作

一.环境 Hadoop部署环境: Centos3.10.0-327.el7.x86_64 Hadoop2.6.5 Java1.8.0_221 代码运行环境: Windows 10 Hadoop 2.6 ...

- 入门大数据---Flume整合Kafka

一.背景 先说一下,为什么要使用 Flume + Kafka? 以实时流处理项目为例,由于采集的数据量可能存在峰值和峰谷,假设是一个电商项目,那么峰值通常出现在秒杀时,这时如果直接将 Flume 聚合 ...

- 入门大数据---安装ClouderaManager,CDH和Impala,Hue,oozie等服务

1.要求和支持的版本 (PS:我使用的环境,都用加粗标识了.) 1.1 支持的操作系统版本 操作系统 版本 RHEL/CentOS/OL with RHCK kernel 7.6, 7.5, 7.4, ...

- 入门大数据---Spark整体复习

一. Spark简介 1.1 前言 Apache Spark是一个基于内存的计算框架,它是Scala语言开发的,而且提供了一站式解决方案,提供了包括内存计算(Spark Core),流式计算(Spar ...

随机推荐

- xxd十六进制编辑器的安装

一.背景:在vi中使用命令:%!xxd无法进行十六进制编辑,为缺少xxd命令所致 二.yum直接安装xxd无法成功[root@ELK ~]# yum install xxd已加载插件:fastestm ...

- vue 中引入使用jquery

1.首先在配置文件中添加 cnpm install 下载jquery文件 2.在webpack配置文件中添加下面代码 3.接着在webpack.base.conf.js中module.exports ...

- (Java实现) 数塔问题

数塔问题(使用动态规划思路求解) 如图所示,给定一个正整数构成的三角形,如下所示: 在下面的数字三角形中寻找一条从顶部到底边的路径, 使得路径上所经过的数字之和最大. 路径上的每一步都只能往左下或者右 ...

- Java 实现 蓝桥杯 历届试题 分糖果

问题描述 有n个小朋友围坐成一圈.老师给每个小朋友随机发偶数个糖果,然后进行下面的游戏: 每个小朋友都把自己的糖果分一半给左手边的孩子. 一轮分糖后,拥有奇数颗糖的孩子由老师补给1个糖果,从而变成偶数 ...

- Java实现第十届蓝桥杯组队

试题 A: 组队 本题总分:5 分 [问题描述] 作为篮球队教练,你需要从以下名单中选出 1 号位至 5 号位各一名球员, 组成球队的首发阵容. 每位球员担任 1 号位至 5 号位时的评分如下表所示. ...

- java实现第四届蓝桥杯带分数

带分数 题目描述 100 可以表示为带分数的形式:100 = 3 + 69258 / 714 还可以表示为:100 = 82 + 3546 / 197 注意特征:带分数中,数字1~9分别出现且只出现一 ...

- opencl(6)读写传输命令、内存映射命令

1:将缓存对象的内容读到缓存对象中(从设备到主机) cl_int clEnqueuReadBuffer( cl_command_queue command_queue, //命令队列 cl_mem b ...

- 手把手教你用JS/Vue/React实现幸运水果机(80后情怀之作)

项目体验地址 免费视频教程 分别使用原生JS,Vue和React,手把手教你开发一个H5小游戏,快速上手Vue和React框架的使用. 项目截图 在线体验 在线体验 游戏介绍 幸运水果机是一款街机游戏 ...

- MongoDB知识点总结

一:MongoDB 概述 一.NoSQL 简介 1. 概念:NoSQL(Not Only SQL的缩写),指的是非关系型数据库,是对不同于传统的关系型数据库的数据库管理系统的统称.用于超大规模数 ...

- 通过与C++程序对比,彻底搞清楚JAVA的对象拷贝

目录 一.背景 二.JAVA对象拷贝的实现 2.1 浅拷贝 2.2 深拷贝的实现方法一 2.3 深拷贝的实现方法二 2.3.1 C++拷贝构造函数 2.3.2 C++源码 2.3.3 JAVA通过拷贝 ...