Python爬取imdb电影数据并存储到mysql数据库

数据获取方式:微信搜索关注【靠谱杨阅读人生】回复【电影】。

整理不易,资源付费,谢谢支持。

Python爬虫代码:

1 import re

2 import time

3 import traceback

4

5 from bs4 import BeautifulSoup

6 from lxml import etree

7 import pymysql

8 import requests

9 #连接数据库 获取游标

10 def get_conn():

11 """

12 :return: 连接,游标

13 """

14 # 创建连接

15 conn = pymysql.connect(host="82.157.112.34",

16 user="root",

17 password="root",

18 db="MovieRankings",

19 charset="utf8")

20 # 创建游标

21 cursor = conn.cursor() # 执行完毕返回的结果集默认以元组显示

22 if ((conn != None) & (cursor != None)):

23 print("数据库连接成功!游标创建成功!")

24 else:

25 print("数据库连接失败!")

26 return conn, cursor

27 #关闭数据库连接和游标

28 def close_conn(conn, cursor):

29 if cursor:

30 cursor.close()

31 if conn:

32 conn.close()

33 return 1

34 def get_imdb():

35

36 # url='https://www.imdb.cn/feature-film/1-0-0-0/?page=1'

37 headers={

38 'user-agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/90.0.4430.93 Safari/537.36'

39 }

40 dataRes=[] #最终结果集

41 temp_list=[] #暂时结果集

42

43 # print(all_li)

44

45 for i in range(200,202):

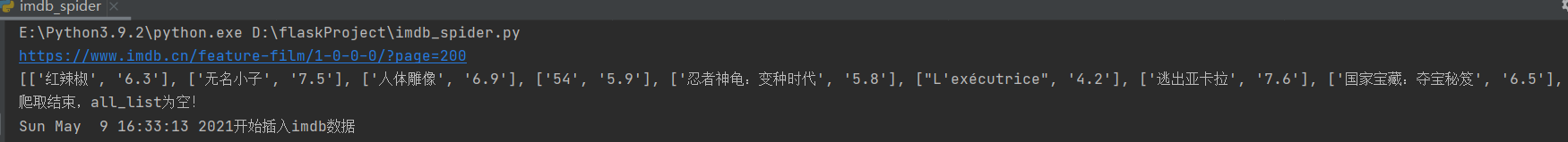

46 url_='https://www.imdb.cn/feature-film/1-0-0-0/?page='+str(i)

47 response = requests.get(url=url_, headers=headers)

48 # print(response)

49 response.encoding = 'utf-8'

50 page_text = response.text

51 # print(page_text)

52 etree_ = etree.HTML(page_text)

53 all_li = etree_.xpath('//div[@class="hot_box"]/ul/li') #获取所有li

54 #判断all_li是否为空

55 if(len(all_li)==0):

56 print("爬取结束,all_list为空!")

57 if(len(dataRes)!=0):

58 return dataRes;

59 else:

60 return ;

61 print(url_)

62 for li in all_li:

63 name=li.xpath('./a[1]/img/@alt')

64 if(len(name)==0):

65 name.append("电影名错误")

66 # print(name)

67 #存姓名

68 temp_list.append(name[0])

69

70 score=li.xpath('./span[@class="img_score"]/@title')

71 if(len(score)==0):

72 score.append("imdb暂无评分")

73 # print(score)

74 #存分数

75 temp_list.append(score[0])

76 # print(temp_list)

77 #存到dataRes 把temp_list置为空

78 dataRes.append(temp_list)

79 temp_list=[]

80 print(dataRes)

81 return dataRes

82 def insert_imdb():

83 """

84 插入imdb数据

85 :return:

86 """

87 cursor = None

88 conn = None

89 try:

90 list_=[]

91 list = get_imdb()

92 if(type(list)!=type(list_)):

93 return ;

94 print(f"{time.asctime()}开始插入imdb数据")

95 conn, cursor = get_conn()

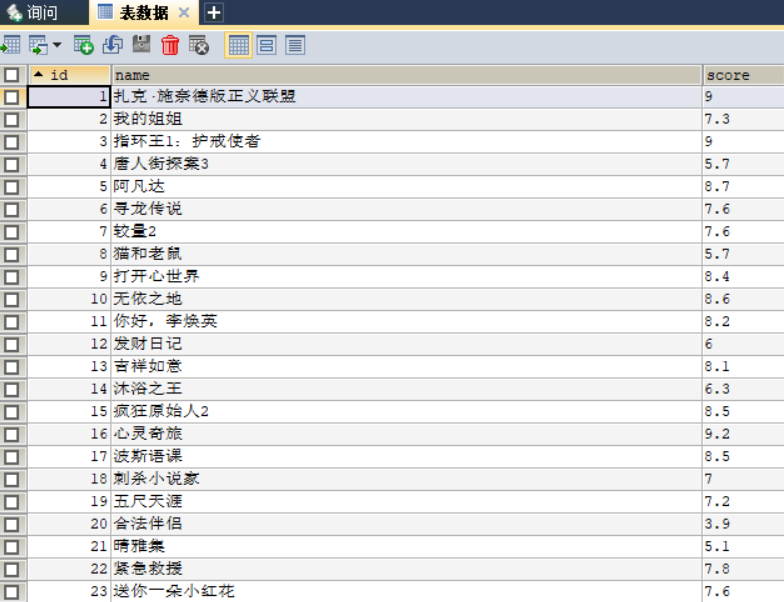

96 sql = "insert into movieimdb (id,name,score) values(%s,%s,%s)"

97 for item in list:

98 try:

99 print(item)

100 cursor.execute(sql, [0, item[0], item[1]])

101 except pymysql.err.IntegrityError:

102 print("重复!跳过!")

103 conn.commit() # 提交事务 update delete insert操作

104 print(f"{time.asctime()}插入imdb数据完毕")

105 finally:

106 close_conn(conn, cursor)

107 return;

108 # def get_dblen():

109 # conn,cursor=

110 # num_=

111

112 if __name__ == '__main__':

113 # get_imdb()

114 insert_imdb()

数据库

Python爬取imdb电影数据并存储到mysql数据库的更多相关文章

- Python爬取招聘信息,并且存储到MySQL数据库中

前面一篇文章主要讲述,如何通过Python爬取招聘信息,且爬取的日期为前一天的,同时将爬取的内容保存到数据库中:这篇文章主要讲述如何将python文件压缩成exe可执行文件,供后面的操作. 这系列文章 ...

- 爬取豆瓣电影top250并存储到mysql数据库

import requests from lxml import etree import re import pymysql import time conn= pymysql.connect(ho ...

- node 爬虫 --- 将爬取到的数据,保存到 mysql 数据库中

步骤一:安装必要模块 (1)cheerio模块 ,一个类似jQuery的选择器模块,分析HTML利器. (2)request模块,让http请求变的更加简单 (3)mysql模块,node连接mysq ...

- 利用Python爬取豆瓣电影

目标:使用Python爬取豆瓣电影并保存MongoDB数据库中 我们先来看一下通过浏览器的方式来筛选某些特定的电影: 我们把URL来复制出来分析分析: https://movie.douban.com ...

- Python爬取豆瓣电影top

Python爬取豆瓣电影top250 下面以四种方法去解析数据,前面三种以插件库来解析,第四种以正则表达式去解析. xpath pyquery beaufifulsoup re 爬取信息:名称 评分 ...

- 利用Python爬取朋友圈数据,爬到你开始怀疑人生

人生最难的事是自我认知,用Python爬取朋友圈数据,让我们重新审视自己,审视我们周围的圈子. 文:朱元禄(@数据分析-jacky) 哲学的两大问题:1.我是谁?2.我们从哪里来? 本文 jacky试 ...

- python 爬取豆瓣电影评论,并进行词云展示

python 爬取豆瓣电影评论,并进行词云展示 本文旨在提供爬取豆瓣电影<我不是药神>评论和词云展示的代码样例 1.分析URL 2.爬取前10页评论 3.进行词云展示 1.分析URL 我不 ...

- python 爬取猫眼电影top100数据

最近有爬虫相关的需求,所以上B站找了个视频(链接在文末)看了一下,做了一个小程序出来,大体上没有修改,只是在最后的存储上,由txt换成了excel. 简要需求:爬虫爬取 猫眼电影TOP100榜单 数据 ...

- python爬取豆瓣电影信息数据

题外话+ 大家好啊,最近自己在做一个属于自己的博客网站(准备辞职回家养老了,明年再战)在家里 琐事也很多, 加上自己 一回到家就懒了(主要是家里冷啊! 广东十几度,老家几度,躲在被窝瑟瑟发抖,) 由于 ...

- python爬虫-爬取豆瓣电影数据

#!/usr/bin/python# coding=utf-8# 作者 :Y0010026# 创建时间 :2018/12/16 16:27# 文件 :spider_05.py# IDE :PyChar ...

随机推荐

- .net core6 Log4记录日志

一.引言 .net core6在文件方面是精简了,所以配置方面也发生了部分变化:下面记录下.net core6中怎么配置Log4 进行日志记录. 二.项目创建 1).首先引用两个包:在Nuget中引入 ...

- 带你领略下iOS中OC的“alloc”源代码,让你在工作中不在迷惑

前言 前面我们使用官方开源的objc源码进行了编译调试 objc4-818.2源码编译调试笔记 前言为什么会想要调试源码? 苹果开源了部分源码, 但相似内容太多, 基本找不到代码见的对应关系, 如果能 ...

- 【Azure Redis 缓存】Azure Cache for Redis有默认备份可以用于恢复么?

问题描述 Azure Cache for Redis有默认备份可以用于恢复么? 答: 只有高级版Redis有. 问题原因 Azure Cache for Redis有不同的版本定价层(基本 Basic ...

- 【Azure 应用服务】App Service for Windows 环境中为Tomcat自定义4xx/5xx页面

问题描述 通过设置Java Web项目,实现在App Service For Windows环境中达到自定义4XX/5XX的页面效果 问题解答 第一步:在本地项目文件中打开web.xml文件 (src ...

- 【Azure API 管理】是否可以将Swagger 的API定义导入导Azure API Management中

问题描述 是否可以将Swagger 的API定义导入导Azure API Management中? 操作步骤 是的,可以通过APIM门户导入单个的API Swagger定义文件.具体步骤如下: 第一步 ...

- C++ //vector 容器构造 vector赋值操作 vector 容量大小 vector插入和删除 //vector数据存取 vector互换容器 vector预留空间

1 //vector 容器构造 vector赋值操作 vector 容量大小 vector插入和删除 2 //vector数据存取 vector互换容器 vector预留空间 3 #include&l ...

- 专访容智信息柴亚团:最低调的公司如何炼成最易用的RPA?

专访容智信息柴亚团:最低调的公司如何炼成最易用的RPA? 专访容智信息柴亚团:终极愿景是助力天下企业成为数字化孪生组织 文/王吉伟 6月,容智信息(容智)正式发布了全新的移动端RPA产品iBot Mo ...

- 一文搞懂如何自己写一个Python库

一文搞懂如何自己写一个Python库 你是否曾想过为自己的Python项目编写一个库,以便在不同项目中重复使用代码? 并且能在PyPI仓库中发布,并通过pip install 库名来安装使用 编写Py ...

- mybatis批量插入的四种方式

一.循环插入 public void insert(List<User> userList) { userList.forEach(user -> userDao.insert(us ...

- Template String Converter - 字符串中加变量 自动将单引号变换 - vscode插件

Template String Converter - 字符串中加变量 自动将单引号变换 - vscode插件