CS231n 2016 通关 第二章-KNN

2、KNN

2、KNN

首先是KNN中用到的距离计算公式,L1和L2如下:

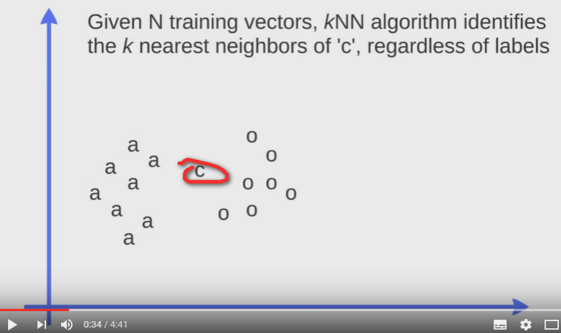

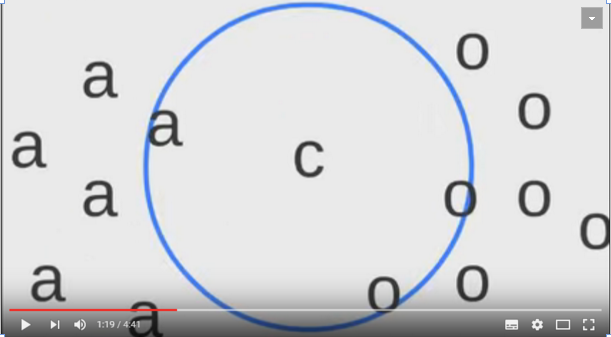

图示KNN的计算过程:

图中有种类 a o,当需要确定c属于哪个种类时,可以使用KNN

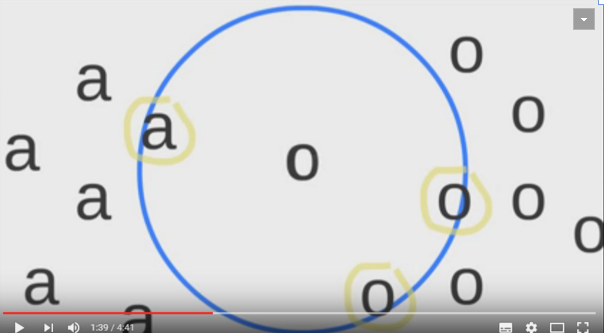

计算c到所有a和所有o的距离,L1或者L2均可。如图示取K为3,即取到3个较小值。

因为较小值中包含在o种类的数量多,所以确定c种类为o:

当K为1时,即为最近邻。同时KNN需要注意的点:

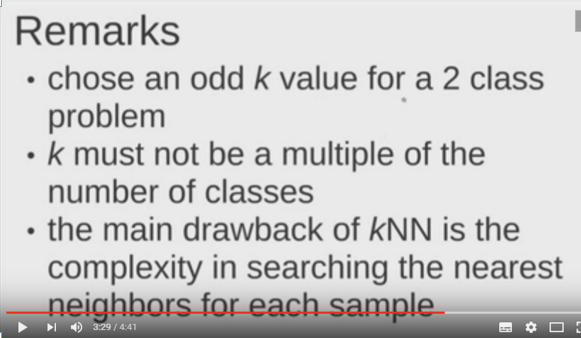

1.取K为奇数

2.K个较小值中尽量包含少的种类

3.在实际中需要权衡训练时间和测试时间,最近邻不需要训练时间,但是需要很多的测试时间。

可以使用KNN运算库:ANN 来进行计算。在数据可视化中会使用KNN.

reference:https://www.youtube.com/watch?v=UqYde-LULfs

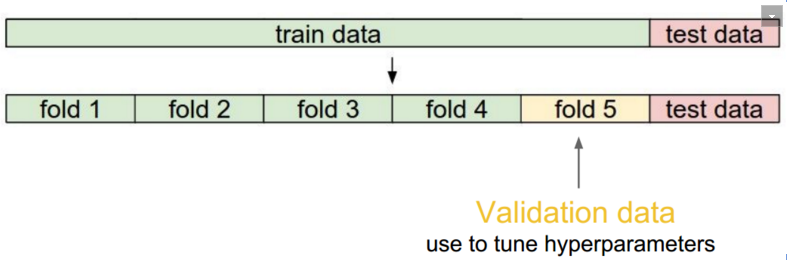

2.3 cross-validation 交叉验证

KNN中K的取值是不确定的,称之为hyperparameter,即超参数。通过cross-validation即交叉验证的方式来选取合适的K值。

选取validation集:将原始训练集拆分成多个数据集合,使用其中之一作为验证集。

验证过程:选取K后,对验证集进行计算,得到不同验证集上的准确率,对准确率取平均值,平均准确率较好的K值为合适的超参数。

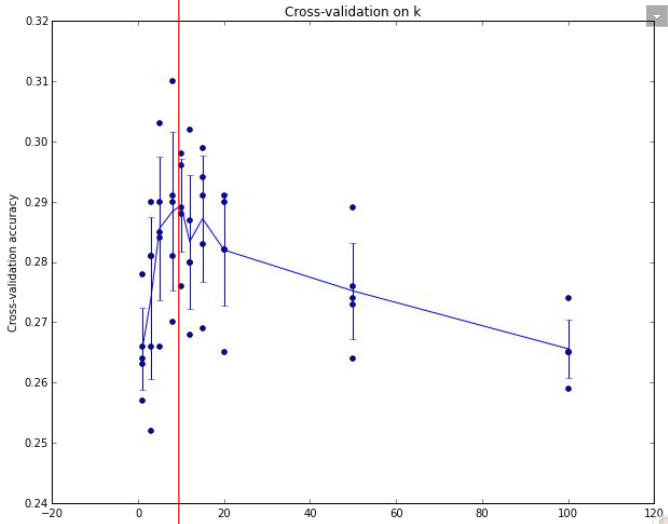

绘制准确率曲线,得到合适的超参数:此处选择K = 7

当然最重要的是课程的最后总结:

瞬间爆炸。。。

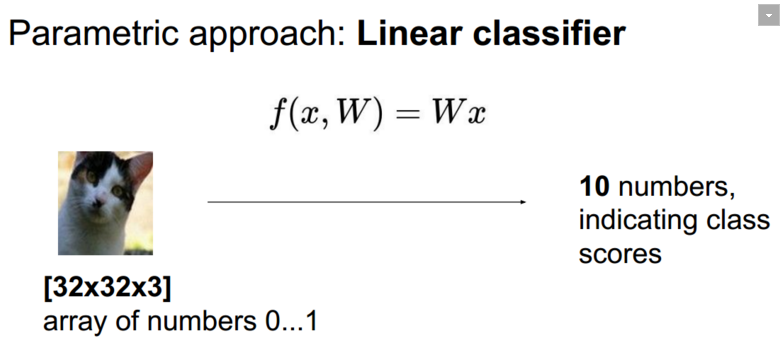

3、线性分类器

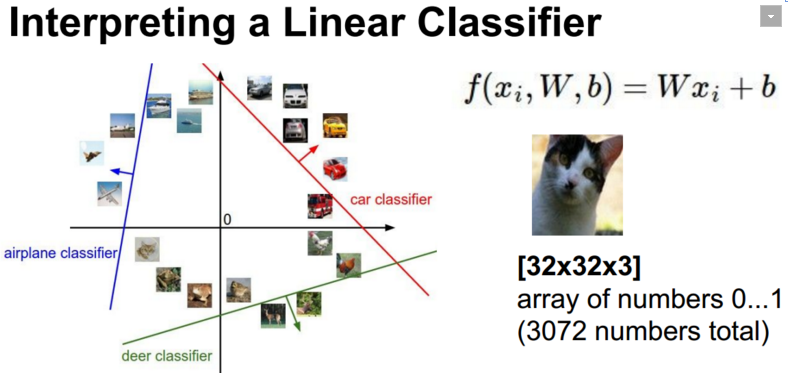

所谓线性分类器,是对输入数据进行线性的计算,最终得到预测label的概率值:

参数设置:注意此时加了bias也就是截距 b:

对线性分类器进行分类界面的可视化:

那么问题来了:解释加bias的原因?

如果没有bias,所有的分类界面均经过原点。可区分性降低。

bias在CNNs中也会使用。原因类似。

线性分类器总结:

图片来源:CS231n winter 课件。

附:通关CS231n企鹅群:578975100 validation:DL-CS231n

CS231n 2016 通关 第二章-KNN的更多相关文章

- CS231n 2016 通关 第二章-KNN 作业分析

KNN作业要求: 1.掌握KNN算法原理 2.实现具体K值的KNN算法 3.实现对K值的交叉验证 1.KNN原理见上一小节 2.实现KNN 过程分两步: 1.计算测试集与训练集的距离 2.通过比较la ...

- CS231n 2016 通关 第一章-内容介绍

第一节视频的主要内容: Fei-Fei Li 女神对Computer Vision的整体介绍.包括了发展历史中的重要事件,其中最为重要的是1959年测试猫视觉神经的实验. In 1959 Harvar ...

- CS231n 2016 通关 第六章 Training NN Part2

本章节讲解 参数更新 dropout ================================================================================= ...

- CS231n 2016 通关 第三章-SVM与Softmax

1===本节课对应视频内容的第三讲,对应PPT是Lecture3 2===本节课的收获 ===熟悉SVM及其多分类问题 ===熟悉softmax分类问题 ===了解优化思想 由上节课即KNN的分析步骤 ...

- CS231n 2016 通关 第五章 Training NN Part1

在上一次总结中,总结了NN的基本结构. 接下来的几次课,对一些具体细节进行讲解. 比如激活函数.参数初始化.参数更新等等. ====================================== ...

- CS231n 2016 通关 第四章-反向传播与神经网络(第一部分)

在上次的分享中,介绍了模型建立与使用梯度下降法优化参数.梯度校验,以及一些超参数的经验. 本节课的主要内容: 1==链式法则 2==深度学习框架中链式法则 3==全连接神经网络 =========== ...

- CS231n 2016 通关 第五、六章 Dropout 作业

Dropout的作用: cell 1 - cell 2 依旧 cell 3 Dropout层的前向传播 核心代码: train 时: if mode == 'train': ############ ...

- CS231n 2016 通关 第五、六章 Batch Normalization 作业

BN层在实际中应用广泛. 上一次总结了使得训练变得简单的方法,比如SGD+momentum RMSProp Adam,BN是另外的方法. cell 1 依旧是初始化设置 cell 2 读取cifar- ...

- CS231n 2016 通关 第五、六章 Fully-Connected Neural Nets 作业

要求:实现任意层数的NN. 每一层结构包含: 1.前向传播和反向传播函数:2.每一层计算的相关数值 cell 1 依旧是显示的初始设置 # As usual, a bit of setup impor ...

随机推荐

- Java日志框架-Spring中使用Logback(Spring/Spring MVC)

继上一篇文章http://www.cnblogs.com/EasonJim/p/7800880.html中所集成的是基于Java的普通项目,如果要在Spring和Spring MVC上集成,需要做如下 ...

- 配置maven从私服上下载构件

maven 本地setting.xml配置 <!--配置maven从私服上下载构件 --> <profiles> <profile> <repositorie ...

- Android:BLE智能硬件开发详解

目录 前言 BLE是个什么鬼 BLE中的角色分工 主要的关键词和概念 GATT(Generic Attribute Profile ) Characteristic Service Android如何 ...

- SqlServer 数据恢复

首先看看微软官方的给出的建议(摘自:http://technet.microsoft.com/zh-cn/library/ms189272.aspx): 在从完整恢复模式或大容量日志恢复模式切换前,请 ...

- [CSS3] Identify Interactive HTML Elements with CSS Link Pseudo Classes

The interactive pseudo-classes for links (and buttons) allow us to make sure the user knows what ele ...

- iOS文件的管理(添加,删除,拷贝,移动)

#import "ViewController.h" @implementation ViewController - (void)viewDidLoad { [super vie ...

- background-size使用参考指南

语法:background-size :[ <length> | <percentage> | auto ]{1,2} | cover | contain相关属性: backg ...

- atitit.窗口静听esc退出本窗口java swing c# .net php

atitit.窗口静听esc退出本窗口java swing c# .net php 1. 监听esc 按键 1 1.1. 监听一个组件 1 1.2. 监听加在form上 1 2. 关闭窗口 2 1. ...

- TestNG demo

下载TestNG的归档文件 下载最新版本的TestNG的jar文件,详细请点击访问 http://www.testng.org..在写这篇教程的时候,我下载TestNG中-6.8.jar,并将 tes ...

- python -- day 11 考试题

1. 文件t1.txt里面的内容为:(6分) 1,alex,22,13651054608,IT 2,wusir,23,13304320533,Tearcher 3,taibai,18,13332353 ...