045 RDD与DataFrame互相转换

一:RDD与DataFrame互相转换

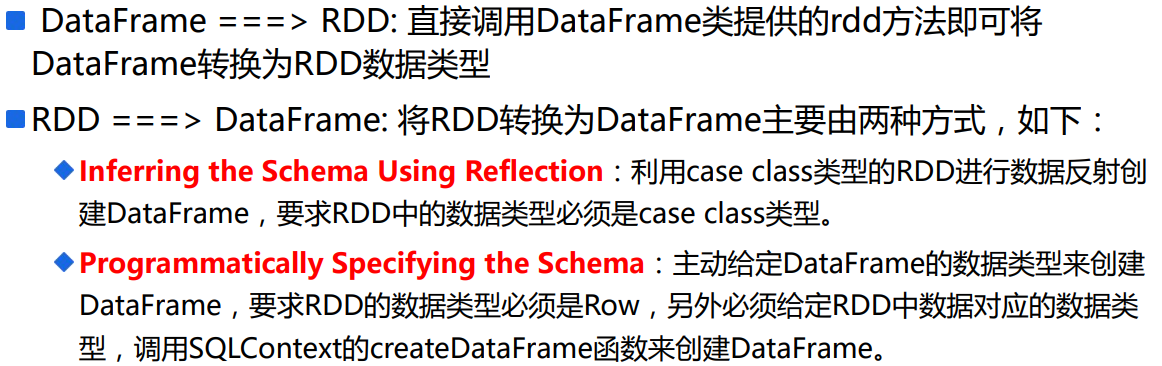

1.总纲

二:DataFrame转换为RDD

1.rdd

使用schema可以获取DataFrame的schema

使用rdd可以获取DataFrame的数据

三:RDD转换为DataFrame

1.第一种方式

使用反射,

RDD的数据类型必须是case class。

import sqlContext.implicits._ //如果不写,下面的转换不成功

//transform

val path="/spark/logs/input"

val rdd=sc.textFile(path)

val apacheAccessDataFrame=rdd

.filter(line=>ApacheAccessLog.isValidateLogLine(line))

.map(line => {

ApacheAccessLog.parseLogLine(line)

}).toDF() //rdd转换为DataFrame

其中,ApacheAccessLog.parseLogLine(line)是case class类型。

2:第二种方式

package com.scala.it

import org.apache.spark.rdd.RDD

import org.apache.spark.sql.types._

import org.apache.spark.sql.{Row, SQLContext}

import org.apache.spark.{SparkConf, SparkContext}

object CreateDataFrameDemo {

def main(args: Array[String]): Unit = {

val conf = new SparkConf()

.setMaster("local[*]")

.setAppName("hive-join-mysql")

// 使用kryo序列化机制

conf.registerKryoClasses(Array(classOf[Row], classOf[Tuple3[Int, String, Double]]))

val sc = SparkContext.getOrCreate(conf) val sqlContext = new SQLContext(sc) // ===================================

// RDD中Row中的各个列的类型必须是一致的(不能有歧义)

val rdd: RDD[Row] = sc.parallelize(Array(

(1, "Tom", 1234.1),

(2, "Lili", 12532.2),

(3, "Gerry", 123.0)

)).map {

case (id, name, salary) => {

Row(id, name, salary)

}

}

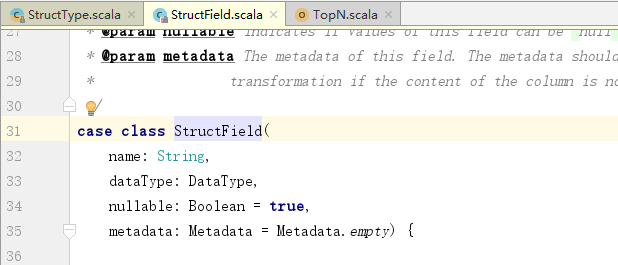

val schema: StructType = StructType(Array(

StructField("id", IntegerType),

StructField("name", StringType),

StructField("salary", DoubleType)

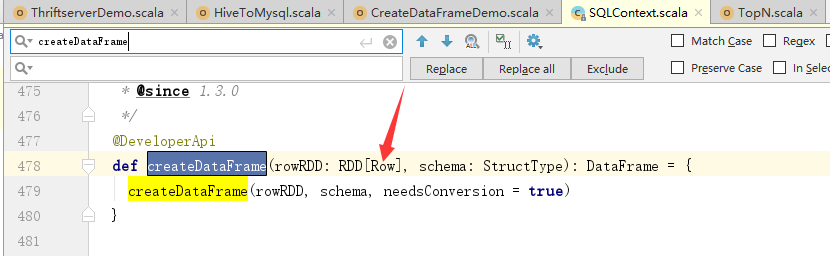

)) val df = sqlContext.createDataFrame(rdd, schema)

df.show()

}

}

3.解释上面的程序

产生RDD有两种方式,读取数据源,或者序列化

这里使用序列化产生RDD。

-----------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

关于rdd中为什么要使用Row:

------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

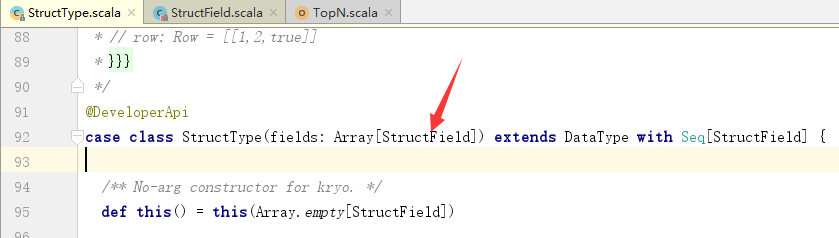

关于StructType:

-------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

关于StructField:

其中,后两个是默认参数,可以不给。

045 RDD与DataFrame互相转换的更多相关文章

- RDD与DataFrame的转换

RDD与DataFrame转换1. 通过反射的方式来推断RDD元素中的元数据.因为RDD本身一条数据本身是没有元数据的,例如Person,而Person有name,id等,而record是不知道这些的 ...

- 转】RDD与DataFrame的转换

原博文出自于: http://www.cnblogs.com/namhwik/p/5967910.html RDD与DataFrame转换1. 通过反射的方式来推断RDD元素中的元数据.因为RDD本身 ...

- RDD&Dataset&DataFrame

Dataset创建 object DatasetCreation { def main(args: Array[String]): Unit = { val spark = SparkSession ...

- 36、将RDD转换为DataFrame

一.概述 为什么要将RDD转换为DataFrame? 因为这样的话,我们就可以直接针对HDFS等任何可以构建为RDD的数据,使用Spark SQL进行SQL查询了.这个功能是无比强大的. 想象一下,针 ...

- spark-DataFrame之RDD和DataFrame之间的转换

package cn.spark.study.core.mycode_dataFrame; import java.io.Serializable;import java.util.List; imp ...

- RDD、DataFrame、Dataset三者三者之间转换

转化: RDD.DataFrame.Dataset三者有许多共性,有各自适用的场景常常需要在三者之间转换 DataFrame/Dataset转RDD: 这个转换很简单 val rdd1=testDF. ...

- RDD、DataFrame和DataSet的区别

原文链接:http://www.jianshu.com/p/c0181667daa0 RDD.DataFrame和DataSet是容易产生混淆的概念,必须对其相互之间对比,才可以知道其中异同. RDD ...

- 谈谈RDD、DataFrame、Dataset的区别和各自的优势

在spark中,RDD.DataFrame.Dataset是最常用的数据类型,本博文给出笔者在使用的过程中体会到的区别和各自的优势 共性: 1.RDD.DataFrame.Dataset全都是spar ...

- spark RDD,DataFrame,DataSet 介绍

弹性分布式数据集(Resilient Distributed Dataset,RDD) RDD是Spark一开始就提供的主要API,从根本上来说,一个RDD就是你的数据的一个不可变的分布式元素集合,在 ...

随机推荐

- 将list集合转json

public static class DataHelper { /// /// js 序列化器 /// static JavaScriptSerializer jss = new JavaScrip ...

- Python-数据类型 主键auto_increment

MySQL数据操作: DML========================================================在MySQL管理软件中,可以通过SQL语句中的DML语言来实 ...

- python基础--管理目录与文件

1) 文件夹 os.listdir() #显示文件夹下所有文件 os.getcwd() #获取当前工作目录 os.chdir() #切换目录 os.mkdir() #建立目录 os.path.exis ...

- 【进阶1-2期】JavaScript深入之执行上下文栈和变量对象(转)

这是我在公众号(高级前端进阶)看到的文章,现在做笔记 https://mp.weixin.qq.com/s/hZIpnkKqdQgQnK1BcrH6Nw 阅读笔记 JS是单线程的语言,执行顺序肯定是顺 ...

- 细说Django的中间件

分析Django的生命周期,我们知道所有的http请求都要经过Django的中间件. 假如现在有一个需求,所有到达服务端的url请求都在系统中记录一条日志,该怎么做呢? Django的中间件的简介 D ...

- Confluence 6 使用 Apache 和 mod_proxy 添加 SSL和其他

添加 SSL 如果你计划在你的应用中启用 SSL ,请参考 Securing your Atlassian applications with Apache using SSL页面中的内容,并确定你在 ...

- Confluence 6 找到你的支持识别代码(SEN)

你可以在下面 3 个地方找到你的 SEN 代码: 在 Confluence 中,进入 > 基本配置(General Configuration) > 许可证详细(License Deta ...

- Swift 新增fileprivate 详解

以前项目中只要用了private 那么在同一个文件同一个类中还是能访问的(比如一个类中写了一个extension) swift3.0现在不行了 新增了一个fileprivate 的访问控制 以前的p ...

- nginx(一)之默认配置文件

首先是nginx.conf vim /etc/nginx/nginx.conf user nginx; // 设置nginx服务的系统使用用户 worker_processes 1; // 工作进程数 ...

- Java的家庭记账本程序(E)

日期:2019.2.9 博客期:032 星期二 今天是把程序的相关Bug补一补,嗯`: 1.添加了跳转说明 生成了一个对于成员的权限声明内容,用户再登陆界面点击Go按钮后,切换至说明页面,再次点击Go ...