elasticsearch ik中文分词器安装

特殊说明:灰色文字用来辅助理解的。

安装IK中文分词器

我在百度上搜索了下,大多介绍的都是用maven打包下载下来的源码,这种方法也行,但是不够方便,为什么这么说?

首先需要安装maven吧?其次需要下载源码吧?最后需要打包吧?

我直接下载打包好的多方便?

1、下载打包好的压缩包

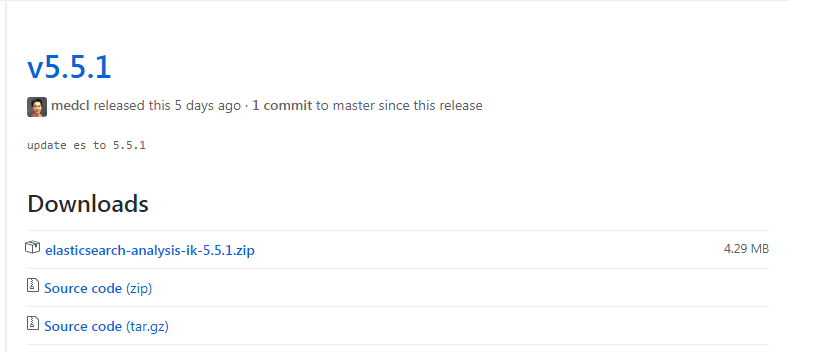

我们需要下载打包好的压缩包,而不是下载需要再用maven打包的源码。举例说明,最新版本是v5.5.1。

下载地址:https://github.com/medcl/elasticsearch-analysis-ik/releases

最上面elasticsearch-analysis-ik-5.5.1.zip就是打包好的,直接下载下来用就行了。

另外需要注意ik的版本需要和你的elasticsearch保持一致。我的是5.2.2的。

上图中下面两个都是源码,如果下载的是源码,仅使用maven打包过程就花了15分钟,时间就是金钱啊。

打包完后,会有提示,告诉你打包在了哪个位置:

[INFO] Building zip: /usr/local/elasticsearch/plugins/ik/target/releases/elasticsearch-analysis-ik-5.2.2.zip

[INFO] ------------------------------------------------------------------------

[INFO] BUILD SUCCESS

[INFO] ------------------------------------------------------------------------

[INFO] Total time: 14:41 min

[INFO] Finished at: 2017-08-06T00:00:35+08:00

[INFO] Final Memory: 29M/91M

[INFO] ------------------------------------------------------------------------

我们可以把打包好的文件保存下来,以后别的机器要用,直接拷贝过去就可以了

2、将下载下来的压缩包,拷贝到centos,并解压在elasticsearch的plugins插件目录下即可

压缩包我是放在/soft目录下的,elasticsearch的安装目录是/usr/local/elasticsearch

[root@localhost soft]# unzip -d /usr/local/elasticsearch/plugins/ik /soft/elasticsearch-analysis-ik-5.2.2.zip

3、重启elasticsearch

在日志里你应该可以看到加载分词字典的日志信息,表示安装成功。

elasticsearch ik中文分词器安装的更多相关文章

- elasticsearch ik中文分词器的安装配置使用

安装步骤 https://github.com/medcl/elasticsearch-analysis-ik 以插件形式安装: [elsearch@localhost elasticsearch- ...

- elasticsearch ik中文分词器的使用详解

(基于es5.4)先喵几眼github,按照步骤安装好分词器 link:https://github.com/medcl/elasticsearch-analysis-ik 复习一下常用的操作 .查看 ...

- 搜索引擎ElasticSearch系列(五): ElasticSearch2.4.4 IK中文分词器插件安装

一:IK分词器简介 IK Analyzer是一个开源的,基于java语言开发的轻量级的中文分词工具包.从2006年12月推出1.0版开始, IKAnalyzer已经推出了4个大版本.最初,它是以开源 ...

- Kafka:ZK+Kafka+Spark Streaming集群环境搭建(十九)ES6.2.2 安装Ik中文分词器

注: elasticsearch 版本6.2.2 1)集群模式,则每个节点都需要安装ik分词,安装插件完毕后需要重启服务,创建mapping前如果有机器未安装分词,则可能该索引可能为RED,需要删除后 ...

- 沉淀再出发:ElasticSearch的中文分词器ik

沉淀再出发:ElasticSearch的中文分词器ik 一.前言 为什么要在elasticsearch中要使用ik这样的中文分词呢,那是因为es提供的分词是英文分词,对于中文的分词就做的非常不好了 ...

- 30.IK中文分词器的安装和简单使用

在之前我们学的都是英文,用的也是英文的standard分词器.从这一节开始,学习中文分词器.中国人基本上都是中文应用,很少是英文的,而standard分词器是没有办法对中文进行合理分词的,只是将每个中 ...

- ElasticSearch的中文分词器ik

一.前言 为什么要在elasticsearch中要使用ik这样的中文分词呢,那是因为es提供的分词是英文分词,对于中文的分词就做的非常不好了,因此我们需要一个中文分词器来用于搜索和使用. 二.IK ...

- elasticsearch使用ik中文分词器

elasticsearch使用ik中文分词器 一.背景 二.安装 ik 分词器 1.从 github 上找到和本次 es 版本匹配上的 分词器 2.使用 es 自带的插件管理 elasticsearc ...

- Elasticsearch:IK中文分词器

Elasticsearch内置的分词器对中文不友好,只会一个字一个字的分,无法形成词语,比如: POST /_analyze { "text": "我爱北京天安门&quo ...

随机推荐

- python 之sqlite3库学习

# -*- coding:utf-8 -*- # 导入SQLite驱动:>>> import sqlite3# 连接到SQLite数据库# 数据库文件是test.db# 如果文件不存 ...

- 按需引入antd报错问题

1.使用create-react-app工具创建了一个项目 create-react-app antd-demo 2.安装babel-plugin-import npm install babel-p ...

- VirtualBox上安装CentOS-7(Minimal)

Windows 10家庭中文版,VirtualBox 5.2.12,CentOS 7(Minimal版), 因为听到大家在谈论CentOS,阿里云上也有CentOS,CentOS还是Red Hat出品 ...

- 前端打包工具之fis3的初级使用

说到打包工具,大家都会想到webpack,我之前也接触过webpack,说实话个人觉得webpack上手容易,但是对于新手来说里面有太多坑,配置文件也不简单.于是乎,我转入了fis3阵营,发现fis3 ...

- opencv之dft及mat类型转换

跑实验时用到dft这个函数,根据教程,需要先将其扩充到最优尺寸,但我用逆变换后发现得到的mat的维数竟然不一样.因此还是不要扩展尺寸了. 参考:http://www.xpc-yx.com/2014/1 ...

- 数据库中INFORMATION_SCHEMA的说明及使用

第一个查询看看库里有多少个表,表名等select * from INFORMATION_SCHEMA.TABLES information_schema这张数据表保存了MySQL服务器所有数据库的信息 ...

- GUC-13 生产者和消费者案例-旧

/* * 生产者和消费者案例 */ public class TestProductorAndConsumer { public static void main(String[] args) { C ...

- Asp.net Vnext 中间件实现基本验证

概述 本文已经同步到<Asp.net Vnext 系列教程 >中] vnext 没有 web.config 可以配置基本验证,本文使用中间件实现基本验证 实现 通过Startup(启动类) ...

- CF293B. Distinct Paths

B. Distinct Paths time limit per test 2 seconds memory limit per test 256 megabytes input standard i ...

- 【51nod】1149 Pi的递推式

题解 我们把这个函数的递归形式画成一张图,会发现答案是到每个出度为0的点的路径的方案数 这个可以用组合数算 记录一下P[i]为i减几次PI减到4以内 如果P[i + 1] > P[i],那么转向 ...