scrapy之Crawspider 腾讯招聘实战案例

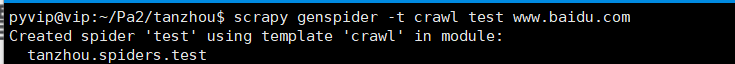

1. 在虚拟机中cd到项目目录,再运行下面代码创建spider文件:

scrapy genspider -t crawl test www.baidu.com

2. spider.py代码

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders import CrawlSpider, Rule

from tanzhou.items import TanzhouItem,DetailItem class TencentSpider(CrawlSpider):

name = 'tencent'

allowed_domains = ['hr.tencent.com']

start_urls = ['https://hr.tencent.com/position.php?lid=2268&tid=87&keywords=python'] rules = (

Rule(LinkExtractor(allow=r'start=\d+'), callback='parse_item',follow=True),

Rule(LinkExtractor(allow=r'position_detail\.php\?id=\d+'), callback='parse_detail_item', follow=False), ) def parse_item(self, response):

# 解析职位信息

tr = response.xpath(

'//table[@class="tablelist"]/tr[@class = "even"]|//table[@class="tablelist"]/tr[@class = "odd"]')

if tr:

for i in tr:

# 第二种方式,用items.py约束

item = TanzhouItem()

item["jobName"] = i.xpath('./td[1]/a/text()').extract_first()

item["jobType"] = i.xpath('./td[2]/text()').extract_first()

item["Num"] = i.xpath('./td[3]/text()').extract_first()

item["Place"] = i.xpath('./td[4]/text()').extract_first()

item["Time"] = i.xpath('./td[5]/text()').extract_first() yield item

def parse_detail_item(self,response):

item = DetailItem()

item['detail_content'] = response.xpath("//ul[@class = 'squareli']/li/text()").extract()

item['detail_content'] = '\n'.join(item['detail_content'])

yield item

3. items代码:

import scrapy class TanzhouItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

jobName = scrapy.Field()

jobType = scrapy.Field()

Num = scrapy.Field()

Place = scrapy.Field()

Time = scrapy.Field()

class DetailItem(scrapy.Item):

detail_content = scrapy.Field()

4. pipelines代码:

import json

from tanzhou.items import TanzhouItem,DetailItem class TanzhouPipeline(object):

def process_item(self, item, spider):

# 数据json化 ,如果是用items 则需要先转化成字典格式dict()再用json

# item = json.dumps(item,ensure_ascii=False)

if isinstance(item,TanzhouItem):

item = json.dumps(dict(item),ensure_ascii=False)

self.f.write(item)

self.f.write('\n')

if isinstance(item,DetailItem):

item = json.dumps(dict(item), ensure_ascii=False)

self.f2.write(item)

self.f2.write('\n') return item

# 爬虫开启时运行

def open_spider(self,spider):

# 打开文件

self.f = open('info2.json','w')

self.f2 = open('detail2.json', 'w')

# 爬虫关闭时运行

def close_spider(self,spider):

# 关闭文件

self.f.close()

self.f2.close()

scrapy之Crawspider 腾讯招聘实战案例的更多相关文章

- Scrapy 项目:腾讯招聘

目的: 通过爬取腾讯招聘网站(https://careers.tencent.com/search.html)练习Scrapy框架的使用 步骤: 1.通过抓包确认要抓取的内容是否在当前url地址中,测 ...

- python3 scrapy 爬取腾讯招聘

安装scrapy不再赘述, 在控制台中输入scrapy startproject tencent 创建爬虫项目名字为 tencent 接着cd tencent 用pycharm打开tencent项目 ...

- 简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息

简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息 简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息 系统环境:Fedora22(昨天已安装scrapy环境) 爬取的开始URL:ht ...

- Scrapy实现腾讯招聘网信息爬取【Python】

一.腾讯招聘网 二.代码实现 1.spider爬虫 # -*- coding: utf-8 -*- import scrapy from Tencent.items import TencentIte ...

- pymongodb的使用和一个腾讯招聘爬取的案例

一.在python3中操作mongodb 1.连接条件 安装好pymongo库 启动mongodb的服务端(如果是前台启动后就不关闭窗口,窗口关闭后服务端也会跟着关闭) 3.使用 import pym ...

- Scrapy项目 - 实现腾讯网站社会招聘信息爬取的爬虫设计

通过使Scrapy框架,进行数据挖掘和对web站点页面提取结构化数据,掌握如何使用Twisted异步网络框架来处理网络通讯的问题,可以加快我们的下载速度,也可深入接触各种中间件接口,灵活的完成各种需求 ...

- Python爬虫框架Scrapy获得定向打击批量招聘信息

爬虫,就是一个在网上到处或定向抓取数据的程序,当然,这样的说法不够专业,更专业的描写叙述就是.抓取特定站点网页的HTML数据.只是因为一个站点的网页非常多,而我们又不可能事先知道全部网页的URL地址, ...

- 【Vue.js实战案例】- Vue.js递归组件实现组织架构树和选人功能

大家好!先上图看看本次案例的整体效果. 浪奔,浪流,万里涛涛江水永不休.如果在jq时代来实这个功能简直有些噩梦了,但是自从前端思想发展到现在的以MVVM为主流的大背景下,来实现一个这样繁杂的功能简直不 ...

- 3.awk数组详解及企业实战案例

awk数组详解及企业实战案例 3.打印数组: [root@nfs-server test]# awk 'BEGIN{array[1]="zhurui";array[2]=" ...

随机推荐

- npm dev run 报错

解决办法: npm run dev --port 8088 Error: listen EACCES 0.0.0.0:8080at Object.exports._errnoException (ut ...

- CLOB数据类型截取SUBSTR_按开始位置偏移量

--DBMS_LOB.substr不加参数表示全部截取,负向截取待定 CREATE OR REPLACE FUNCTION CLOB_SUBSTR( V_CLOB CLOB, N_OFFSET NUM ...

- Hbase理论&&hbase shell&&python操作hbase&&python通过mapreduce操作hbase

一.Hbase搭建: 二.理论知识介绍: 1Hbase介绍: Hbase是分布式.面向列的开源数据库(其实准确的说是面向列族).HDFS为Hbase提供可靠的底层数据存储服务,MapReduce为Hb ...

- STM32L476应用开发之五:数据保存与SD卡操作

便携式气体分析仪的特点就是离线运行.尽管是离线运行,但测试数据还是需要的,所以采取方式保存数据就是必须的.在本次项目中我们计划采用SD卡来保存数据. 1.硬件设计 该读卡器整合 SD 卡规范和 FAT ...

- XmlDocument.Load(url) url是https远程时,报错" 基础连接已经关闭: 未能为 SSL/TLS 安全通道建立信任关系。" "根据验证过程,远程证书无效。"

XmlDocument.Load(url) url是https远程时,报错" 基础连接已经关闭: 未能为 SSL/TLS 安全通道建立信任关系." "根据验证过程, ...

- VUE开发请求本地数据的配置,旧版本dev-server.js,新版本webpack.dev.conf.js

VUE开发请求本地数据的配置,早期的vue-lic下面有dev-server.js和dev-client.js两文件,请求本地数据在dev-server.js里配置,最新的vue-webpack-te ...

- ionic3 点击输入 框弹出白色遮罩 并把 界面顶到上面

这个蛋疼 问题 ,在android 上面遇到这种情况 ,键盘弹出的时候 总有一个白色的遮罩在后面出现,网上查了很久都没发现原因. 偶然发现一个方法 ,试下了下 问题解决了. 代码如下: IonicMo ...

- Maven设置本地仓库路径

在maven文件下的settings.xml中添加<localRepository>F:\cppdy\repo</localRepository>(本地仓库路径)

- 爬虫框架之Scrapy

一.介绍 二.安装 三.命令行工具 四.项目结构以及爬虫应用简介 五.Spiders 六.Selectors 七.Items 八.Item Pipelin 九. Dowloader Middeware ...

- 编辑方法分享之如何编辑PDF文件内容

我们现在在工作中会经常使用到PDF文件,还会有遇到需要编辑PDF文件的时候,PDF文件的编辑问题一直是个大难题.很多朋友在面对PDF文件的时候束手无策,不知道该怎么对它进行编辑.下面小编就教给大家一个 ...