038 关于HIVE的配置

一:常用版本

1.版本

0.13.1 2014年

1.2.1 2015年

版本之间的区别:支持SQL不同,向关系型数据库靠拢。

目前看到的版本是2.3.2了。

2.官网

二:安装配置hive

1.检测hadoop

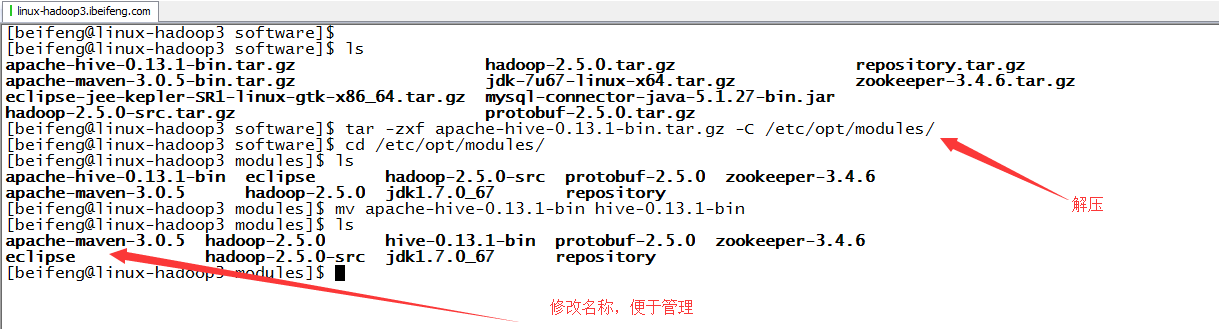

2.解压hive

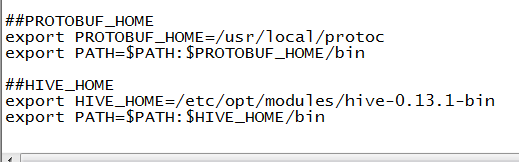

3.修改环境

sudo vi /etc/profile

4.source以下

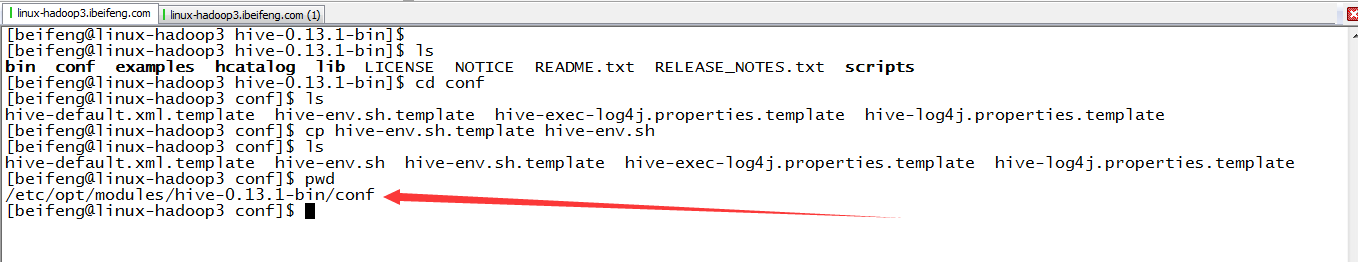

5.复制hive-env.sh

6.编辑hive-env.sh

设置hadoop的配置环境,因为hive需要hadoop,不然hive和hadoop没有关联。

hive的配置文件目录要启动的,因为除了默认的hive加载,自定义的hive文件在conf下,也需要加载。

7.在HDFS上创建文件夹并修改写权限

同组可写权限。

保存hive的数据,主要放在HDFS上的warehouse文件夹下。

说明:

为啥是这个目录。因为hive.metastore.warehouse.dir在默认文件中的位置是这个位置,所以就设置了这个目录。

8.验证hive的安装

属于启动。

进入hive的命令行。

二:操作hive

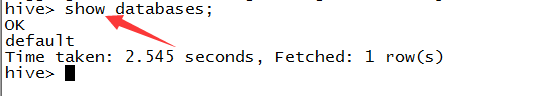

1.显示有哪些数据库

有一个default数据库。

说明:

假设在这个数据库下创建一个表,这个表就在user/hive/warehouse文件夹下。

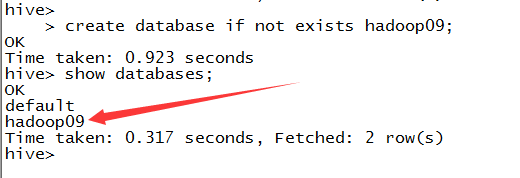

2.创建数据库

3.在新建的数据库中新建表

使用新建的数据库

use hadoop09;

这个使用的字符串是string,不是varchar,因为底层是hadoop。

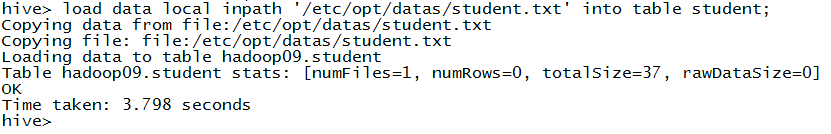

4.加载数据

首先要书写数据:

加载数据:

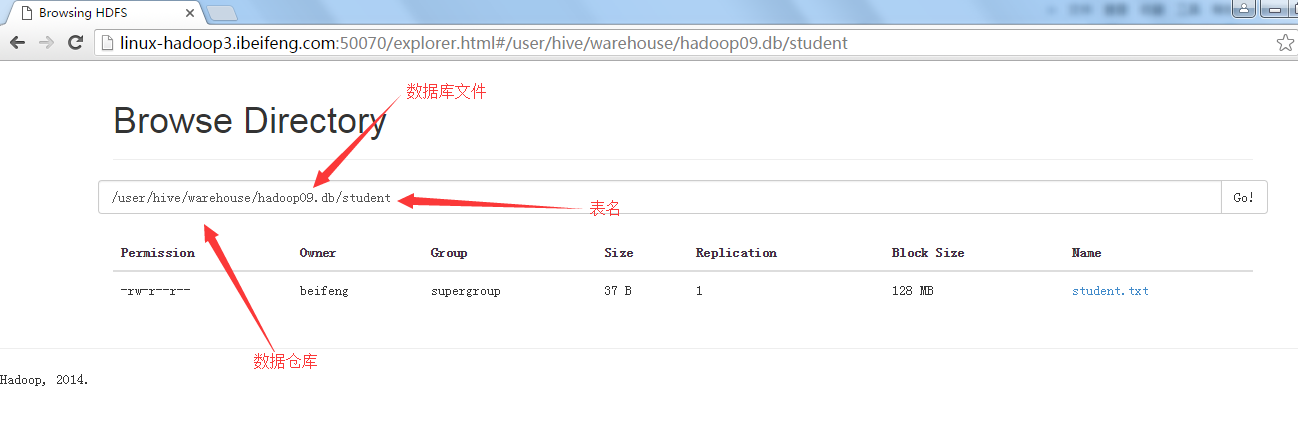

5.HDFS里文件的分布

一开始是数据仓库文件。

hadoop09是数据库,所以生成的文件名字教hadoop09.db。

student是一张表。

里面有一个文件,是数据文件,这个文件也是刚才在本地编辑的文件。

维护都是使用文件夹。

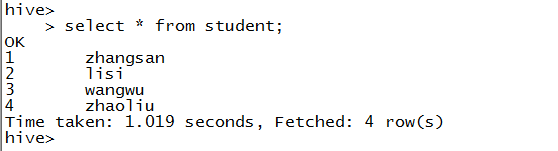

6.hive查询语句

三:hive的问题

1.问题的由来

当开启第二个hive的时候,就会出现问题。

因为hive的默认数据库使用的是derby,只能启用一个实例,所以不适合企业。

解决的方案是:使用mysql关系数据库代替derby。

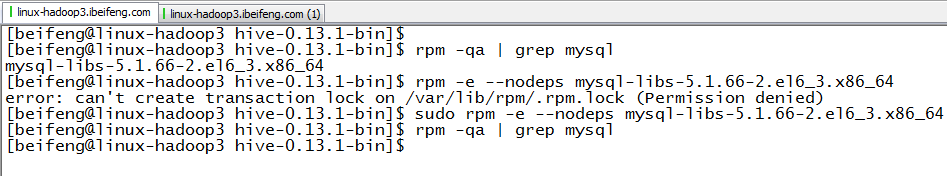

四:配置mysql

1.卸载已经安装的mysql

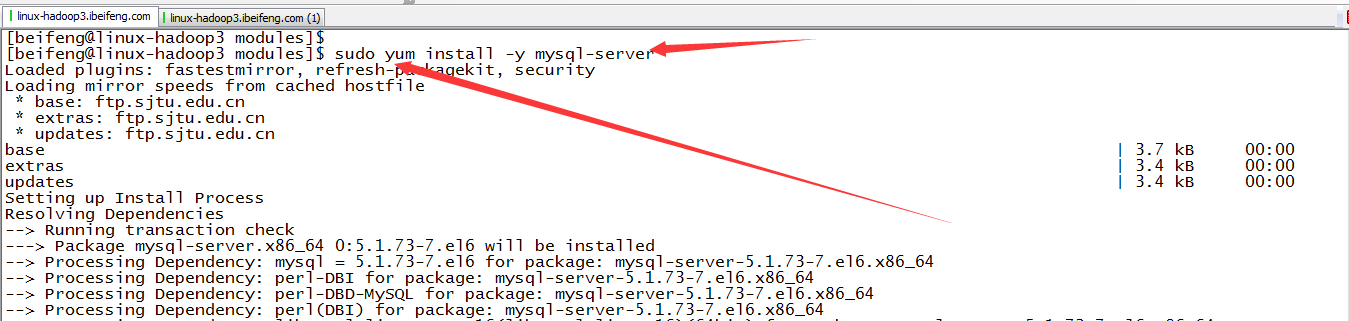

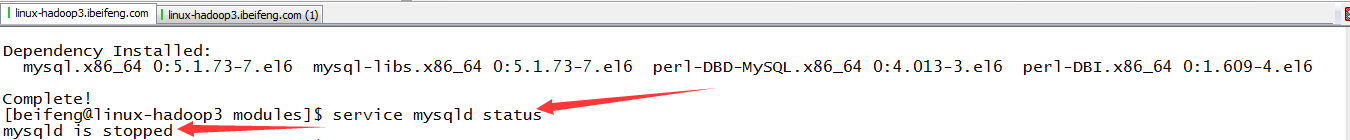

2.安装mysql

3.查看mysql的状态

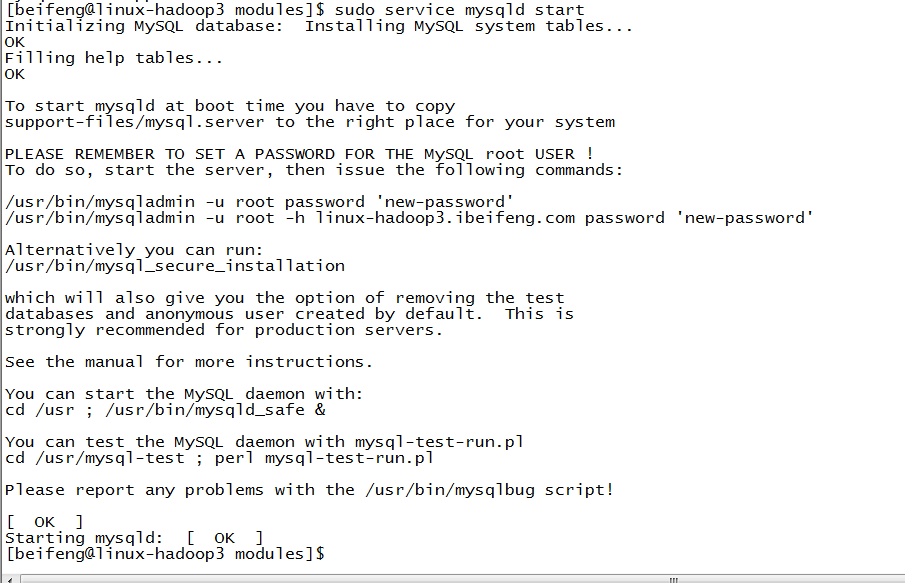

4.开启服务

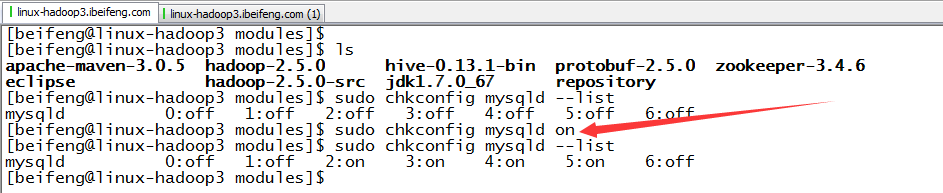

5.设置开机启动

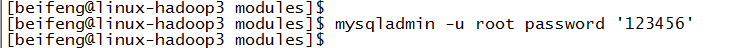

6.设置密码

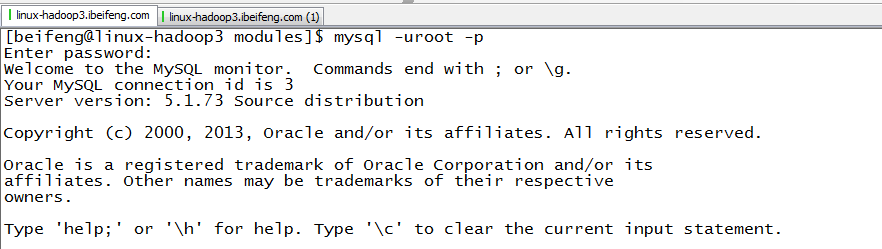

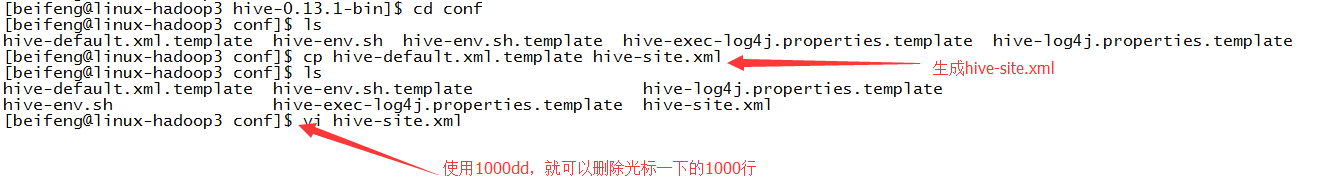

7.进入数据库

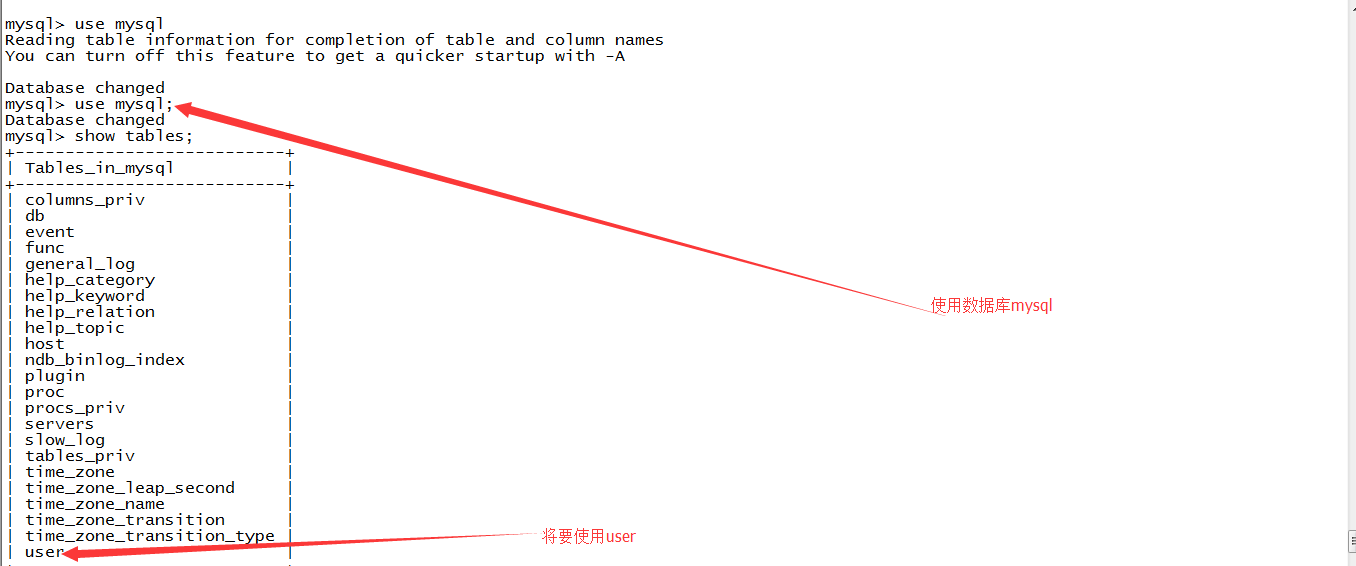

8.修改连接权限的位置

9.修改连接权限

增加一个权限

删除其他的

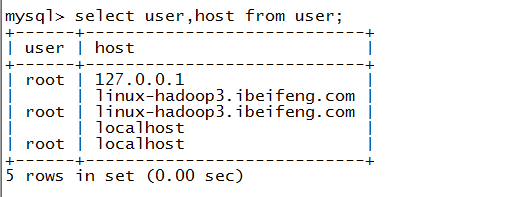

10.刷新权限,退出,重启服务

以上的mysql已经配置完成

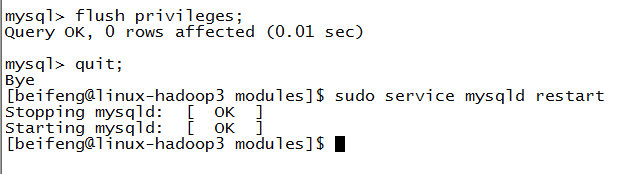

五.配置hive

1.生成hive-site.xml

2.配置hive-site.xml、

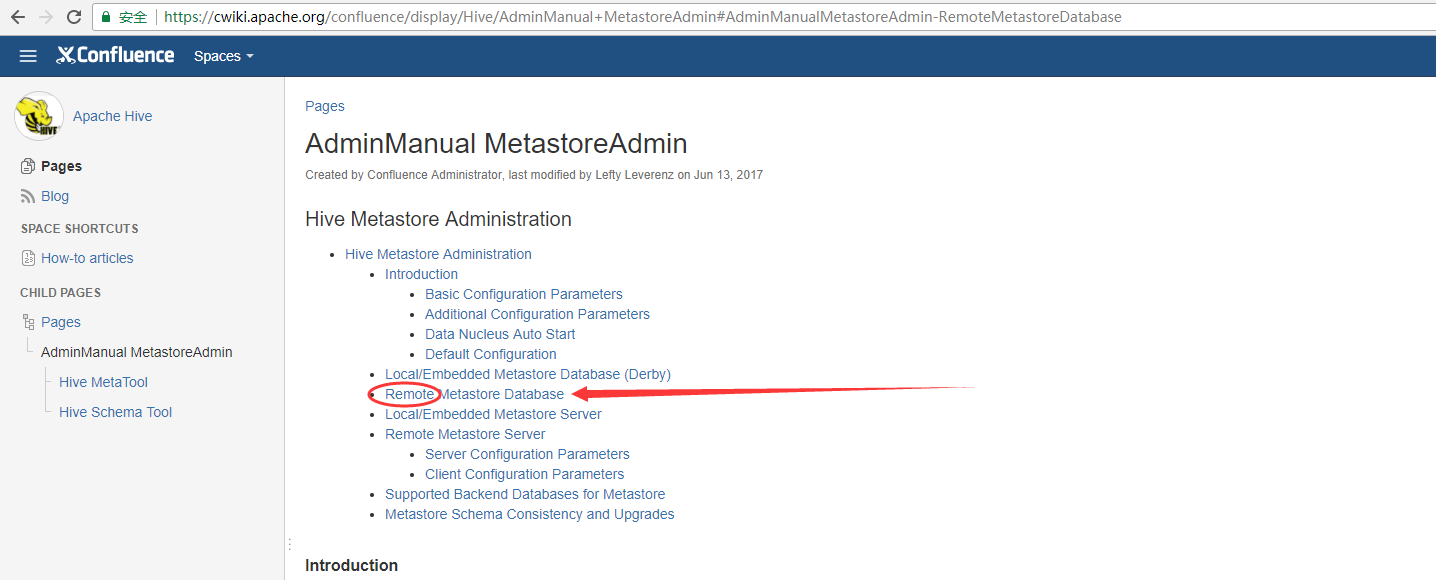

官网位置:

修改的配置:

3.在lib下加入驱动

4.启动hive

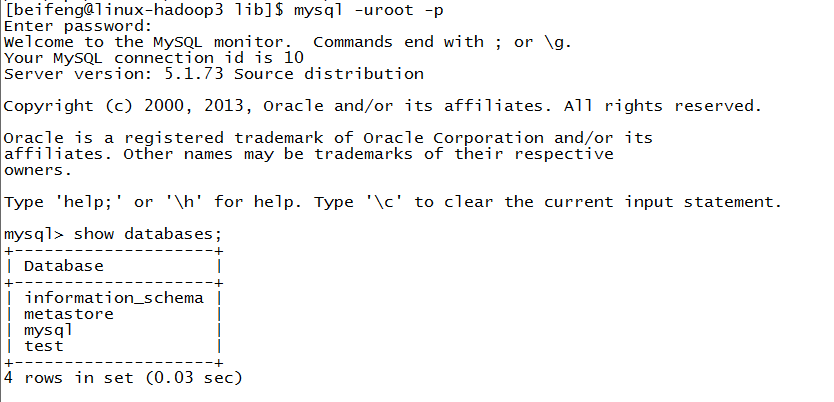

5.观看效果

出现了metastore数据库。

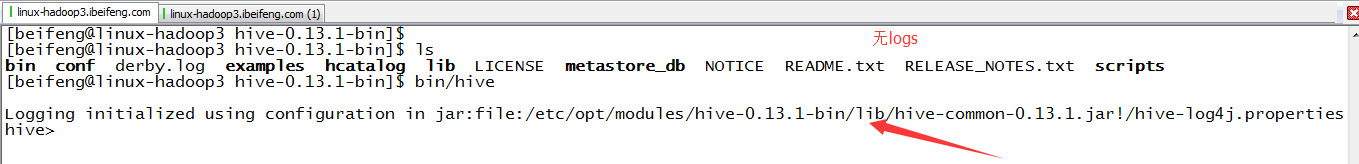

六:日志的配置问题

1.问题的由来

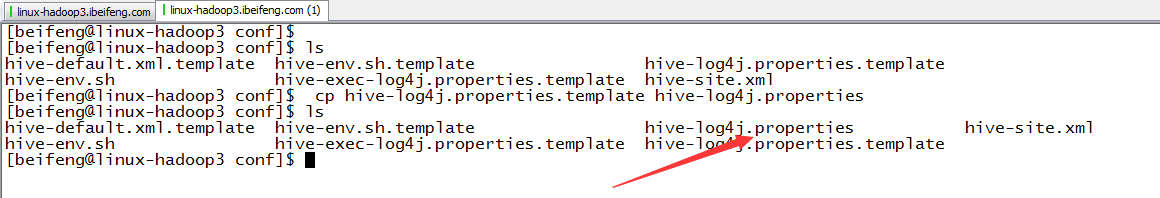

2.在conf中启用

3.修改配置,hive运行的日志配置

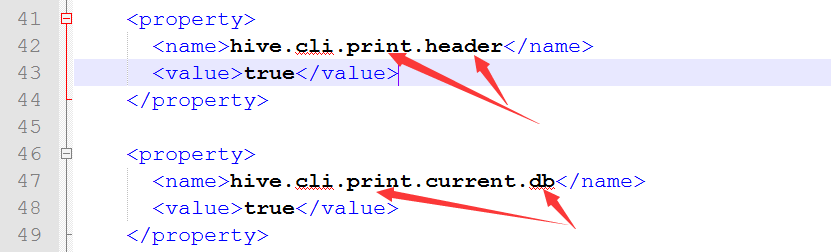

七.人性化设置

1.列名,数据库名

2.效果

038 关于HIVE的配置的更多相关文章

- Hive安装配置指北(含Hive Metastore详解)

个人主页: http://www.linbingdong.com 本文介绍Hive安装配置的整个过程,包括MySQL.Hive及Metastore的安装配置,并分析了Metastore三种配置方式的区 ...

- Hadoop之Hive(2)--配置Hive Metastore

Hive metastore服务以关系性数据库的方式存储Hive tables和partitions的metadata,并且提供给客户端访问这些数据的metastore service的API.下面介 ...

- 【转】 hive安装配置及遇到的问题解决

原文来自: http://blog.csdn.net/songchunhong/article/details/51423823 1.下载Hive安装包apache-hive-1.2.1-bin.ta ...

- hive权限配置

基于CDH5.x的Hive权限配置 1.打开权限控制,默认是没有限制的 set hive.security.authorization.enabled=true; 2.配置默认权限 hive.secu ...

- Hive的配置| 架构原理

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并提供类SQL查询功能. 本质是:将HQL转化成MapReduce程序 1)Hive处理的数据存储在HDFS 2)Hi ...

- Mac上Hive安装配置

Mac上Hive安装配置 1.安装 下载hive,地址:http://mirror.bit.edu.cn/apache/hive/ 之前我配置了集群,tjt01.tjt02.tjt03,这里hive安 ...

- Hive的配置详解和日常维护

Hive的配置详解和日常维护 一.Hive的参数配置详解 1>.mapred.reduce.tasks 默认为-1.指定Hive作业的reduce task个数,如果保留默认值,则Hive 自 ...

- Hive安装配置详解步骤以及hive使用mysql配置

Hive是一个数据仓库基础工具在Hadoop中用来处理结构化数据.它架构在Hadoop之上,总归为大数据,并使得查询和分析方便.并提供简单的sql查询功能,可以将sql语句转换为MapReduce任务 ...

- Hive设置配置参数的方法,列举8个常用配置

Hive设置配置参数的方法 Hive提供三种可以改变环境变量的方法,分别是: (1).修改${HIVE_HOME}/conf/hive-site.xml配置文件: (2).命令行参数: (3).在已经 ...

随机推荐

- elasticsearch 基本配置

基本配置elasticsearch的config文件夹里面有两个配置文件:elasticsearch.yml .logging.yml.jvm.options 第一个是es的基本配置文件,第二个是日志 ...

- 微信公众号JSAPI支付-多公众号向同一商户号支付的问题解决

一.背景 项目提供公众号商城集成,在公众号里进行商品的购买,并与多家公众号合作增加渠道流量. . 二.实现 有关微信公众号.商户号的开通与支付绑定不细说 从背景里可知,我们需要实现多个公众号购买向同一 ...

- Java SE之反射技术[Field](二)

如果对于反射的基本概念还不了解的请见上一帖子.本文仅谈fields的用法demo /** * * @author Zen Johnny * */ package com.cpms.test; impo ...

- 第4月第20天 python re xls2lua

1. import re replace_values = ['one', 'two', 'three'] replace_keys = [str(i) for i in xrange(1, 4)] ...

- saltstack系列~第三篇

一 简介:今天来聊聊sls文件的编写二 目的:通过编写特定的sls文件实现环境的初始化和固定软件的安装三 目录: /srv/salt/ 可以构造deploy文件夹四 基本构造:配置基本以yaml规范. ...

- python - isinstance/issubclass 函数

#isinstance(obj,cls) #检查是否obj是否是object的类cls的对象 #判断一个对象是否是一个类的实例 class F00(object): pass obj = F00() ...

- 2018-2019-2 网络对抗技术 20165320 Exp4 恶意代码分析

2018-2019-2 网络对抗技术 20165320 Exp4 恶意代码分析 一.实践目标 监控你自己系统的运行状态,看有没有可疑的程序在运行 分析一个恶意软件,就分析Exp2或Exp3中生成后门软 ...

- Linux安装后首次设置root密码

① 1.sudo password root //给指定用户设置密码 2.sudo passwd root //给指定用户设置密码 ②su root //切换到指定用户

- 用conda管理Python包

用conda管理Python包 conda是一个很好的包管理工具,在用了Anaconda之后一直不知道怎么用conda进行管理,其实很简单,就是没人教,慢慢自己摸索了一点.直接在Anaconda的命令 ...

- mac安装pyspider报错

(env)$ pip3 uninstall pycurl (env)$ pip3 install --upgrade pip (env)$ export LDFLAGS=-L/usr/local/op ...