NIPS2017-The neural hawks process

1.首先这篇文章研究的是 event stream,什么是event stream呢 ?

假如你是一个医生,你每天会看到很多病人 ,对于每一个病人,你都有他一长串的历史记录,有他在不同时间做了什么检查,得了什么病

假如你在淘宝、亚马逊买东西的记录,在不同时间买了不同的东西, 这也是一个event stream

在推特或者 微博上面 你可以看到 好友 在不同的时间发表微博,这些都是 event stream

2.研究event stream的意义

因为基于对过去的掌握,我们想对未来做出一定程度的预测

比如你是医生,给你病人过去的事件流,你可以预测他什么时候再来,为了什么来visit(感冒、发烧、拉肚子)

在亚马逊上,根据过往信息,你想知道用户什么时候再来买东西,买什么东西

在微博上,你想知道什么时候会retweet ,是来做这件事

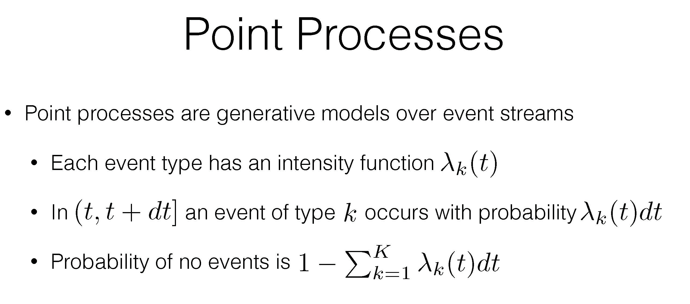

通常用 Point Process 处理 event stream

通常,用point process 来model 事件流,怎么来model呢 首先,前面看了一共有K个时间类别 , 每一个事件类别 有一个intensity function

它代表:极短时间内品均有多少个这类事件,在这个极端时间内发生了 所以在一个极小的时间内时间K类事件发生的概率

被intensity function 定义为 那么在这个时间点上 没有任何事件发生的概率 是(1减去其他事件发生的总和)

那么在这个时间点上 没有任何事件发生的概率 是(1减去其他事件发生的总和)

定义完这些之后,我们可以构造一个 event stream 在这个model下的probability

在这张图中,我们观测到两类事件(k = 2) 绿色的五边形代表的事件,粉色的正方形事件

在0到T的时间内 观测到了 N个不同的时间点。分别在Ti 发生了 事件ki

整个event stream 在0-T时间的log probability 在所有时间点没有任何事件发生(也就是左边的那一行) 加上 在 N个时间点上的 log probability (也就是第二项 ) ,

在前一页 在每一个时间点发生的概率 和 没有事件发生的概率() , 把他俩带入公式 ,并且进行一个泰勒展开 ,就可以得到最下面的公式

这个式子就是point process 对每一个观测到的事件流给出来的 log probability

左边这个被减去的积分 解释 0-T无穷个时间点上 没有任何时间发生

右边这一项 解释 为什么在N个离散的时间点有你观测到的事件发生

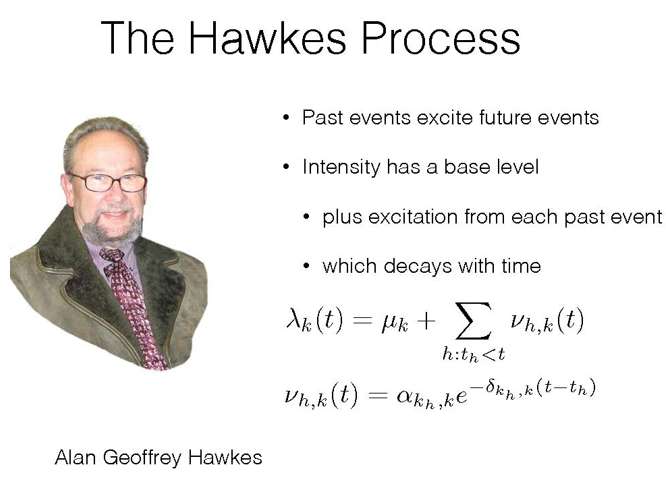

3.The Hawkes Process

很久以前,这个hawkes教授首先做了这件事,他提出了hawkes process :

他假设过去的事件 对未来事件 都有一个短暂的正向影响,

也就是过去的事件 会 正向提高 未来事件发生的概率 ,

基于这个假设, 他把intensity function 定义为一个 base level + 过去每一个事件对后面的事件带来的影响的加和,

这个影响是不同事件之间的相互影响,有k个事件,就有k的平方个阿尔法 , 这个正向的影响随着 事件衰减,所以要加上 后面这个指数项

也就是说 hawkes process假设每一类别事件他的intensity function在一个base level的基础上不断被过去事件激发,激发又随着事件消减

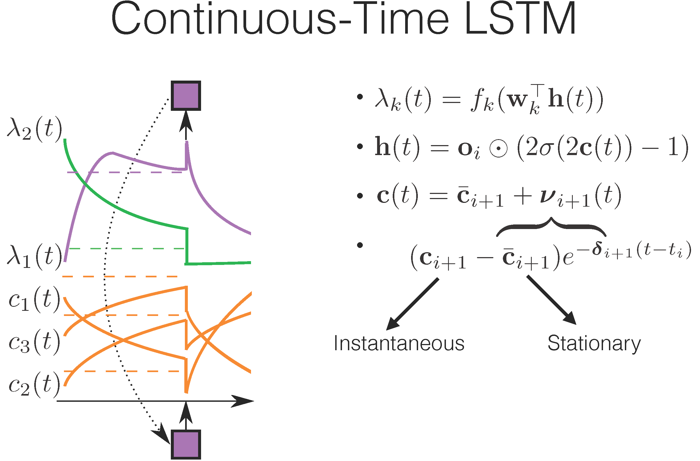

4.Continuous-Time LSTM (neural hawkes process)

作者提出了一个continuous-time LSTM

先看右边的公式:正如刚才所说的,可以把intensity function 作为一个连续时间上变化的hidden state上的non-linear function 。由于我们知道 hidden state 是被update 和 cell memory 共同决定

我们假设 cell memory 是随着时间变化的 ,从而使得H也随着时间变化

通常在普通的lstm中gate encode cell memory C 的变化, 在新模型中有两个C

一个表示暂态的memory 就是这个C , 他表示第i 次事件发生的时候,他变成了Ci+1

同时类似的,我们还可以有另外一个cell memeory 表示一个稳态的memory Cbar

他表示在稳态的时候cellmemory处于什么样的值,我们可以假设在每次事件发生之后和下一次事件发生之前,真正的cell memory T 会从暂态cell memory 开始 逐渐的向 稳态C bar变化,变化率 由一个可以被学习到的 daita function 决定

这样的话 由于c的每一个 element都是对着时间指数变化的 这堆element做一个combination 和一个non-linear 的变换,理论上可模拟 任何方式变化的时间函数 , 也就是说当我们把很多指数变化的函数组合起来的时候,我们可以让他们的组合 来逼近任何复杂形状的函数,那我们就可以得到任何复杂

形状的intensity function

举个例子 ,就是左边这张图,下面的黄线代表cell memory,假设用的是有3个hidden node 的LSTM

也就是他的维度D=3,每一个维度都随着事件递增或递减,当下一个维度发生之后,这个cell memory都会发生显著的变化,事件发生之后,cell memory 会发生显著变化,以一定速率递增或者递减

假设有两个不同事件,绿色和粉色事件,每一个事件都有它的 intensity function,他俩都可以以一些参数被写成这三个cell,c1,c2,c3的non-linear projection,那么我们可以看到 随着横轴时间轴的推移,cell memory 不断产生变化 , intensity function 也不断产生变化 , 当粉色事件发生,粉色事件作为输入,改变了cell memory的值 ,进而改变了 intensity function的值 , 新一轮的缓慢变化又开始了

整个这部分内容就是 neural hawkes 的核心内容 ,作者用连续时间上的LSTM 来capture连续时间

上hidden state的变化 ,进而能把intensity function 表示成 hidden state的一个复杂的non-linear projection。从未capture到各种复杂的影响

5.Future Work

future work 就是跟reinforce learning 结合起来

做连续时间 上的 reinforcement learning , 来学习环境什么时候给反馈,给什么反馈

和 agent 什么时候做响应 做 什么响应

NIPS2017-The neural hawks process的更多相关文章

- Self-organizing Maps及其改进算法Neural gas聚类在异常进程事件识别可行性初探

catalogue . SOM简介 . SOM模型在应用中的设计细节 . SOM功能分析 . Self-Organizing Maps with TensorFlow . SOM在异常进程事件中自动分 ...

- Deep learning_CNN_Review:A Survey of the Recent Architectures of Deep Convolutional Neural Networks——2019

CNN综述文章 的翻译 [2019 CVPR] A Survey of the Recent Architectures of Deep Convolutional Neural Networks 翻 ...

- 论文翻译:2020_FLGCNN: A novel fully convolutional neural network for end-to-end monaural speech enhancement with utterance-based objective functions

论文地址:FLGCNN:一种新颖的全卷积神经网络,用于基于话语的目标函数的端到端单耳语音增强 论文代码:https://github.com/LXP-Never/FLGCCRN(非官方复现) 引用格式 ...

- Survey of single-target visual tracking methods based on online learning 翻译

基于在线学习的单目标跟踪算法调研 摘要 视觉跟踪在计算机视觉和机器人学领域是一个流行和有挑战的话题.由于多种场景下出现的目标外貌和复杂环境变量的改变,先进的跟踪框架就有必要采用在线学习的原理.本论文简 ...

- Plant Leaves Classification植物叶子分类:基于孪生网络的小样本学习方法

目录 Abstract Introduction PROPOSED CNN STRUCTURE INITIAL CNN ANALYSIS EXPERIMENTAL STRUCTURE AND ALGO ...

- 论文翻译:Conv-TasNet: Surpassing Ideal Time–Frequency Magnitude Masking for Speech Separation

我醉了呀,当我花一天翻译完后,发现已经网上已经有现成的了,而且翻译的比我好,哎,造孽呀,但是他写的是论文笔记,而我是纯翻译,能给读者更多的思想和理解空间,并且还有参考文献,也不错哈,反正翻译是写给自己 ...

- 论文翻译:2021_Towards model compression for deep learning based speech enhancement

论文地址:面向基于深度学习的语音增强模型压缩 论文代码:没开源,鼓励大家去向作者要呀,作者是中国人,在语音增强领域 深耕多年 引用格式:Tan K, Wang D L. Towards model c ...

- 【论文笔记】Malware Detection with Deep Neural Network Using Process Behavior

[论文笔记]Malware Detection with Deep Neural Network Using Process Behavior 论文基本信息 会议: IEEE(2016 IEEE 40 ...

- [CS231n-CNN] Training Neural Networks Part 1 : activation functions, weight initialization, gradient flow, batch normalization | babysitting the learning process, hyperparameter optimization

课程主页:http://cs231n.stanford.edu/ Introduction to neural networks -Training Neural Network ________ ...

随机推荐

- zabbix配置邮件告警

1.安装邮件服务 yum -y install mailx @qq.com #发邮件测试 2.添加报警媒介 输入接收告警邮件的邮箱 3.配置SMTP服务端 使用本机作为SMTP服务器 4.创建触发器 ...

- zabbix调用api检索方法

环境 zabbix:172.16.128.16:zabbix_web:172.16.16.16/zabbix 用户名:Admin 密码:zabbix 获取的数据仅做参考,以Linux发送HTTP的PO ...

- MongoDB语法与现有关系型数据库SQL语法比较

MongoDB语法 MySql语法 db.test.find({'name':'foobar'}) <==> select ...

- Azure存储账户的日志分析方法

1.首先确认日志功能是否开启(日志文件根据存储账户的类型,按使用量收费 . 2.在存储账户-Usage(classic)-Metrics中查看突出流量的时间: 3.在Explorer中下载对应时间点的 ...

- SQL 行转列的运用

适用场景:需要将行数据转换成列数据 例子: 现在有一个学生的成绩表 但是我们需要将每个学生的成绩汇集到一条数据上,这时候就可以用到行转列. 代码如下 一.不使用 PIVOT SELECT ),[St ...

- CentOS7 升级 gvim 到 8.x 版本

因为 CentOS7 在默认情况下,通过 yum 安装的 vim-X11.x86_64 版本为 7.x 版本,对 Youcompleteme 支持不好.故需要升级到 8.x 版本. 以下记录 gvim ...

- Pandas 数据清洗常用篇

一.缺失值 sklearn中的preprocessing下有imputer,可进官方文档参考.这里主讲pandas. 拿到数据,一般先检查是否有缺失值,用isnul()或notnull(). 再决定d ...

- Centos6.5-DHCPServer安装

1.查询dhcp有没有被安装,如下没有被安装 [zfp@localhost ~]$ rpm -q dhcppackage dhcp is not installed[zfp@localhost ~]$ ...

- 网络视频会议openmeetings Windows安装

官网 http://openmeetings.apache.org/index.html 下载文件解压运行install-service脚本之后运行red5脚本启动 官方安装文档 http://ope ...

- springboot 注册dao层 service 层

可以使用三种注解来引入DAO层的接口到spring容器中.1.@Mapper,写在每一个DAO层接口上,如下: 2.@MapperScan和@ComponentScan两者之一.前者的意义是将指定包中 ...