Python 语音识别

调用科大讯飞语音听写,使用

Python实现语音识别,将实时语音转换为文字。

参考这篇博客实现的录音,首先在官网下载了关于语音听写的SDK,然后在文件夹内新建了两个.py文件,分别是get_audio.py和iat_demo.py,并且新建了一个存放录音的文件夹audios,文件夹内存放录音文件input.wav,我的整个文件目录如下:

asr_SDK(文件名)

├─ Readme.html

├─ audios

│ └─ input.wav(存放音频)

├─ bin

│ ├─ gm_continuous_digit.abnf

│ ├─ ise_cn

│ ├─ ise_en

│ ├─ msc

│ ├─ msc.dll (因为我是32位的python,所以用的这个动态链接库)

│ ├─ msc_x64.dll

│ ├─ source.txt

│ ├─ userwords.txt

│ └─ wav

├─ doc

├─ get_audio.py

├─ iat_demo.py

├─ include

├─ libs

├─ release.txt

└─ samples

一、录音

这里使用的是pyaudio进行录音,需要下载相关的轮子,具体可参考我的另一篇博客。然后根据自己的需要进行了修改,gt_audio.py全部代码如下:

import pyaudio # 这个需要自己下载轮子

import wave

in_path = "./audios/input.wav" # 存放录音的路径 def get_audio(filepath):

aa = str(input("是否开始录音? (y/n)"))

if aa == str("y") :

CHUNK = 1024

FORMAT = pyaudio.paInt16

CHANNELS = 1 # 声道数

RATE = 11025 # 采样率

RECORD_SECONDS = 5 # 录音时间

WAVE_OUTPUT_FILENAME = filepath

p = pyaudio.PyAudio() stream = p.open(format=FORMAT,

channels=CHANNELS,

rate=RATE,

input=True,

frames_per_buffer=CHUNK) print("*"*5, "开始录音:请在5秒内输入语音", "*"*5)

frames = []

for i in range(0, int(RATE / CHUNK * RECORD_SECONDS)):

data = stream.read(CHUNK)

frames.append(data)

print("*"*5, "录音结束\n") stream.stop_stream()

stream.close()

p.terminate() wf = wave.open(WAVE_OUTPUT_FILENAME, 'wb')

wf.setnchannels(CHANNELS)

wf.setsampwidth(p.get_sample_size(FORMAT))

wf.setframerate(RATE)

wf.writeframes(b''.join(frames))

wf.close()

elif aa == str("否"):

exit()

else:

print("语音录入失败,请重新开始")

get_audio(in_path)

录音的保持是可循环的,每当重新录音,都会覆盖前一次的音频。

二、语音识别

直接使用的是科大讯飞官网语音听写的web API关于Python的例子,在此基础上进行了相关的调整,自动识别录音转换为文字。iat_demo.py的全部代码如下:

import websocket

import requests

import datetime

import hashlib

import base64

import hmac

import json

import os, sys

import re

from urllib.parse import urlencode

import logging

import time

import ssl

import wave

from wsgiref.handlers import format_date_time

from datetime import datetime

from time import mktime

from pyaudio import PyAudio,paInt16

from get_audio import get_audio # 导入录音.py文件 input_filename = "input.wav" # 麦克风采集的语音输入

input_filepath = "./audios/" # 输入文件的path

in_path = input_filepath + input_filename type = sys.getfilesystemencoding() path_pwd = os.path.split(os.path.realpath(__file__))[0]

os.chdir(path_pwd) try:

import thread

except ImportError:

import _thread as thread logging.basicConfig() STATUS_FIRST_FRAME = 0 # 第一帧的标识

STATUS_CONTINUE_FRAME = 1 # 中间帧标识

STATUS_LAST_FRAME = 2 # 最后一帧的标识 framerate = 8000

NUM_SAMPLES = 2000

channels = 1

sampwidth = 2

TIME = 2 global wsParam class Ws_Param(object):

# 初始化

def __init__(self, host):

self.Host = host

self.HttpProto = "HTTP/1.1"

self.HttpMethod = "GET"

self.RequestUri = "/v2/iat"

self.APPID = "5d312675" # 在控制台-我的应用-语音听写(流式版)获取APPID

self.Algorithm = "hmac-sha256"

self.url = "wss://" + self.Host + self.RequestUri # 采集音频 录音

get_audio("./audios/input.wav") # 设置测试音频文件,流式听写一次最多支持60s,超过60s会引起超时等错误。

self.AudioFile = r"./audios/input.wav" self.CommonArgs = {"app_id": self.APPID}

self.BusinessArgs = {"domain":"iat", "language": "zh_cn","accent":"mandarin"} def create_url(self):

url = 'wss://ws-api.xfyun.cn/v2/iat'

now = datetime.now()

date = format_date_time(mktime(now.timetuple()))

APIKey = 'a6aabfcca4ae28f9b6a448f705b7e432' # 在控制台-我的应用-语音听写(流式版)获取APIKey

APISecret = 'e649956e14eeb085d1b0dce77a671131' # 在控制台-我的应用-语音听写(流式版)获取APISecret signature_origin = "host: " + "ws-api.xfyun.cn" + "\n"

signature_origin += "date: " + date + "\n"

signature_origin += "GET " + "/v2/iat " + "HTTP/1.1"

signature_sha = hmac.new(APISecret.encode('utf-8'), signature_origin.encode('utf-8'),

digestmod=hashlib.sha256).digest()

signature_sha = base64.b64encode(signature_sha).decode(encoding='utf-8') authorization_origin = "api_key=\"%s\", algorithm=\"%s\", headers=\"%s\", signature=\"%s\"" % (

APIKey, "hmac-sha256", "host date request-line", signature_sha)

authorization = base64.b64encode(authorization_origin.encode('utf-8')).decode(encoding='utf-8')

v = {

"authorization": authorization,

"date": date,

"host": "ws-api.xfyun.cn"

}

url = url + '?' + urlencode(v)

return url # 收到websocket消息的处理 这里我对json解析进行了一些更改 打印简短的一些信息

def on_message(ws, message):

msg = json.loads(message) # 将json对象转换为python对象 json格式转换为字典格式

try:

code = msg["code"]

sid = msg["sid"] if code != 0:

errMsg = msg["message"]

print("sid:%s call error:%s code is:%s\n" % (sid, errMsg, code))

else:

result = msg["data"]["result"]["ws"]

# 以json格式显示

data_result = json.dumps(result, ensure_ascii=False, sort_keys=True, indent=4, separators=(',', ': '))

print("sid:%s call success!" % (sid))

print("result is:%s\n" % (data_result))

except Exception as e:

print("receive msg,but parse exception:", e) # 收到websocket错误的处理

def on_error(ws, error):

print("### error:", error) # 收到websocket关闭的处理

def on_close(ws):

print("### closed ###") # 收到websocket连接建立的处理

def on_open(ws):

def run(*args):

frameSize = 1280 # 每一帧的音频大小

intervel = 0.04 # 发送音频间隔(单位:s)

status = STATUS_FIRST_FRAME # 音频的状态信息,标识音频是第一帧,还是中间帧、最后一帧

with open(wsParam.AudioFile, "rb") as fp:

while True:

buf = fp.read(frameSize) # 文件结束

if not buf:

status = STATUS_LAST_FRAME

# 第一帧处理

# 发送第一帧音频,带business 参数

# appid 必须带上,只需第一帧发送

if status == STATUS_FIRST_FRAME: d = {"common": wsParam.CommonArgs,

"business": wsParam.BusinessArgs,

"data": {"status": 0, "format": "audio/L16;rate=16000",

"audio": str(base64.b64encode(buf),'utf-8'),

"encoding": "raw"}}

d = json.dumps(d)

ws.send(d)

status = STATUS_CONTINUE_FRAME

# 中间帧处理

elif status == STATUS_CONTINUE_FRAME:

d = {"data": {"status": 1, "format": "audio/L16;rate=16000",

"audio": str(base64.b64encode(buf),'utf-8'),

"encoding": "raw"}}

ws.send(json.dumps(d))

# 最后一帧处理

elif status == STATUS_LAST_FRAME:

d = {"data": {"status": 2, "format": "audio/L16;rate=16000",

"audio": str(base64.b64encode(buf),'utf-8'),

"encoding": "raw"}}

ws.send(json.dumps(d))

time.sleep(1)

break

# 模拟音频采样间隔

time.sleep(intervel)

ws.close() thread.start_new_thread(run, ()) if __name__ == "__main__":

wsParam = Ws_Param("ws-api.xfyun.cn") #流式听写 域名

websocket.enableTrace(False)

wsUrl = wsParam.create_url()

ws = websocket.WebSocketApp(wsUrl, on_message=on_message, on_error=on_error, on_close=on_close)

ws.on_open = on_open

ws.run_forever(sslopt={"cert_reqs": ssl.CERT_NONE})

三、启动程序

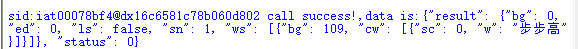

在程序文件夹内,右键点击iat_demo,选择Edit with IDLE->Edit with IDLE3.7(32 bit)打开,然后使用F5快速启动,启动的时候如果提示没有哪个第三方包,自行安装。启动成功后根据提示进行操作,这是我修改json解析之前操作的打印结果:

相关代码下载

Python 语音识别的更多相关文章

- 基于百度语音识别API的Python语音识别小程序

一.功能概述 实现语音为文字,可以扩展到多种场景进行工作,这里只实现其基本的语言接收及转换功能. 在语言录入时,根据语言内容的多少与停顿时间,自动截取音频进行转换. 工作示例: 二.软件环境 操作系统 ...

- 手把手使用Python语音识别,进行语音转文字

0. 太长不看系列,直接使用 在1.2官网注册后拿到APISecret和APIKey,直接复制文章2.4demo代码,确定音频为wav格式,采样率为16K,在命令行执行 python single_s ...

- Python语音识别(计算器)

第一步关于导入模块的事,我试了好几个方法才发现在好像win7系统没有语音识别功能,我用了win10的又需要重新下载一个包 这样子,win32com.client模块就可以使用了 import win3 ...

- Python简单语音识别并响应

起因是一个工作中喜欢说口头禅的同事,昨天老说"你看看你看看 操不操心".说了几次之后我就在他说完"你看看"后面续上,"操不操心".往复多次后 ...

- 语音识别中的CTC算法的基本原理解释

欢迎大家前往腾讯云+社区,获取更多腾讯海量技术实践干货哦~ 本文作者:罗冬日 目前主流的语音识别都大致分为特征提取,声学模型,语音模型几个部分.目前结合神经网络的端到端的声学模型训练方法主要CTC和基 ...

- Python人工智能学习笔记

Python教程 Python 教程 Python 简介 Python 环境搭建 Python 中文编码 Python 基础语法 Python 变量类型 Python 运算符 Python 条件语句 ...

- 痞子衡嵌入式:语音处理工具Jays-PySPEECH诞生记(1)- 环境搭建(Python2.7.14 + PyAudio0.2.11 + Matplotlib2.2.3 + SpeechRecognition3.8.1 + pyttsx3 2.7)

大家好,我是痞子衡,是正经搞技术的痞子.今天痞子衡给大家介绍的是语音处理工具Jays-PySPEECH诞生之环境搭建. 在写Jays-PySPEECH时需要先搭好开发环境,下表列出了开发过程中会用到的 ...

- python调用百度语音(语音识别-斗地主语音记牌器)

一.概述 本篇简要介绍百度语音语音识别的基本使用(其实是斗地主时想弄个记牌器又没money,抓包什么的又不会,只好搞语音识别的了) 二.创建应用 打开百度语音官网,产品与使用->语音识别-> ...

- python +百度语音识别+图灵对话

https://github.com/Dongvdong/python_Smartvoice 上电后,只要周围声音超过 2000,开始录音5S 录音上传百度识别,并返回结果文字输出 继续等待,周围声音 ...

随机推荐

- ckeditor如何能实现直接粘贴把图片上传到服务器中?

在之前在工作中遇到在富文本编辑器中粘贴图片不能展示的问题,于是各种网上扒拉,终于找到解决方案,在这里感谢一下知乎中众大神以及TheViper. 通过知乎提供的思路找到粘贴的原理,通过TheViper找 ...

- 关于BSP,BIOS,和bootloader

BSP是板级支持包,是介于主板硬件和操作系统之间的一层,应该说是属于操作系统的一部分,主要目的是为了支持操作系统,使之能够更好的运行于硬件主板.BSP是相对于操作系统而言的,不同的操作系统对应于不同定 ...

- change可以重命名列名,也可能修改列的类型和约束,而modify只能修改列的数据类型。

change 可以重命名列名,也可能修改列的数据类型,而modify只能修改列的数据类型. change 比modify功能多,如果要用change修改字段类型和约束,要加上新字段名,新字段名可以和原 ...

- EZOJ #373排序

分析 它居然真的是个nlog^3暴力?! 两个数在加小于min(lowbit(x),lowbit(y))的数时对他们的奇偶性不影响 因此每次加上min(lowbit(x),lowbit(y))判断此时 ...

- leetcode 122. 买卖股票的最佳时机 II (python)

给定一个数组,它的第 i 个元素是一支给定股票第 i 天的价格. 设计一个算法来计算你所能获取的最大利润.你可以尽可能地完成更多的交易(多次买卖一支股票). 注意:你不能同时参与多笔交易(你必须在再次 ...

- PostgreSQL 在视频、图片去重,图像搜索业务中的应用

摘要: PostgreSQL 在视频.图片去重,图像搜索业务中的应用作者digoal日期2016-11-26标签PostgreSQL , Haar wavelet , 图像搜索 , 图片去重 , 视频 ...

- php Function ereg() is deprecated的解决方法

PHP 5.3 ereg() 无法正常使用,提示“Function ereg() is deprecated Error”.问题根源是php中有两种正则表示方法,一个是posix,一个是perl,ph ...

- LeetCode 144. Binary Tree Preorder Traversal 动态演示

先序遍历的非递归办法,还是要用到一个stack class Solution { public: vector<int> preorderTraversal(TreeNode* root) ...

- C#将字符串Split()成数组

string str="aaajbbbjccc";string[] sArray=str.Split('j');foreach(string i in sArray) Respon ...

- SAS去空格

data test; x=" aaa bbb hahaha"; x1=compress(x); x2=left(x); p ...