论文解读(USIB)《Towards Explanation for Unsupervised Graph-Level Representation Learning》

论文信息

论文标题:Towards Explanation for Unsupervised Graph-Level Representation Learning

论文作者:Qinghua Zheng, Jihong Wang, Minnan Luo, Yaoliang Yu, Jundong Li, Lina Yao, Xiaojun Chang

论文来源:2022, arXiv

论文地址:download

论文代码:download

1 Introduction

使用信息瓶颈的图级表示可解释性。

2 Notations and preliminaries

2.1 Information Bottleneck

给定输入数据 $X$ 及其标签 $Y$,Information Bottleneck 的目的是发现一个压缩的潜在表示 $Z$,它以 $Y$ 提供最大的信息。在形式上,我们可以通过优化以下优化问题来学习潜在的表示 $Z$:

$\underset{Z}{max } \;\mathcal{L}_{I B}=I(Z ; Y)-\beta I(X ; Z)\quad\quad\quad(1)$

其中,$\beta$ 表示对信息量和压缩量的超参数权衡。

互信息(MI)I(X;Z)度量两个随机变量的相关性,表述为

$I(X ; Z)= \int_{x} \int_{z} p(x, z) \log \frac{p(x, z)}{p(x) p(z)} d x d z $

2.2 GNN explanation

GNN的解释旨在理解对GNN的计算过程至关重要的图的内在信息,从而提供人类可理解的解释。具体来说,给定一个图 $G$ 和一个学习条件分布 $P_{\psi}(\hat{Z} \mid G), \mathrm{GNN}$ 的GNN模型 $\psi$),GNN解释的目的是学习与GNN的计算结果最相关的解释子图 $S$,即:

$\underset{S \in \mathcal{S}}{\text{arg max }} \operatorname{Score}(S, \hat{Z})\quad\quad\quad(2)$

其中,$\mathcal{S}$ 表示由图 $G$ 的所有可能的子图组成的集合;$\operatorname{Score}(S, \hat{Z})$ 测量了子图 $\mathcal{S}$ 和 GNN 的计算结果 $\hat{Z}$ 之间的相关性。

例如,GNNExcraner[9]关注于对监督 GNN 的解释,并将相关评分 $\operatorname{Score}(S, \hat{Z})$ 形式化为互信息,即

$S=\arg \max _{S \in \mathcal{S}} I(S ; \hat{Y})$

其中,随机变量 $\hat{Y}=\hat{Z}$ 表示分类概率。

3 Method

3.1 Unsupervised Subgraph Information Bottleneck

在本文中,我们研究了无监督图级表示学习的未探索的解释问题。给定一个由无监督 GNN 提取的图 $G$ 及其对应的表示 $Z$,我们的目标是识别与这些表示最相关的解释子图 $S$。

根据前面的解释工作原理[9,10],我们利用互信息来度量相关性,因此将解释问题表述为 $\underset{S}{\text{arg max }} I(S ; Z)$。不幸的是,由于 $I(Z ; S) \leq I(Z ; G)$(证明见附录B),因此已经证明了存在一个平凡的解 $S=G$。琐碎的解决方案表明,解释子图年代可能包含多余的信息,例如,噪声和无关的信息表示 $Z$ 受 $IB$ 原则的成功解释监督网络[19],我们推广 $IB$ 原则无监督设置,以避免琐碎的解决方案和利用一个新的原则。

Definition. (Unsupervised Subgraph Information Bottleneck: USIB). Given a graph $G$ and its representation $Z$ , the USIB seeks for the most informative yet compressed explanation $S$ through optimization problem

$ \underset{S}{\text{max } }\mathcal{L}_{U S I B}=I(Z ; S)-\beta I(G ; S)\quad\quad\quad(3)$

通过优化USIB目标,我们可以在解释性子图的信息性和压缩性之间进行权衡。然而,由于USIB目标的优化,互信息涉及到高维数据的积分,这是非常困难的。因此,需要利用互信息估计方法。

3.2 Optimization for USIB

我们分别在USIB的目标中处理两项 $I(Z ; S)$ 和 $I(G ; S)$。

Maximizing $I(Z ; S)$

我们采用 Jensen-Shannon MI estimator [32,33]来为 $I(Z;S)$ 分配一个近似的下界,即,

$\hat{I}^{J S D}(Z ; S):=\sup _{f_{\phi}} \mathbb{E}_{p(S, Z)}\left[-s p\left(-f_{\phi}(S, Z)\right)\right]-\mathbb{E}_{p(S), p(Z)}\left[s p\left(f_{\phi}(S, Z)\right)\right]\quad\quad\quad(4)$

其中 $ s p(x)=\log \left(1+e^{x}\right)$ 为 softplus function;函数 $ f_{\phi}: \mathcal{S} \times \mathcal{Z} \rightarrow \mathbb{R}$ 是带可学习参数 $\phi $,以区分 $S$ 和 $Z$ 的实例是否从联合分布中采样。它是由 $\mathrm{MLP}_{\phi_{1}}$ 和 $\mathrm{GNN}_{\phi_{2}}$ 的函数复合来实现的,即:

$f_{\phi}\left(S^{(k)}, Z^{(k)}\right)=\operatorname{MLP}_{\phi_{1}}\left(\operatorname{GNN}_{\phi_{2}}\left(S^{(k)}\right) \| Z^{(k)}\right)\quad\quad\quad(5)$

其中,$\phi=\left\{\phi_{1}, \phi_{2}\right\}$;$\|$ 是指连接操作符。请注意,先验分布 $p(S, Z)$ 和 $p(Z)$ 在实践中通常是不可到达的。结合蒙特卡罗抽样来近似先验分布,我们得到了一个近似下界 $Eq.4$ 由:

$\underset{\phi}{max} \mathcal{L}_{1}(\phi, S)=\frac{1}{K} \sum\limits_{k=1}^{K}-s p\left(-f_{\phi}\left(S^{(k)}, Z^{(k)}\right)\right)-\frac{1}{K} \sum\limits_{k=1, m \neq k}^{K} s p\left(f_{\phi}\left(S^{(k)}, Z^{(m)}\right)\right)\quad\quad\quad(6)$

其中,$K$ 为样本的数量。$\left(S^{(k)}, Z^{(k)}\right)$ 从联合分布 $p(S, Z)$ 中采样,$\left(S^{(k)}, Z^{(m)}\right)$ 分别从边缘分布 $p(S)$ 和 $p(Z)$ 中独立采样。在实践中,我们通过随机排列从联合分布中抽样 $\left(S^{(k)}, Z^{(k)}\right)$ 对来采样 $\left(S^{(k)}, Z^{(m)}\right)$。

Minimizing $\boldsymbol{I}(\boldsymbol{G} ; \boldsymbol{S}) $

请注意,解释子图的熵 $H(S)=\mathbb{E}_{p(S)}[-\log p(S)]$ 为 $I(G ; S)$ 提供了一个上界,因为不等式 $I(G ; S)=H(S)-H(S \mid G) \leq H(S)$ 成立。然而,由于在实践中 $S$ 的先验分布未知的,因此很难计算熵。为了解决这个问题,我们考虑一个松弛,并假设解释图是一个吉尔伯特随机图(Gilbert random graph)[34],其中边有条件地相互独立。具体地说,让 $(i, j) \in \mathcal{E}$ 表示图 $G$ 的边,$e_{i, j} \sim \operatorname{Bernoulli}\left(\mu_{i, j}\right)$ 是一个二元变量指示是否为子图 $S$ 选择边 $(i, j)$ 。因此,子图的概率分解为 $p(S)=\prod\limits _{(i, j) \in \mathcal{E}} p\left(e_{i, j}\right)$,其中 $p\left(e_{i, j}\right)=\mu_{i, j}^{e_{i, j}}\left(1-\mu_{i, j}\right)^{1-e_{i, j}}$。这样,我们就可以用蒙特卡罗抽样得到 $I(G ; S)$ 的一个近似上界,它记为

$\mathcal{L}_{2}(S)=-\frac{1}{K} \sum\limits_{k=1}^{K} \sum\limits_{(i, j) \in \mathcal{E}} e_{i, j}^{(k)} \log \mu_{i, j}^{(k)}+\left(1-e_{i, j}^{(k)}\right) \log \left(1-\mu_{i, j}^{(k)}\right)\quad\quad\quad(7)$

基于梯度的优化方法可能无法优化 $\text{Eq.6}$ 和 $\text{Eq.7}$ ,由于不可微采样过程和子图结构的离散性质。因此,我们遵循 Gumbel-Softmax reparametrization trick [35, 36] 并将二元变量 $e_{i, j}$ 放宽为一个连续的边权值变量 $\hat{e}_{i, j}=\sigma((\log \epsilon-\log (1-\epsilon)+ \left.\left.w_{i, j}\right) / \tau\right) \in[0,1]$,其中 $\sigma(\cdot)$ 是 sigmoid function ;$\epsilon \sim \operatorname{Uniform}(0,1)$;$\tau$ 是温度超参数,并有 $\lim _{\tau \rightarrow 0} p\left(\hat{e}_{i, j}=1\right)=\sigma\left(w_{i, j}\right)$;$w_{i, j}$ 是由神经网络根据之前的工作计算的潜在变量:

$w_{i, j}^{(k)}=\operatorname{MLP}_{\theta_{1}}\left(\mathbf{z}_{i}^{(k)} \| \mathbf{z}_{j}^{(k)}\right) \text { with } \mathbf{z}_{i}^{(k)}=\operatorname{GNN}_{\theta_{2}}\left(G^{(k)}, i\right), i=1,2, \cdots\quad\quad\quad(8)$

其中,$\mathbf{z}_{i}^{(k)}$ 表示节点 $i$ 的节点表示。为了更好地表示,我们表示 $\theta= \left\{\theta_{1}, \theta_{2}\right\}$,并通过 $\hat{S}^{(k)}=g_{\theta}\left(G^{(k)}\right)^{3}$ 生成松弛子图 $\hat{S}$。设 $\mu_{i, j}^{(k)}=\sigma\left(w_{i, j}^{(k)}\right)$,等式中的 $\text{Eq.7}$ 可以被重写为

$\mathcal{L}_{2}\left(g_{\theta}\left(G^{(k)}\right)\right)=-\frac{1}{K} \sum\limits_{k=1}^{K} \sum\limits_{(i, j) \in \mathcal{E}} \hat{e}_{i, j}^{(k)} \log \sigma\left(w_{i, j}^{(k)}\right)+\left(1-\hat{e}_{i, j}^{(k)}\right) \log \left(1-\sigma\left(w_{i, j}^{(k)}\right)\right)\quad\quad\quad(9)$

总之,我们重写了USIB优化问题 $\text{Eq.3}$ 作为:

$\underset{\phi, \theta}{\text{max }} \mathcal{L}_{U S I B}(\phi, \theta, G)=\mathcal{L}_{1}\left(\phi, g_{\theta}\left(G^{(k)}\right)\right)-\beta * \mathcal{L}_{2}\left(g_{\theta}\left(G^{(k)}\right)\right)\quad\quad\quad(10)$

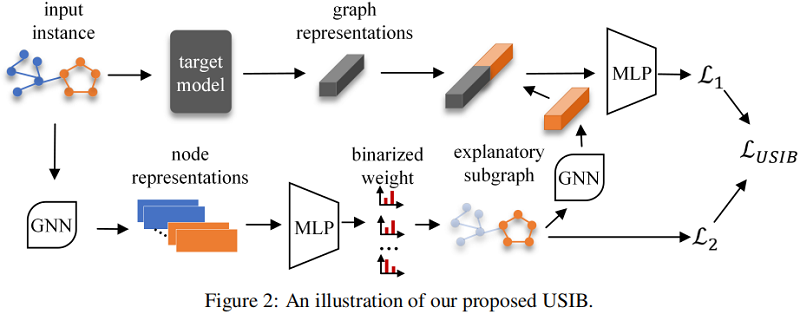

我们的方法的概述如 Fig. 2 所示。首先通过神经网络生成解释子图,然后利用另一个网络来估计解释子图和图表示之间的互信息。最后,对子图生成器和互信息估计器进行了协同优化。最终的解释性子图可以通过选择具有 top-n 个边权值 $\left(\hat{e}_{i, j}^{(k)}\right)$ 的边来实现。详细的算法可以在附录中找到。

3 Experiments

在本节中,我们通过回答以下问题来实证评估我们所提出的方法的有效性和优越性。

- RQ1 How does our proposed method perform compared to other baseline explainers?

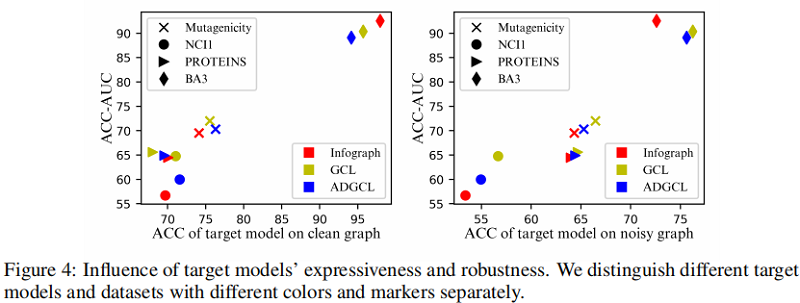

- RQ2 Does expressiveness and robustness of representations affect the fifidelity of explanatory subgraphs in agreement with the theoretical analysis?

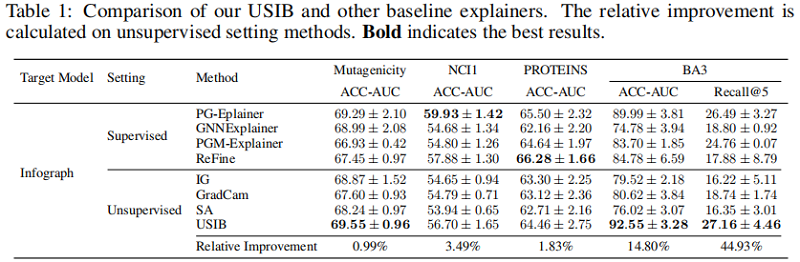

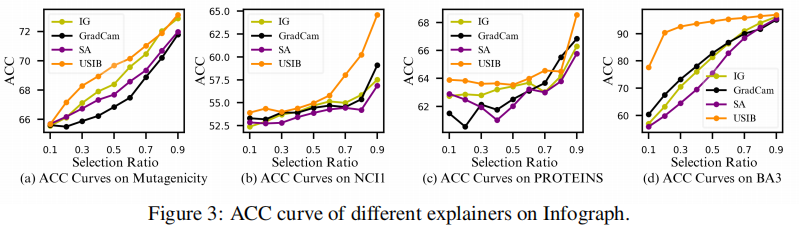

3.1 Effectiveness of USIB

3.2 Inflfluence of representations’ expressiveness and robustness

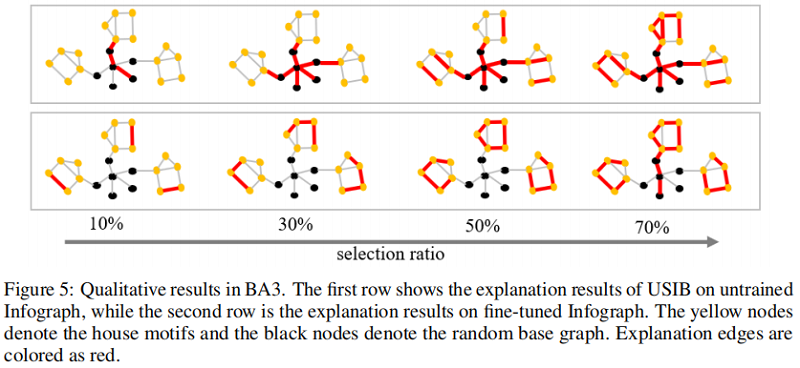

3.3 Qualitative analysis

4 Conclusion

我们研究了一个未被探索的解释问题:对无监督图表示学习的解释。我们提出了IB原理来解决解释问题,从而产生了一种新的解释方法USIB。此外,我们还从理论上分析了标签空间上的表示和解释子图之间的联系,结果表明,表达性和鲁棒性有利于解释子图的保真度。在四个数据集和三个目标模型上的广泛结果证明了我们的方法的优越性和理论分析的有效性。作为未来的研究方向,我们考虑了无监督表示学习的反事实解释[42],并探讨了解释和对抗性例子[43,44,45]之间是否存在联系。

修改历史

2022-06-21 创建文章

参考文献

论文解读(USIB)《Towards Explanation for Unsupervised Graph-Level Representation Learning》的更多相关文章

- 论文解读(GRACE)《Deep Graph Contrastive Representation Learning》

Paper Information 论文标题:Deep Graph Contrastive Representation Learning论文作者:Yanqiao Zhu, Yichen Xu, Fe ...

- 论文解读(GCC)《Efficient Graph Convolution for Joint Node RepresentationLearning and Clustering》

论文信息 论文标题:Efficient Graph Convolution for Joint Node RepresentationLearning and Clustering论文作者:Chaki ...

- 论文解读(AGC)《Attributed Graph Clustering via Adaptive Graph Convolution》

论文信息 论文标题:Attributed Graph Clustering via Adaptive Graph Convolution论文作者:Xiaotong Zhang, Han Liu, Qi ...

- 论文解读《Momentum Contrast for Unsupervised Visual Representation Learning》俗称 MoCo

论文题目:<Momentum Contrast for Unsupervised Visual Representation Learning> 论文作者: Kaiming He.Haoq ...

- 论文解读(MLGCL)《Multi-Level Graph Contrastive Learning》

论文信息 论文标题:Structural and Semantic Contrastive Learning for Self-supervised Node Representation Learn ...

- 论文解读(SelfGNN)《Self-supervised Graph Neural Networks without explicit negative sampling》

论文信息 论文标题:Self-supervised Graph Neural Networks without explicit negative sampling论文作者:Zekarias T. K ...

- 论文解读(DGI)《DEEP GRAPH INFOMAX》

论文标题:DEEP GRAPH INFOMAX 论文方向:图像领域 论文来源:2019 ICLR 论文链接:https://arxiv.org/abs/1809.10341 论文代码:https:// ...

- 论文解读(DCRN)《Deep Graph Clustering via Dual Correlation Reduction》

论文信息 论文标题:Deep Graph Clustering via Dual Correlation Reduction论文作者:Yue Liu, Wenxuan Tu, Sihang Zhou, ...

- 论文解读(IGSD)《Iterative Graph Self-Distillation》

论文信息 论文标题:Iterative Graph Self-Distillation论文作者:Hanlin Zhang, Shuai Lin, Weiyang Liu, Pan Zhou, Jian ...

- 论文解读(SAGPool)《Self-Attention Graph Pooling》

论文信息 论文标题:Self-Attention Graph Pooling论文作者:Junhyun Lee, Inyeop Lee, Jaewoo Kang论文来源:2019, ICML论文地址:d ...

随机推荐

- Mybatis插入数据

对上文->Mybatis快速入门-<进行代码修改 1.在UserMapper.xml中添加插入操作 <!-- 插入操作--> <insert id="save& ...

- SpringMVC的数据响应方式-页面跳转

1.返回字符串形式 直接返回字符串:此种方式会返回字符串与视图解析器的前后缀拼接后跳转 有关视图解析器的拼接请访问此地址 注意:WEB-INF下的资源一般不能访问,因为转发是服务器的操作所以可以访问到 ...

- JavaWeb学习day7-Response初学3(重定向)

重定向:web资源收到客户端请求后,通知客户端去访问另外一个web资源 1 protected void doGet(HttpServletRequest req, HttpServletRespon ...

- alipay 当面付扫码支付实战开发

alipay 当面付扫码支付开发 参考官网地址:https://opendocs.alipay.com/open/194/105072 1.当面付介绍: 当面付包括付款码支付和扫码支付两种收款方式.适 ...

- 集合——Collection接口,List接口

集合:对象的容器,定义了对多个对象进行操作的常用方法.可实现数组的功能 集合和数组的区别: 数组长度固定,集合长度不固定 数组可以存储基本数据类型和引用数据类型,集合只能存储引用数据类型. 集合的位置 ...

- shell语法习题练习进阶版

第4章 shell语法深度习题练习 4.1 使用if,case,函数的方法将服务改成system(centos6) 4.1.1 if方法 4.1.1.1 system实现 4.1.1.1.1 编写代码 ...

- Python抽象基类:ABC谢谢你,因为有你,温暖了四季!

Python抽象基类:ABC谢谢你,因为有你,温暖了四季! Python抽象基类:ABC谢谢你,因为有你,温暖了四季! 实例方法.类方法和静态方法 抽象类 具名元组 参考资料 最近阅读了<Pyt ...

- Docker Compose 的介绍、安装与使用

什么是 Docker Compose? Compose 是 Docker 官方的开源项目,负责实现Docker容器集群的快速编排,开源代码在 https://github.com/docker/com ...

- ucore lab1 操作系统启动过程 学习笔记

开头赞美THU给我们提供了这么棒的资源.难是真的难,好也是真的好.这种广查资料,反复推敲,反复思考从通电后第一条代码搞起来理顺一个操作系统源码的感觉是真的爽. 1. 操作系统镜像文件ucore.img ...

- 为什么vue中的v-bind用在class属性上有点怪?

如图所见,普通的标签属性我们直接使用 :属性名=`props的值` 就可以了.为什么用到class里要加[ ] 这个???