python爬虫入门(1)-urllib模块

- url:需要打开的网址

- data:Post提交的数据

- timeout:设置网站的访问超时时间

import urllib.request

response = urllib.request.urlopen("http://www.fishc.com")#是一个HTTP响应类型

html =response.read()#读取响应内容,为bytes类型

# print(type(html),html) #输出的为一串<class 'bytes'>

html = html.decode('utf-8')#bytes类型解码为str类型

print(html)

import urllib.request

response = urllib.request.urlopen("http://placekitten.com/g/400/400")

cat_img = response.read()

with open('cat_400_400.jpg','wb')as f:

f.write(cat_img)

import urllib.request

import urllib.parse

import json

import time

while True:

content = input("请输入需要翻译的内容《输入q!退出程序》:")

if content == 'q!':

break

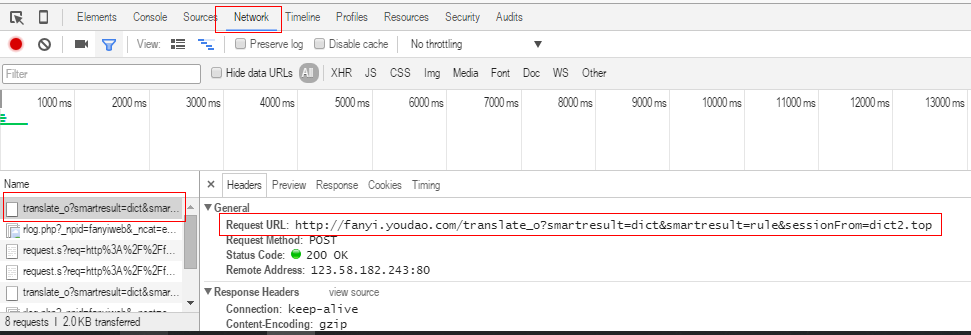

url = "http://fanyi.youdao.com/translate?smartresult=dict&smartresult=rule&smartresult=ugc&sessionFrom=http://www.youdao.com/" #即RequestURL中的链接

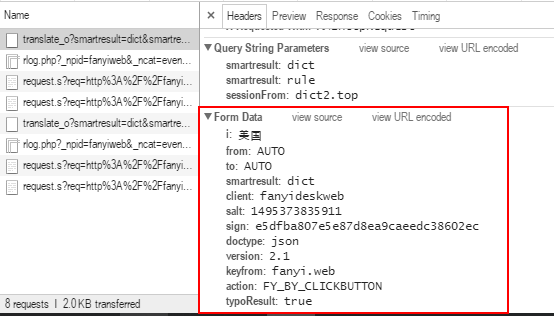

data = {}

#Form Data中的内容,适当删除无用信息

data['i'] = content

data['smartresult'] = 'dict'

data['client'] = 'fanyideskweb'

data['doctype'] = 'json'

data['version'] = '2.1'

data['keyfrom'] = 'fanyi.web'

data['action'] = 'FY_BY_CLICKBUTTON'

data['typoResult'] = 'true'

data = urllib.parse.urlencode(data).encode('utf-8')

#打开网址并提交表单

response = urllib.request.urlopen(url, data)

html = response.read().decode('utf-8')

target = json.loads(html)

print("翻译结果:%s" % (target['translateResult'][0][0]['tgt']))

time.sleep(2)

import urllib.request

import random

url ='http://www.whatismyip.com.tw/'

iplist =['61.191.41.130:80','115.46.97.122:8123',] #参数是一个字典{'类型':'代理IP:端口号'}

proxy_support = urllib.request.ProxyHandler({'http':random.choice(iplist)})

#定制、创建一个opener

opener = urllib.request.build_opener(proxy_support)

#通过addheaders修改User-Agent

opener.addheaders =[('User-Agent','Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/48.0.2564.97 Safari/537.36')]

#安装opener

urllib.request.install_opener(opener)

response = urllib.request.urlopen(url)

html = response.read().decode('utf-8')

print(html)

import urllib.request

import re

def open_url(url):

#打开URL并修改header,将URL内容读取

req = urllib.request.Request(url)

#通过add_header修改User-Agent

req.add_header('User-Agent','Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/48.0.2564.97 Safari/537.36')

page = urllib.request.urlopen(req)

html = page.read().decode('utf-8')

return html def get_img(html):

p = r'<img class="BDE_Image" src="([^"]+\.jpg)'

imglist = re.findall(p,html)#寻找到图片的链接

for each in imglist:

filename = each.split("/")[-1]

urllib.request.urlretrieve(each,filename,None)#保存图片

if __name__ =='__main__':

url ="https://tieba.baidu.com/p/5090206152"

get_img(open_url(url))

python爬虫入门(1)-urllib模块的更多相关文章

- Python爬虫入门之Urllib库的高级用法

1.设置Headers 有些网站不会同意程序直接用上面的方式进行访问,如果识别有问题,那么站点根本不会响应,所以为了完全模拟浏览器的工作,我们需要设置一些Headers 的属性. 首先,打开我们的浏览 ...

- Python爬虫入门之Urllib库的基本使用

那么接下来,小伙伴们就一起和我真正迈向我们的爬虫之路吧. 1.分分钟扒一个网页下来 怎样扒网页呢?其实就是根据URL来获取它的网页信息,虽然我们在浏览器中看到的是一幅幅优美的画面,但是其实是由浏览器解 ...

- Python爬虫入门:Urllib库的高级使用

1.设置Headers 有些网站不会同意程序直接用上面的方式进行访问,如果识别有问题,那么站点根本不会响应,所以为了完全模拟浏览器的工作,我们需要设置一些Headers 的属性. 首先,打开我们的浏览 ...

- Python爬虫入门:Urllib库的基本使用

1.分分钟扒一个网页下来 怎样扒网页呢?其实就是根据URL来获取它的网页信息,虽然我们在浏览器中看到的是一幅幅优美的画面,但是其实是由浏览器解释才呈现出来的,实质它 是一段HTML代码,加 JS.CS ...

- 芝麻HTTP:Python爬虫入门之Urllib库的基本使用

1.分分钟扒一个网页下来 怎样扒网页呢?其实就是根据URL来获取它的网页信息,虽然我们在浏览器中看到的是一幅幅优美的画面,但是其实是由浏览器解释才呈现出来的,实质它是一段HTML代码,加 JS.CSS ...

- 芝麻HTTP: Python爬虫入门之Urllib库的高级用法

1.设置Headers 有些网站不会同意程序直接用上面的方式进行访问,如果识别有问题,那么站点根本不会响应,所以为了完全模拟浏览器的工作,我们需要设置一些Headers 的属性. 首先,打开我们的浏览 ...

- Python爬虫入门:Urllib parse库使用详解(二)

文字转载:https://www.jianshu.com/p/e4a9e64082ef,转载内容仅供学习 如有侵权,请联系删除 获取url参数 urlparse 和 parse_qs ParseRes ...

- 3.Python爬虫入门三之Urllib和Urllib2库的基本使用

1.分分钟扒一个网页下来 怎样扒网页呢?其实就是根据URL来获取它的网页信息,虽然我们在浏览器中看到的是一幅幅优美的画面,但是其实是由浏览器解释才呈现出来的,实质它是一段HTML代码,加 JS.CSS ...

- Python爬虫入门四之Urllib库的高级用法

1.设置Headers 有些网站不会同意程序直接用上面的方式进行访问,如果识别有问题,那么站点根本不会响应,所以为了完全模拟浏览器的工作,我们需要设置一些Headers 的属性. 首先,打开我们的浏览 ...

- 转 Python爬虫入门四之Urllib库的高级用法

静觅 » Python爬虫入门四之Urllib库的高级用法 1.设置Headers 有些网站不会同意程序直接用上面的方式进行访问,如果识别有问题,那么站点根本不会响应,所以为了完全模拟浏览器的工作,我 ...

随机推荐

- 彻底的卸载干净oracle 11g

1.关闭oracle所有的服务.可以在windows的服务管理器中关闭: 2.打开注册表:regedit 打开路径: <找注册表 :开始->运行->regedit> H ...

- java 加密解密工具类(实用!!!)

最近发现了一个加密解密的好例子,很方便使用,可以作为平时开发的工具集,记录一下. package com.sh.springboottdemo2.util; import com.sun.org.ap ...

- Mac下配置Hadoop环境

下载Hadoop(我下载的是2.8.0版本) 点击此处下载 下载后,使用 tar -zxvf tar包名 解压tar包,解压完成后有这样一个文件出现 修改Hadoop的配置文件 需要修改的配置文件在H ...

- codeforce AIM tech Round 4 div 2 B rectangles

2017-08-25 15:32:14 writer:pprp 题目: B. Rectangles time limit per test 1 second memory limit per test ...

- STL map用法总结(multimap)

2017-08-19 10:58:52 writer;pprp #include <map> #include <string> #include <iostream&g ...

- [BZOJ3244][NOI2013]树的计数

这题大家为什么都写O(NlogN)的算法呢?…… 让本蒟蒻来写一个O(N)的吧…… 首先还是对BFS序和DFS序重编号,记标好的DFS序为d[1..n].令pos[x]为x在d[]中出现的位置,即po ...

- 超详细!mac flutter 创建过程及遇到的问题

虽然网上有教程,但是过程中遇到些问题,这些问题教程里并没有,所以写这个文章记录一下. 1.打开终端 2.clone flutter 命令: git clone -b beta https://gith ...

- js中中括号,大括号使用详解

js中中括号,大括号使用详解 一.总结 一句话总结:{ } 是一个对象,[ ] 是一个数组 1.js大括号{}表示什么意思? 对象 { } 大括号,表示定义一个对象,大部分情况下要有成对的属性和值,或 ...

- 开发H5游戏引擎的选择:Egret或Laya?

开发H5游戏引擎的选择:Egret或Laya? 一.总结 一句话总结:选laya吧 二.开发H5游戏引擎的选择:Egret或Laya? 一.H5游戏开发的引擎介绍 开发H5游戏的引擎有很多,比如egr ...

- SpringMVC之ModelAndView的 jsp值在浏览页面不显示

Tomcat运行后浏览器上显示的结果! <%@ page isELIgnored="false" %>改变后问spring mvc开发过程中, 经常会给model ad ...