A RECURRENT NEURAL NETWORK WITHOUT CHAOS

本篇文章的介绍了一个非常简单的门限RNN(gated recurrent neural network),

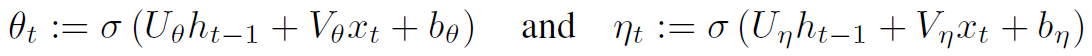

这里有两扇门horizontal/forget gate和vertical/input gate, 即

其中  (logistic sigmoid function)

(logistic sigmoid function)

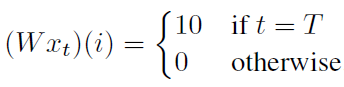

下面假设输入数据xt满足如下性质,

若隐层节点初始化为0, 即 ,则网络对脉冲xt的响应为,

,则网络对脉冲xt的响应为,

其中 衰减到0, forget gate

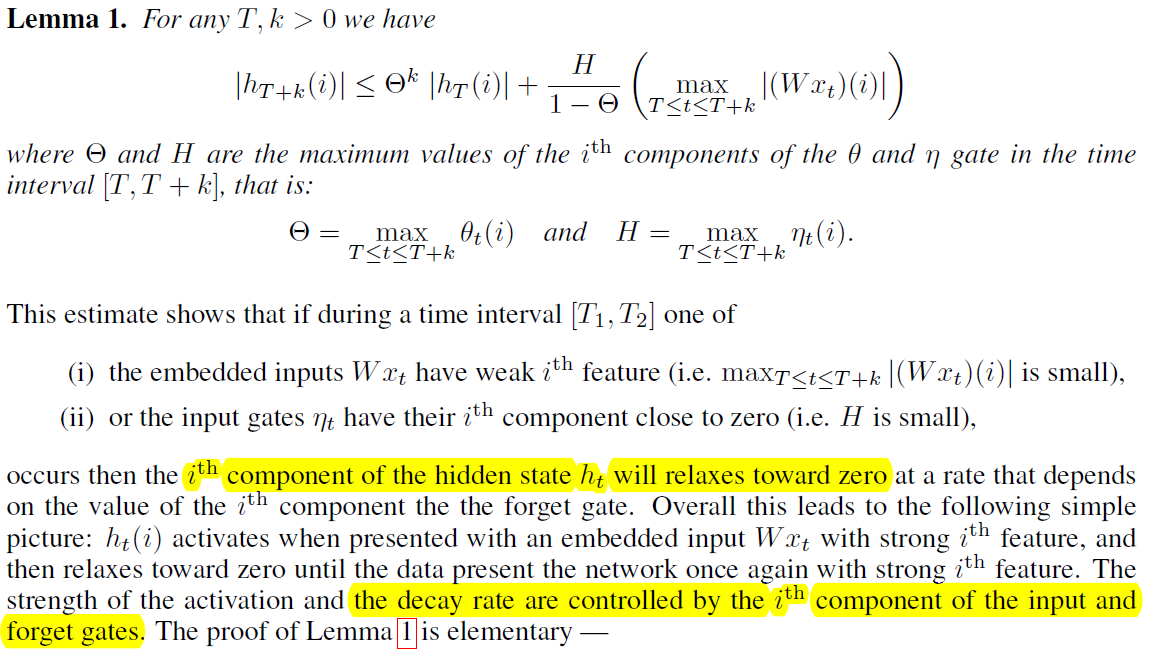

衰减到0, forget gate 控制了衰减速度,所以当隐层节点ht(i)遇到比较强的信号,ht(i)被激活,接着衰减到0,直到下一次再次被激活。

控制了衰减速度,所以当隐层节点ht(i)遇到比较强的信号,ht(i)被激活,接着衰减到0,直到下一次再次被激活。

zero input比较

本文的模型,只有一个吸引子, zero state, 但其它的模型,i.e., vanilla RNN, the LSTM and the GRU 具有混沌动力学行为。

接着文章想说明,这个没有混沌的RNN在word level language modeling task也能达到很好的效果,间接的说明混沌性质并不能解释这些模型在tasks上的成功。

CHAOS IN RECURRENT NEURAL NETWORKS

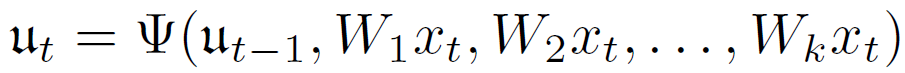

考虑下面的离散动力系统, 向量u属于Rd

形成的轨迹,会进入该系统的吸引子(不变集), 通常是分形的。

所有的RNN可以写成下面的形式

假设没有输入,则RNN可以诱导出相应的动力系统

从而刻画了产生复杂轨迹的能力。

如何才能出现上面的动力系统的行为呢?实际上是可以存在的,由于参数Wj是通过学习得到的,当遇到一个不怎么重要的数据点xt0,与隐层节点具有很弱的耦合性, 也就是说数据的影响不大, i.e., Wjxt0 ≈ 0,,就会在接下来的一段时间出现上述动力系统的行为,直到遇到一个非常重要的信号。

CHAOTIC BEHAVIOR OF LSTM AND GRU IN THE ABSENCE OF INPUT DATA

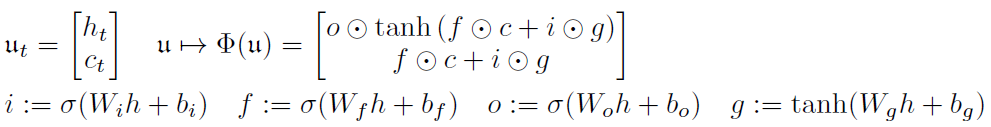

考虑下面LSTM诱导的动力系统,

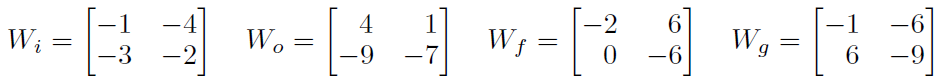

其中的参数具体为,

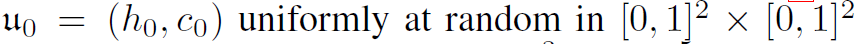

接着初始化隐层节点,

图1为具体的动力系统的展示, 图中的吸引子实质上是4维动力系统在2维上的投影。

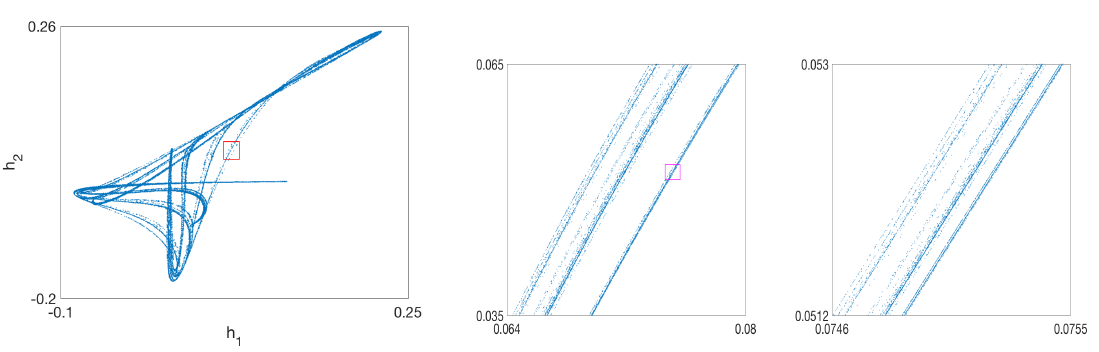

混沌动力系统具有初值敏感性,给定一个初始点,作者在[1e-7, 1e7]范围内进行扰动,跑200steps, 总共100,000次扰动。结果就是,第200步的点,几乎充满了整个吸引子。

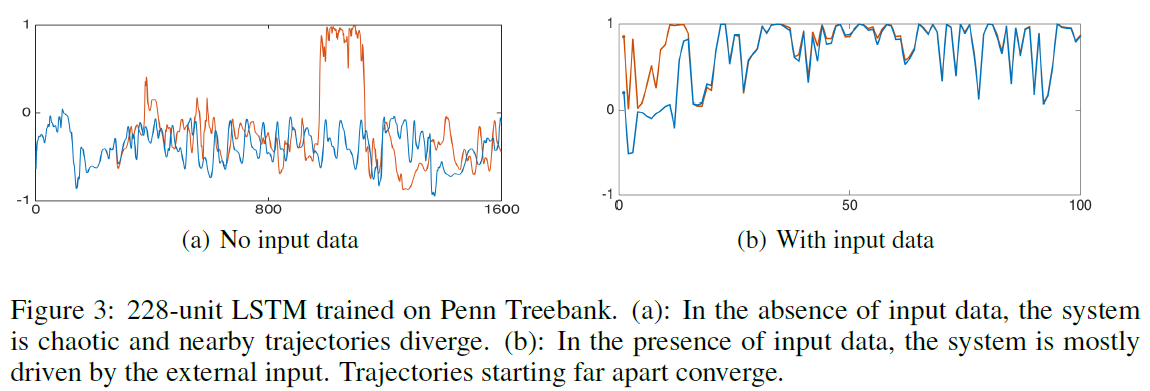

上面都是构造的例子,下面是作者在Penn Treebank corpus without dropout 训练好的LSTM,结果也出现混沌现象。当有初入的时候,就不再是一个自治的动力系统了,完全收到输入信号控制。

CHAOS-FREE BEHAVIOR OF THE CFN

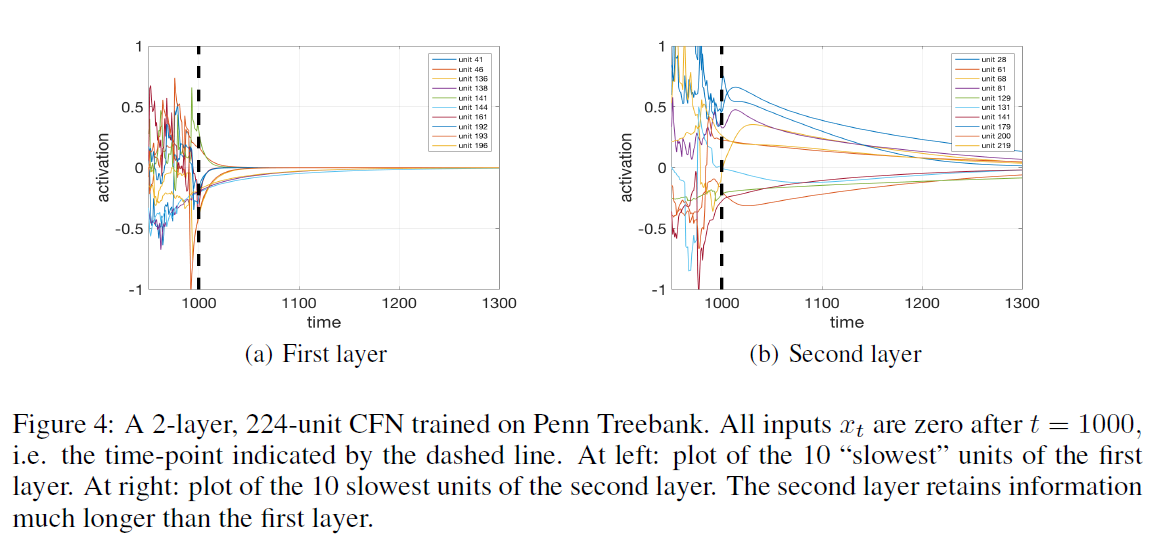

实验结果:高层的隐层节点的信号衰减慢

A RECURRENT NEURAL NETWORK WITHOUT CHAOS的更多相关文章

- Recurrent Neural Network系列1--RNN(循环神经网络)概述

作者:zhbzz2007 出处:http://www.cnblogs.com/zhbzz2007 欢迎转载,也请保留这段声明.谢谢! 本文翻译自 RECURRENT NEURAL NETWORKS T ...

- Recurrent Neural Network(循环神经网络)

Reference: Alex Graves的[Supervised Sequence Labelling with RecurrentNeural Networks] Alex是RNN最著名变种 ...

- Recurrent Neural Network系列2--利用Python,Theano实现RNN

作者:zhbzz2007 出处:http://www.cnblogs.com/zhbzz2007 欢迎转载,也请保留这段声明.谢谢! 本文翻译自 RECURRENT NEURAL NETWORKS T ...

- Recurrent Neural Network系列3--理解RNN的BPTT算法和梯度消失

作者:zhbzz2007 出处:http://www.cnblogs.com/zhbzz2007 欢迎转载,也请保留这段声明.谢谢! 这是RNN教程的第三部分. 在前面的教程中,我们从头实现了一个循环 ...

- Recurrent Neural Network系列4--利用Python,Theano实现GRU或LSTM

yi作者:zhbzz2007 出处:http://www.cnblogs.com/zhbzz2007 欢迎转载,也请保留这段声明.谢谢! 本文翻译自 RECURRENT NEURAL NETWORK ...

- 循环神经网络(Recurrent Neural Network,RNN)

为什么使用序列模型(sequence model)?标准的全连接神经网络(fully connected neural network)处理序列会有两个问题:1)全连接神经网络输入层和输出层长度固定, ...

- Recurrent Neural Network[Content]

下面的RNN,LSTM,GRU模型图来自这里 简单的综述 1. RNN 图1.1 标准RNN模型的结构 2. BiRNN 3. LSTM 图3.1 LSTM模型的结构 4. Clockwork RNN ...

- Recurrent Neural Network[survey]

0.引言 我们发现传统的(如前向网络等)非循环的NN都是假设样本之间无依赖关系(至少时间和顺序上是无依赖关系),而许多学习任务却都涉及到处理序列数据,如image captioning,speech ...

- 【NLP】Recurrent Neural Network and Language Models

0. Overview What is language models? A time series prediction problem. It assigns a probility to a s ...

随机推荐

- Linux 查找特定程序 whereis

Linux 查找特定程序 whereis whereis 命令主要用于查找程序文件,并提供这个文件的二进制可执行文件.源代码文件和使用手册存放位置. 1.查找命令程序 例如,查找 touch 命令 [ ...

- 配置文件 "G:\虚拟机列表\Linux001.vmx" 由产品 VMware 创建, 其版本 VMware Workstation 不兼容并且不能使用.

解析: 报这种错误一般是虚拟机文件里声明的VMware版本和真实的VMware版本不一致导致.我们可以手动更改真实VMware版本,或者更改虚拟机文件里声明的VMware版本.以下我们通过更该虚拟机文 ...

- 联想H430怎么清除cmos密码?

联想H430怎么清除cmos密码? 方法一:长时间对cmos放电 首先断掉主机电源,然后找到主板上的纽扣电池,将电池小心取出,然后使用一金属导体,短接电池座中的正负极,这样也可达到快速放电的目的. 有 ...

- MessageBox显示位置

假设存在2个窗口类CImDlg与CChatDlg,如果希望MessageBox跟随CChatDlg,方法是 CChatDlg *pDlg = xxx; pDlg->MessageBox();

- PTA(Basic Level)1058.A+B in Hogwarts

If you are a fan of Harry Potter, you would know the world of magic has its own currency system -- a ...

- 爬取糗事百科热门段子的数据并保存到本地,xpath的使用

和之前的爬虫类博客的爬取思路基本一致: 构造url_list,因为糗事百科的热门栏目默认是13页,所以这个就简单了 遍历发送请求获取响应 提取数据,这里用的是xpath提取,用的是Python的第三方 ...

- 自动生成ID

public class IdUtil { /** * * @return 返回时间id,类似于20191217195622 */ public static String timeId(){ Dat ...

- linux 下如何将网页版应用生成桌面图标

使用linux mint已经两年了,很多国民应用,都没有Linux版,但是这些应用都有网页版,今天就说下最简单的将网页应用变成桌面应用,无需配置,安装任何插件.以微信为例; 首先,在谷歌浏览器打开网页 ...

- windows系统下nginx+tomcat+redis做负载均衡和session粘滞附整套解决方案

Nginx: 在nginx-1.8.0\conf目录下找到nginx.conf文件,打开文件修改文件中http{}中的内容,在http{}中加入 upstream localhost { serve ...

- css中的position 的absolute和relative的区别(转)

我们先来看看CSS3 Api中对position属性的相关定义: static:无特殊定位,对象遵循正常文档流.top,right,bottom,left等属性不会被应用. relative:对象遵循 ...