时空图神经网路:STGNNs

STGNNs:SPATIAL–TEMPORAL GRAPH NEURAL NETWORKS

许多实际应用中的图在图结构和图输入方面都是动态的。STGNNs在捕获图的动态性方面占有重要地位。

这类方法的目的是建模动态节点输入,同时假设连接节点之间的相互依赖性。STGNNs同时捕获一个图的空间和时间依赖性。

STGNNs的任务可以是预测未来节点值或标签或预测时空图标签。

For example, a traffic network consists of speed sensors placed on roads, where edge weights are determined by the distance between pairs of sensors. As the traffic condition of one road may depend on its adjacent roads’ conditions, it is necessary to consider spatial dependence when performing traffic speed forecasting. As a solution, STGNNs capture spatial and temporal dependencies of a graph simultaneously.

STGNNs 分为两个方向:

1)RNN-based methods

大多数基于RNN的方法通过:使用图卷积传递到递归单元, 过滤输入和隐藏状态来捕获时空依赖性

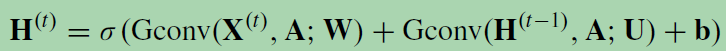

a simple RNN takes the form:

X(t): Rn×d is the node feature matrix at time step t. After inserting graph convolution, it becomes

Gconv(·) is a graph convolutional layer.

相关工作:

1): Graph convolutional recurrent network (GCRN) combines an LSTM network with ChebNet.

2): Diffusion convolutional RNN (DCRNN) incorporates a proposed diffusion graph convolutional layer into a GRU network. Besides, DCRNN adopts an encoder-decoder framework to predict the future K steps of node values.

3): Structural-RNN proposes a recurrent framework to predict node labels at each time step. It comprises two kinds of RNNs, namely, a node-RNN and an edge-RNN. The temporal information of each node and each edge is passed through a node-RNN and an edge-RNN, respectively. To incorporate the spatial information, a node-RNN takes the outputs of edge-RNNs as inputs. Since assuming different RNNs for different nodes and edges significantly increases model complexity, it instead splits nodes and edges into semantic groups. Nodes or edges in the same semantic group share the same RNN model, which saves the computational cost.

RNN-based approaches suffer from time-consuming iterative propagation and gradient explosion/vanishing issues.

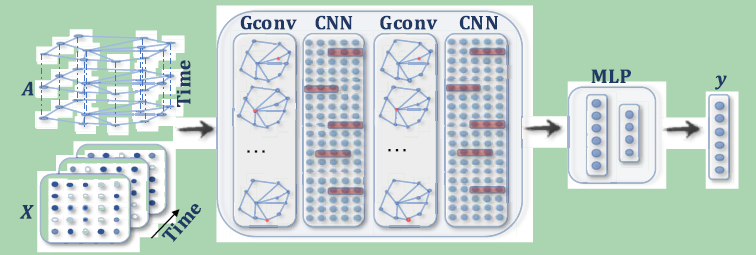

2)CNN-based methods

CNN-based approaches tackle spatial-temporal graphs in a nonrecursive manner with the advantages of parallel computing, stable gradients, and low-memory requirements.

CNN-based approaches interleave 1-D-CNN layers with graph convolutional layers to learn temporal and spatial dependencies, respectively.

Assume that the inputs to an STGNN are a tensor X: RT×n×d and the 1-D-CNN layer slides over X[:, i, :] along the time axis to aggregate temporal information for each

node, while the graph convolutional layer operates on X[i,:,:] to aggregate spatial information at each time step.

以前的方法都使用预定义的图结构。它们假设预定义的图结构反映了节点之间真实的依赖关系。然而,在时空设置中有许多图形数据的快照,可以从数据中自动学习潜在的静态图形结构。

学习潜在静态空间依赖可以帮助研究者发现网络中不同实体之间可解释且稳定的相关性。但是,在某些情况下,学习潜在的动态空间依赖关系可以进一步提高模型的精度。

GaAN employs attention mechanisms to learn dynamic spatial dependencies through an RNN-based approach. An attention function is used to update the edge weight between two connected nodes given their current node inputs.

ASTGCN further includes a spatial attention function and a temporal attention function to learn latent dynamic spatial dependencies and temporal dependencies through a CNN-based approach.

ASTGCN还包括一个空间注意函数和一个时间注意函数,用于通过基于cnn的方法学习潜在的动态空间依赖和时间依赖。

The common drawback of learning latent spatial dependencies is that it needs to calculate the spatial dependence weight between each pair of nodes, which costs O(n2).

Dynamic Graph Convolutional Networks:(2017)

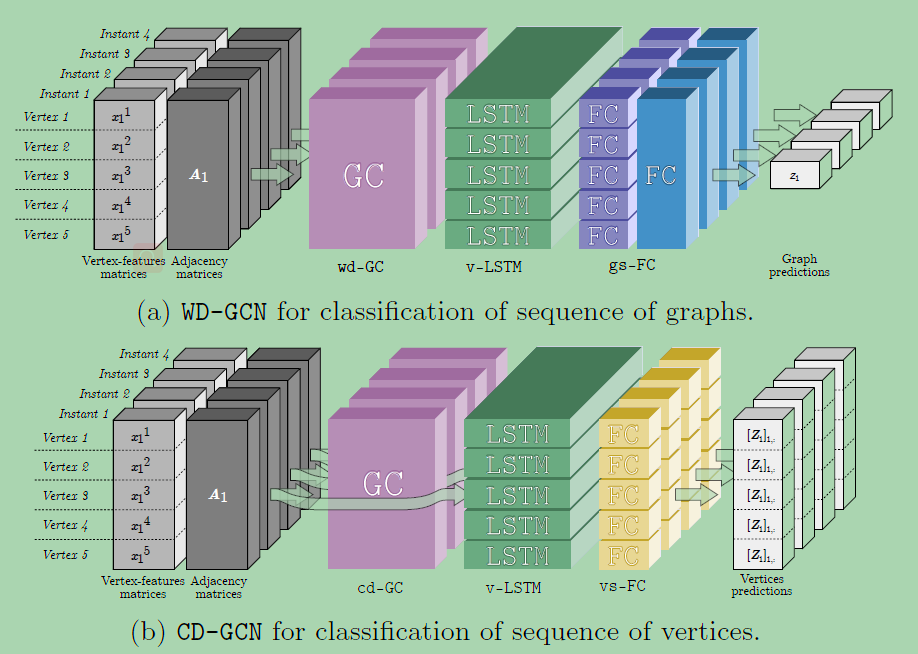

Many different classification tasks need to manage structured data, which are usually modeled as graphs. Moreover, these graphs can be dynamic, meaning that the vertices/edges of each graph may change during time. Our goal is to jointly exploit structured data and temporal information through the use of a neural network model.

许多不同的分类任务需要管理结构化数据,这些数据通常建模为图。此外,这些图可以是动态的,这意味着每个图的顶点/边可能在一段时间内改变。我们的目标是通过使用神经网络模型联合利用结构化数据和时间信息。

this paper proposes two novel approaches, which combine Long Short-Term Memory networks and Graph Convolutional Networks to learn long short-term dependencies together with graph structure.

本文提出了两种新的方法,即结合长短期记忆网络和图卷积网络来学习长短期依赖关系和图结构。

However, many real-world structured data are dynamic and nodes/edges in the graphs may change during time. In such a dynamic scenario, temporal information can also play an important role.

然而,许多真实世界的结构化数据是动态的,图中的节点/边可能会随着时间的推移而改变. 在这种动态场景中,时间信息也可以发挥重要作用。

the new network architectures proposed in this paper will work on ordered sequences of graphs and ordered sequences of vertex features.

时空图神经网路:STGNNs的更多相关文章

- 人工智能起步-反向回馈神经网路算法(BP算法)

人工智能分为强人工,弱人工. 弱人工智能就包括我们常用的语音识别,图像识别等,或者为了某一个固定目标实现的人工算法,如:下围棋,游戏的AI,聊天机器人,阿尔法狗等. 强人工智能目前只是一个幻想,就是自 ...

- 神经网路的层数,损失函数(loss)

神经网络的复杂度:可用神经网络的层数和神经网络中待优化参数个数表示 神经网路的层数:一般不计入输入层,层数 = n 个隐藏层 + 1 个输出层 神经网路待优化的参数:神经网络中所有参数 w 的个数 + ...

- tensorflow学习之路-----简单卷积神经网路

import tensorflow as tf#取数据,目的是辨别数字from tensorflow.examples.tutorials.mnist import input_data'''手动添加 ...

- 神经网路-SGD-1

SGD神经网络以及python中实现 1.SGD(stochastic gradient descend):<1>数据抽取:<2>计算梯度;<3>参数更新:< ...

- tensorflow学习2-线性拟合和神经网路拟合

线性拟合的思路: 线性拟合代码: import tensorflow as tf import numpy as np import matplotlib.pyplot as plt #%%图形绘制 ...

- 可视化CNN神经网路第一层参数

在上Andrew Ng的课的时候搜集到了课程里面自带的显示NN参数的代码,但是只能显示灰度图,而且NN里的参数没有通道的概念.所以想要获得可视化CNN的参数,并且达到彩色的效果就不行了. 所以就自己写 ...

- 神经网络模型之AlexNet的一些总结

说明: 这个属于个人的一些理解,有错误的地方,还希望给予教育哈- 此处以caffe官方提供的AlexNet为例. 目录: 1.背景 2.框架介绍 3.步骤详细说明 5.参考文献 背景: AlexNet ...

- np2016课程总结

林牧 SA16222166 课程目标 课程安排 A1a A2 A3 项目集成 环境搭建 其他方面的收获 本课心得 课程目标 通过实现一个医学辅助诊断的专家系统原型,具体为实现对血常规检测报告OCR识别 ...

- Stanford机器学习笔记-6. 学习模型的评估和选择

6. 学习模型的评估与选择 Content 6. 学习模型的评估与选择 6.1 如何调试学习算法 6.2 评估假设函数(Evaluating a hypothesis) 6.3 模型选择与训练/验证/ ...

随机推荐

- Fauce:Fast and Accurate Deep Ensembles with Uncertainty for Cardinality Estimation 论文解读(VLDB 2021)

Fauce:Fast and Accurate Deep Ensembles with Uncertainty for Cardinality Estimation 论文解读(VLDB 2021) 本 ...

- 设置 Visual Studio 总是以管理员身份运行

话不多说直接上干货 第一步: 打开 Visual Studio 的安装目录,找到 devenv.exe,然后右键快捷菜单选择"兼容性疑难解答". 第二步: 选择故障排查选项 疑难解 ...

- Linux网络重点知识总结性梳理

一个执着于技术的公众号 1 OSI七层模型 层次 说明 功能/协议 应用层 应用程序及接口 提供应用程序的接口:FTP telnet http pop3等 表示层 对数据进行转换.加密和压缩 将上层的 ...

- 打造一款高逼格的Vim神器

点击上方"开源Linux",选择"设为星标" 回复"学习"获取独家整理的学习资料! 作者:枫上雾棋 链接:https://segmentfa ...

- 2021 CSP-J复赛 我的备战与游记

目录 备战 2021.10.18 2021.10.19 2021.10.20 2021.10.21 2021.10.22 比赛当日 早上 线下见面 正文 比赛后 赛后总结与讲解 简单总结 Candy ...

- OPRF

在PSI中经常用到OPRF技术,现在系统学习一下. PRF Pseudo Random Function,伪随机函数,主要就是用来产生为伪随机数的. 伪随机数 什么伪随机数? 伪随机数是用确定性的算法 ...

- 强制20天加班开发app后被集体解雇,象寻技术负责人公众号发文怒斥前领导

5月16日下午三点,象寻官方公众号发了一篇<祝象寻早日倒闭的文章>文章,文章配一个竖中指的手势.如此劲爆的文章瞬间引爆了微信朋友圈,大家纷纷分享给好友和微信群,阅读量也达到了十万+. 当时 ...

- WTF表单验证

WTF表单验证可分为3个步骤: ①导入wtf扩展提供的表单验证器.(from wtforms.validators import DataRequired,EqualTo) ②定义表单类 # 定义表单 ...

- 以圆类 Circle 及立体图形类 Solid 为基础设计圆锥类 Cone

学习内容:以圆类 Circle 及立体图形类 Solid 为基础设计圆锥类 Cone 代码示例: import java.util.Scanner; class Point4{ private dou ...

- script标签crossorigin属性及同源策略和跨域方法

首先介绍(同源策略) 同源策略是浏览器最核心且基本的安全约定,要求协议.域名.端口都相同为同源,如果非同源时请求数据浏览器会在控制台抛出跨域异常错误,同源策略是浏览器的行为,即使客户端请求发送了,服务 ...