base64解析爬取糗百

一、缘由

这是我之前刚开始学习的时候爬取糗百的练习内容,主要练习的是bs64解析。虽然现在用的不是特别的多,但是当初的时候用起来还是非常的顺手的。

二、代码实现

#coding:utf-8 import requests

from bs4 import BeautifulSoup def download_page(url):

headers={

'User - Agent':"Mozilla / 5.0(Windows NT 10.0; WOW64) AppleWebKit / 537.36(KHTML, like Gecko) Chrome / 86.0.4240.198 Safari / 537.36"

} #模拟请求登录

r=requests.get(url,headers=headers)

return r.text def get_content(html,page):

output='''第{}页 作者:{}性别:{}年龄:{}点赞:{}\n{}\n----------\n\n'''

soup=BeautifulSoup(html,'html.parser')

con=soup.find('div',id='content')

con_list=con.find_all('div',class_='article')

for i in con_list:

# hot_comments = i.find('div', class_='main-text').get_text() # 获取热评

vote = i.find('i', class_='number').string # 点赞数

author=i.find('h2').string #获得作者的名字

content=i.find('div',class_='content').find('span').get_text() #获取内容

author_info=i.find('div',class_='artciGender') #获取性别,年龄等

if author_info is not None:

class_list=author_info['class']

if 'womenIcon' in class_list:

gender='女'

elif 'manIcon' in class_list:

gender='男'

else:

gender=''

age=author_info.string

else:

gender=''

age=''

save_txt(output.format(page,author,gender,age,vote,content,))#hot_comments def save_txt(*args):

for i in args:

with open('qiubai.txt','a',encoding='utf-8') as f:

f.write(i)

print(i) def main():

for i in range(1,14):

url=f'''https://www.qiushibaike.com/text/page/{i}/'''

html=download_page(url)

get_content(html, i) if __name__ == '__main__':

main()

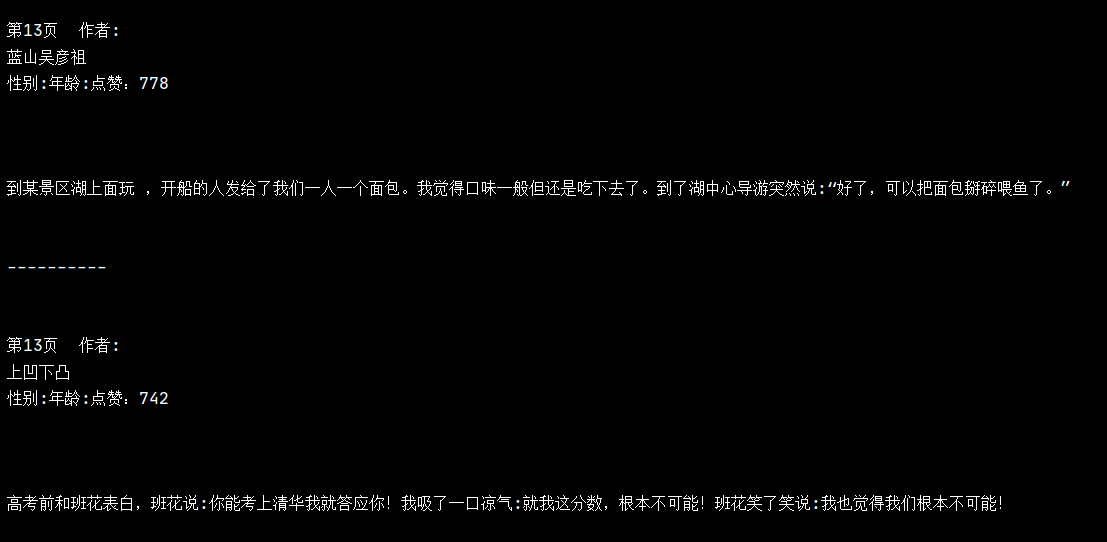

三、效果展示

base64解析爬取糗百的更多相关文章

- Python 爬虫入门(一)——爬取糗百

爬取糗百内容 GitHub 代码地址https://github.com/injetlee/Python/blob/master/qiubai_crawer.py 微信公众号:[智能制造专栏],欢迎关 ...

- Java - XPath解析爬取内容

code { margin: 0; padding: 0; white-space: pre; border: none; background: transparent; } pre { backg ...

- Beautifulsoup网页解析——爬取豆瓣排行榜分类接口

我们在网页爬取的过程中,会通过requests成功的获取到所需要的信息,而且,在返回的网页信息中,也是通过HTML代码的形式进行展示的.HTML代码都是通过固定的标签组合来实现页面信息的展示,所以,最 ...

- BS4爬取糗百

-- coding: cp936 -- import urllib,urllib2 from bs4 import BeautifulSoup user_agent='Mozilla/5.0 (Win ...

- python爬取糗百第一页的笑话

自学python网络爬虫,发现request比urllib还是要好用一些,因此利用request和BeautifulSoup来实现糗百的首页笑话的抓取.BeautifulSoup通过find和find ...

- 爬虫实例之使用requests和Beautifusoup爬取糗百热门用户信息

这次主要用requests库和Beautifusoup库来实现对糗百的热门帖子的用户信息的收集,由于糗百的反爬虫不是很严格,也不需要先登录才能获取数据,所以较简单. 思路,先请求首页的热门帖子获得用户 ...

- python爬取糗百内容

#-*- coding: utf-8 -*- import urllib import urllib2 import re #页面为1 page=1 url='http://www.qiushibai ...

- 接着上次的python爬虫,今天进阶一哈,局部解析爬取网页数据

*解析网页数据的仓库 用Beatifulsoup基于lxml包lxml包基于html和xml的标记语言的解析包.可以去解析网页的内容,把我们想要的提取出来. 第一步.导入两个包,项目中必须包含beau ...

- 全栈爬取-Scrapy框架(CrawlSpider)

引入 提问:如果想要通过爬虫程序去爬取”糗百“全站数据新闻数据的话,有几种实现方法? 方法一:基于Scrapy框架中的Spider的递归爬取进行实现(Request模块递归回调parse方法). 方法 ...

- scrapy框架基于CrawlSpider的全站数据爬取

引入 提问:如果想要通过爬虫程序去爬取”糗百“全站数据新闻数据的话,有几种实现方法? 方法一:基于Scrapy框架中的Spider的递归爬取进行实现(Request模块递归回调parse方法). 方法 ...

随机推荐

- Ceph 有关知识简介

Ceph 存储集群至少需要一个 Ceph Monitor 和两个 OSD 守护进程.而运行 Ceph 文件系统客户端时,则必须要有元数据服务器( Metadata Server ). Ceph OSD ...

- KVM 下如何关闭 virbr0

安装KVM 后都会发现网络接口里多了一个叫做 virbr0 的虚拟网络接口: 这是由于安装和启用了 libvirt 服务后生成的,libvirt 在服务器(host)上生成一个 virtual net ...

- .NET6 使用 AutoMapper (解析)

一.Net 6环境下的.net core项目里如何使用AutoMapper实现依赖注入. 注: AutoMapper 是一个对象-对象映射器,可以将一个对象映射到另一个对象. 第一步,在Nuget引入 ...

- CentOS 7.9 安装 redis-6.2.0

一.CentOS 7.9 安装 redis-6.2.0 1 下载地址:https://download.redis.io/releases/redis-6.2.0.tar.gz 2 安装gcc来进行编 ...

- .Net CLR GC plan_phase二叉树和Brick_table

楔子 别那么懒,勤快点.以下取自CLR PreView 7.0. 主题 GC计划阶段(plan_phase)主要就两个部分,一个是堆里面的对象构建一颗二叉树(这颗二叉树的每个节点包含了诸如对象移动信息 ...

- IDEA 调试起来太费劲?你需要了解这几招!

各位好啊,我是会编程的蜗牛,我们在使用IDEA开发java项目时,经常需要用到IDEA的调试功能,不过平时我们用的调试方法可能过于简单了,其实IDEA还给我们提供了非常强大的调试功能,下面让我来看一看 ...

- Oracle安装和卸载

Oracle安装: 1. 检查是否安装net framework 3.5 2. 安装win64_11gR2_database服务端 更改安装目录,设置密码 2. 检查服务 services.msc,两 ...

- 齐博x1where 标签动态变量查询/where 实现条件筛选与数据关联

大家可能对union参数不太习惯的话,也可以用where语句加入动态变量查询,比如 where="fid=$fid&uid=$info[uid]&pid>=$info. ...

- 鹅长微服务发现与治理巨作PolarisMesh实践-上

@ 目录 概述 定义 核心功能 组件和生态 特色亮点 解决哪些问题 官方性能数据 架构原理 资源模型 服务治理 基本原理 服务注册 服务发现 安装 部署架构 集群安装 SpringCloud应用接入 ...

- 使用GitHub Actions实现自动化部署

前言 大家在工作中想必都是通过自动化部署来进行前端项目的部署的,也就是我们在开发完某个需求时,我们只需要将代码推送到某个分支,然后就能自动完成部署,我们一般不用关心项目是如何build以及如何depl ...