小爬爬7:回顾&&crawlSpider

1.回顾昨日内容

回顾

- 全站数据爬取(分页)

- 手动请求的发送Request(url,callback)

- post请求和cookie处理

- start_requests(self)

- FromRequest(url,callback,formdata)

- cookie操作是自动处理 - 请求传参

- 使用场景:

- 实现:scrapy.Request(url,callback,meta={'':''})

callback:response.meta['']

- 中间件

- 下载中间件:批量拦截所有的请求和响应

- 拦截请求:UA伪装(process_request),代理ip(process_exception:return request)

- 拦截响应:process_response

2.crawl总结

- CrawlSpider

作用:就是用于进行全站数据的爬取

- CrawlSpider就是Spider的一个子类

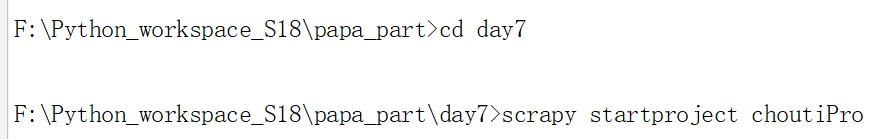

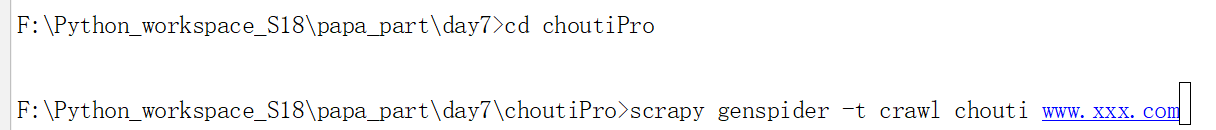

- 如何新建一个基于CrawlSpider的爬虫文件

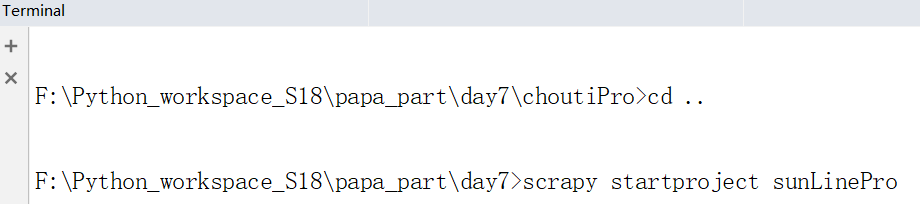

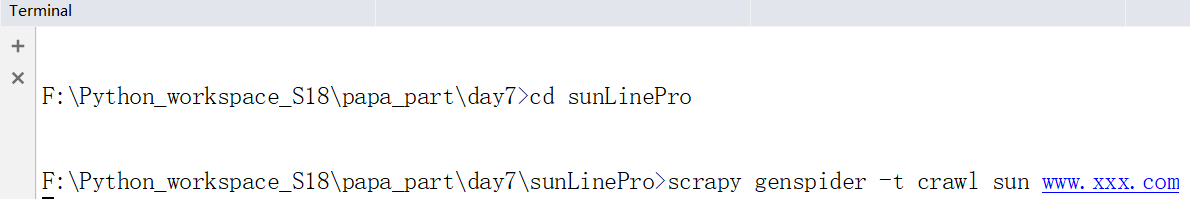

- scrapy genspider -t crawl xxx www.xxx.com

- LinkExtractor连接提取器:根据指定规则(正则)进行连接的提取

- Rule规则解析器:将链接提取器提取到的链接进行请求发送,然后对获取的页面数据进行

指定规则(callback)的解析

- 一个链接提取器对应唯一一个规则解析器

3.高效的全栈数据爬取

新建一个抽屉的项目,我们对其进行全栈数据的爬取

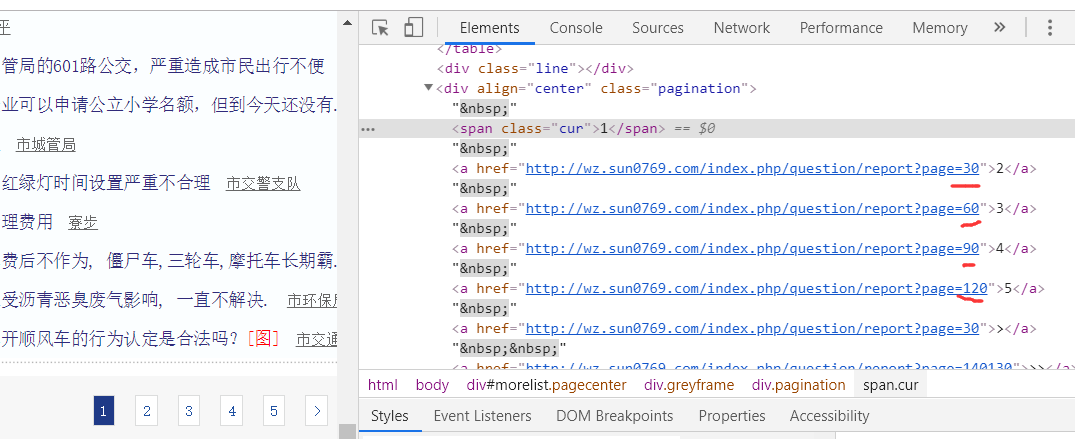

下图是页码对应的url

# -*- coding: utf- -*-

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders import CrawlSpider, Rule class ChoutiSpider(CrawlSpider):

name = 'chouti'

# allowed_domains = ['www.xxx.com']

#抽屉的第一页链接

start_urls = ['https://dig.chouti.com/all/hot/recent/1']

#全栈数据爬取是将所有页码依次请求发送

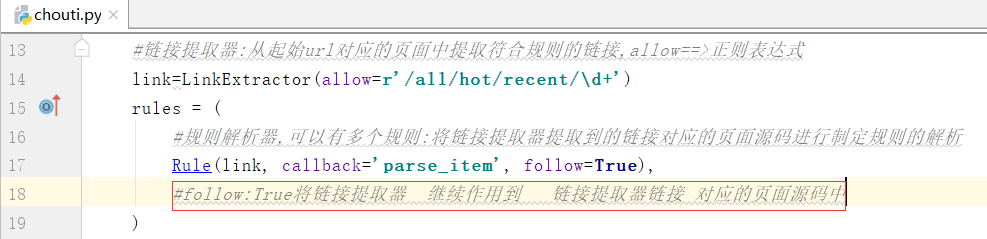

#链接提取器:从起始url对应的页面中提取符合规则的链接,allow==>正则表达式

link=LinkExtractor(allow=r'/all/hot/recent/\d+')

rules = (

#规则解析器,可以有多个规则:将链接提取器提取到的链接对应的页面源码进行制定规则的解析

Rule(link, callback='parse_item', follow=False),

) def parse_item(self, response):

# item = {}

#item['domain_id'] = response.xpath('//input[@id="sid"]/@value').get()

#item['name'] = response.xpath('//div[@id="name"]').get()

#item['description'] = response.xpath('//div[@id="description"]').get()

# return item

print(response)

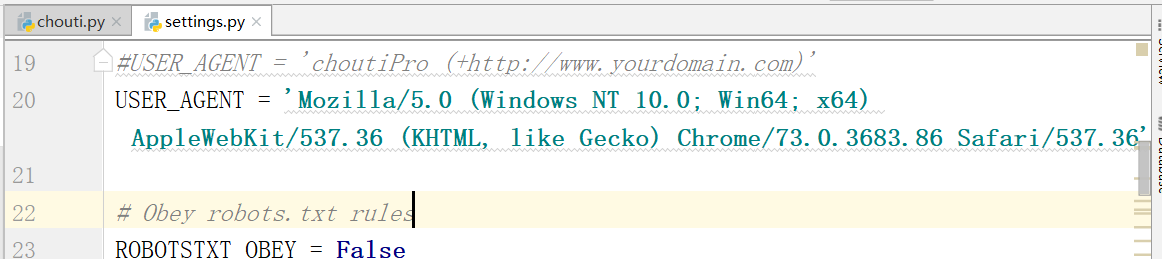

修改下面的内容:

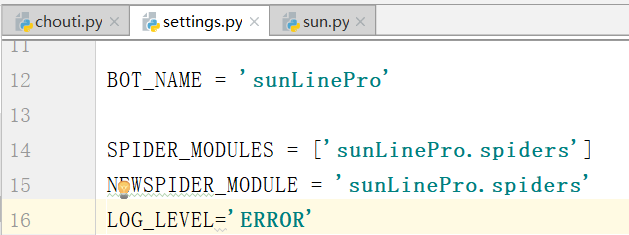

LOG_LEVEL='ERROR'

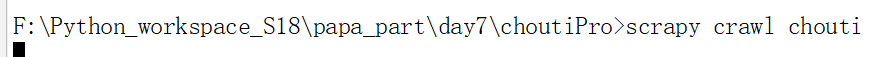

下面我们提取指定的规则执行下面的命令:

运行之后,我们只是爬取到了10条数据

我们需要将最后一个界面作为起始,也就是follow=True就可以了

再次运行下面的命令:

运行上边的命令,我们就成功取到120页的数据.

自己理解这句话:

follow:True将链接提取器继续作用到链接提取器链接对应的页面源码中,

新的需求:

4.crawlSpider深度爬取

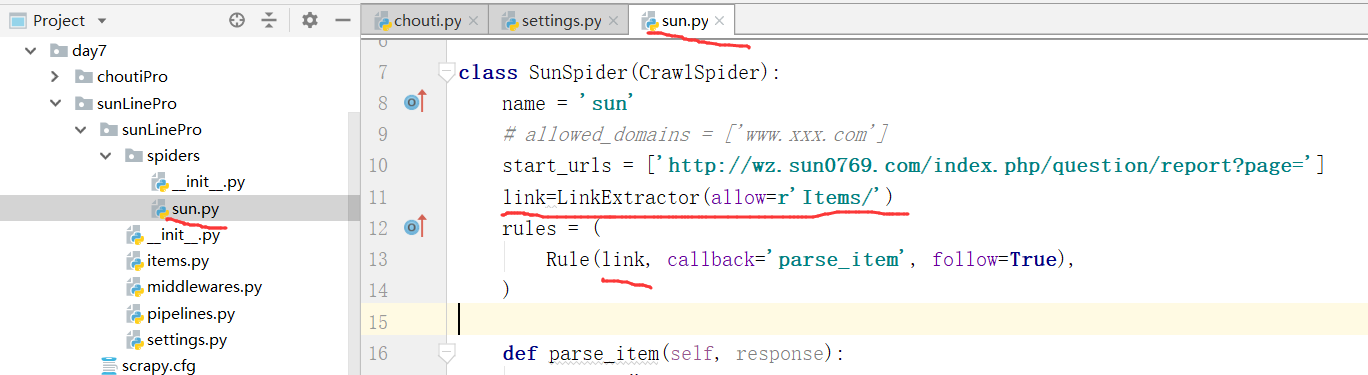

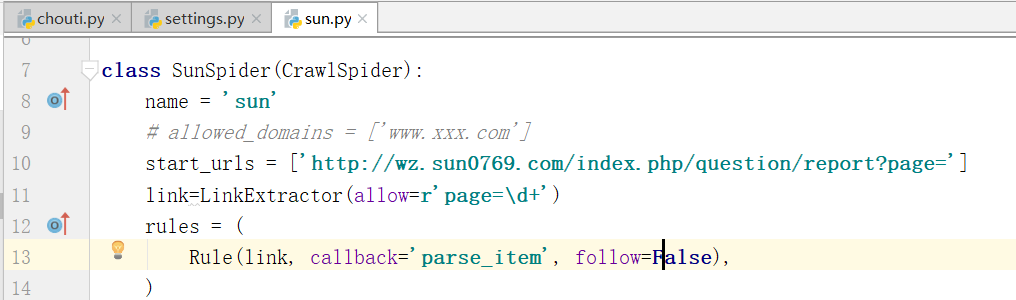

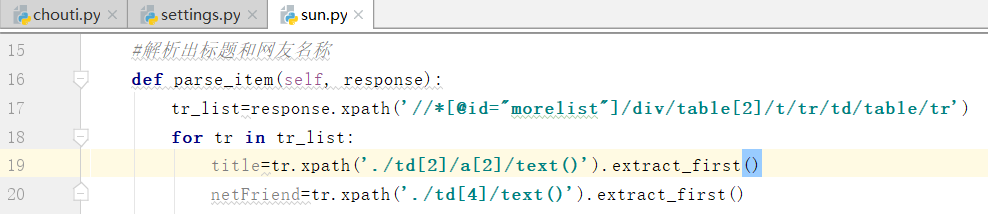

案例:阳光热线,我们解析出首页的对应"标题"和详情页中的"段落"

2个链接提取器和2和规则解析器

(1)下面第一步,我们需要新建一个工程

添加UA和修改robot协议为false

注释allowed_domains,并且将起始url写在start_urls里边

阳光热线的第一页:http://wz.sun0769.com/index.php/question/report?page=

看一下,我们如何取到源码的链接:

我们看到的是页码中的数据是30的倍数,对比我们看到了这个发生了变化

修改follow=False,只爬取前五页,原因是数据量太大

我们需要拿到table的xpath解析,注意要修改tbody,再拿到下面的tr

执行程序

小爬爬7:回顾&&crawlSpider的更多相关文章

- ELK之开心小爬爬

1.开心小爬爬 在爬取之前需要先安装requests模块和BeautifulSoup这两个模块 ''' https://www.autohome.com.cn/all/ 爬取图片和链接 写入数据库里边 ...

- 小爬爬6.scrapy回顾和手动请求发送

1.数据结构回顾 #栈def push(self,item) def pop(self) #队列 def enqueue(self,item) def dequeue(self) #列表 def ad ...

- 小爬爬5:重点回顾&&移动端数据爬取1

1. ()什么是selenium - 基于浏览器自动化的一个模块 ()在爬虫中为什么使用selenium及其和爬虫之间的关联 - 可以便捷的获取动态加载的数据 - 实现模拟登陆 ()列举常见的sele ...

- java小知识点简单回顾

1.java的数据类型分为两种:简单类型和引用类型(数组.类以及接口).注意,java没有指针的说法,只有引用.简单类型的变量被声明时,存储空间也同时被分配:而引用类型声明变量(对象)时,仅仅为其分配 ...

- 小爬爬5:scrapy介绍3持久化存储

一.两种持久化存储的方式 1.基于终端指令的吃持久化存储: 特点:终端指令的持久化存储,只可以将parse方法的返回值存储到磁盘文件 因此我们需要将上一篇文章中的author和content作为返回值 ...

- 小爬爬4:12306自动登录&&pyppeteer基本使用

超级鹰(更简单的操作验证) - 超级鹰 - 注册:普通用户 - 登陆: - 创建一个软件(id) - 下载示例代码 1.12306自动登录 # Author: studybrother sun fro ...

- 小爬爬1:jupyter简单使用&&爬虫相关概念

1.jupyter的基本使用方式 两种模式:code和markdown (1)code模式可以直接编写py代码 (2)markdown可以直接进行样式的指定 (3)双击可以重新进行编辑 (4)快捷键总 ...

- 小爬爬5:scrapy介绍2

1.scrapy:爬虫框架 -框架:集成了很多功能且具有很强通用性的一个项目模板 -如何学习框架:(重点:知道有哪些模块,会用就行) -学习框架的功能模板的具体使用. 功能:(1)异步爬取(自带buf ...

- 小爬爬6: 网易新闻scrapy+selenium的爬取

1.https://news.163.com/ 国内国际,军事航空,无人机都是动态加载的,先不管其他我们最后再搞中间件 2. 我们可以查看到"国内"等板块的位置 新建一个项目,创建 ...

随机推荐

- HBase 三维模型解析

总结下一直想写hbase的实践经验,在用hbase的过程中,我们都知道,rowkey设计的好坏,是我们能最大发挥hbase的架构优势,也是我们是否正确理解hbase的一个关键点.闲话少说,进入正题. ...

- Leetcode153. Find Minimum in Rotated Sorted Array寻找旋转排序数组中最小值

假设按照升序排序的数组在预先未知的某个点上进行了旋转. ( 例如,数组 [0,1,2,4,5,6,7] 可能变为 [4,5,6,7,0,1,2] ). 请找出其中最小的元素. 你可以假设数组中不存在重 ...

- 未加星标 Linux磁盘下查看I/O磁盘的性能

iostat查看linux硬盘IO性能 rrqm/s:每秒进行merge的读操作数目.即delta(rmerge)/s wrqm/s:每秒进行merge的写操作数目.即delta(wmerge)/s ...

- 如何处理HTML5新标签的浏览器兼容问题?

方法一 : 1.使用静态资源的html5shiv包 <!--[if lt IE9]> <script src="http://cdn.static.runoob.com/l ...

- apk反编译(6)用ProGuard 混淆、压缩代码,压缩资源。

1.android官方文档 https://developer.android.com/studio/build/shrink-code 主要内容如下: 1.1 压缩代码 混淆生成的文件:<m ...

- JavaScript如何实现字符串拼接操作

实际应用中,目标字符串的生成可能需要多个数据的拼接. 由于应用频繁,几乎是所有编程语言都必须掌握的操作,当然每种语言具有各自特点. 本文将通过代码实例详细介绍一下JavaScript如何实现字符串拼接 ...

- mybatis深入理解(八)-----关联表查询

一.一对一关联 1.1.提出需求 根据班级id查询班级信息(带老师的信息) 1.2.创建表和数据 创建一张教师表和班级表,这里我们假设一个老师只负责教一个班,那么老师和班级之间的关系就是一种一对一的关 ...

- 利用HttpWebRequest通过POST Json数据在.net后台实现不同平台间的数据传输

/// <summary> /// 返回JSon数据 /// </summary> /// <param name="JSONData">要处理 ...

- jodatime 计算时间差_统计程序运行耗时

https://blog.csdn.net/De_Moivre/article/details/79775661 记录开始执行的时间 DateTime startDateTime=new DateTi ...

- GIT → 04:Git与代码托管平台

4.1 Git 与 GitHub比较 Git 是一个版本管理工具 , 只在本地使用的一个版本管理工具,其作用就是可以让你更好的管理你的程序,比如你原来提交过的内容,后面虽然修改过,但是通过git这个工 ...