机器学习实战 - python3 学习笔记(一) - k近邻算法

一. 使用k近邻算法改进约会网站的配对效果

k-近邻算法的一般流程:

- 收集数据:可以使用爬虫进行数据的收集,也可以使用第三方提供的免费或收费的数据。一般来讲,数据放在txt文本文件中,按照一定的格式进行存储,便于解析及处理。

- 准备数据:使用Python解析、预处理数据。

- 分析数据:可以使用很多方法对数据进行分析,例如使用Matplotlib将数据可视化。

- 测试算法:计算错误率。

- 使用算法:错误率在可接受范围内,就可以运行k-近邻算法进行分类。

实战内容:

海伦女士一直使用在线约会网站寻找适合自己的约会对象。尽管约会网站会推荐不同的任选,但她并不是喜欢每一个人。经过一番总结,她发现自己交往过的人可以进行如下分类:

- 不喜欢的人

- 魅力一般的人

- 极具魅力的人

海伦收集约会数据已经有了一段时间,她把这些数据存放在文本文件datingTestSet.txt中,每个样本数据占据一行,总共有1000行。

海伦收集的样本数据主要包含以下3种特征:

- 每年获得的飞行常客里程数

- 玩视频游戏所消耗时间百分比

- 每周消费的冰淇淋公升数

完整代码:

import numpy as np

import operator

import matplotlib

import matplotlib.pyplot as plt def classify0(inX, dataSet, labels, k):

'''距离计算'''

dataSetSize = dataSet.shape[0]

diffMat = np.tile(inX, (dataSetSize, 1)) - dataSet

sqDiffMat = diffMat ** 2

sqDistances = sqDiffMat.sum(axis=1)

distances = sqDistances ** 0.5

sortedDistIndicies = distances.argsort()

classCount = {}

'''选择距离最小的k个点'''

for i in range(k):

voteIlabel = labels[sortedDistIndicies[i]]

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1

'''排序'''

sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True)

return sortedClassCount[0][0] def file2matrix(filename):

fr = open(filename) # 打开文件

arrayOfLines = fr.readlines() # 读取文件所有内容

numberOfLines = len(arrayOfLines) # 返回文件的行数

returnMat = np.zeros((numberOfLines, 3))

classLabelVector = []

index = 0

for line in arrayOfLines:

line = line.strip()

listFromLine = line.split('\t')

returnMat[index, :] = listFromLine[0:3]

# 根据文本中标记的喜欢的程度进行分类,1代表不喜欢,2代表魅力一般,3代表极具魅力

if listFromLine[-1] == 'didntLike':

classLabelVector.append(1)

elif listFromLine[-1] == 'smallDoses':

classLabelVector.append(2)

elif listFromLine[-1] == 'largeDoses':

classLabelVector.append(3)

index += 1

return returnMat, classLabelVector datingDataMat, datingLabels = file2matrix('datingTestSet.txt') fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(datingDataMat[:, 1], datingDataMat[:, 2], 15.0 * np.array(datingLabels), 15.0 * np.array(datingLabels))

plt.show() def autoNorm(dataSet):

'''归一化特征值:利用公式 newValue = (oldValue - min) / (max - min), 这个公式可以将任意取值范围的特征值转化为0到1区间的值'''

normDataSet = np.zeros(np.shape(dataSet))

m = dataSet.shape[0] minVals = dataSet.min(0) # min(0) 表示返回矩阵中所有列的最小值,当min(1)时,则返回矩阵中所有行的最小值

maxVals = dataSet.max(0)

ranges = maxVals - minVals normDataSet = dataSet - np.tile(minVals, (m, 1))

normDataSet = normDataSet / np.tile(ranges, (m, 1))

return normDataSet, ranges, minVals

normMat, ranges, minVals = autoNorm(datingDataMat) def datingClassTest():

hoRatio = 0.10 # 取所有数据的百分之10 filename = 'datingTestSet.txt'

datingDataMat, datingLabels = file2matrix(filename)

normMat, ranges, minVals = autoNorm(datingDataMat) m = normMat.shape[0]

numTestVes = int(m * hoRatio) # 测试集数量

errorCount = 0.0 # 错误的次数

for i in range(numTestVes):

# 前100个数据作为测试集,后900个数据作为训练集

classifierResult = classify0(normMat[i, :], normMat[numTestVes:m, :], datingLabels[numTestVes:m], 4)

print('分类结果: %d, 真实类别: %d'%(classifierResult, datingLabels[i])) if (classifierResult != datingLabels[i]):

errorCount += 1.0

print('错误率: %f%%' % (errorCount / float(numTestVes) * 100))

datingClassTest() def classifyPerson():

resultList = ['讨厌', '有些喜欢', '非常喜欢']

percentTats = float(input('玩视频游戏所耗时间百分比:'))

ffMiles = float(input('每年获得的飞行常客里程数:'))

iceCream = float(input('每周消费的冰淇淋公升数:')) filename = 'datingTestSet.txt'

datingDataMat, datingLabels = file2matrix(filename)

normMat, ranges, minVals = autoNorm(datingDataMat) inArr = np.array([ffMiles, percentTats, iceCream])

classifierResult = classify0((inArr - minVals) / ranges, normMat, datingLabels, 4) print('你可能%s这个人' % (resultList[classifierResult - 1])) classifyPerson()

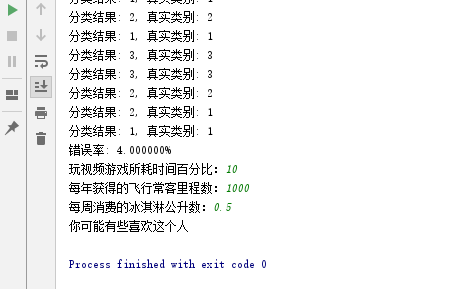

运行结果:

二. sklearn手写数字识别系统

为了简单起见,这里构造的系统只能识别数字0到9,需要识别的数字已经使用图形处理软件,处理成具有相同的色彩和大小①:宽高是32像素×32像素的黑白图像。尽管采用文本格式存储图像不能有效地利用内存空间,但是为了方便理解,我们还是将图像转换为文本格式。

接下来,我们将使用强大的第三方Python科学计算库Sklearn构建手写数字系统。

import numpy as np

import operator

from os import listdir

from sklearn.neighbors import KNeighborsClassifier as KNN def img2Vector(filename):

'''将32*32的二进制图像转换为1*1024向量''' # 创建1*1024 的零向量

returnVect = np.zeros((1, 1024))

# 打开文件

fr = open(filename)

# 按行读取

for i in range(32):

# 读一行数据

lineStr = fr.readline()

# 每一行的前32个元素依次添加到returnVect中

for j in range(32):

returnVect[0, 32 * i + j] = int(lineStr[j]) # 返回转换后的1*1024向量

return returnVect def handwritingClassTest():

'''手写数字分类测试''' # 测试集的Labels

hwLabels = []

# 返回trainingDigits目录下的文件名

trainingFileList = listdir('trainingDigits')

# 返回文件夹下文件的个数

m = len(trainingFileList)

# 初始化训练的Mat矩阵,测试集

trainingMat = np.zeros((m, 1024))

# 从文件名中解析出训练集的类别

for i in range(m):

# 获得文件的名字

fileNameStr = trainingFileList[i]

# 获得分类的数字

classNumber = int(fileNameStr.split('_')[0])

# 将获得的类别添加到hwLabels中

hwLabels.append(classNumber)

# 将每一个文件的1*1024数据存储到trainingMat矩阵中

trainingMat[i, :] = img2Vector('trainingDigits/%s' % (fileNameStr))

# 构建KNN分类器

neigh = KNN(n_neighbors=3, algorithm='auto')

# 拟合模型,trainingMat为训练矩阵,hwLabels为对应的标签

neigh.fit(trainingMat,hwLabels)

# 返回testDigits目录下的文件列表

testFileList = listdir('testDigits')

# 错误检测计数

errorCount = 0.0

# 测试集的数量

mTest = len(testFileList)

# 从文件中解析出测试集的类别并进行分类

for i in range(mTest):

# 获得文件的名字

fileNameStr = testFileList[i]

# 获得分类的数字

classNumber = int(fileNameStr.split('_')[0])

# 获得测试集的1*1024向量,用于训练

vectorUnderTest = img2Vector('testDigits/%s' % (fileNameStr))

# 获得预测结果

classifierResult = neigh.predict(vectorUnderTest) print('分类返回结果为:%d\t真是结果为:%d' % (classifierResult, classNumber)) if classifierResult != classNumber:

errorCount += 1.0

print('总共错了 %d 个数据\n错误率为:%f%%' % (errorCount, errorCount / mTest * 100)) handwritingClassTest()

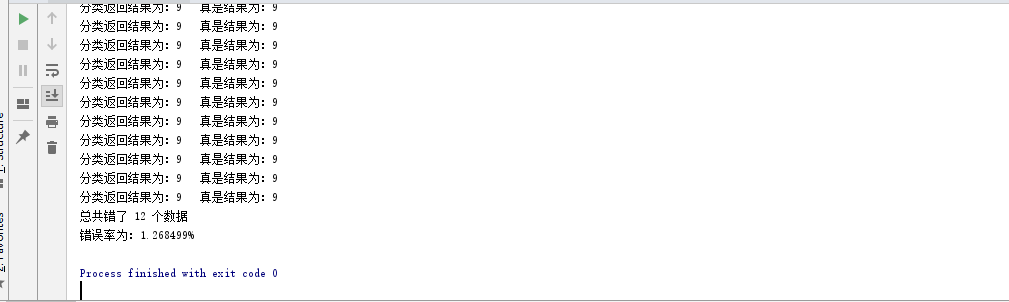

运行结果:

机器学习实战 - python3 学习笔记(一) - k近邻算法的更多相关文章

- 《机器学习实战》学习笔记一K邻近算法

一. K邻近算法思想:存在一个样本数据集合,称为训练样本集,并且每个数据都存在标签,即我们知道样本集中每一数据(这里的数据是一组数据,可以是n维向量)与所属分类的对应关系.输入没有标签的新数据后,将 ...

- 《机器学习实战》学习笔记第十四章 —— 利用SVD简化数据

相关博客: 吴恩达机器学习笔记(八) —— 降维与主成分分析法(PCA) <机器学习实战>学习笔记第十三章 —— 利用PCA来简化数据 奇异值分解(SVD)原理与在降维中的应用 机器学习( ...

- 《机器学习实战》学习笔记第九章 —— 决策树之CART算法

相关博文: <机器学习实战>学习笔记第三章 —— 决策树 主要内容: 一.CART算法简介 二.分类树 三.回归树 四.构建回归树 五.回归树的剪枝 六.模型树 七.树回归与标准回归的比较 ...

- 《机器学习实战》学习笔记第二章 —— K-近邻算法

主要内容: 一.算法概述 二.距离度量 三.k值的选择 四.分类决策规则 五.利用KNN对约会对象进行分类 六.利用KNN构建手写识别系统 七.KNN之线性扫描法的不足 八.KD树 一.算法概述 1. ...

- 《机实战》第2章 K近邻算法实战(KNN)

1.准备:使用Python导入数据 1.创建kNN.py文件,并在其中增加下面的代码: from numpy import * #导入科学计算包 import operator #运算符模块,k近邻算 ...

- [转]Python3《机器学习实战》学习笔记(一):k-近邻算法(史诗级干货长文)

转自http://blog.csdn.net/c406495762/article/details/75172850 版权声明:本文为博主原创文章,未经博主允许不得转载. 目录(?)[-] 一 简 ...

- 《机器学习实战》学习笔记第十三章 —— 利用PCA来简化数据

相关博文: 吴恩达机器学习笔记(八) —— 降维与主成分分析法(PCA) 主成分分析(PCA)的推导与解释 主要内容: 一.向量內积的几何意义 二.基的变换 三.协方差矩阵 四.PCA求解 一.向量內 ...

- 《机器学习实战》学习笔记——第13章 PCA

1. 降维技术 1.1 降维的必要性 1. 多重共线性--预测变量之间相互关联.多重共线性会导致解空间的不稳定,从而可能导致结果的不连贯.2. 高维空间本身具有稀疏性.一维正态分布有68%的值落于正负 ...

- Python3《机器学习实战》学习笔记(一):k-近邻算法(史诗级干货长文)

https://blog.csdn.net/c406495762/article/details/75172850

随机推荐

- Django Template 进阶

回顾: Variables {{ var }} {{ dict.key }} {{ var.attr }} {{ var.method }} {{ varindex }} Filter {{ list ...

- JAVA基础语法——标识符、修饰符、关键字(个人整理总结)

JAVA基础语法——标识符.修饰符.关键字 一 . 标识符 1.1 什么是标识符 就是程序员在定义java程序时,自定义的一些名字,例如helloworld 程序里关键字class 后跟的Dem ...

- localStorage 存满了怎么办?

先来几道面试题 1.a.meituan.com 和 b.meituan.com 这两个域能够共享同一个 localStorage 吗? 2.在 webview 中打开一个页面:i.meituan.co ...

- ASP.NET Web API实现微信公众平台开发(三)自定义菜单

承接之前的流程,在完成服务器绑定和获取access_token之后,本文主要讲述如何实现微信自定义菜单. 官方示例效果 开始之前 .自定义菜单最多包括3个一级菜单,每个一级菜单最多包含5个二级菜单. ...

- static加载顺序简介

1.先执行父类的静态代码块和静态变量初始化,并且静态代码块和静态变量的执行顺序只跟代码中出现的顺序有关. 2.执行子类的静态代码块和静态变量初始化. 3.执行父类的实例变量初始化 4.执行父类的构造函 ...

- Git本地上传到服务器

Git本地上传到服务器 2018年05月17日 10:45:02 VV-King 阅读数:643 标签: git 1.本机window系统的话先下载msysgit 下载后在开始菜单里面找到 &q ...

- 使用JDBC连接各种数据库

项目需要连多钟数据库,把链接的关键部分在这里记录下来. 1.Oracle8/8i/9i数据库(thin模式) Class.forName("oracle.jdbc.driver.Oracle ...

- SqlServer 循环建表、删除表、更新表

常用于分库分表 1.批量删除 declare @outter int declare @inner int ) ) ) begin set @tablePrefix='BankPayOrder_'+c ...

- 微信开放平台创建android应用时怎么获取应用签名

之前微信开放平台中申请创建应用,没有整理,过了好久,又重新百度,今天索性整理了,以供童鞋们备用. 1.微信开发平台注册申请成开发者账号,就此略过 2.在管理中心选择创建移动应用.按照严格要求填写.上传 ...

- RocketMQ系列实战

RocketMQ实战(一)RocketMQ实战(二)RocketMQ实战(三):分布式事务RocketMQ实战(四)