GCE 部署 ELK 7.1可视化分析 nginx

一、准备

我这边有一个网站放在了 Google VM 上面,所以打算在购买一台服务器安装 ELK 来处理分析 nginx 的访问日志。

- 操作系统版本:CentOS 7

- ELK版本:7.1

1.1、服务器环境准备

我们这里还是采用官方的 yum 源进行安装,简单省事,首先配置官方 yum 仓库。

rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearch

cat >> /etc/yum.repos.d/elasticsearch.repo <<EOF

[elasticsearch-7.x]

name=Elasticsearch repository for 7.x packages

baseurl=https://artifacts.elastic.co/packages/7.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-md

EOF

关闭防火墙。

systemctl stop firewalld.service

systemctl disable firewalld.service

二、安装 ES

Elasticsearch 的软件包自带一个版本的 OpenJDK,所以我们这里不需要单独去安装 JDK 了,直接使用官方的就行。

yum install elasticsearch -y

因为默认是监听 IP 是127.0.0.1,我们需要开启配置文件/etc/elasticsearch/elasticsearch.yml的一个参数network.host,写上自己的本地IP即可。

2.1、遇到小问题

如此修改了一下配置文件之后,我发现无法启动了,日志也没有看到什么错误,我就手动执行查看问题。

[root@elk ~]# su - elasticsearch -s /bin/sh -c "/usr/share/elasticsearch/bin/elasticsearch"

su: warning: cannot change directory to /nonexistent: No such file or directory

OpenJDK 64-Bit Server VM warning: Option UseConcMarkSweepGC was deprecated in version 9.0 and will likely be removed in a future release.

[2019-05-31T03:20:42,902][INFO ][o.e.e.NodeEnvironment ] [elk] using [1] data paths, mounts [[/ (rootfs)]], net usable_space [7.7gb], net total_space [9.9gb], types [rootfs]

[2019-05-31T03:20:42,908][INFO ][o.e.e.NodeEnvironment ] [elk] heap size [990.7mb], compressed ordinary object pointers [true]

.................................

[2019-05-31T03:20:50,083][INFO ][o.e.x.s.a.s.FileRolesStore] [elk] parsed [0] roles from file [/etc/elasticsearch/roles.yml]

[2019-05-31T03:20:50,933][INFO ][o.e.x.m.p.l.CppLogMessageHandler] [elk] [controller/5098] [Main.cc@109] controller (64 bit): Version 7.1.1 (Build fd619a36eb77df) Copyright (c) 2019 Elasticsearch BV

[2019-05-31T03:20:51,489][DEBUG][o.e.a.ActionModule ] [elk] Using REST wrapper from plugin org.elasticsearch.xpack.security.Security

[2019-05-31T03:20:51,881][INFO ][o.e.d.DiscoveryModule ] [elk] using discovery type [zen] and seed hosts providers [settings]

[2019-05-31T03:20:53,019][INFO ][o.e.n.Node ] [elk] initialized

[2019-05-31T03:20:53,020][INFO ][o.e.n.Node ] [elk] starting ...

[2019-05-31T03:20:53,178][INFO ][o.e.t.TransportService ] [elk] publish_address {10.154.0.3:9300}, bound_addresses {10.154.0.3:9300}

[2019-05-31T03:20:53,187][INFO ][o.e.b.BootstrapChecks ] [elk] bound or publishing to a non-loopback address, enforcing bootstrap checks

ERROR: [2] bootstrap checks failed

[1]: max file descriptors [4096] for elasticsearch process is too low, increase to at least [65535]

[2]: the default discovery settings are unsuitable for production use; at least one of [discovery.seed_hosts, discovery.seed_providers, cluster.initial_master_nodes] must be configured

[2019-05-31T03:20:53,221][INFO ][o.e.n.Node ] [elk] stopping ...

[2019-05-31T03:20:53,243][INFO ][o.e.n.Node ] [elk] stopped

[2019-05-31T03:20:53,244][INFO ][o.e.n.Node ] [elk] closing ...

[2019-05-31T03:20:53,259][INFO ][o.e.n.Node ] [elk] closed

[2019-05-31T03:20:53,264][INFO ][o.e.x.m.p.NativeController] [elk] Native controller process has stopped - no new native processes can be started

我们可以看到下面的两个错误,一个是说最大文件打开数比较小,一个说还必须开启一个 discovery 设置,那我们分别操作一下。

#临时修改,立刻生效

ulimit -n 655350

#永久修改

echo "* soft nofile 655360" >> /etc/security/limits.conf

echo "* hard nofile 655360" >> /etc/security/limits.conf

我修改后的配置文件如下:

node.name: node-1

path.data: /var/lib/elasticsearch

path.logs: /var/log/elasticsearch

network.host: 10.154.0.3

cluster.initial_master_nodes: ["node-1", "node-2"]

然后我们就可以启动了。

systemctl daemon-reload

systemctl enable elasticsearch.service

systemctl start elasticsearch.service

访问一下页面。

{

"name" : "node-1",

"cluster_name" : "elasticsearch",

"cluster_uuid" : "P0GGZU9pRzutp-zHDZvYuQ",

"version" : {

"number" : "7.1.1",

"build_flavor" : "default",

"build_type" : "rpm",

"build_hash" : "7a013de",

"build_date" : "2019-05-23T14:04:00.380842Z",

"build_snapshot" : false,

"lucene_version" : "8.0.0",

"minimum_wire_compatibility_version" : "6.8.0",

"minimum_index_compatibility_version" : "6.0.0-beta1"

},

"tagline" : "You Know, for Search"

}

三、安装 Kibana

为了节省机器资源,我们这里使用安装在一台机器上面,因为环境上面已经配置好,我们这里直接进行安装。

yum install kibana -y

编辑配置文件/etc/kibana/kibana.yml,修改如下内容:

server.port: 5601

server.host: "10.154.0.3"

elasticsearch.hosts: ["http://10.154.0.3:9200"]

启动服务。

systemctl daemon-reload

systemctl enable kibana.service

systemctl start kibana.service

访问画面正常显示即我们安装完成。

四、安装 Logstash

yum install logstash -y

创建配置文件/etc/logstash/conf.d/logstash.conf,增加如下内容:

input {

beats {

port => 5044

}

}

filter {

if [fields][type] == "nginx_access" {

grok {

match => { "message" => "%{NGINXACCESS}" }

}

}

if [fields][type] == "apache_access" {

grok {

match => { "message" => "%{COMBINEDAPACHELOG}" }

}

}

mutate {

remove_field =>["message"]

remove_field =>["host"]

remove_field =>["input"]

remove_field =>["prospector"]

remove_field =>["beat"]

}

geoip {

source => "clientip"

}

date {

match => [ "timestamp" , "dd/MMM/yyyy:HH:mm:ss Z" ]

}

}

output {

if [fields][type] == "nginx_access" {

elasticsearch {

hosts => "172.18.8.200:9200"

index => "%{[fields][type]}-%{+YYYY.MM.dd}"

}

}

if [fields][type] == "apache_access" {

elasticsearch {

hosts => "172.18.8.200:9200"

index => "%{[fields][type]}-%{+YYYY.MM.dd}"

}

}

}

未完待续。。。

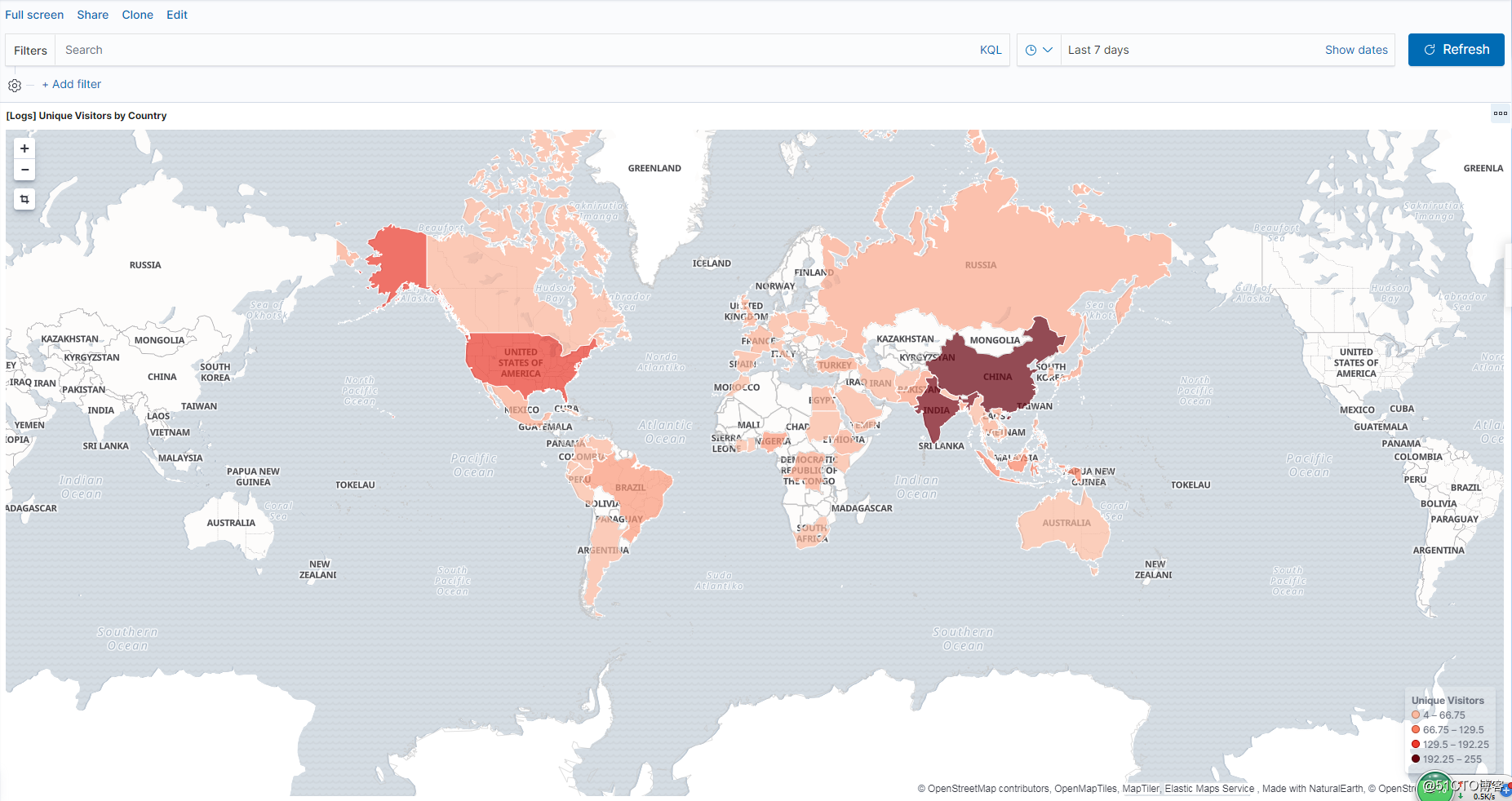

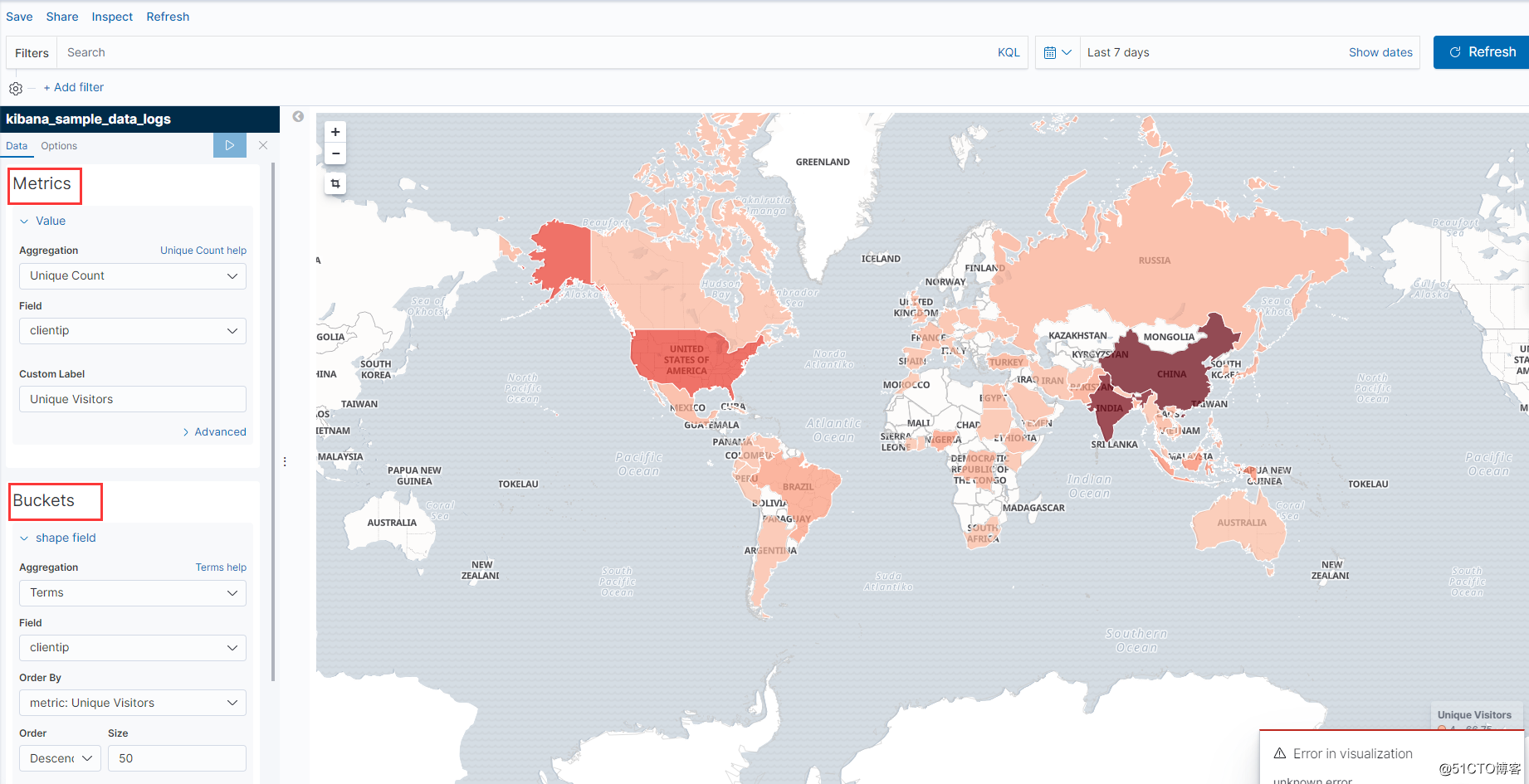

最终效果图如下:

GCE 部署 ELK 7.1可视化分析 nginx的更多相关文章

- Linux下单机部署ELK日志收集、分析环境

一.ELK简介 ELK是elastic 公司旗下三款产品ElasticSearch .Logstash .Kibana的首字母组合,主要用于日志收集.分析与报表展示. ELK Stack包含:Elas ...

- 使用Docker快速部署ELK分析Nginx日志实践(二)

Kibana汉化使用中文界面实践 一.背景 笔者在上一篇文章使用Docker快速部署ELK分析Nginx日志实践当中有提到如何快速搭建ELK分析Nginx日志,但是这只是第一步,后面还有很多仪表盘需要 ...

- 使用Docker快速部署ELK分析Nginx日志实践

原文:使用Docker快速部署ELK分析Nginx日志实践 一.背景 笔者所在项目组的项目由多个子项目所组成,每一个子项目都存在一定的日志,有时候想排查一些问题,需要到各个地方去查看,极为不方便,此前 ...

- elk平台分析nginx日志的基本搭建

一.elk套件介绍 ELK 由 ElasticSearch . Logstash 和 Kiabana 三个开源工具组成.官方网站: https://www.elastic.co/products El ...

- [原创]ubuntu14.04部署ELK+redis日志分析系统

ubuntu14.04部署ELK+redis日志分析系统 [环境] host1:172.17.0.4 搭建ELK+redis服务 host2:172.17.0.3 搭建logstash+nginx服务 ...

- 利用ELK分析Nginx日志生产实战(高清多图)

本文以api.mingongge.com.cn域名为测试对象进行统计,日志为crm.mingongge.com.cn和risk.mingongge.com.cn请求之和(此二者域名不具生产换环境统计意 ...

- 利用ELK分析Nginx日志

本文以api.mingongge.com.cn域名为测试对象进行统计,日志为crm.mingongge.com.cn和risk.mingongge.com.cn请求之和(此二者域名不具生产换环境统计意 ...

- 利用docker部署elk交换机日志分析

今天我们来聊一下利用docker部署elk日志分析系统,这里解析一下elk是啥东西.elk分别是Elasticsearch,Logstash和Kibana的首字母缩写. Elasticsearch是一 ...

- elk收集分析nginx access日志

elk收集分析nginx access日志 首先elk的搭建按照这篇文章使用elk+redis搭建nginx日志分析平台说的,使用redis的push和pop做队列,然后有个logstash_inde ...

随机推荐

- LOAD DATA INFILE读取CSV中一千万条数据至mysql

作业要求 构建一个关系模式和课本中的关系movies(title,year,length,movietype,studioname,producerC)一样的关系,名称自定,在这个关系中插入1000万 ...

- Python和Shell交互工具 ShellPy

ShellPy 是一款Python和Shell的交互工具.一般来说,我们会通过Subprocess.Popen或者Command模块执行一条Shell命令或脚本,然后通过返回的标准输出和错误输出来得到 ...

- Linux C打印所有的环境变量

#include <stdio.h> extern char** environ; int main() { ; ; environ[nIndex] != NULL; nIndex++) ...

- MySQL 5.6 中一个重要的优化——Index Condition Pushdown,究竟push down了什么

1 问题描述 一条SQL,在数据库中是如何执行的呢?相信很多人都会对这个问题比较感兴趣.当然,要完整描述一条SQL在数据库中的生命周期,这是一个非常巨大的问题,涵盖了SQL的词法解析.语 ...

- web超大文件上传

文件夹数据库处理逻辑 publicclass DbFolder { JSONObject root; public DbFolder() { this.root = new JSONObject(); ...

- const char*p,char const*p,char *const p

转自 http://blog.csdn.net/todd911/article/details/7911995 const char*, char const*, char*const的区别问题几乎是 ...

- vue怎么引入echats并使用 (柱状图 字符云)

安装 npm install echarts --save 下面看一下如何简单的使用: 在main.js中引入(全局引入) // 引入echarts import echarts from 'echa ...

- 用MFC构造DIRECTX应用框架

一. MFC类库与DirectXSDK Microsoft DirectX SDK是开发基于 Windows平台游戏的一个软件开发工具,其主要功能主要包括在五个组件中: DirectDraw. Dir ...

- MySQL inodb cluster部署

innodb cluster是基于组复制来实现的. 搭建一套MySQL的高可用集群innodb. 实验环境: IP 主机名 系统 软件 192.168.91.46 master RHEL7.4 mys ...

- 基于Ryu REST API的VLAN实现

目录 0.预备知识 1.实验内容 2.编写脚本addflow.sh一步实现流表下发 3.使用api查看流表 4.实验结果 0.预备知识 ryu控制器的API文档:ryu.app.ofctl_rest ...