HBase导入数据同时与Phoenix实现同步映射

1.HDFS上数据准备

2019-03-24 09:21:57.347,869454021315519,8,1

2019-03-24 22:07:15.513,867789020387791,8,1

2019-03-24 21:43:34.81,357008082359524,8,1

2019-03-24 16:05:32.227,860201045831206,8,1

2019-03-24 18:11:18.167,866676040163198,8,1

2019-03-24 22:01:24.877,868897026713230,8,1

2019-03-24 12:34:23.377,863119033590062,8,1

2019-03-24 20:16:32.53,862505041870010,8,1

2019-03-24 09:10:55.18,864765037658468,8,1

2019-03-24 16:18:41.503,869609023903469,8,1

2019-03-24 10:44:52.027,869982033593376,8,1

2019-03-24 20:00:08.007,866798025149107,8,1

2019-03-24 10:25:18.1,863291034398181,2,3

2019-03-24 10:33:48.56,867557030361332,8,1

2019-03-24 16:42:15.057,869841022390535,8,1

2019-03-24 10:08:00.277,867574031105048,8,1

注意: 分隔符是‘,’

2. HBase上创建表

create 'ALLUSER','INFO';

3. 在Phoenix中建立相同的表名以实现与hbase表的映射

create table if not exists ALLUSER(

firsttime varchar primary key,

INFO.IMEI varchar,

INFO.COID varchar,

INFO.NCOID varchar

)

注意:

- 除主键外,Phoenix表的表名和字段字段名要和HBase表中相同,包括大小写

- Phoneix中的column必须以HBase的columnFamily开头

4. 通过importtsv.separator指定分隔符,否则默认的分隔符是tab键

hbase org.apache.hadoop.hbase.mapreduce.ImportTsv \

-Dimporttsv.columns=HBASE_ROW_KEY,INFO:IMEI,INFO:IMEI,INFO:NCOID \

-Dimporttsv.separator=, -Dimporttsv.bulk.output=/warehouse/temp/alluser ALLUSER /user/hive/warehouse/toutiaofeedback.db/newuser/000001_0

5. 将生成的HFlie导入到HBase

hbase org.apache.hadoop.hbase.mapreduce.LoadIncrementalHFiles /warehouse/temp/alluser ALLUSER

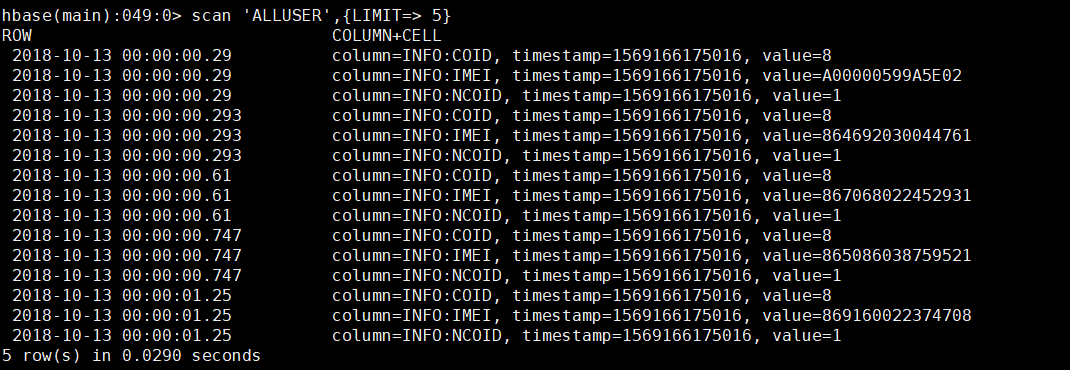

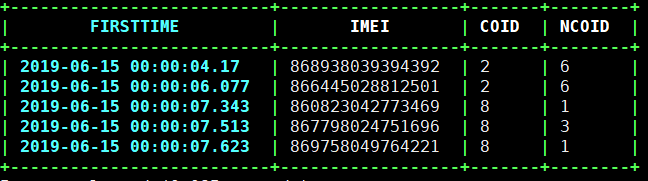

6. 查看HBase,Phoenix

查看HBase

查看Phoenix

HBase导入数据同时与Phoenix实现同步映射的更多相关文章

- Phoneix(四)hbase导入数据同时与phoenix实现映射同步

一.说明 先创建一个hbase表格,能够导入本地数据到hbase中,最后能够通过phoneix进行访问. 1.数据准备(10W条,样例如下),文件test.txt 0,20190520164020,1 ...

- 使用sqoop工具从oracle导入数据

sqoop工具是hadoop下连接关系型数据库和Hadoop的桥梁,支持关系型数据库和hive.hdfs,hbase之间数据的相互导入,可以使用全表导入和增量导入 从RDBMS中抽取出的数据可以被Ma ...

- sqoop工具从oracle导入数据2

sqoop工具从oracle导入数据 sqoop工具是hadoop下连接关系型数据库和Hadoop的桥梁,支持关系型数据库和hive.hdfs,hbase之间数据的相互导入,可以使用全表导入和增量导入 ...

- 通过phoenix导入数据到hbase出错记录

解决方法1 错误如下 -- ::, [hconnection-0x7b9e01aa-shared--pool11069-t114734] WARN org.apache.hadoop.hbase.ip ...

- 使用Sqoop从MySQL导入数据到Hive和HBase 及近期感悟

使用Sqoop从MySQL导入数据到Hive和HBase 及近期感悟 Sqoop 大数据 Hive HBase ETL 使用Sqoop从MySQL导入数据到Hive和HBase 及近期感悟 基础环境 ...

- hbase批量数据导入报错:NotServingRegionException

批量导入数据到hbase的时候,报错: org.apache.hadoop.hbase.client.RetriesExhaustedWithDetailsException: Failed 1 ac ...

- HBase 实战(1)--HBase的数据导入方式

前言: 作为Hadoop生态系统中重要的一员, HBase作为分布式列式存储, 在线实时处理的特性, 备受瞩目, 将来能在很多应用场景, 取代传统关系型数据库的江湖地位. 本篇博文重点讲解HBase的 ...

- HBase(三): Azure HDInsigt HBase表数据导入本地HBase

目录: hdfs 命令操作本地 hbase Azure HDInsight HBase表数据导入本地 hbase hdfs命令操作本地hbase: 参见 HDP2.4安装(五):集群及组件安装 , ...

- sqoop:mysql和Hbase/Hive/Hdfs之间相互导入数据

1.安装sqoop 请参考http://www.cnblogs.com/Richardzhu/p/3322635.html 增加了SQOOP_HOME相关环境变量:source ~/.bashrc ...

随机推荐

- 写论文的第四天 Spark安装 使用sparkshell

Spark分布式安装 Spark安装注意:需要和本机的hadoop版本对应 前往spark选择自己相对应的版本下载之后进行解压 命令:tar –zxf spark-2.4.0-bin-hadoop2. ...

- 还在用if else?策略模式了解一下!

在公司负责的就是订单取消业务,老系统中各种类型订单取消都是通过if else 判断不同的订单类型进行不同的逻辑.在经历老系统的折磨和产品需求的不断变更,决定进行一次大的重构:消灭 if else. 接 ...

- Hive 窗口分析函数

1.窗口函数 1.LAG(col,n,DEFAULT) 用于统计窗口内往上第n行值 第一个参数为列名,第二个参数为往上第n行(可选,默认为1),第三个参数为默认值(当往上第n行为NULL时候,取默认值 ...

- 16.XML语法、CDATA、约束(DTD、Schema)讲解

xml主要用来描述数据,比如配置文件,网络之间传输数据等,并且在android中也经常用xml来布局,,接下来便来学习xml常用的东西 1.XML语法 xml语法分为: 1.1 文档声明 必须位于文档 ...

- CodeForces 989D

题意略. 思路: 可以看成是所有的云彩照常运动,而月亮在跑.只要两个云彩相交后,在分离前月亮能赶到,就算是符合题意的. 可以知道,两个相隔越远的相向运动地云彩是越有可能符合题意的,因为它们相遇所用时间 ...

- 玩转 SpringBoot 2 快速搭建 | RESTful Api 篇

概述 RESTful 是一种架构风格,任何符合 RESTful 风格的架构,我们都可以称之为 RESTful 架构.我们常说的 RESTful Api 是符合 RESTful 原则和约束的 HTTP ...

- Oracle - 自治事务autonomous transaction

自治事务 - autonomous transaction 在Oracle数据库中,有时候我们会希望记录一个过程或者函数的运行日志,不管正常运行结束还是触发异常结束,都要记录. 正常结束的没有问题,但 ...

- CodeForces 628 D Magic Numbers 数位DP

Magic Numbers 题意: 题意比较难读:首先对于一个串来说, 如果他是d-串, 那么他的第偶数个字符都是是d,第奇数个字符都不是d. 然后求[L, R]里面的多少个数是d-串,且是m的倍数. ...

- Atcoder D - A or...or B Problem(思维)

题目链接:http://agc015.contest.atcoder.jp/tasks/agc015_d 题意:给出两个数b,a(a>=b)问{a,a+1,....,b}的集合内取任意数求或运算 ...

- U盘便携式hexo&博客搭建&极速纯净低bug主题推荐&部署到coding&SEO优化搜索

指南:U盘便携式hexo&博客搭建&极速纯净低bug主题推荐&部署到coding&SEO优化搜索 U盘便携式hexo随处写博客 简述:在任意一台联网的电脑上续写he ...