中国农产品信息网站scrapy-redis分布式爬取数据

---恢复内容开始---

基于scrapy_redis和mongodb的分布式爬虫

项目需求:

1:自动抓取每一个农产品的详细数据

2:对抓取的数据进行存储

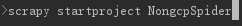

第一步:

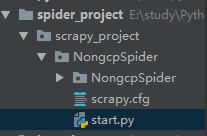

创建scrapy项目

创建爬虫文件

在items.py里面定义我们要爬取的数据

# -*- coding: utf-8 -*-

# Define here the models for your scraped items

#

# See documentation in:

# https://doc.scrapy.org/en/latest/topics/items.html

import scrapy

class NongcpspiderItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

# 供求关系

supply = scrapy.Field()

# 标题

title = scrapy.Field()

# 发布时间

create_time = scrapy.Field()

# 发布单位

unit = scrapy.Field()

# 联系人

contact = scrapy.Field()

# 手机号码

phone_number = scrapy.Field()

# 地址

address = scrapy.Field()

# 详细地址

detail_address = scrapy.Field()

# 上市时间

market_time = scrapy.Field()

# 价格

price = scrapy.Field()

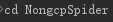

将settings.py改为false

写spider爬虫文件nongcp_spider.py,进行字段解析使用xpath,正则表达式

# -*- coding: utf-8 -*-

import scrapy

import re

from ..items import NongcpspiderItem

class NongcpSpiderSpider(scrapy.Spider):

name = 'nongcp_spider'

# allowed_domains = ['http://www.nongnet.com/']

start_urls = ['http://www.nongnet.com/']

def parse(self, response):

"""

解析详情页和下一页url

:param response:

:return:

"""

detail_urls = response.xpath('//li[@class="lileft"]/a/@href').extract()

for detail_url in detail_urls:

yield scrapy.Request(url=self.start_urls[0]+detail_url, callback=self.detail_parse)

next_url = response.xpath("//span[@id='ContentMain_lblPage']/a/@href").extract()

if next_url:

yield scrapy.Request(url=self.start_urls[0]+next_url[-2])

def detail_parse(self, response):

"""

解析具体的数据

:param response:

:return:

"""

items = NongcpspiderItem()

title_result = response.xpath('//h1[@class="h1class"]/text()').extract_first()

if title_result:

items['supply'] = title_result.strip()[1:2]

items['title'] = title_result.strip()[3:]

creatte_time = re.findall(r"<font color='999999'>时间:(\d+/\d+/\d+ \d+:\d+)  ", response.text)

if creatte_time:

items['create_time'] = creatte_time[0]

unit = re.findall(r"发布单位</div><div class='xinxisxr'><a href='.*?.aspx'>(.*?)</a>", response.text, re.S)

if unit:

items['unit'] = unit[0]

price = response.xpath('//div[@class="scdbj1"]/text()').extract()

if price:

items['price'] = ''.join(price)

yield items

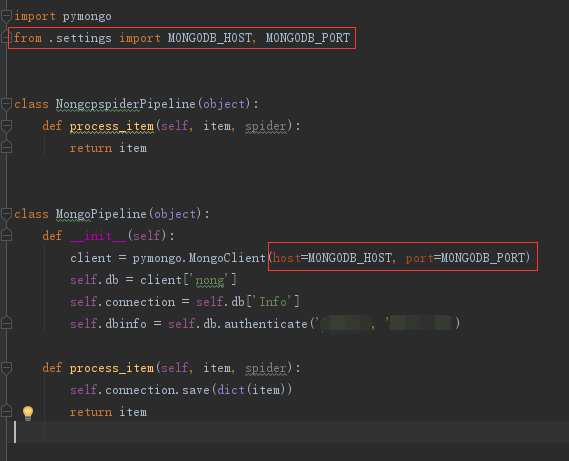

编写pipelines.py,往mongodb里面存储数据

# -*- coding: utf-8 -*-

# Define your item pipelines here

#

# Don't forget to add your pipeline to the ITEM_PIPELINES setting

# See: https://doc.scrapy.org/en/latest/topics/item-pipeline.html

import pymongo

class NongcpspiderPipeline(object):

def process_item(self, item, spider):

return item

class MongoPipeline(object):

def __init__(self):

client = pymongo.MongoClient(host='127.0.0.1', port=27017)

self.db = client['nong']

self.connection = self.db['Info']

self.dbinfo = self.db.authenticate('xxxx', 'xxxx')

def process_item(self, item, spider):

self.connection.save(dict(item))

return item

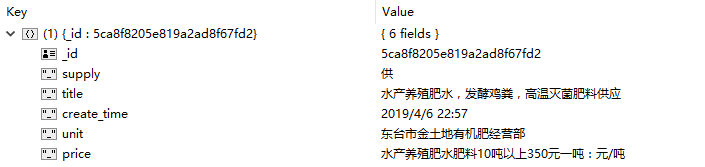

完成以上步骤就可以进行数据的爬取了,接下来我们来测试一下爬取的效果

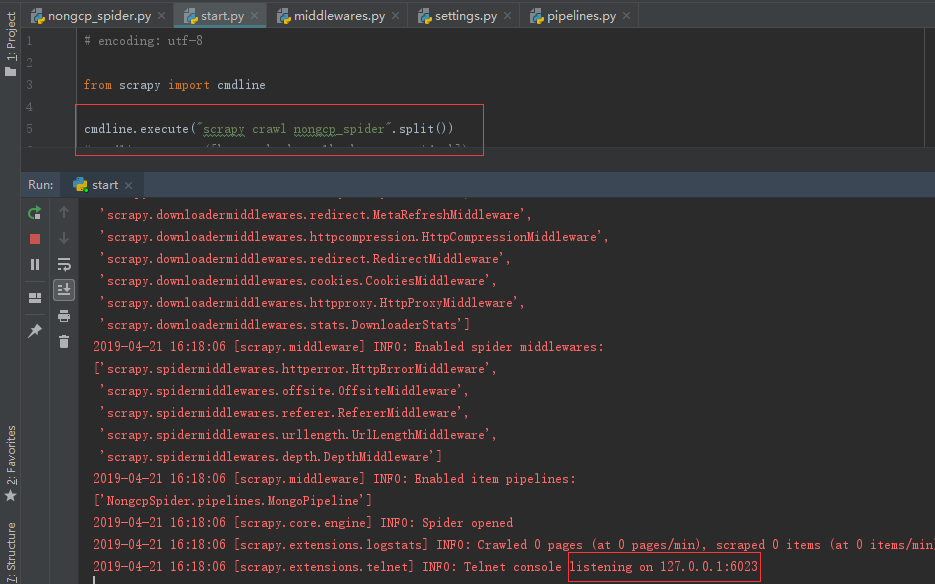

编写启动脚本start.py

#encoding: utf-8

from scrapy import cmdline

# cmdline.execute("scrapy crawl qsbk_spider".split())

cmdline.execute(["scrapy", 'crawl', 'nongcp_spider'])

开启settings.py pipelines字段

运行程序,爬取到的效果如下

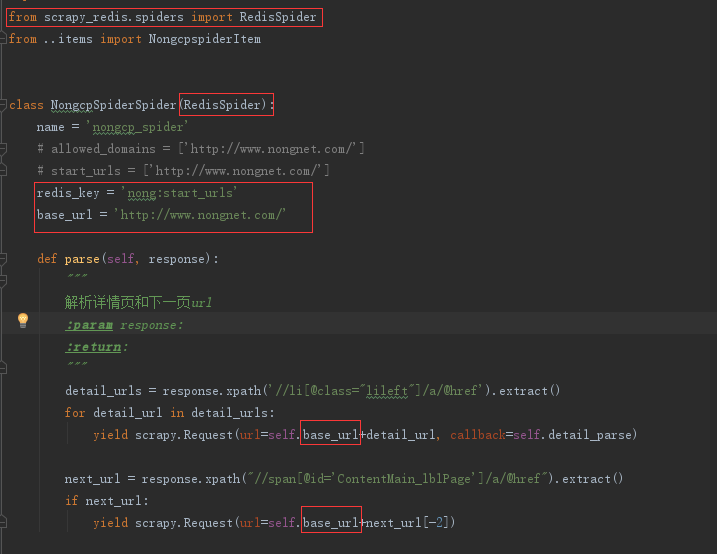

接下来实现分布式去重爬取

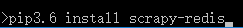

先安装scrapy-redis

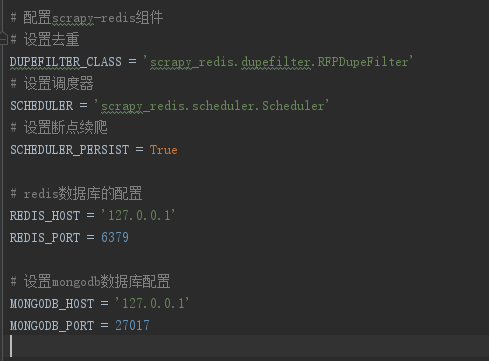

在settings.py里面配置scrapy-redis组件

在pipelines.py引入mongdb配置

修改nongcp_spider.py文件

如果爬取过程中出现封ip的操作,我们可以设置middlewares.py,,在该文件设置代理

使用阿布云代理

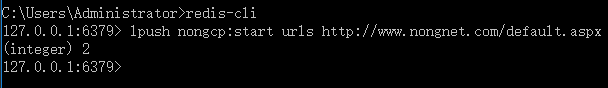

先启动start.py文件,在运行redis-cli

然后就可以抓取数据了到mongdb里面了

---恢复内容结束---

中国农产品信息网站scrapy-redis分布式爬取数据的更多相关文章

- 爬虫--scrapy+redis分布式爬取58同城北京全站租房数据

作业需求: 1.基于Spider或者CrawlSpider进行租房信息的爬取 2.本机搭建分布式环境对租房信息进行爬取 3.搭建多台机器的分布式环境,多台机器同时进行租房数据爬取 建议:用Pychar ...

- Scrapy持久化存储-爬取数据转义

Scrapy持久化存储 爬虫爬取数据转义问题 使用这种格式,会自动帮我们转义 'insert into wen values(%s,%s)',(item['title'],item['content' ...

- scrapy使用PhantomJS爬取数据

环境:python2.7+scrapy+selenium+PhantomJS 内容:测试scrapy+PhantomJS 爬去内容:涉及到js加载更多的页面 原理:配置文件打开中间件+修改proces ...

- scrapy-redis + Bloom Filter分布式爬取tencent社招信息

scrapy-redis + Bloom Filter分布式爬取tencent社招信息 什么是scrapy-redis 什么是 Bloom Filter 为什么需要使用scrapy-redis + B ...

- scrapy-redis分布式爬取tencent社招信息

scrapy-redis分布式爬取tencent社招信息 什么是scrapy-redis 目标任务 安装爬虫 创建爬虫 编写 items.py 编写 spiders/tencent.py 编写 pip ...

- Scrapy 分布式爬取

由于受到计算机能力和网络带宽的限制,单台计算机运行的爬虫咋爬取数据量较大时,需要耗费很长时间.分布式爬取的思想是“人多力量大”,在网络中的多台计算机同时运行程序,公童完成一个大型爬取任务, Scrap ...

- scrapy-redis实现爬虫分布式爬取分析与实现

本文链接:http://blog.csdn.net/u012150179/article/details/38091411 一 scrapy-redis实现分布式爬取分析 所谓的scrapy-redi ...

- scrapy-redis分布式爬取知乎问答,使用docker布置多台机器。

先上结果: 问题: 答案: 可以看到现在答案文档有十万多,十万个为什么~hh 正文开始: 分布式爬虫应该是在多台服务器(A B C服务器)布置爬虫环境,让它们重复交叉爬取,这样的话需要用到状态管理器. ...

- Python使用Scrapy框架爬取数据存入CSV文件(Python爬虫实战4)

1. Scrapy框架 Scrapy是python下实现爬虫功能的框架,能够将数据解析.数据处理.数据存储合为一体功能的爬虫框架. 2. Scrapy安装 1. 安装依赖包 yum install g ...

随机推荐

- RBG灯颜色渐变(颜色要尽可能多)程序分析

相信很多调过RBG灯的朋友都是通过分别改变R.B.G的占空比来改变颜色的,但是不是发现了一个问题,那就是不管怎样调都很难实现几十种颜色的变化,一般只有是7种颜色的渐变.下面给朋友们分享一个可以实现几十 ...

- 国家与大洲对应关系json数据

[ { "continent_cname": "欧洲", "continent_name": "EU", "c ...

- mongodb 3.4 学习 (一) 安装

https://www.mongodb.com/blog/post/capacity-planning-and-hardware-provisioning-mongodb-ten-minutes 安装 ...

- php之Apache压力测试

1,测试本机是否已经安装好Apache ①进入自己的Apache目录下面的bin目录,然后执行ab -V.如果返回Apache版本则表示已经装好 2,执行压力测试命令,ab -n 1000(请求总数) ...

- 关于Oracle死锁处理方法

关于数据库死锁的检查方法一. 数据库死锁的现象程序在执行的过程中,点击确定或保存按钮,程序没有响应,也没有出现报错.二. 死锁的原理当对于数据库某个表的某一列做更新或删 ...

- [19/03/12-星期二] 数组_遍历(for-each)&复制&java.util.Arrays类

一.遍历 for-each即增强for循环,是JDK1.5新增加的功能,专门用于读取数组或集合中所有的元素,即对数组进行遍历. //数组遍历 for-each public class Test_03 ...

- stixel-net绘制指标图

需解决问题: 1.离散点进行平滑曲线画法 https://blog.csdn.net/cdqn10086/article/details/70143616 def draw_curve(x,y,img ...

- SSM命名规范框架

文件名 作用 src 根目录,没什么好说的,下面有main和test. main 主要目录,可以放java代码和一些资源文件. java 存放我们的java代码,这个文件夹要使用Build Path ...

- Python程序的执行原理(转)

1. 过程概述 Python先把代码(.py文件)编译成字节码,交给字节码虚拟机,然后虚拟机一条一条执行字节码指令,从而完成程序的执行. 2. 字节码 字节码在Python虚拟机程序里对应的是PyCo ...

- 运用Xdebug调试和优化PHP程序

什么是Xdebug? Xdebug是一个开放源代码的PHP程序调试器(即一个Debug工具),可以用来跟踪,调试和分析PHP程序的运行状况.Xdebug现在的最新版本是xdebug 2.0.0beta ...