用jieba库统计文本词频及云词图的生成

一、安装jieba库

:\>pip install jieba #或者 pip3 install jieba

二、jieba库解析

jieba库主要提供提供分词功能,可以辅助自定义分词词典。

jieba库中包含的主要函数如下:

jieba.cut(s) 精确模式,返回一个可迭代的数据类型

jieba.cut(s,cut_all=True) 全模式,输出文本s中所有可能的单词

jieba.cut_for_search(s) 搜索引擎模式,适合搜索引擎建立索引的分词结果

jieba.lcut(s) 精确模式,返回一个列表类型,建议使用

jieba.lcut(s,cut_all=True) 全模式,返回一个列表类型,建议使用

jieba.lcut_for_search(s) 搜索引擎模式,返回一个列表类型,建议使用

jieba.add_word(w) 向分词词典中增加新词w

三、用jieba库统计文本的词频

《流浪地球》是刘慈欣的一部作品。该书讲述了庞大的地球逃脱计划,逃离太阳系,前往新家园。从网上获取该书的文本文件,保存于桌面上,命名为“流浪地球。”

现统计其文本中出现次数最多的是个词语,源代码如下:

import jieba

txt = open("C:\\Users\\Administrator\\Desktop\\流浪地球.txt", "r", encoding='utf-8').read()

words = jieba.lcut(txt)

counts = {}

for word in words:

if len(word) == 1: #排除单个字符的分词结果

continue

else:

counts[word] = counts.get(word,0) + 1

items = list(counts.items())

items.sort(key=lambda x:x[1], reverse=True)

for i in range(10):

word, count = items[i]

print ("{0:<10}{1:>5}".format(word, count))

运行程序后,输出结果如下:

故容易得知流浪地球中出现频次较高的词语

四、结合jieba库的词频统计制作词云图

1、准备工作:pip 安装 jieba , wordcloud ,matplotlib

2以阿Q正传为例:

源代码为:

from wordcloud import WordCloud

import matplotlib.pyplot as plt

import jieba #生成词云

def create_word_cloud(filename):

text = open("{}.txt".format(filename)).read()

# 结巴分词

wordlist = jieba.cut(text, cut_all=True)

wl = " ".join(wordlist) # 设置词云

wc = WordCloud(

# 设置背景颜色

background_color="white",

# 设置最大显示的词云数

max_words=2000,

# 这种字体都在电脑字体中,一般路径

font_path='C:\Windows\Fonts\simfang.ttf',

height=1200,

width=1600,

# 设置字体最大值

max_font_size=200,

# 设置有多少种随机生成状态,即有多少种配色方案

random_state=100,

) myword = wc.generate(wl) # 生成词云

# 展示词云图

plt.imshow(myword)

plt.axis("off")

plt.show()

wc.to_file('p.png') # 把词云保存下 if __name__ == '__main__':

create_word_cloud('C:\\Users\\Administrator\\Desktop\\阿Q正传')

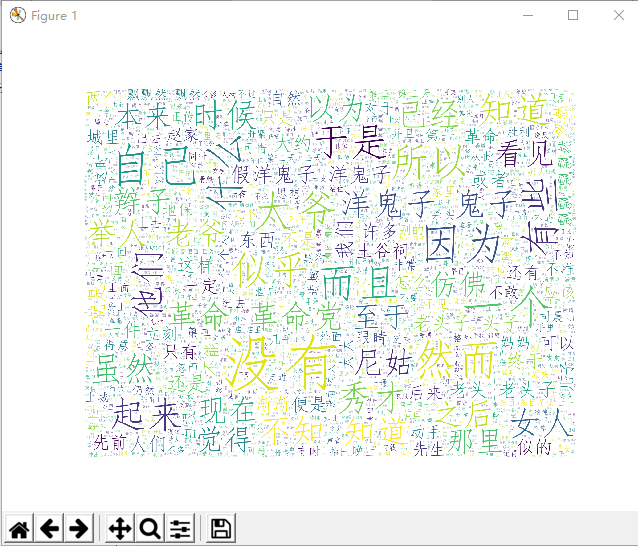

运行程序后,输出结果如下:

故可得出文本的云词图。

用jieba库统计文本词频及云词图的生成的更多相关文章

- 用Python搞出自己的云词图 | 【带你装起来】

作者:AI算法与图像处理 参考:http://www.sohu.com/a/149657007_236714 云词图简介 什么词云 由词汇组成类似云的彩色图形.“词云”就是对网络文本中出现频率较高的“ ...

- 利用python jieba库统计政府工作报告词频

1.安装jieba库 舍友帮装的,我也不会( ╯□╰ ) 2.上网寻找政府工作报告 3.参照课本三国演义词频统计代码编写 import jieba txt = open("D:\政府工作报告 ...

- jieba库的使用和好玩的词云

1.jieba库基本介绍 (1).jieba库概述 jieba是优秀的中文分词第三方库 - 中文文本需要通过分词获得单个的词语 - jieba是优秀的中文分词第三方库,需要额外安装 - ...

- jieba 库的使用和好玩的词云

jieba库的使用: (1) jieba库是一款优秀的 Python 第三方中文分词库,jieba 支持三种分词模式:精确模式.全模式和搜索引擎模式,下面是三种模式的特点. 精确模式:试图将语句最精 ...

- 运用jieba库统计词频及制作词云

一.对中国十九大报告做词频分析 import jieba txt = open("中国十九大报告.txt.txt","r",encoding="utf ...

- jieba库初级应用

1.jieba库基本介绍 (1).jieba库概述 jieba是优秀的中文分词第三方库 - 中文文本需要通过分词获得单个的词语 - jieba是优秀的中文分词第三方库,需要额外安装 - ...

- 广师大学习笔记之文本统计(jieba库好玩的词云)

1.jieba库,介绍如下: (1) jieba 库的分词原理是利用一个中文词库,将待分词的内容与分词词库进行比对,通过图结构和动态规划方法找到最大概率的词组:除此之外,jieba 库还提供了增加自定 ...

- jieba库词频统计

一.jieba 库简介 (1) jieba 库的分词原理是利用一个中文词库,将待分词的内容与分词词库进行比对,通过图结构和动态规划方法找到最大概率的词组:除此之外,jieba 库还提供了增加自定义中文 ...

- python实例:利用jieba库,分析统计金庸名著《倚天屠龙记》中人物名出现次数并排序

本实例主要用到python的jieba库 首先当然是安装pip install jieba 这里比较关键的是如下几个步骤: 加载文本,分析文本 txt=open("C:\\Users\\Be ...

随机推荐

- dubbo服务运行的三种方式

dubbo服务运行,也就是让生产服务的进程一直启动.如果生产者进程挂掉,也就不存在生产者,消费者不能进行消费. Dubbo服务运行的三种方式如下:1.使用Servlet容器运行(Tomcat.Jett ...

- js中split 正则表示式 (/[,+]/)

定义和用法 split() 方法用于把一个字符串分割成字符串数组. 语法 stringObject.split(separator,howmany) separator 作为分隔符,separator ...

- vuedraggable(vue2.0)组件详解

github地址 安装 yarn add vuedraggable npm i -S vuedraggable 使用方式 通常 <draggable v-model="myArray& ...

- GRPC单向/双向流

开始食用grpc(之二)https://www.cnblogs.com/funnyzpc/p/9570992.html 开始食用grpc(之一)https://www.cnblogs.com/funn ...

- 精通ArrayList,关于ArrayList你想知道的一切

目录 精通ArrayList,关于ArrayList你想知道的一切 前言 ArrayList 内部结构,和常用方法实现 实例化方法 添加元素 add()方法 get()方法 移除元素 怎么扩容的 序列 ...

- spring security 简单应用

Pom <?xml version="1.0" encoding="UTF-8"?> <project xmlns="http:// ...

- java实验5

实验一要求: 两人一组结对编程: 参考http://www.cnblogs.com/rocedu/p/6766748.html#SECDSA 结对实现中缀表达式转后缀表达式的功能 MyBC.java ...

- Servlet(七):session

Session 学习:问题: Request 对象解决了一次请求内的不同 Servlet 的数据共享问 题,那么一个用户的不同请求的处理需要使用相同的数据怎么办呢?解决: 使用 session 技术. ...

- 微信小程序--家庭记账本开发--01

微信小程序的开发准备与开发工具的学习 在这次寒假伊始,临近春节,学习进程有所拉下,现在补上.寻找了好多网站的相关学习视频,包括微信公众平台关于小程序这方面也有好多相关资料供查阅. 1.开发准备: 首先 ...

- 【Vue】-- 数据双向绑定的原理 --Object.defineProperty()

Object.defineProperty()方法被许多现代前端框架(如Vue.js,React.js)用于数据双向绑定的实现,当我们在框架Model层设置data时,框架将会通过Object.def ...