爬取千千小说 -- xpath

今天以其中一本小说为例,讲一下下载小说的主体部分,了解正常的爬取步骤,用到的是request和xpath。

爬取数据三步走:访问url --》爬取数据 --》保存数据

一、访问千千小说网址: https://www.qqxsnew.com/

二、随便选一部小说,打开章节目录界面(比方说魔道祖师):https://www.qqxsnew.com/18/18991/

三、开始编写代码。

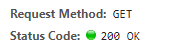

a. 利用request访问网页,是get请求还是post请求要看网页上面写的是啥

右击检查,选择network,随便找个页面,看下request Method方法是什么。

右击检查,选择network,随便找个页面,看下request Method方法是什么。

url = "https://www.qqxsnew.com/18/18991/"

html = requests.get(url, headers=headers).text

b. 得到网页的html页面(html页面 == 在网页鼠标右击“查看网页源代码”),获取章节名字和章节链接。

章节名字和章节链接获取需要用到XPath --》在网页鼠标右击检查 --》定位到任意章节(如第一章)--》copy --》copy XPath --》 //*[@id="list"]/dl/dd[13]/a

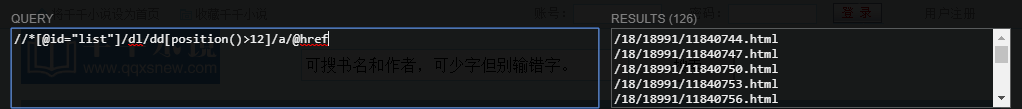

如果安装过XPath插件的话,可以将上面复制的XPath在插件里面查询,可以看到只查询到了一个

我们的目的是获取到所有章节的名字和链接,分析上面XPath的字串,发现dd[13]这个地方是定位,每个dd都是一个章节,所以我们模糊定位看看

咦,可以看出来dd里面的内容都出来了,但是前面12章的内容不是我们需要的,我们要的是从第一章开始,所以需要把它们过滤掉,position是一个定位的函数,大于12是说从第13位开始,也就是第一章

这数据正好是我们想要提取的文字,所以我们已经得到了文字提取的XPath字串://*[@id="list"]/dl/dd[position()>12]/a

文字和链接都在a标签里面,链接在href属性里面,所以链接的XPath字串://*[@id="list"]/dl/dd[position()>12]/a/@href

好了,前面是在分析XPath字串是怎么得到的,如果自己对XPath语法熟的话,也可以自己写提取字串,然后用插件去验证,或者直接用代码验证都是可以的。现在我们把它放到代码中去

# 获取a标签对象

chapter_titles_obj = datas.xpath('//*[@id="list"]/dl/dd[position()>12]/a')

for chapter_title_obj in chapter_titles_obj:

# 获取a标签文本

chapter_title_text = chapter_title_obj.xpath('./text()')[0]

# 获取a标签的链接

chapter_url = chapter_title_obj.xpath('./@href')[0]

打印出来看看结果

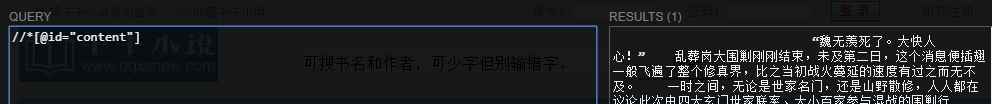

c. 每个章节的链接都拿到了,接下来就是请求了,这个不多说,和上面请求的方法一样,XPath获取方法也相同。

d. 存储获取到的数据

for content_chapter_text in content_chapter:

print(content_chapter_text)

with open("魔道祖师/" + chapter_title_text + ".txt", 'a', encoding='utf-8') as f:

f.write(content_chapter_text)

这样,一篇小说从访问到下载的过程就结束了。

完整代码

#!/usr/bin/env python

# _*_ coding: UTF-8 _*_

"""=================================================

@Project -> File : six-dialog_design -> qianqian.py

@IDE : PyCharm

@Author : zihan

@Date : 2020/5/25 14:50

@Desc :

================================================="""

import requests

from lxml import etree headers = {

'User-Agent': ""

} def main():

url = "https://www.qqxsnew.com/18/18991/"

html = requests.get(url, headers=headers).text

datas = etree.HTML(html)

chapter_titles_obj = datas.xpath('//*[@id="list"]/dl/dd[position()>12]/a')

for chapter_title_obj in chapter_titles_obj:

chapter_title_text = chapter_title_obj.xpath('./text()')[0]

chapter_url = chapter_title_obj.xpath('./@href')[0]

chapter_url = "https://www.qqxsnew.com" + chapter_url # 对每一章的链接发送请求

html_chapter = requests.get(chapter_url, headers=headers).text

datas_chapter = etree.HTML(html_chapter)

content_chapter = datas_chapter.xpath('//*[@id="content"]/text()')

print(chapter_title_text, "开始下载")

for content_chapter_text in content_chapter:

print(content_chapter_text)

with open("魔道祖师/" + chapter_title_text + ".txt", 'a', encoding='utf-8') as f:

f.write(content_chapter_text) if __name__ == '__main__':

main()

OK。如果想要批量下载,或者选择下载等,只是改变url而已,了解主体方法后,这些都不难。

爬取千千小说 -- xpath的更多相关文章

- 如何用python爬虫从爬取一章小说到爬取全站小说

前言 文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行获取http ...

- Python爬虫爬取全书网小说,程序源码+程序详细分析

Python爬虫爬取全书网小说教程 第一步:打开谷歌浏览器,搜索全书网,然后再点击你想下载的小说,进入图一页面后点击F12选择Network,如果没有内容按F5刷新一下 点击Network之后出现如下 ...

- python之如何爬取一篇小说的第一章内容

现在网上有很多小说网站,但其实,有一些小说网站是没有自己的资源的,那么这些资源是从哪里来的呢?当然是“偷取”别人的数据咯.现在的问题就是,该怎么去爬取别人的资源呢,这里便从简单的开始,爬取一篇小说的第 ...

- 爬虫入门(四)——Scrapy框架入门:使用Scrapy框架爬取全书网小说数据

为了入门scrapy框架,昨天写了一个爬取静态小说网站的小程序 下面我们尝试爬取全书网中网游动漫类小说的书籍信息. 一.准备阶段 明确一下爬虫页面分析的思路: 对于书籍列表页:我们需要知道打开单本书籍 ...

- scrapy进阶(CrawlSpider爬虫__爬取整站小说)

# -*- coding: utf-8 -*- import scrapy,re from scrapy.linkextractors import LinkExtractor from scrapy ...

- Python的scrapy之爬取6毛小说网的圣墟

闲来无事想看个小说,打算下载到电脑上看,找了半天,没找到可以下载的网站,于是就想自己爬取一下小说内容并保存到本地 圣墟 第一章 沙漠中的彼岸花 - 辰东 - 6毛小说网 http://www.6ma ...

- 使用scrapy爬取金庸小说目录和章节url

刚接触使用scrapy的时候,如果一开始就想实现特别复杂的配置,显然是不太现实的,用一些小的例子可以帮助自己理解各个模块. 今天的目标:爬取http://www.luoxia.com/shendiao ...

- 网络字体反爬之pyspider爬取起点中文小说

前几天跟同事聊到最近在看什么小说,想起之前看过一篇文章说的是网络十大水文,就想把起点上的小说信息爬一下,搞点可视化数据看看.这段时间正在看爬虫框架-pyspider,觉得这种网站用框架还是很方便的,所 ...

- 使用requests+BeautifulSoup爬取龙族V小说

这几天想看龙族最新版本,但是搜索半天发现 没有网站提供 下载, 我又只想下载后离线阅读(写代码已经很费眼睛了).无奈只有自己 爬取了. 这里记录一下,以后想看时,直接运行脚本 下载小说. 这里是从 ...

- 爬虫入门实例:利用requests库爬取笔趣小说网

w3cschool上的来练练手,爬取笔趣看小说http://www.biqukan.com/, 爬取<凡人修仙传仙界篇>的所有章节 1.利用requests访问目标网址,使用了get方法 ...

随机推荐

- 设置NX欢迎界面

环境变量 变量名:UGII_WELCOME_PAGE 变量值:http://www.baidu.com/

- OO unit4 summary

Unit4 一.第四单元作业的架构设计 第四单元个人认为主要是考察对于层次结构的理解,即如何理解并处理好UML图的树状结构组织,在理好层次之间以及层次内部的相互关系之后,就只剩下代码实现的问题了.但是 ...

- OO unit3 summary

Unit3 JML(Java Modeling Language) 是用于对 Java 程序进行规格化设计的一种表示语言,它对于方法内部具体是如何实现的并无要求,只是对方法的接口以及行为进行限制, ...

- 在element的table修改事件中修改数据,table的数据也会修改

大家在修改的时候有的会通过点击事件里面获取点击列表的值然后去赋值,但是row是Object对象类型,如果直接赋值的话,就变成了浅拷贝,复制的是地址,导致在表单中改变值的时候table中的数据也跟着改变 ...

- kubelet分析-pvc扩容源码分析

kubernetes ceph-csi分析目录导航 存储的扩容分为controller端操作与node端操作两大步骤,controller端操作由external-resizer来调用ceph完成,而 ...

- 四、JavaSE语言基础之运算符

什么是是运算符 运算符:用于数据运算的符号,运算是一种处理.(注:浮点型数据(float.double)进行运算会出现精度丢失的情况) 运算符大致可分为以下六种: 一.算术运算符:+.-.*./.%. ...

- mysql_my.cnf文件详解

以下是 my.cnf 配置文件参数解释:#*** client options 相关选项 ***##以下选项会被MySQL客户端应用读取.注意只有MySQL附带的客户端应用程序保证可以读取这段内容.如 ...

- 12、windows定时备份数据库

12.1.删除指定目录中的内容: del /Q E:\DATABAK\* copy 1.txt bak\a.txt 12.2.可用的备份计划: 1.脚本: BakScripts @echo off R ...

- 通过PLSQL创建Database link,DBMS_Job,Procedure,实现Oracle跨库传输数据

前一阵领导安排了一个任务:定时将集团数据库某表的数据同步至我们公司服务器的数据库,感觉比写增删改查SQL有趣,特意记录下来,希望能帮到有类似需求的小伙伴,如有错误也希望各位不吝指教 环境描述: 集团数 ...

- Redis 底层数据结构之整数集合

文章参考:<Redis 设计与实现>黄建宏 整数集合 整数集合时集合键的底层实现之一,当一个集合只包含整数值元素,并且这个集合数量不多时,就会使用整数集合 typedef struct i ...