Python3爬虫之爬取某一路径的所有html文件

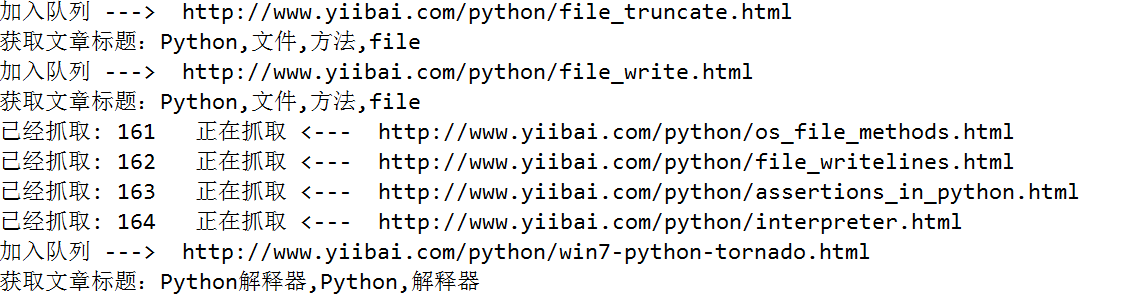

要离线下载易百教程网站中的所有关于Python的教程,需要将Python教程的首页作为种子url:http://www.yiibai.com/python/,然后按照广度优先(广度优先,使用队列;深度优先,使用栈),依次爬取每一篇关于Python的文章。为了防止同一个链接重复爬取,使用集合来限制同一个链接只处理一次。

使用正则表达式提取网页源码里边的文章标题和文章url,获取到了文章的url,使用Python根据url生成html文件十分容易。

-

import re

-

import urllib.request

-

import urllib

-

from collections import deque

-

# 保存文件的后缀

-

SUFFIX='.html'

-

# 提取文章标题的正则表达式

-

REX_TITLE=r'<title>(.*?)</title>'

-

# 提取所需链接的正则表达式

-

REX_URL=r'/python/(.+?).html'

-

# 种子url,从这个url开始爬取

-

BASE_URL='http://www.yiibai.com/python/'

-

-

-

# 将获取到的文本保存为html文件

-

def saveHtml(file_name,file_content):

-

# 注意windows文件命名的禁用符,比如 /

-

with open (file_name.replace('/','_')+SUFFIX,"wb") as f:

-

# 写文件用bytes而不是str,所以要转码

-

f.write(bytes(file_content, encoding = "utf8"))

-

# 获取文章标题

-

def getTitle(file_content):

-

linkre = re.search(REX_TITLE,file_content)

-

if(linkre):

-

print('获取文章标题:'+linkre.group(1))

-

return linkre.group(1)

-

-

# 爬虫用到的两个数据结构,队列和集合

-

queue = deque()

-

visited = set()

-

# 初始化种子链接

-

queue.append(BASE_URL)

-

count = 0

-

-

while queue:

-

url = queue.popleft() # 队首元素出队

-

visited |= {url} # 标记为已访问

-

-

print('已经抓取: ' + str(count) + ' 正在抓取 <--- ' + url)

-

count += 1

-

urlop = urllib.request.urlopen(url)

-

# 只处理html链接

-

if 'html' not in urlop.getheader('Content-Type'):

-

continue

-

-

# 避免程序异常中止

-

try:

-

data = urlop.read().decode('utf-8')

-

title=getTitle(data);

-

# 保存文件

-

saveHtml(title,data)

-

except:

-

continue

-

-

# 正则表达式提取页面中所有链接, 并判断是否已经访问过, 然后加入待爬队列

-

linkre = re.compile(REX_URL)

-

for sub_link in linkre.findall(data):

-

sub_url=BASE_URL+sub_link+SUFFIX;

-

# 已经访问过,不再处理

-

if sub_url in visited:

-

pass

-

else:

-

# 设置已访问

-

visited |= {sub_url}

-

# 加入队列

-

queue.append(sub_url)

-

print('加入队列 ---> ' + sub_url)

Python3爬虫之爬取某一路径的所有html文件的更多相关文章

- 【Python3爬虫】爬取美女图新姿势--Redis分布式爬虫初体验

一.写在前面 之前写的爬虫都是单机爬虫,还没有尝试过分布式爬虫,这次就是一个分布式爬虫的初体验.所谓分布式爬虫,就是要用多台电脑同时爬取数据,相比于单机爬虫,分布式爬虫的爬取速度更快,也能更好地应对I ...

- python3 爬虫之爬取安居客二手房资讯(第一版)

#!/usr/bin/env python3 # -*- coding: utf-8 -*- # Author;Tsukasa import requests from bs4 import Beau ...

- python3爬虫应用--爬取网易云音乐(两种办法)

一.需求 好久没有碰爬虫了,竟不知道从何入手.偶然看到一篇知乎的评论(https://www.zhihu.com/question/20799742/answer/99491808),一时兴起就也照葫 ...

- 使用htmlparse爬虫技术爬取电影网页的全部下载链接

昨天,我们利用webcollector爬虫技术爬取了网易云音乐17万多首歌曲,而且还包括付费的在内,如果时间允许的话,可以获取更多的音乐下来,当然,也有小伙伴留言说这样会降低国人的知识产权保护意识,诚 ...

- [Python爬虫] Selenium爬取新浪微博客户端用户信息、热点话题及评论 (上)

转载自:http://blog.csdn.net/eastmount/article/details/51231852 一. 文章介绍 源码下载地址:http://download.csdn.net/ ...

- from appium import webdriver 使用python爬虫,批量爬取抖音app视频(requests+Fiddler+appium)

使用python爬虫,批量爬取抖音app视频(requests+Fiddler+appium) - 北平吴彦祖 - 博客园 https://www.cnblogs.com/stevenshushu/p ...

- 使用htmlparser爬虫技术爬取电影网页的全部下载链接

昨天,我们利用webcollector爬虫技术爬取了网易云音乐17万多首歌曲,而且还包括付费的在内,如果时间允许的话,可以获取更多的音乐下来,当然,也有小伙伴留言说这样会降低国人的知识产权保护意识,诚 ...

- 【Python】【爬虫】爬取酷狗TOP500

好啦好啦,那我们来拉开我们的爬虫之旅吧~~~ 这一只小爬虫是爬取酷狗TOP500的,使用的爬取手法简单粗暴,目的是帮大家初步窥探爬虫长啥样,后期会慢慢变得健壮起来的. 环境配置 在此之前需要下载一个谷 ...

- Python爬虫之爬取站内所有图片

title date tags layut Python爬虫之爬取站内所有图片 2018-10-07 Python post 目标是 http://www.5442.com/meinv/ 如需在非li ...

随机推荐

- nios DMA使用注意事项

1.对同一个设备的多次DMA读写操作之间如果并行,有可能会导致数据传输错误.可以在程序中对每次DMA操作进行等待.如下: 点击(此处)折叠或打开 void dma_done(void *p) { in ...

- 制作 Gif 工具

ScreenToGif:非常小,非常强大: 从此可以十分方便地从视频中抠 gif 出来了: 以及制作一些教学类小 gif,插入到网页中: 丰富的编辑功能: 插入文本,插入标题,插入图像等: 下载地址: ...

- HDFS的安全模式

- javascript中的那些宽度和高度

window.outerHeight和window.outerWidth 表示整个浏览器窗体的大小,包括任务栏等. IE9及以上 window.innerHeight和window.in ...

- Gson解析List的一点小问题

这阵子在使用gson解析时遇到了点小麻烦,因为一直用的fastjson,最近一个项目里使用的gson,需要解析list集合,查资料都是使用TypeToken解决,相对比较麻烦,下面为大伙推荐一种简便的 ...

- 【AngularJS学习笔记】AngularJS表单验证

AngularJS表单验证 AngularJS提供了一些自带的验证属性 1.novalidate:添加到HTML的表单属性中,用于禁用浏览器默认的验证. 2.$dirty 表单有填写记录 3.$v ...

- LINUX 上源代码安装与配置samba服务,支持从windows上读写LINUX文件。

###动机###在windows编写代码文件比较方便,因为有source insight.但是需要在LINUX上编译.一种办法就是使用samba文件共享. [1] 下载samba代码.按照config ...

- NodeJS学习笔记 (12)网络地址解析-url(ok)

模块概述 nodejs中,提供了url这个非常实用的模块,用来做URL的解析.在做node服务端的开发时会经常用到.使用很简单,总共只有3个方法. 正式讲解前,各位同学先把下面这个图记在心上(来自no ...

- Tp5 的 validate 自动验证

tp5自带的验证功能: 用法之一: $validate = new \think\Validate([ ['name', 'require|alphaDash', '用户名不能为空|用户名格式只能是字 ...

- Python爬虫基础示例

使用pip安装相关依赖: pip install requests pip install bs4 安装成功提示:Successfully installed *... 爬取中国天气网数据示例代码: ...