可视化自编码器训练结果&稀疏自编码器符号一览表

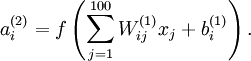

训练完(稀疏)自编码器,我们还想把这自编码器学习到的函数可视化出来,好弄明白它到底学到了什么。我们以在10×10图像(即n=100)上训练自编码器为例。在该自编码器中,每个隐藏单元i对如下关于输入的函数进行计算:

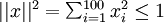

我们将要可视化的函数,就是上面这个以2D图像为输入,并由隐藏单元i计算出来的函数。它是依赖于参数 的(暂时忽略偏置项bi)。需要注意的是,

的(暂时忽略偏置项bi)。需要注意的是, 可看作输入

可看作输入 的非线性特征。不过还有个问题:什么样的输入图像x可以让可让

的非线性特征。不过还有个问题:什么样的输入图像x可以让可让 得到最大程度的激励?(通俗一点说,隐藏单元

得到最大程度的激励?(通俗一点说,隐藏单元 要找个什么样的特征?)。这里我们必须给x加个约束,否则会得到平凡解。若假设输入有范数约束

要找个什么样的特征?)。这里我们必须给x加个约束,否则会得到平凡解。若假设输入有范数约束 ,则可证。令隐藏单元i得到最大激励的输入应该由下面公式计算的像素

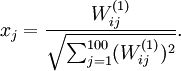

,则可证。令隐藏单元i得到最大激励的输入应该由下面公式计算的像素 给出(共需计算100个像素,j=1,...,100):

给出(共需计算100个像素,j=1,...,100):

当我们用上式算出各像素的值、把它们组成一幅图像、并将图像呈现在我们面前之时,隐藏单元i所追寻特征的真正含义也渐渐明朗起来???。

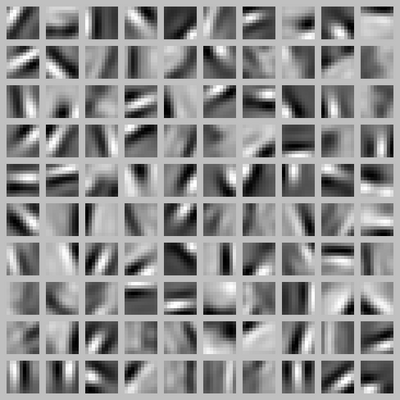

假如我们训练的自编码器有100个隐藏单元,可视化结果就会包含100幅这样的图像——每个隐藏单元都对应一幅图像。审视这100幅图像,我们可以试着体会这些隐藏单元学出来的整体效果是什么样的。

当我们对稀疏自编码器(100个隐藏单元,在10X10像素的输入上训练 )进行上述可视化处理之后,结果如下所示:

上图的每一个小方块都给出可一个(带有有界范数的)输入图像x,它可以使这100个隐藏单元中的某一个获得最大激励。我们可以看到,不同的隐藏单元学会了在图像的不同位置和方向进行边缘检测。

显而易见,这些特征对物体识别等计算视觉任务是十分有用的。若将其用于其他输入域(如音频),该算法也可学到对这些输入域有用的表示或特征。

稀疏自编码器符号一览表

下面是我们在推导sparse autoencoder时使用的符号一览表:

| 符号 | 含义 |

|

训练样本的输入特征, . . |

|

输出值/目标值. 这里  可以是向量. 在autoencoder中, 可以是向量. 在autoencoder中, . . |

|

第  个训练样本 个训练样本 |

|

输入为  时的假设输出,其中包含参数 时的假设输出,其中包含参数 . 该输出应当与目标值 . 该输出应当与目标值  具有相同的维数. 具有相同的维数. |

|

连接第  层 层  单元和第 单元和第  层 层  单元的参数. 单元的参数. |

|

第  层 层  单元的偏置项. 也可以看作是连接第 单元的偏置项. 也可以看作是连接第  层偏置单元和第 层偏置单元和第  层 层  单元的参数. 单元的参数. |

|

参数向量. 可以认为该向量是通过将参数 组合展开为一个长的列向量而得到. 组合展开为一个长的列向量而得到. |

|

网络中第  层 层  单元的激活(输出)值. 单元的激活(输出)值.

另外,由于 |

|

激活函数. 本文中我们使用  . . |

|

第  层 层  单元所有输入的加权和. 因此有 单元所有输入的加权和. 因此有  . . |

|

学习率 |

|

第  层的单元数目(不包含偏置单元). 层的单元数目(不包含偏置单元). |

|

网络中的层数. 通常  层是输入层, 层是输入层, 层是输出层. 层是输出层. |

|

权重衰减系数. |

|

对于一个autoencoder,该符号表示其输出值;亦即输入值  的重构值. 与 的重构值. 与  含义相同. 含义相同. |

|

稀疏值,可以用它指定我们所需的稀疏程度 |

|

(sparse autoencoder中)隐藏单元  的平均激活值. 的平均激活值. |

|

(sparse autoencoder目标函数中)稀疏值惩罚项的权重. |

可视化自编码器训练结果&稀疏自编码器符号一览表的更多相关文章

- 深度学习入门教程UFLDL学习实验笔记一:稀疏自编码器

UFLDL即(unsupervised feature learning & deep learning).这是斯坦福网站上的一篇经典教程.顾名思义,你将在这篇这篇文章中学习到无监督特征学习和 ...

- DL二(稀疏自编码器 Sparse Autoencoder)

稀疏自编码器 Sparse Autoencoder 一神经网络(Neural Networks) 1.1 基本术语 神经网络(neural networks) 激活函数(activation func ...

- Deep Learning学习随记(一)稀疏自编码器

最近开始看Deep Learning,随手记点,方便以后查看. 主要参考资料是Stanford 教授 Andrew Ng 的 Deep Learning 教程讲义:http://deeplearnin ...

- Sparse autoencoder implementation 稀疏自编码器实现

任务:在这个问题中,你将实现稀疏自编码器算法,并且展示它怎么发现边缘是自然图像的一个好的表示. 在文件 sparseae_exercise.zip中,我们已经提供了一些Matlab中的初始代码,你应该 ...

- 稀疏自编码器及TensorFlow实现

自动编码机更像是一个识别网络,只是简单重构了输入.而重点应是在像素级重构图像,施加的唯一约束是隐藏层单元的数量. 有趣的是,像素级重构并不能保证网络将从数据集中学习抽象特征,但是可以通过添加更多的约束 ...

- UFLDL教程(一)---稀疏自编码器

神经网络模型 简单的神经网络 前向传播 代价函数 对于单个例子 .其代价函数为: 给定一个包括m个例子的数据集,我们能够定义总体代价函数为: 以上公式中的第一项 是一个均方差项. 第二项是一个规则化 ...

- tesorflow - create neural network+结果可视化+加速神经网络训练+Optimizer+TensorFlow

以下仅为了自己方便查看,绝大部分参考来源:莫烦Python,建议去看原博客 一.添加层 def add_layer() 定义 add_layer()函数 在 Tensorflow 里定义一个添加层的函 ...

- sklearn 可视化模型的训练测试收敛情况和特征重要性

show the code: # Plot training deviance def plot_training_deviance(clf, n_estimators, X_test, y_test ...

- Deep Learning 教程(斯坦福深度学习研究团队)

http://www.zhizihua.com/blog/post/602.html 说明:本教程将阐述无监督特征学习和深度学习的主要观点.通过学习,你也将实现多个功能学习/深度学习算法,能看到它们为 ...

随机推荐

- MySQL高级第五章——主从复制

一.复制的基本原理 slave会从master读取binlog(二进制日志文件)进行数据同步 步骤: 详细操作步骤请参见:http://www.cnblogs.com/luckcs/articles/ ...

- 成都Uber优步司机奖励政策(1月18日)

滴快车单单2.5倍,注册地址:http://www.udache.com/ 如何注册Uber司机(全国版最新最详细注册流程)/月入2万/不用抢单:http://www.cnblogs.com/mfry ...

- STM32的GUI库使用

1. 实验平台使用百为的STM32F103开发板 2. 例程目录\百为stm32开发板光盘\stm32_gui_lib\Project\Embedded_GUI_Example\EWARM 3. 直接 ...

- php安全性问题

目录 常见攻击类型 1.sql注入: 2.xss攻击 3.csrf攻击: php安全三板斧:过滤输入.验证数据,以及转义输出. 1.数据过滤: 2.验证数据: 3.转义输出: laravel 中如何避 ...

- javaweb(五)——Servlet开发(一)

一.Servlet简介 Servlet是sun公司提供的一门用于开发动态web资源的技术. Sun公司在其API中提供了一个servlet接口,用户若想用发一个动态web资源(即开发一个Java程序向 ...

- 浅谈如何提高自动化测试的稳定性和可维护性 (pytest&allure)

装饰器与出错重试机制 谈到稳定性,不得不说的就是“出错重试”机制了,在自动化测试中,由于环境一般都是测试环境,经常会有各种各种的抽风情况影响测试结果,这样就为测试的稳定性带来了挑战,毕竟谁也不想自己的 ...

- 第二篇 CSS快速入门

学CSS 和 JS的路线: 1. 首先,学会怎么找到标签.只有找到标签,才能操作标签——CSS通过选择器去找标签 2. 其次,学会怎么操作标签对象. CSS概述 CSS是Cascading Style ...

- leetcode-全排列详解(回溯算法)

全排列 给定一个没有重复数字的序列,返回其所有可能的全排列. 示例: 输入: [1,2,3] 输出: [ [1,2,3], [1,3,2], [2,1,3], [2,3,1], [3,1,2 ...

- 【转】unity3d 资源文件从MAX或者MAYA中导出的注意事项

转自游戏开发主席 1.首先,Unity3d 中,导出带动画的资源有2种导出方式可以选择: 1) 导出资源时,只导出一个文件,保留模型,骨骼和所有的动作帧(把所有的动作,比如idle,atta ...

- Ubuntu—安装网络调试工具

https://pan.baidu.com/s/1G6oHXp3SvcN6HMAMqTdqhA 1,在ubuntu的终端下,切换到网络调试工具所在的目录 $ cd 桌面/ #我的放在桌面上 2, ...

.

.