Spark 2.2.0 分布式集群环境搭建

集群机器:

1台 装了 ubuntu 14.04的 台式机

1台 装了ubuntu 16.04 的 笔记本 (机器更多时同样适用)

1.需要安装好Hadoop分布式环境

参照:Hadoop分类 -->http://www.cnblogs.com/soyo/p/7868282.html

2.安装Spark2.2.0 到/usr/local2

sudo chmod -R 777 Spark( 此/usr/local2路径下的被解压的spark("spark"名字是自己改的) )

3.配置环境变量

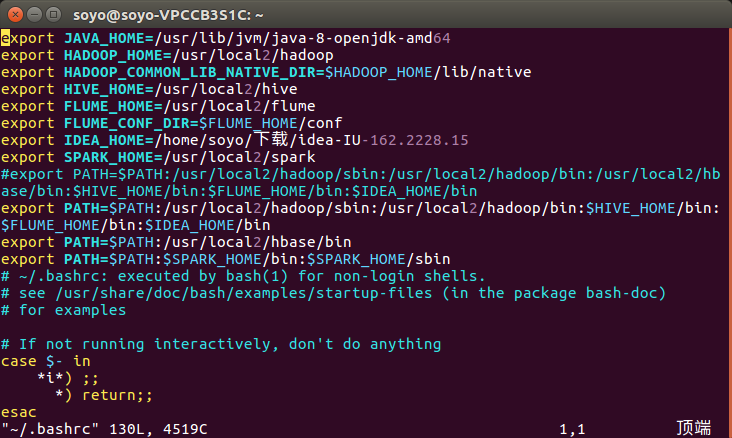

vim ~/.bashrc

添加:

export SPARK_HOME=/usr/local2/spark

export PATH=$PATH:$SPARK_HOME/bin:$SPARK_HOME/sbin

source ~/.bashrc

4.Spark分布式配置:

在Master节点主机上进行如下操作:

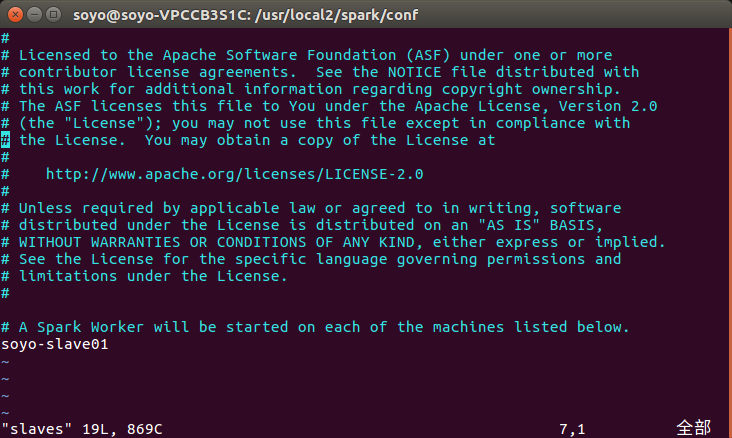

1.配置 slaves:slaves文件设置Worker节点

cd /usr/local2/spark/conf

cp ./slaves.template ./slaves

vim slaves

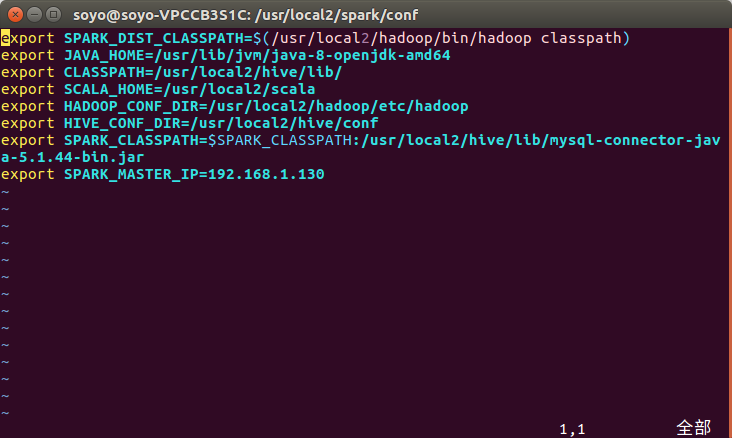

2.配置 spark-env.sh (刚开始这个文件也是没有的)( cp ./spark-env.sh.template ./spark-env.sh)

这里就加了 export SPARK_MASTER_IP=192.168.1.130 (别的是以前在非分布式情况下使用Spark需要时添加的)

SPARK_MASTER_IP 指定 Spark 集群 Master 节点的 IP 地址;

4.给节点分发Spark配置:

cd /usr/local2

tar -zcf ~/ spark.tar.gz ./spark

cd ~

scp ./spark.tar.gz soyo-slave01:/home/soyo

在soyo-slave01节点上分别执行下面同样的操作:

sudo tar -zxf spark.tar.gz -C /usr/local2

sudo chmod -R 777 spark

4.启动Spark集群:

4.1先启动分布式Hadoop:

在master节点执行:start-all.sh

4.2启动Spark:

启动Master节点:

在master节点执行:start-master.sh (在soyo-VPCCB3S1C节点执行jps:多了Master这个进程)

启动slave节点:

在master节点执行:start-slaves.sh (在soyo-slave01节点执行jps:多了Worker这个进程)

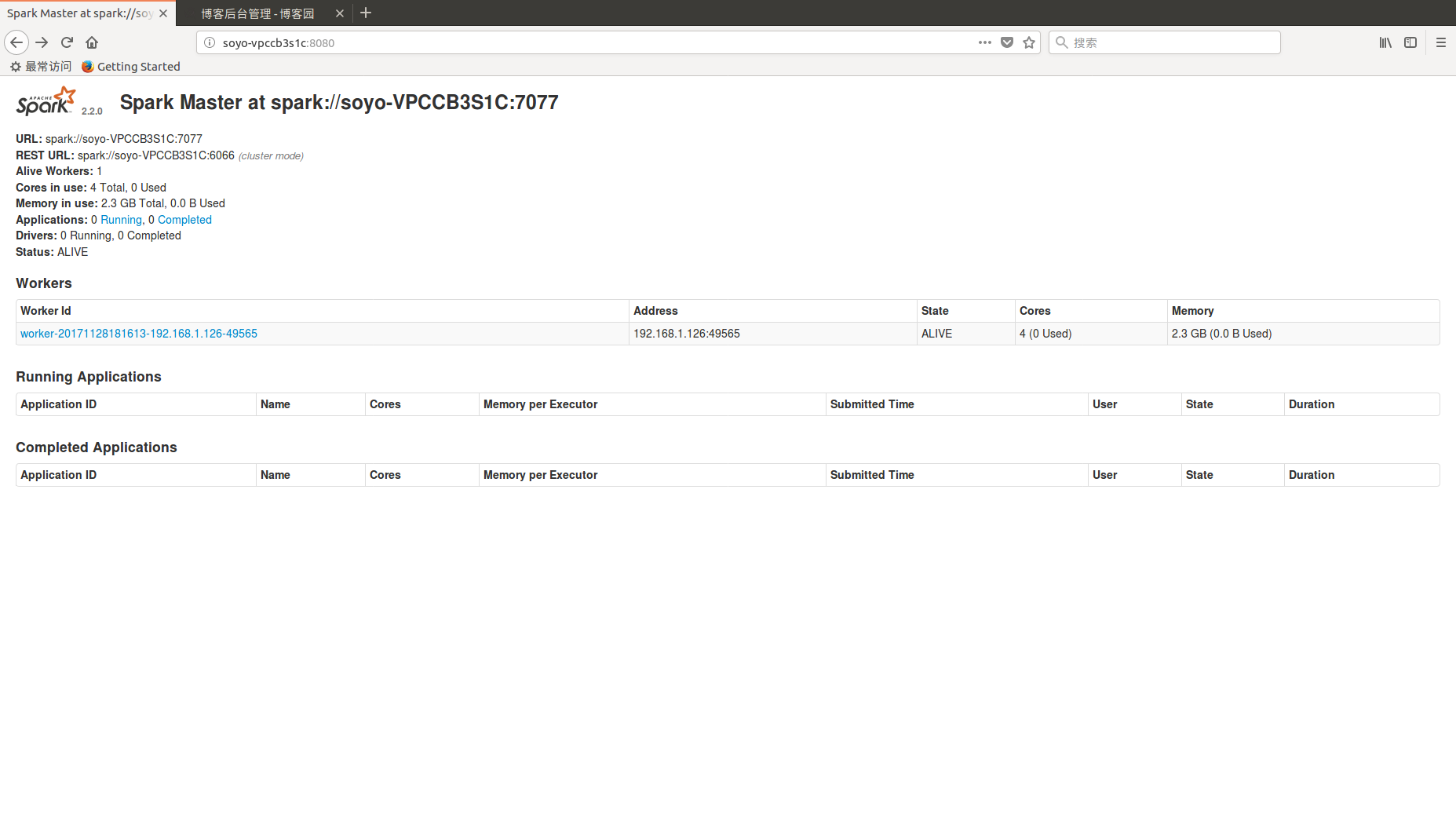

4.3在浏览器上查看Spark独立集群管理器的集群信息

http://soyo-vpccb3s1c:8080/

4.关闭Spark集群:

Spark 2.2.0 分布式集群环境搭建的更多相关文章

- Spark 1.6.1分布式集群环境搭建

一.软件准备 scala-2.11.8.tgz spark-1.6.1-bin-hadoop2.6.tgz 二.Scala 安装 1.master 机器 (1)下载 scala-2.11.8.tgz, ...

- Hadoop完全分布式集群环境搭建

1. 在Apache官网下载Hadoop 下载地址:http://hadoop.apache.org/releases.html 选择对应版本的二进制文件进行下载 2.解压配置 以hadoop-2.6 ...

- Kafka 完全分布式集群环境搭建

思路: 先在主机s1上安装配置,然后远程复制到其它两台主机s2.s3上, 并分别修改配置文件server.properties中的broker.id属性. 1. 搭建前准备 示例共三台主机,主机IP映 ...

- ZooKeeper 完全分布式集群环境搭建

1. 搭建前准备 示例共三台主机,主机IP映射信息如下: 192.168.32.101 s1 192.168.32.102 s2 192.168.32.103 s3 2.下载ZooKeeper, 以 ...

- Hadoop伪分布式集群环境搭建

本教程讲述在单机环境下搭建Hadoop伪分布式集群环境,帮助初学者方便学习Hadoop相关知识. 首先安装Hadoop之前需要准备安装环境. 安装Centos6.5(64位).(操作系统再次不做过多描 ...

- 阿里云ECS服务器部署HADOOP集群(一):Hadoop完全分布式集群环境搭建

准备: 两台配置CentOS 7.3的阿里云ECS服务器: hadoop-2.7.3.tar.gz安装包: jdk-8u77-linux-x64.tar.gz安装包: hostname及IP的配置: ...

- Hadoop学习(一):完全分布式集群环境搭建

1. 设置免密登录 (1) 新建普通用户hadoop:useradd hadoop(2) 在主节点master上生成密钥对,执行命令ssh-keygen -t rsa便会在home文件夹下生成 .ss ...

- Hadoop+HBase+ZooKeeper分布式集群环境搭建

一.环境说明 集群环境至少需要3个节点(也就是3台服务器设备):1个Master,2个Slave,节点之间局域网连接,可以相互ping通,下面举例说明,配置节点IP分配如下: Hostname IP ...

- IBM BigInsights 3.0.0.2 集群环境搭建

1. 改动hosts文件和永久主机名 由于BigInsights 3.0版本号不像之前的版本号能够直接用IP来添加节点,因此我们须要更改每台server的hosts文件和主机名: vim/etc/ho ...

随机推荐

- 基于vue实现模糊匹配(这里以邮箱模糊匹配为例,其他的模糊匹配都可以类比)

html部分(主要部分): js: data: methods: 效果图:

- JS 去除字符串空格

$.trim()是jQuery提供的函数,用于去掉字符串首尾的空白字符. "abc 123 def".replace(/\s/g, "") 去除所有的空格

- CodeForces 221D Little Elephant and Array

Little Elephant and Array Time Limit: 4000ms Memory Limit: 262144KB This problem will be judged on C ...

- 如何实现IIS 7.0对非HTTP协议的支持

在<再谈IIS与ASP.NET管道>介绍各种版本的IIS的设计时,我们谈到IIS 7.0因引入WAS提供了对非HTTP协议的支持.这个对于WCF的服务寄宿来说意义重大,它意味着我们通过II ...

- DRF JWT的用法 & Django的自定义认证类 & DRF 缓存

JWT 相关信息可参考: https://www.jianshu.com/p/576dbf44b2ae DRF JWT 的使用方法: 1. 安装 DRF JWT # pip install djang ...

- [thrift] thrift基本原理及使用

参考文章RPC 基本原理与 Apach Thrift 初体验 RPC基本原理 RPC(Remote Procedure Call),远程过程调用,大部分的RPC框架都遵循如下三个开发步骤: 1. 定义 ...

- 自己打断点走的struts流程&拦截器工作原理

①. 请求发送给 StrutsPrepareAndExecuteFilter ②. StrutsPrepareAndExecuteFilter 判定该请求是否是一个 Struts2 请 求(Actio ...

- 洛谷——P1007 独木桥

P1007 独木桥 题目背景 战争已经进入到紧要时间.你是运输小队长,正在率领运输部队向前线运送物资.运输任务像做题一样的无聊.你希望找些刺激,于是命令你的士兵们到前方的一座独木桥上欣赏风景,而你留在 ...

- Balanced Binary Tree (二叉树DFS)

Given a binary tree, determine if it is height-balanced. For this problem, a height-balanced binary ...

- Java:删除某文件夹下的所有文件

import java.io.File;public class Test{ public static void main(String args[]){ Test t = new Test(); ...