读论文《Distilling the Knowledge in a Neural Network》——蒸馏网络 —— 蒸馏算法 —— 知识蒸馏 中的温度系数到底怎么用, temperature怎么用?

论文地址:

https://arxiv.org/pdf/1503.02531.pdf

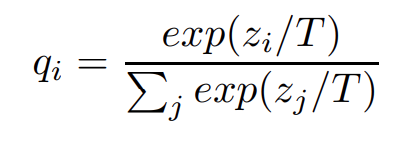

蒸馏网络的重要公式:

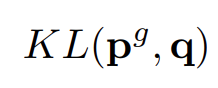

其中,\(p^g\)为Teacher网络,\(q\)为Student网络。

个体神经网络(CNN模型):

CNN层 + 全连接层(输出的是logits) + softmax层(输出的是预测值概率P) + 交叉熵损失函数

蒸馏算法:

第一步:使用训练数据集训练Teacher网络,这时候的logits是不使用Temperature参数调控的,和正常算法流程一致;

第二步:使用Teacher网络的\(p^{g}\)和Student网络的\(q\)使用\(KL(p^{g}, q)\)来训练Student网络,需要注意这时的\(p^{g}\)和\(q\)都是使用在对各自的logits使用Temerature系数之后的,并且需要注意这里的Temperature可以视作为一个超参数,并且在使用Teacher网络训练Student网络时使用的训练数据集和单独训练Teacher网络的数据集一致;

第三步:完成Student网络训练后进行测试,注意,这时的Student网络是不需要对logits使用Temperature参数调控的,也就是说测试Student网络时是和普通算法流程一致的,是不使用Temperature参数的。

可以说,在蒸馏算法中这个Temperature是一个超参数形式的存在,并且只存在于使用Teacher网络训练Student网络的时候,其主要原因是这时候如果只是使用概率P进行训练则难以解决概率分布不均衡的情况,并且也无法识别不同logits得到相同P的情况,如果只使用logits则也无法计算时的单位不统一的问题,为此论文中提出对logits加入Temperature系数调整,并用KL散度进行Student网络的训练。

很多人不理解这个知识蒸馏算法,其主要障碍就是不理解这个Temperature系数上,其实这个系数只是一个超参,并且在实际训练时也只是起到一个调节的作用,虽然这个Temperature系统对算法的最终performance影响很大,但是却并不神秘。

读论文《Distilling the Knowledge in a Neural Network》——蒸馏网络 —— 蒸馏算法 —— 知识蒸馏 中的温度系数到底怎么用, temperature怎么用?的更多相关文章

- 【DKNN】Distilling the Knowledge in a Neural Network 第一次提出神经网络的知识蒸馏概念

原文链接 小样本学习与智能前沿 . 在这个公众号后台回复"DKNN",即可获得课件电子资源. 文章已经表明,对于将知识从整体模型或高度正则化的大型模型转换为较小的蒸馏模型,蒸馏非常 ...

- 【论文考古】知识蒸馏 Distilling the Knowledge in a Neural Network

论文内容 G. Hinton, O. Vinyals, and J. Dean, "Distilling the Knowledge in a Neural Network." 2 ...

- Distilling the Knowledge in a Neural Network

url: https://arxiv.org/abs/1503.02531 year: NIPS 2014   简介 将大模型的泛化能力转移到小模型的一种显而易见的方法是使用由大模型产生的类概率作 ...

- ASPLOS'17论文导读——SC-DCNN: Highly-Scalable Deep Convolutional Neural Network using Stochastic Computing

今年去参加了ASPLOS 2017大会,这个会议总体来说我感觉偏系统和偏软一点,涉及硬件的相对少一些,对我这个喜欢算法以及硬件架构的菜鸟来说并不算非常契合.中间记录了几篇相对比较有趣的paper,今天 ...

- 论文翻译:2019_TCNN: Temporal convolutional neural network for real-time speech enhancement in the time domain

论文地址:TCNN:时域卷积神经网络用于实时语音增强 论文代码:https://github.com/LXP-Never/TCNN(非官方复现) 引用格式:Pandey A, Wang D L. TC ...

- 论文笔记之:Decoupled Deep Neural Network for Semi-supervised Semantic Segmentation

Decoupled Deep Neural Network for Semi-supervised Semantic Segmentation xx

- 论文笔记:ReNet: A Recurrent Neural Network Based Alternative to Convolutional Networks

ReNet: A Recurrent Neural Network Based Alternative to Convolutional Networks2018-03-05 11:13:05 ...

- 【论文考古】Training a 3-Node Neural Network is NP-Complete

今天看到一篇1988年的老文章谈到了训练一个简单网络是NPC问题[1].也就是下面的网络结构,在线性激活函数下,如果要找到参数使得输入数据的标签估计准确,这个问题是一个NPC问题.这个文章的意义在于宣 ...

- 1503.02531-Distilling the Knowledge in a Neural Network.md

原来交叉熵还有一个tempature,这个tempature有如下的定义: \[ q_i=\frac{e^{z_i/T}}{\sum_j{e^{z_j/T}}} \] 其中T就是tempature,一 ...

- 源自人脑的神奇算法 -- 读《How to make your own neural network》有感

最近读到了一本很好的关于机器学习-深度学习的书值得推荐下并特意做了这个学习总结. 为什么推荐 在我认为好书(计算机类)的评判有几个标准: 试图以通俗的语言阐述,并在引入任何新概念的时候都讲述来龙去脉, ...

随机推荐

- kettle从入门到精通 第五十课 ETL之kettle 课程源文件分享

Kettle 是一款功能强大的开源 ETL 工具,被广泛应用于数据集成.数据转换和数据加载等领域.随着数据量和多样性的不断增加,使用 Kettle 进行数据处理已成为许多企业和数据工程师的首选.在过去 ...

- epoll使用与原理

使用要点 边缘模式(ET)与水平模式(LT)区别 下面内容来自linux man page The epoll event distribution interface is able to beha ...

- java8 lambda Group分组示例

导入jar包<dependency> <groupId>com.alibaba</groupId> <artifactId>fastjson</a ...

- iOS开发之弹窗管理

前言 "千淘万漉虽辛苦,吹尽狂沙始到金."在这快速变化的互联网行业,身边的朋友有的选择了勇敢创业,有的则在技术的海洋中默默耕耘.时常在深夜反思,作为一个开发者,我们的价值何在?答案 ...

- onreadystatechange 属性

onreadystatechange 属性是 XMLHttpRequest 对象的一个事件处理器,用于在 XMLHttpRequest 对象的 readyState 属性发生变化时触发.这个属性通常用 ...

- 记一次反向代理过滤sql注入

公司有一php系统,由于该系统是购买的,并且没人懂php,无法通过修改代码过滤sql注入问题 代码如下: public class Program { public static void Main( ...

- mysql8.0.22在centos7.6下的简单安装

如果想把mysql安装得好一些,则严重推荐使用压缩包来安装,不推荐使用rpm方式. 一般情况下,现在大部分的服务器都是x86-64,少数是arm架构的. 选择合适的版本,下载即可. 本文中,使用的是 ...

- 用pm2命令管理你的node项目

文章目录 前言 安装 运行项目 pm2的命令 前言 我在服务器上运行node项目,使用命令nohup npm start &,结果关闭终端之后,进程就会停止,看来nohup也不是万能的后台运行 ...

- Linux Driver : i2c-gpio

# Linux Driver : i2c-gpio https://www.cnblogs.com/haoxing990/p/4718834.html https://blog.csdn.net/ji ...

- Freertos学习:在Posix环境仿真FreeRTOS

--- title: rtos-freertos-在Posix环境仿真FreeRTOS date: 2020-06-11 16:22:34 categories: tags: - freertos - ...