局部加权回归(Lowess)

代码示例:(源自:https://blog.csdn.net/weixin_71158509/article/details/136060826)

import numpy as np

import matplotlib.pyplot as plt

def local_weighted_regression(x, y, query_point, tau):

m = len(x)

weights = np.exp(-0.5 * ((x - query_point) / tau) ** 2)

X = np.column_stack((np.ones(m), x))

W = np.diag(weights)

theta = np.linalg.inv(X.T @ W @ X) @ X.T @ W @ y

return theta[0] + theta[1] * query_point

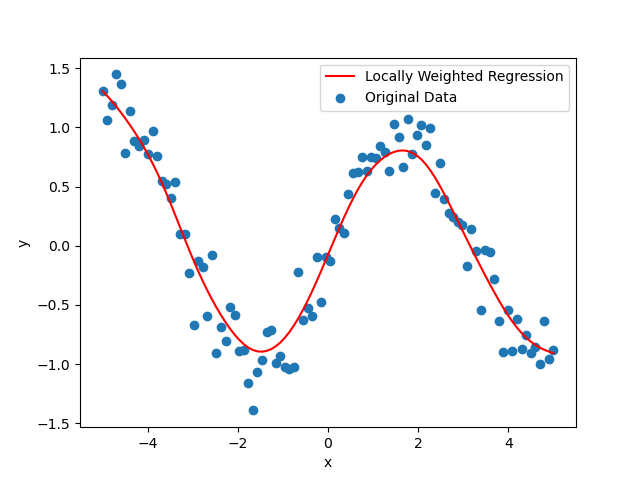

# 生成带噪声的非线性数据

np.random.seed(0)

x = np.linspace(-5, 5, 100)

y = np.sin(x) + np.random.normal(0, 0.2, 100)

# 设定tau参数

tau = 0.5

# 针对每个x点进行局部加权回归拟合

pred_y = [local_weighted_regression(x, y, query_point, tau) for query_point in x]

# 绘制原始数据和拟合曲线

plt.scatter(x, y, label='Original Data')

plt.plot(x, pred_y, color='red', label='Locally Weighted Regression')

plt.xlabel('x')

plt.ylabel('y')

plt.legend()

plt.show()

参考:

http://www.360doc.com/content/23/1114/09/1103876076_1103876076.shtml

https://blog.51cto.com/u_14405/10716690

https://blog.51cto.com/u_16213668/10656049

https://www.bilibili.com/video/BV1pFHxexE61

https://blog.csdn.net/longgb123/article/details/79520982

https://www.cnblogs.com/mooba/p/5947161.html

https://www.bilibili.com/video/BV1NP411K7eS/

局部加权回归(Lowess)的更多相关文章

- 局部加权回归LOWESS

1. LOWESS 用kNN做平均回归: \[ \hat{f(x)} = Ave(y_i | x_i \in N_k(x)) \] 其中,\(N_k(x)\)为距离点x最近k个点组成的邻域集合(nei ...

- Stanford大学机器学习公开课(三):局部加权回归、最小二乘的概率解释、逻辑回归、感知器算法

(一)局部加权回归 通常情况下的线性拟合不能很好地预测所有的值,因为它容易导致欠拟合(under fitting).如下图的左图.而多项式拟合能拟合所有数据,但是在预测新样本的时候又会变得很糟糕,因为 ...

- 第三集 欠拟合与过拟合的概念、局部加权回归、logistic回归、感知器算法

课程大纲 欠拟合的概念(非正式):数据中某些非常明显的模式没有成功的被拟合出来.如图所示,更适合这组数据的应该是而不是一条直线. 过拟合的概念(非正式):算法拟合出的结果仅仅反映了所给的特定数据的特质 ...

- [置顶] 局部加权回归、最小二乘的概率解释、逻辑斯蒂回归、感知器算法——斯坦福ML公开课笔记3

转载请注明:http://blog.csdn.net/xinzhangyanxiang/article/details/9113681 最近在看Ng的机器学习公开课,Ng的讲法循循善诱,感觉提高了不少 ...

- Robust Locally Weighted Regression 鲁棒局部加权回归 -R实现

鲁棒局部加权回归 [转载时请注明来源]:http://www.cnblogs.com/runner-ljt/ Ljt 作为一个初学者,水平有限,欢迎交流指正. 算法参考文献: (1) Robust L ...

- 线性回归 Linear regression(4) 局部加权回归

这篇文章将介绍过拟合和欠拟合的概念,并且介绍局部加权回归算法. 过拟合和欠拟合 之前在线性回归中,我们总是将单独的x作为我们的特征,但其实我们可以考虑将,甚至x的更高次作为我们的特征,那么我们通过线性 ...

- 局部加权回归(LWR) Matlab模板

将百度文库上一份局部加权回归的代码,将其改为模板以便复用. q2x,q2y为数据集,是n*1的矩阵: r是波长参数,就是对于距离的惩罚力度: q_x是要拟合的数据横坐标,是1*n的矩阵: 得到的q_y ...

- 局部加权回归、欠拟合、过拟合(Locally Weighted Linear Regression、Underfitting、Overfitting)

欠拟合.过拟合 如下图中三个拟合模型.第一个是一个线性模型,对训练数据拟合不够好,损失函数取值较大.如图中第二个模型,如果我们在线性模型上加一个新特征项,拟合结果就会好一些.图中第三个是一个包含5阶多 ...

- 局部加权回归、欠拟合、过拟合 - Andrew Ng机器学习公开课笔记1.3

本文主要解说局部加权(线性)回归.在解说局部加权线性回归之前,先解说两个概念:欠拟合.过拟合.由此引出局部加权线性回归算法. 欠拟合.过拟合 例如以下图中三个拟合模型.第一个是一个线性模型.对训练数据 ...

- Locally weighted linear regression(局部加权线性回归)

(整理自AndrewNG的课件,转载请注明.整理者:华科小涛@http://www.cnblogs.com/hust-ghtao/) 前面几篇博客主要介绍了线性回归的学习算法,那么它有什么不足的地方么 ...

随机推荐

- 一文带你理解URI 和 URL 有什么区别?

当我们打开浏览器,要访问一个网站或者一个ftp服务器的时候,一定要输入一串字符串, 比如: https://blog.csdn.net/ 或者: ftp://192.168.0.111/ 这样我们就可 ...

- 零基础学习人工智能—Python—Pytorch学习(八)

前言 本文介绍卷积神经网络的上半部分. 其实,学习还是需要老师的,因为我自己写文章的时候,就会想当然,比如下面的滑动窗口,我就会想当然的认为所有人都能理解,而实际上,我们在学习的过程中之所以卡顿的点多 ...

- Mac 使用远程 Ubuntu 机器进行时间备份

设置 SMB 服务 首先在 Ubuntu 中配置 SMB 服务.可以参考 Ubuntu 设置 SMB 服务. 创建 APFS 磁盘映像 我们在 Ubuntu 上创建出的 SMB 共享文件夹可以用来存放 ...

- Docker高级篇:实战Redis集群!从3主3从变为4主4从

通过前面两篇,我们学会了三主三从的Redis集群搭建及主从容错切换迁移,随着业务增加,可能会有主从扩容的,所以,本文我们来实战主从扩容 PS本系列:<Docker学习系列>教程已经发布的内 ...

- 移动端Android跟ios兼容性问题,反人类!!!

一.查询参数编码问题 我们在日常开发中,有时候会遇到拼接参数特别多的情况,那么就会导致一行代码特别长.那么为了美观呢,有的同学会进行换行处理,如下代码: 可以看到我红色框出来的地方就是经过了手动的回车 ...

- 立体视觉 StereoVision

双目相机 原理 [深度相机系列三]深度相机原理揭秘--双目立体视觉 StereoVision--立体视觉(1) StereoVision--立体视觉(2) StereoVision--立体视觉(3) ...

- maven jetty指定端口号启动

mvn jetty 启动指定端口号 方法 mvn jetty:run -Djetty.port=端口号 备注: 通过以上命令在 windows 中 powershell 下运行时,可能会碰到以下问题: ...

- 【题目全解】ACGO排位赛#12

ACGO 排位赛#12 - 题目解析 别问为什么没有挑战赛#11,因为挑战赛#11被贪心的 Yuilice 吃掉了(不是). 本次挑战赛难度相比较前面几次有所提升. 爆料:小鱼现在已经入职了研发部门, ...

- 所见即所得,赋能RAG:PDF解析里的段落识别

前几天,有一位用户使用OCR产品识别多栏论文后向我们询问:要怎么解决不合适的断句.分段以及错误阅读顺序的问题? 我们用一个相似案例为大家直观展示这位用户遇到的情况. 如图中的多栏期刊,如果用OCR识别 ...

- Angular 18+ 高级教程 – Component 组件 の ng-template

前言 上一篇 Dynamic Component 我们有提到,作为 MVVM 框架的 Angular 需要有方法替代掉 2 个 DOM Manipulation: document.createEle ...