SOTA激活函数学习

除了之前较为流行的RELU激活函数,最近又新出了几个效果较好的激活函数

一、BERT激活函数 - GELU(gaussian error linear units)高斯误差线性单元

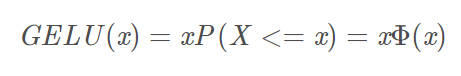

数学公式如下:

X是服从标准正态分布的变量。

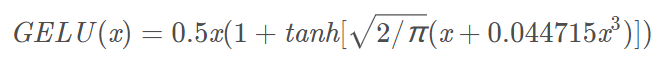

近似的数学计算公式如下:

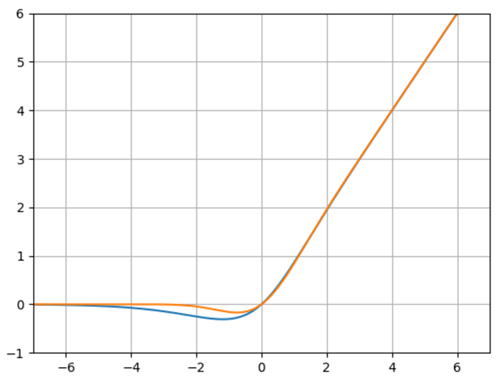

函数图如下:

橙色曲线为:GELU

蓝色曲线为:Mish函数

特性:当输入x减小的时候,输入会有一个更高的概率被dropout掉,这样的激活变换就会随机依赖于输入了,在激活中引入了随机正则的思想,是一种对神经元输入的概率描述。但是其实GELU相比Mish函数就要差一点,首先在大于0阶段,Mish函数的梯度是要略大于GELU,在负轴阶段Mish函数比GELU要晚一点趋近于0,也就是神经元能够晚一点死掉。

import math

import numpy as np

from matplotlib import pyplot as plt def mish(x):

return x * math.tanh(math.log(1+math.exp(x))) def GELU(x):

return 0.5*x*(1+math.tanh(math.sqrt(2/math.pi)*(x+0.044715*x**3))) x = np.linspace(-10,10,1000)

y=[]

z=[]

for i in x:

y.append(mish(i))

z.append(GELU(i))

plt.plot(x,y)

plt.plot(x,z)

plt.grid()

plt.ylim(-1,6)

plt.xlim(-7,7)

plt.show()

二、Mish激活函数

公式如下:

函数图如下:

橙色曲线为:ln(1+e^(x))

蓝色曲线为:Mish函数

import math

import numpy as np

from matplotlib import pyplot as plt def mish(x):

return x * math.tanh(math.log(1+math.exp(x))) def ln_e(x):

return math.log(1+math.exp(x)) x = np.linspace(-10,10,1000)

y=[]

z=[]

for i in x:

y.append(mish(i))

z.append(ln_e(i))

plt.plot(x,y)

plt.plot(x,z)

plt.grid()

plt.show()

SOTA激活函数学习的更多相关文章

- Mish:一个新的SOTA激活函数,ReLU的继任者

Mish:一个新的SOTA激活函数,ReLU的继任者 CVer 昨天 以下文章来源于AI公园 ,作者ronghuaiyang AI公园 专注分享干货的AI公众号,图像处理,NLP,深度学习,机器学 ...

- ML激活函数使用法则

sigmoid .tanh .ReLu tanh 函数或者双曲正切函数是总体上都优于 sigmoid 函数的激活函数. 基本已经不用 sigmoid 激活函数了,tanh 函数在所有场合都优于 sig ...

- deeplearning.ai课程学习(3)

第三周:浅层神经网络(Shallow neural networks) 1.激活函数(Activation functions) sigmoid函数和tanh函数两者共同的缺点是,在z特别大或者特别小 ...

- 吴恩达《深度学习》-第一门课 (Neural Networks and Deep Learning)-第三周:浅层神经网络(Shallow neural networks) -课程笔记

第三周:浅层神经网络(Shallow neural networks) 3.1 神经网络概述(Neural Network Overview) 使用符号$ ^{[

- [C1W3] Neural Networks and Deep Learning - Shallow neural networks

第三周:浅层神经网络(Shallow neural networks) 神经网络概述(Neural Network Overview) 本周你将学习如何实现一个神经网络.在我们深入学习具体技术之前,我 ...

- 论文阅读 | Text Processing Like Humans Do: Visually Attacking and Shielding NLP Systems

[code&data] [pdf] 主要工作 文章首先证明了对抗攻击对NLP系统的影响力,然后提出了三种屏蔽方法: visual character embeddings adversaria ...

- 《Neural Networks and Deep Learning》课程笔记

Lesson 1 Neural Network and Deep Learning 这篇文章其实是 Coursera 上吴恩达老师的深度学习专业课程的第一门课程的课程笔记. 参考了其他人的笔记继续归纳 ...

- [DeeplearningAI笔记]神经网络与深度学习3.2_3.11(激活函数)浅层神经网络

觉得有用的话,欢迎一起讨论相互学习~Follow Me 3.2 神经网络表示 对于一个由输入层,隐藏层,输出层三层所组成的神经网络来说,输入层,即输入数据被称为第0层,中间层被称为第1层,输出层被称为 ...

- 【深度学习】深入理解ReLU(Rectifie Linear Units)激活函数

论文参考:Deep Sparse Rectifier Neural Networks (很有趣的一篇paper) Part 0:传统激活函数.脑神经元激活频率研究.稀疏激活性 0.1 一般激活函数有 ...

随机推荐

- vm|vmware workstation 15|14 pro 激活|密钥|序列号|许可证

VMware Workstation Pro 15 激活许可证 UY758-0RXEQ-M81WP-8ZM7Z-Y3HDA VF750-4MX5Q-488DQ-9WZE9-ZY2D6 UU54R-FV ...

- Centos 7 修改网卡名称、静态IP

修改内核选项 # vim /etc/sysconfig/grub GRUB_TIMEOUT= GRUB_DISTRIBUTOR="$(sed 's, release .*$,,g' /etc ...

- 常用.gitignore

android开发 关键词:java,android,androidstudio 地址:https://www.gitignore.io/api/java,android,androidstudio ...

- WordPress自定义查询WP_Query使用方法大全

自定义调用文章在网站建设中很常用,wordpress也很人性化,用新建查询new WP_Query就能实现相关功能.WP_Query怎么用呢?随ytkah一起来看看吧 我们知道wordpress的主循 ...

- eclipse集成maven(四)

一.配置maven 打开Window-Preference-Maven,我们可以看到,默认是使用Eclipse的,不是我们要的maven,可以在Installations中,点击"Add&q ...

- luoguP1829 [国家集训队]Crash的数字表格 / JZPTAB(莫比乌斯反演)

题意 注:默认\(n\leqslant m\). 所求即为:\(\sum\limits_{i=1}^{n}\sum\limits_{j=1}^{m}lcm(i,j)\) 因为\(i*j=\gcd(i, ...

- Express服务器开发

作者 | Jeskson 来源 | 达达前端小酒馆 Express服务器开发 创建Express应用程序,Express路由,pug视图模板的使用 Express简介: 让我们来创建Express应用 ...

- [LeetCode] 746. Min Cost Climbing Stairs 爬楼梯的最小损失

On a staircase, the i-th step has some non-negative cost cost[i] assigned (0 indexed). Once you pay ...

- FWT-快速沃尔什变换

FWT-快速沃尔什变换 FWT有啥用啊 我们知道,FFT可以解决多项式的卷积,即 \[ C_k=\sum_{i+j=k}A_i*B_j \] 如果将操作符换一下,换成集合运算符 比如 \[ C_k=\ ...

- Navicat Keygen - for Windows

如何使用这个注册机 从这里下载最新的release. 使用navicat-patcher.exe替换掉navicat.exe和libcc.dll里的Navicat激活公钥. navicat-patch ...