Spark1.0.0 源码编译和部署包生成

问题导读:

1、如何对Spark1.0.0源码编译?

2、如何生成Spark1.0的部署包?

3、如何获取包资源?

Spark1.0.0的源码编译和部署包生成,其本质只有两种:Maven和SBT,只不过针对不同场景而已:

Maven编译

SBT编译

IntelliJ IDEA编译(可以采用Maven或SBT插件编译),适用于开发人员

部署包生成(内嵌Maven编译),适用于维护人员

编译的目的是生成指定环境下运行Spark本身或开发Spark Application的JAR包,本次编译的目的生成运行在hadoop2.2.0上的Spark JAR包。缺省编译所支持的hadoop环境是hadoop1.0.4。

1:获取Spark1.0.0 源码官网下载

2:SBT编译

将源代码复制到指定目录,然后进入该目录,运行:

- SPARK_HADOOP_VERSION=2.2.0 SPARK_YARN=true sbt/sbt assembly

复制代码

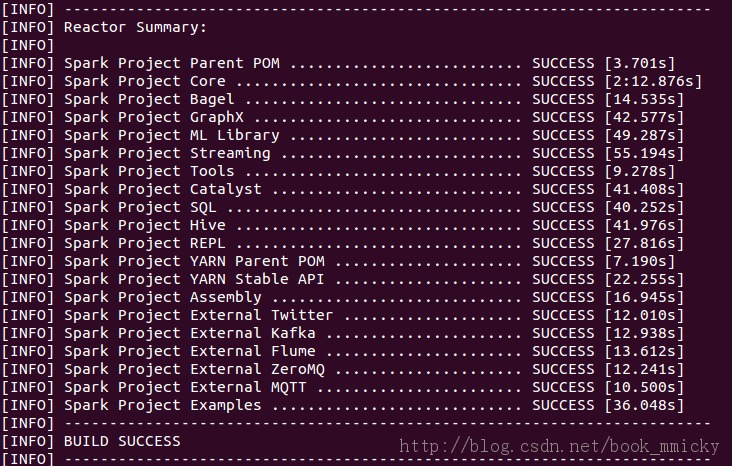

3:Maven编译

事先安装好maven3.04或maven3.05,并设置要环境变量MAVEN_HOME,将$MAVEN_HOME/bin加入PATH变量。然后将源代码复制到指定目录,然后进入该目录,先设置Maven参数:

- export MAVEN_OPTS="-Xmx2g -XX:MaxPermSize=512M -XX:ReservedCodeCacheSize=512m"

复制代码

再运行:

- mvn -Pyarn -Dhadoop.version=2.2.0 -Dyarn.version=2.2.0 -DskipTests clean package

复制代码

<ignore_js_op>

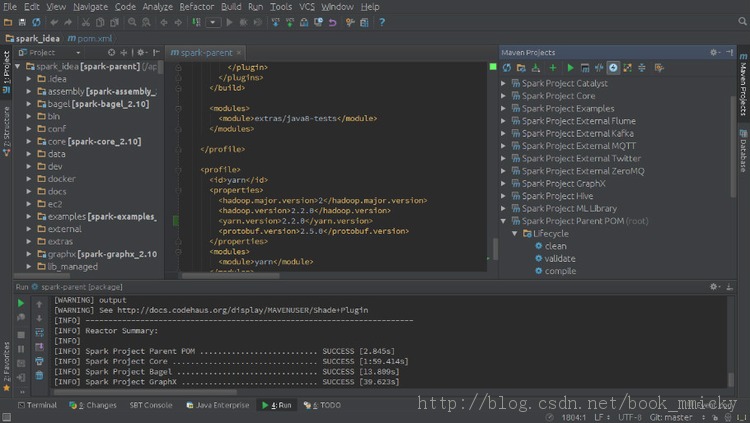

4:IntelliJ IDEA编译

IntelliJ IDEA是个优秀的scala开发IDE,所以顺便就提一下IntelliJ IDEA里的spark编译。

首先将源代码复制到指定目录,然后启动IDEA -> import project -> import project from external model -> Maven编译目录中的pom.xml -> 在选择profile时选择hadoop2.2 -> 直到导入项目。

<ignore_js_op>

在maven projects视图选择Spark Project Parent POM(root),然后选中工具栏倒数第四个按钮(ship Tests mode)按下,这时Liftcycle中test是灰色的。

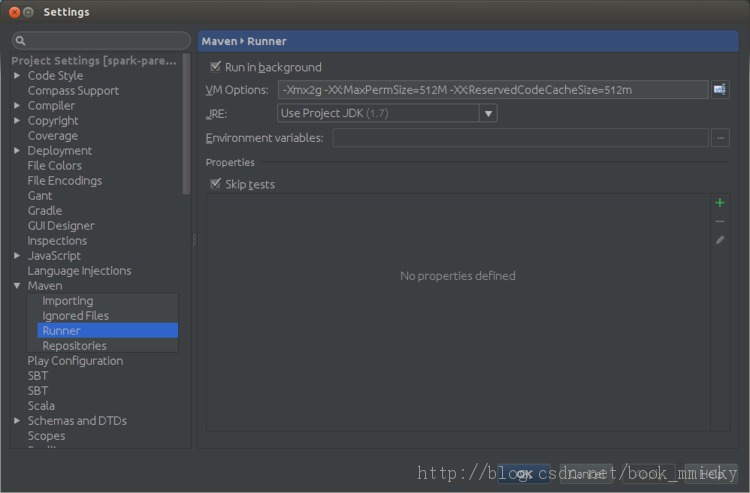

接着按倒数第一个按钮进入Maven设置,在runner项设置VM option:

- -Xmx2g -XX:MaxPermSize=512M -XX:ReservedCodeCacheSize=512m

复制代码

<ignore_js_op>

按OK 保存。

回到maven projects视图,点中Liftcycle中package,然后按第5个按钮(Run Maven Build按钮),开始编译。其编译结果和Maven编译是一样的。

5:生成spark部署包

编译完源代码后,虽然直接用编译后的目录再加以配置就可以运行spark,但是这时目录很庞大,又3G多吧,部署起来很不方便,所以需要生成部署包。

spark源码根目录下带有一个脚本文件make-distribution.sh可以生成部署包,其参数有:

--hadoop VERSION:打包时所用的Hadoop版本号,不加此参数时hadoop版本为1.0.4。

--with-yarn:是否支持Hadoop YARN,不加参数时为不支持yarn。

--with-hive:是否在Spark SQL 中支持hive,不加此参数时为不支持hive。

--skip-java-test:是否在编译的过程中略过java测试,不加此参数时为略过。

--with-tachyon:是否支持内存文件系统Tachyon,不加此参数时不支持tachyon。

--tgz:在根目录下生成 spark-$VERSION-bin.tgz,不加此参数时不生成tgz文件,只生成/dist目录。

--name NAME:和--tgz结合可以生成spark-$VERSION-bin-$NAME.tgz的部署包,不加此参数时NAME为hadoop的版本号。

如果要生成spark支持yarn、hadoop2.2.0的部署包,只需要将源代码复制到指定目录,进入该目录后运行:

- ./make-distribution.sh --hadoop 2.2.0 --with-yarn --tgz

复制代码

如果要生成spark支持yarn、hive的部署包,只需要将源代码复制到指定目录,进入该目录后运行:

- ./make-distribution.sh --hadoop 2.2.0 --with-yarn --with-hive --tgz

复制代码

如果要生成spark支持yarn、hadoop2.2.0、techyon的部署包,只需要将源代码复制到指定目录,进入该目录后运行:

- ./make-distribution.sh --hadoop 2.2.0 --with-yarn --with-tachyon --tgz

复制代码

生成在部署包位于根目录下,文件名类似于spark-1.0.0-bin-2.2.0.tgz。

值得注意的是:make-distribution.sh已经带有Maven编译过程,所以不需要先编译再打包。

资源下载包-较全

6:后记

解压部署包后或者直接在编译过的目录,通过配置conf下的文件,就可以使用spark了。

Spark有下列几种部署方式:

Standalone

YARN

Mesos

Amazon EC2

其实说部署,还不如说运行方式,Spark只是利用不同的资源管理器来申请计算资源。其中Standalone方式是使用Spark本身提供的资源管理器,可以直接运行;而在YARN运行,需要提供运行Spark Application的jar包(或者直接在NM节点上部署Spark):

maven编译的jar包为:./assembly/target/scala-2.10/spark-assembly-1.0.0-hadoop2.2.0.jar

SBT编译的jar包为:./assembly/target/scala-2.10/spark-assembly-1.0.0-hadoop2.2.0.jar

具体使用参见:Spark1.0.0 YARN模式部署

TIPS:

众所周知的网络问题,编译的时候经常会发生卡死的现象,对于maven编译,只需要安ctrl+z结束进程重新编译就可以了;而对于sbt编译,由于有时候会有文件锁定的问题,在按ctrl+z结束进程后,最好退出终端后再开启一个新的终端进行编译

Spark1.0.0 源码编译和部署包生成的更多相关文章

- 英蓓特Mars board的android4.0.3源码编译过程

英蓓特Mars board的android4.0.3源码编译过程 作者:StephenZhu(大桥++) 2013年8月22日 若要转载,请注明出处 一.编译环境搭建及要点: 1. 虚拟机软件virt ...

- spark2.1.0的源码编译

本文介绍spark2.1.0的源码编译 1.编译环境: Jdk1.8或以上 Hadoop2.7.3 Scala2.10.4 必要条件: Maven 3.3.9或以上(重要) 点这里下载 http:// ...

- 非寻常方式学习ApacheTomcat架构及10.0.12源码编译

概述 开启博客分享已近三个月,感谢所有花时间精力和小编一路学习和成长的伙伴们,有你们的支持,我们继续再接再厉 **本人博客网站 **IT小神 www.itxiaoshen.com 定义 Tomcat官 ...

- 解决Tomcat10.0.12源码编译问题进而剖析其优秀分层设计架构

概述 Tomcat.Jetty.Undertow这几个都是非常有名实现Servlet规范的应用服务器,Tomcat本身也是业界上非常优秀的中间件,简单可将Tomcat看成是一个Http服务器+Serv ...

- android 5.0 (lollipop)源码编译环境搭建(Mac OS X)

硬件环境:MacBook Pro Retina, 13-inch, Late 2013 处理器 2.4 GHz Intel Core i5 内存 8 GB 1600 MHz DDR3 硬盘60G以 ...

- hadoop2.0 eclipse 源码编译

在eclipse下编译hadoop2.0源码 http://www.cnblogs.com/meibenjin/archive/2013/07/05/3172889.html hadoop cdh4编 ...

- Spark-2.0.2源码编译

注:图片如果损坏,点击文章链接:https://www.toutiao.com/i6813925210731840013/ Spark官网下载地址: http://spark.apache.org/d ...

- kafka 0.11.0.3 源码编译

首先下载 kafka 0.11.0.3 版本 源码: http://mirrors.hust.edu.cn/apache/kafka/0.11.0.3/ 下载源码 首先安装 gradle,不再说明 1 ...

- anroid 6.0.1_r77源码编译

一.源码下载(基本类似4.4.4_r1) 二.必须使用openjdk1.7 sudo add-apt-repository ppa:openjdk-r/ppa sudo apt-get update ...

随机推荐

- Redis学习笔记(3)-XShell连接CentOSMini,并安装Redis

使用XShell远程连接CentOSMini 点击download下载XShell5.0. 下载之后安装.配置XShell. 配置XShell前的准备 打开VM,启动CentOSMini.CentOS ...

- [转]c# System.IO.Ports SerialPort Class

本文转自:https://docs.microsoft.com/en-us/dotnet/api/system.io.ports.serialport?redirectedfrom=MSDN& ...

- [android] 内容提供者实现

[android] 内容提供者实现 上一节的主机名类似网络上的域名,协议是content://,可以定义一下规则 content://主机名/insert 添加操作 content://主机名/del ...

- mysql left join的深入探讨

即使你认为自己已对 MySQL 的 LEFT JOIN 理解深刻,但我敢打赌,这篇文章肯定大致也许可能让你学会点东西! ON 子句与 WHERE 子句的不同 一种更好地理解带有 WHERE ... I ...

- 【Spring】27、JPA 实现乐观锁@Version注解的使用

持久层使用jpa时,默认提供了一个注解@Version来实现乐观锁 简单来说就是用一个version字段来充当乐观锁的作用.先来设计实体类 /** * Created by xujingfeng on ...

- VSCode Snippet 小试牛刀

这几天因为一个需求,要不断重复一个用特定代码段去包围不同代码的需求. 这个要不断移动鼠标以及重复敲打相同代码的体力活,实在让我老眼昏花,体内的懒人之力迫使我想一个快捷的方法来代替之. 之前就知道Sni ...

- CodeMirror 使用

codemirror是一款在线代码编辑器,官网:https://codemirror.net/doc/manual.html#overview 使用说明 第一步 安装: npm install cod ...

- PHP常用函数归类【持续整理中......】

一.PHP基础语法 变量,常量 严格区分大小写,但内置结构或关键字无所谓(echo) 命名:不能以数字,空格,.来开头,但是可以有汉字,eg:$变量="aa"; ...

- python实现简单的计算器功能

如想实现一个计算器的功能,输入格式为字符串,不能运用python里面的内置方法,出去简单的加减乘除,设计一个相对高级的计算器: a = '1 - 2 * ( ( 6 0 -3 0 +(-40/5) * ...

- echarts功能配置实例----柱/折线、饼图

---恢复内容开始--- echarts中的柱状图和折线图的参数配置可以共用,一般只需要修改图表类型这一个参数即可. 一.echarts最简单的实例 1.折线图/柱状图 <html> &l ...