学生课程分数的Spark SQL分析

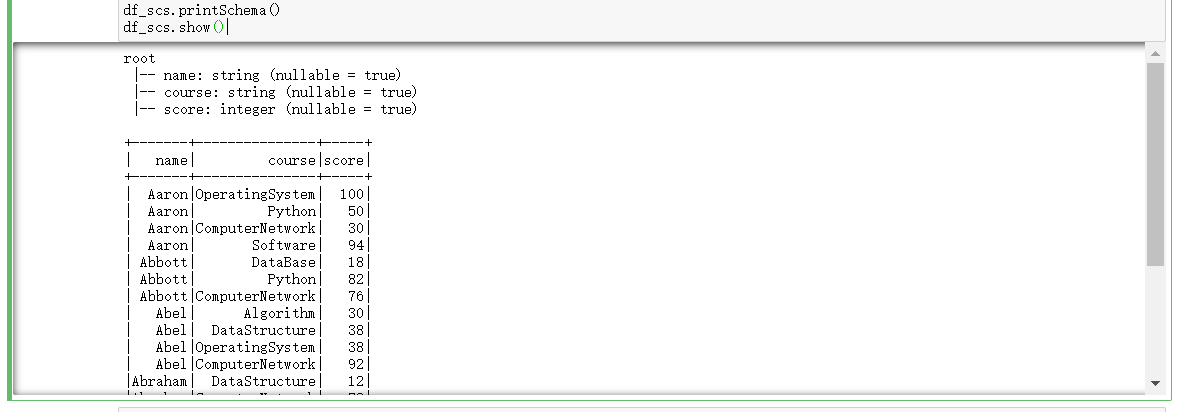

读学生课程分数文件chapter4-data01.txt,创建DataFrame。

url = "file:///D:/chapter4-data01.txt"

rdd = spark.sparkContext.textFile(url).map(lambda line:line.split(','))

rdd.take(3) from pyspark.sql.types import IntegerType,StringType,StructField,StructType

from pyspark.sql import Row #生成“表头”

fields = [StructField('name',StringType(),True),StructField('course',StringType(),True),StructField('score',IntegerType(),True)]

schema = StructType(fields) # 生成“表中的记录”

data = rdd.map(lambda p:Row(p[0],p[1],int(p[2]))) # 把“表头”和“表中的记录”拼接在一起

df_scs = spark.createDataFrame(data,schema)

df_scs.printSchema()

df_scs.show()

一:用DataFrame的操作或SQL语句完成以下数据分析要求,并和用RDD操作的实现进行对比:

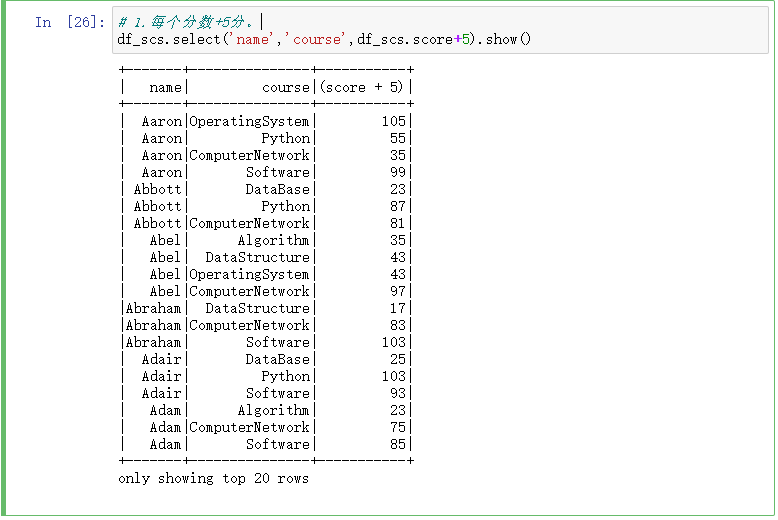

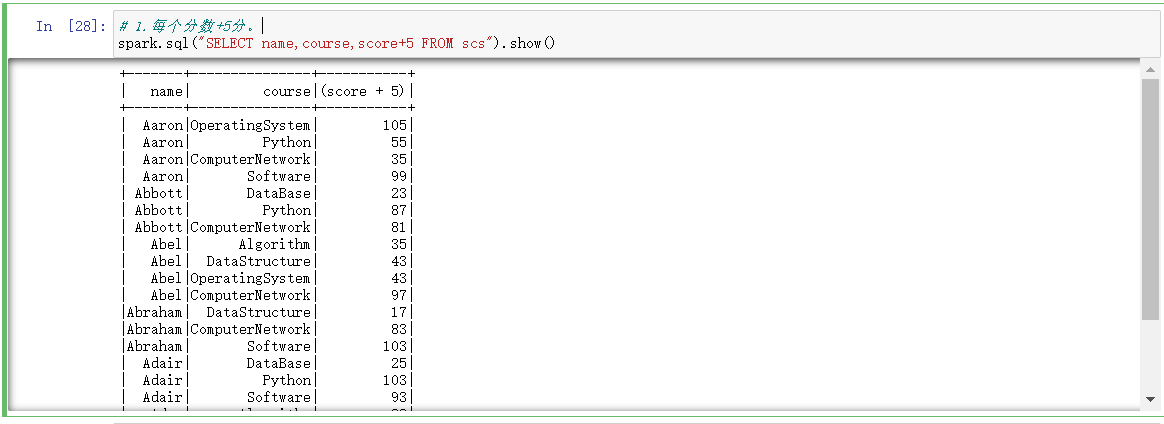

1.每个分数+5分。

# 1.每个分数+5分。

df_scs.select('name','course',df_scs.score+5).show()

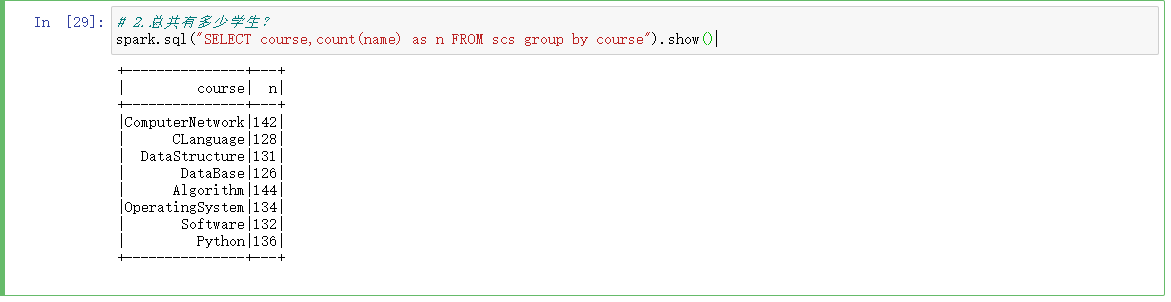

2.总共有多少学生?

# 2.总共有多少学生?

df_scs.select(df_scs.name).distinct().count() df_scs.select(df_scs['name']).distinct().count() df_scs.select('name').distinct().count()

3.总共开设了哪些课程?

# 3.总共开设了哪些课程?

df_scs.select('course').distinct().show()

4.每个学生选修了多少门课?

# 4.每个学生选修了多少门课?

df_scs.groupBy('name').count().show()

5.每门课程有多少个学生选?

# 5.每门课程有多少个学生选?

df_scs.groupBy('course').count().show()

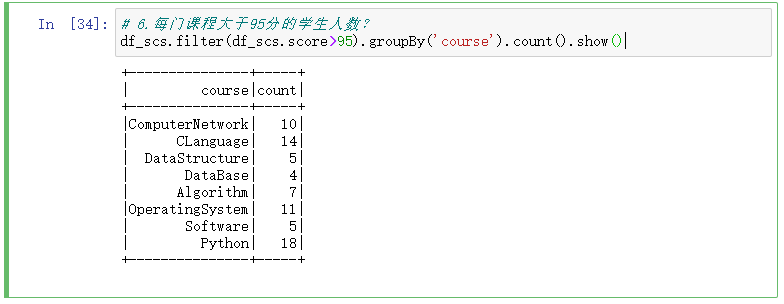

6.每门课程大于95分的学生人数?

# 6.每门课程大于95分的学生人数?

df_scs.filter(df_scs.score>95).groupBy('course').count().show()

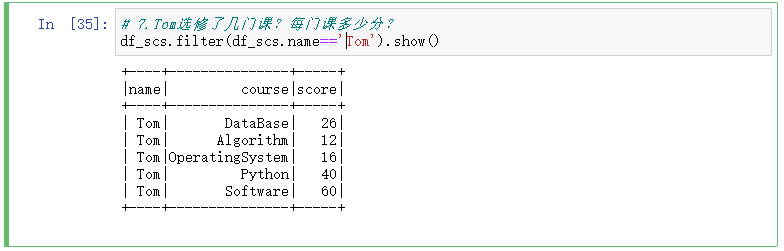

7.Tom选修了几门课?每门课多少分?

# 7.Tom选修了几门课?每门课多少分?

df_scs.filter(df_scs.name=='Tom').show()

8.Tom的成绩按分数大小排序。

# 8.Tom的成绩按分数大小排序。

df_scs.filter(df_scs.name=='Tom').orderBy(df_scs.score).show()

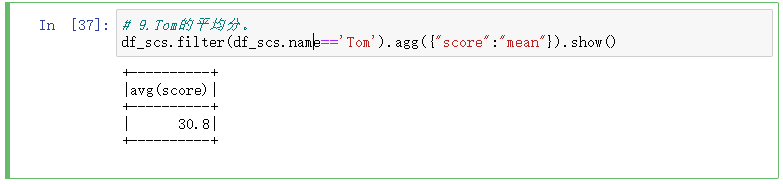

9.Tom的平均分。

# 9.Tom的平均分。

df_scs.filter(df_scs.name=='Tom').agg({"score":"mean"}).show()

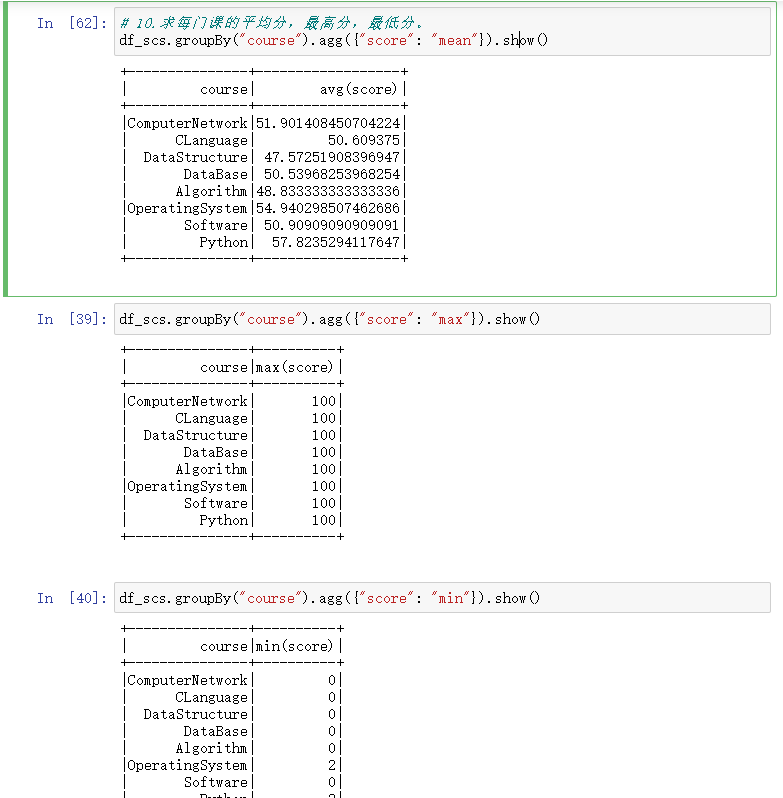

10.求每门课的平均分,最高分,最低分。

# 10.求每门课的平均分,最高分,最低分。

df_scs.groupBy("course").agg({"score": "mean"}).show() df_scs.groupBy("course").agg({"score": "max"}).show() df_scs.groupBy("course").agg({"score": "min"}).show()

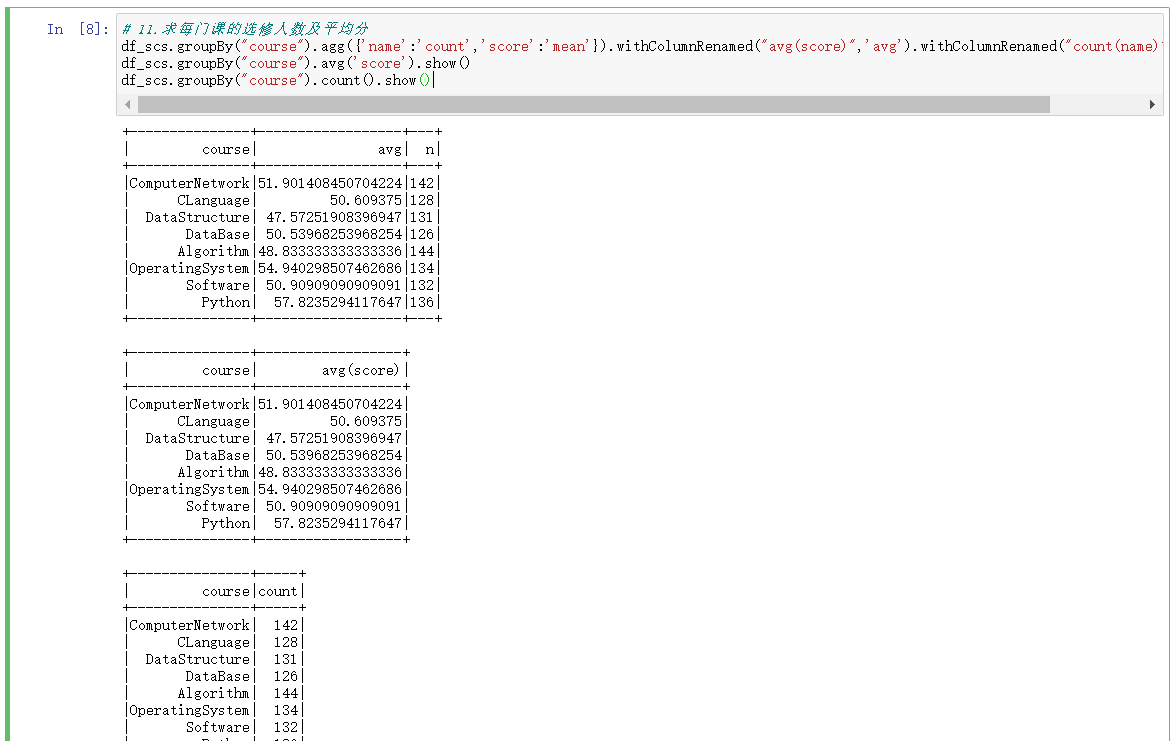

11.求每门课的选修人数及平均分,精确到2位小数。

# 11.求每门课的选修人数及平均分,精确到2位小数。

df_scs.select(countDistinct('name').alias('学生人数'),countDistinct('course').alias('课程数'),round(mean('score'),2).alias('所有课的平均分')).show()

12.每门课的不及格人数,通过率

# 12.每门课的不及格人数,通过率

df_scs.filter(df_scs.score<60).groupBy('course').count().show()

13.结果可视化。

二、用SQL语句完成以上数据分析要求

1.每个分数+5分。

# 1.每个分数+5分。

spark.sql("SELECT name,course,score+5 FROM scs").show()

2.总共有多少学生?

# 2.总共有多少学生?

spark.sql("SELECT course,count(name) as n FROM scs group by course").show()

3.总共开设了哪些课程?

# 3.总共开设了哪些课程?

spark.sql("SELECT course FROM scs group by course").show()

4.每个学生选修了多少门课?

# 4.每个学生选修了多少门课?

spark.sql("SELECT name,count(course) FROM scs group by name").show()

5.每门课程有多少个学生选?

# 5.每门课程有多少个学生选?

spark.sql("SELECT course,count(name) FROM scs group by course").show()

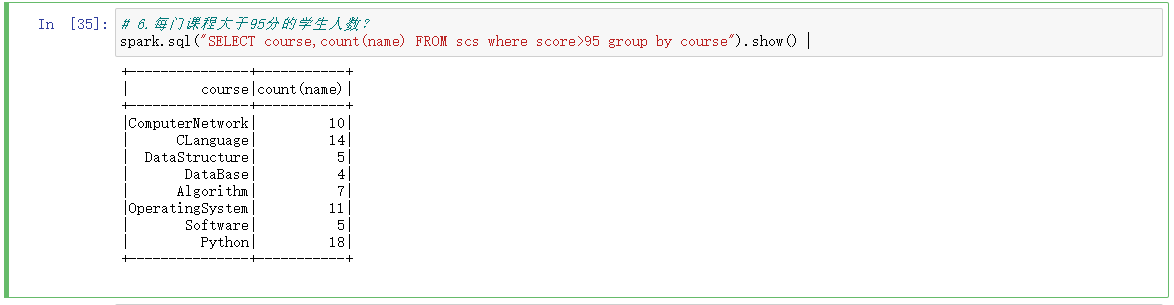

6.每门课程大于95分的学生人数?

# 6.每门课程大于95分的学生人数?

spark.sql("SELECT course,count(name) FROM scs where score>95 group by course").show()

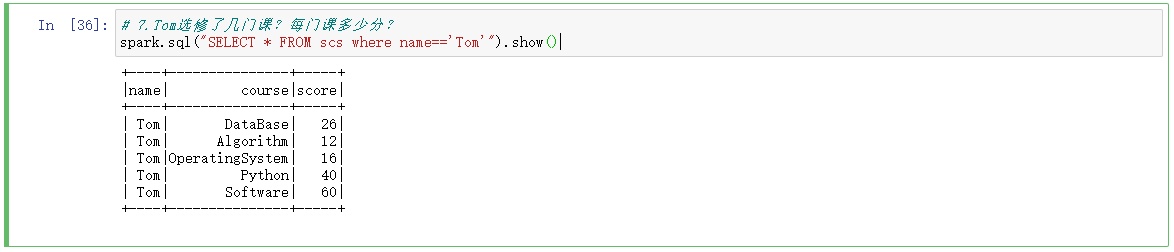

7.Tom选修了几门课?每门课多少分?

# 7.Tom选修了几门课?每门课多少分?

spark.sql("SELECT * FROM scs where name=='Tom'").show()

8.Tom的成绩按分数大小排序。

# 8.Tom的成绩按分数大小排序。

spark.sql("SELECT * FROM scs where name=='Tom' order by score desc").show()

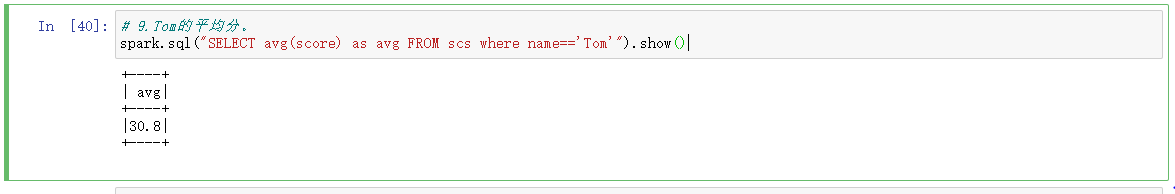

9.Tom的平均分。

# 9.Tom的平均分。

spark.sql("SELECT avg(score) as avg FROM scs where name=='Tom'").show()

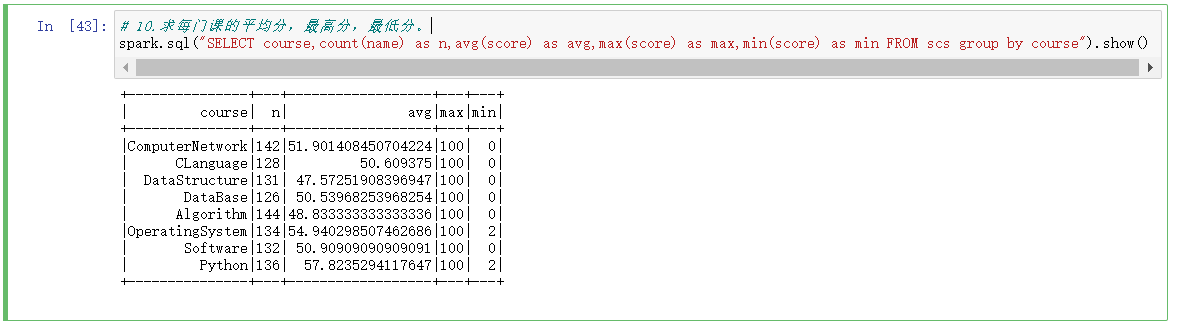

10.求每门课的平均分,最高分,最低分。

# 10.求每门课的平均分,最高分,最低分。

spark.sql("SELECT course,count(name) as n,avg(score) as avg,max(score) as max,min(score) as min FROM scs group by course").show()

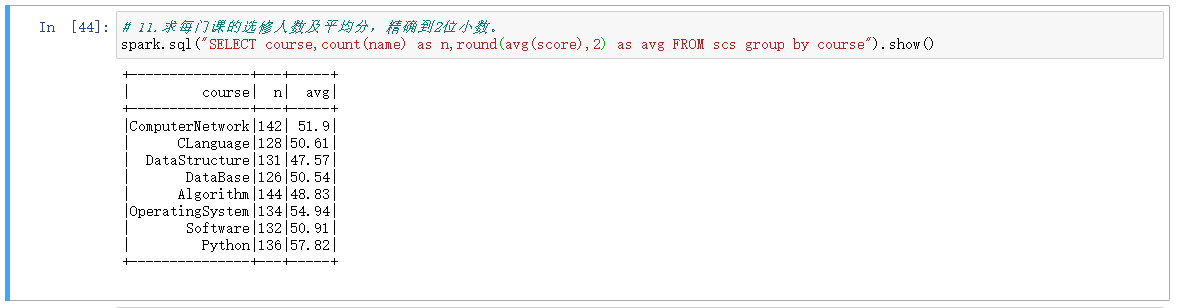

11.求每门课的选修人数及平均分,精确到2位小数。

# 11.求每门课的选修人数及平均分,精确到2位小数。

spark.sql("SELECT course,count(name) as n,round(avg(score),2) as avg FROM scs group by course").show()

12.每门课的不及格人数,通过率

# 12.每门课的不及格人数,通过率

spark.sql("SELECT course,count(name) as n,avg(score) as avg FROM scs group by course").createOrReplaceTempView("a")

spark.sql("SELECT course,count(score) as notPass FROM scs where score<60 group by course").createOrReplaceTempView("b")

spark.sql("SELECT * from a left join b on a.course=b.course").show() spark.sql("select a.course,round(a.avg,2),b.notPass,round((a.n-b.notPass)/a.n,2) as passRat from a left join b on a.course=b.course").show()

三、对比分别用RDD操作实现、用DataFrame操作实现和用SQL语句实现的异同。(比较两个以上问题)

例如:每门课的选修人数与平均分

1.RDD实现

# 方法一 combineByKey()

course = words.combineByKey(lambda v:(int(v),1),lambda c,v:(c[0]+int(v),c[1]+1),lambda c1,c2:(c1[0]+c2[0],c1[1]+c2[1])) #每门课的选修人数及所有人的总分。combineByKey()

course.map(lambda x:(x[0],x[1][1],round(x[1][0]/x[1][1],2))).collect() #每门课的选修人数及平均分,精确到2位小数。 #方法二 reduceByKey()

lines.map(lambda line:line.split(',')).map(lambda x:(x[1],(int(x[2]),1))).reduceByKey(lambda a,b:(a[0]+b[0],a[1]+b[1])).collect()

2.DataFrame实现

df_scs.groupBy("course").agg({'name':'count','score':'mean'}).withColumnRenamed("avg(score)",'avg').withColumnRenamed("count(name)",'n').show()

df_scs.groupBy("course").avg('score').show()

df_scs.groupBy("course").count().show()

3.SQL语句

spark.sql("SELECT course,count(name) as n,avg(score) as avg FROM scs group by course").show()

四、结果可视化。

函数:http://spark.apache.org/docs/2.2.0/api/python/pyspark.sql.html#module-pyspark.sql.functions

学生课程分数的Spark SQL分析的更多相关文章

- 08 学生课程分数的Spark SQL分析

读学生课程分数文件chapter4-data01.txt,创建DataFrame. 用DataFrame的操作或SQL语句完成以下数据分析要求,并和用RDD操作的实现进行对比: 每个分数+5分. 总共 ...

- hive Spark SQL分析窗口函数

Spark1.4发布,支持了窗口分析函数(window functions).在离线平台中,90%以上的离线分析任务都是使用Hive实现,其中必然会使用很多窗口分析函数,如果SparkSQL支持窗口分 ...

- Spark SQL大数据处理并写入Elasticsearch

SparkSQL(Spark用于处理结构化数据的模块) 通过SparkSQL导入的数据可以来自MySQL数据库.Json数据.Csv数据等,通过load这些数据可以对其做一系列计算 下面通过程序代码来 ...

- 05 RDD练习:词频统计,学习课程分数

.词频统计: 1.读文本文件生成RDD lines 2.将一行一行的文本分割成单词 words flatmap() 3.全部转换为小写 lower() 4.去掉长度小于3的单词 filter() 5. ...

- 小菜菜mysql练习解读分析1——查询" 01 "课程比" 02 "课程成绩高的学生的信息及课程分数

查询" 01 "课程比" 02 "课程成绩高的学生的信息及课程分数 好的,第一道题,刚开始做,就栽了个跟头,爽歪歪,至于怎么栽跟头的 ——需要分析题目,查询的是 ...

- 大数据学习day26----hive01----1hive的简介 2 hive的安装(hive的两种连接方式,后台启动,标准输出,错误输出)3. 数据库的基本操作 4. 建表(内部表和外部表的创建以及应用场景,数据导入,学生、分数sql练习)5.分区表 6加载数据的方式

1. hive的简介(具体见文档) Hive是分析处理结构化数据的工具 本质:将hive sql转化成MapReduce程序或者spark程序 Hive处理的数据一般存储在HDFS上,其分析数据底 ...

- Spark SQL慕课网日志分析(1)--系列软件(单机)安装配置使用

来源: 慕课网 Spark SQL慕课网日志分析_大数据实战 目标: spark系列软件的伪分布式的安装.配置.编译 spark的使用 系统: mac 10.13.3 /ubuntu 16.06,两个 ...

- Mysql--查询"01"课程比"02"课程成绩高的学生的信息及课程分数

今天在写Mysql代码作业时,写到这个题,感觉值得分享!!!!!!! 查询"01"课程比"02"课程成绩高的学生的信息及课程分数 分析如下: 首先先查询&quo ...

- Spark SQL概念学习系列之Spark SQL 架构分析(四)

Spark SQL 与传统 DBMS 的查询优化器 + 执行器的架构较为类似,只不过其执行器是在分布式环境中实现,并采用的 Spark 作为执行引擎. Spark SQL 的查询优化是Catalyst ...

- Spark SQL 源代码分析之 In-Memory Columnar Storage 之 in-memory query

/** Spark SQL源代码分析系列文章*/ 前面讲到了Spark SQL In-Memory Columnar Storage的存储结构是基于列存储的. 那么基于以上存储结构,我们查询cache ...

随机推荐

- hta--Windows运行html的桌面应用程序(HTML应用程序)

HTA(HTML Application)-- HTML应用程序 作为前端开发,我们能熟练使用html实现各种效果,但是如果要实现一个简单的桌面应用程序那么应该怎么做呢,答案很简单,只需要把html文 ...

- 驱动开发:探索DRIVER_OBJECT驱动对象

本章将探索驱动程序开发的基础部分,了解驱动对象DRIVER_OBJECT结构体的定义,一般来说驱动程序DriverEntry入口处都会存在这样一个驱动对象,该对象内所包含的就是当前所加载驱动自身的一些 ...

- w11 U盘启动进PE看不到硬盘解决方法

w11 U盘启动进PE看不到硬盘解决方法 今天,因为要配系统,所以需要进pe,改配置文件,进去之后发现看不到系统盘,大吃一惊,然后各种找资料,最后,还是被我搞定了. 这里以戴尔为例,方法都差不多,先看 ...

- pysimplegui之第一个程序,包括回调函数,事件,阻塞等待内容

自定义窗口 API 调用(您的第一个窗口) 总结一下:我遇到的坑, 比如拿输入框的内容的时候可以直接通过value[key] 几种窗口模式就是什么时候用timeout这个参数 关闭窗口可以的一边形式 ...

- [VMware]虚拟网络编辑器

虚拟网络编辑器 Vmware > 编辑 > 虚拟网络编辑器 VMnet0 VMnet0:用于虚拟桥接模式网络下的虚拟交换机 vmnet0: 实际上就是一个虚拟的网桥 这个网桥有很若干个端口 ...

- [Maven]Maven聚合工程

一直对此问题好奇,正好有这兴致和时间,有必要了解一下. 所谓聚合项目,实际上就是对项目分模块. 互联网项目一般来说按照业务分(订单模块.VIP模块.支付模块.CMS模块-): 传统的软件项目,大多采用 ...

- 扎实打牢数据结构算法根基,从此不怕算法面试系列之004 week01 02-04 使用泛型实现线性查找法

1.算法描述 在数组中逐个查找元素,即遍历. 2.上一篇文的实现结果 在 扎实打牢数据结构算法根基,从此不怕算法面试系列之003 week01 02-03 代码实现线性查找法中,我们实现了如下代码: ...

- 深度学习--实战 LeNet5

深度学习--实战 LeNet5 数据集 数据集选用CIFAR-10的数据集,Cifar-10 是由 Hinton 的学生 Alex Krizhevsky.Ilya Sutskever 收集的一个用于普 ...

- springCloud Alibaba服务的注册与发现之eureka搭建

1.创建eureka微服务模块.导入maven依赖. <dependency> <groupId>org.springframework.cloud</groupId&g ...

- 大规模 Transformer 模型 8 比特矩阵乘简介 - 基于 Hugging Face Transformers、Accelerate 以及 bitsandbytes

引言 语言模型一直在变大.截至撰写本文时,PaLM 有 5400 亿参数,OPT.GPT-3 和 BLOOM 有大约 1760 亿参数,而且我们仍在继续朝着更大的模型发展.下图总结了最近的一些语言模型 ...