大数据笔记(四)——操作HDFS

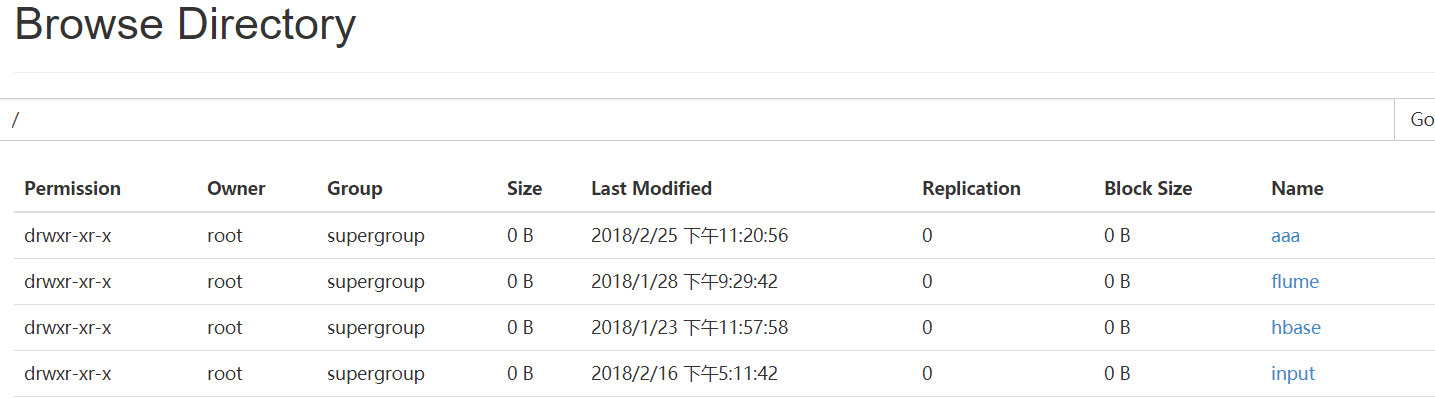

一.Web Console:端口50070

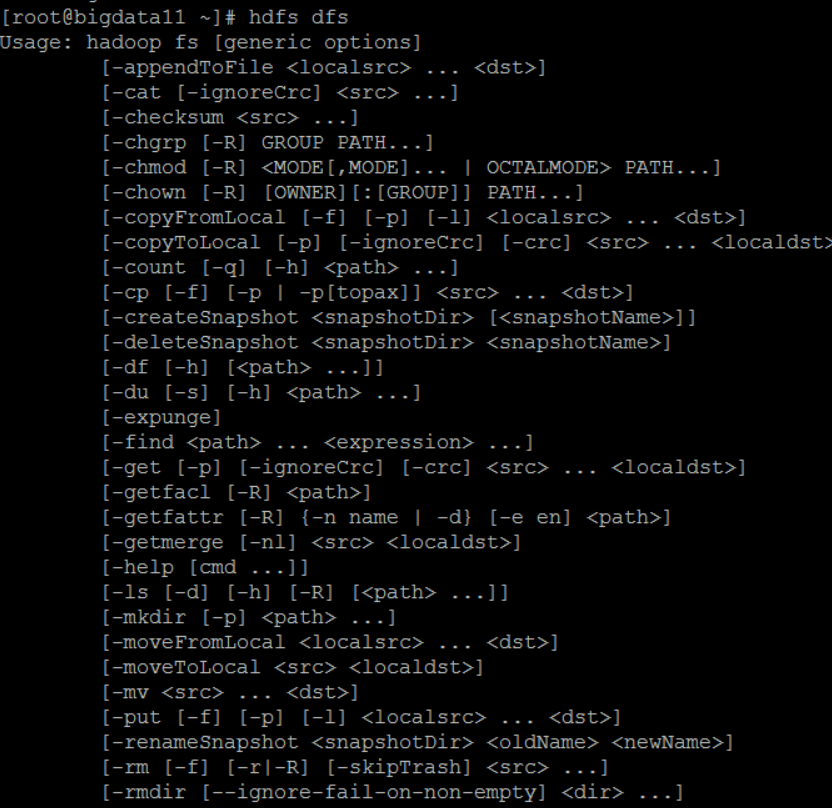

二.HDFS的命令行操作

(一)普通操作命令

HDFS 操作命令帮助信息: hdfs dfs + Enter键

常见命令

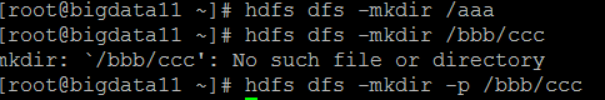

1. -mkdir

- 在HDFS上创建目录:hdfs dfs -mkdir /aaa

- 如果父目录不存在,使用 -p 命令先创建父目录:

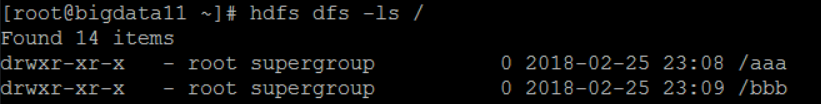

2. -ls /

查看hdfs文件系统根目录下的目录和文件:

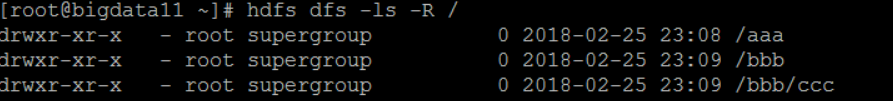

3.-ls -R /

查看所有目录和文件:

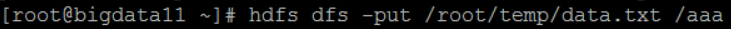

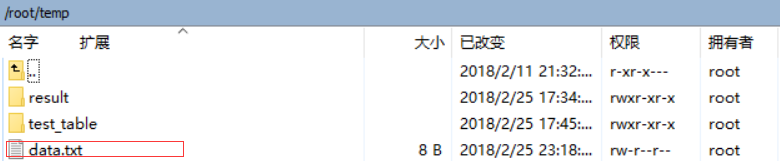

4.-put

上传数据:将本地Linux文件data.txt上传到HDFS的aaa目录下

-copyFromLocal 上传数据,类似-put

-moveFromLocal 上传数据,类似-put,相当于ctrl+x

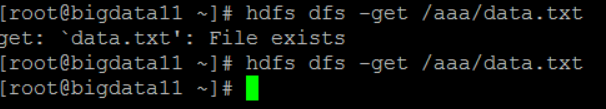

5.-get 下载数据(刚才上传数据时已经有data.txt,所以要把Linux目录下的data.txt先删除)

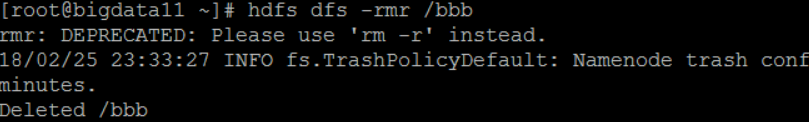

6.-rm: 删除目录

-rmr: 删除目录,包括子目录

hdfs dfs -rmr /bbb

7. -getmerge:把某个目录下的文件,合并后再下载

8.-cp:拷贝 hdfs dfs -cp /input/data.txt /input/data2.txt

9.-mv:移动 hdfs dfs -cp /input/data.txt /aaa/a.txt

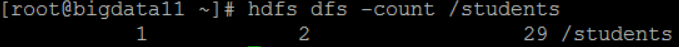

10.-count 统计hdfs对应路径下的目录个数,文件个数,文件总计大小:hdfs dfs -count /students

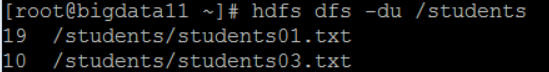

11.-du 显示hdfs对应路径下每个文件夹和目录的大小 hdfs dfs -du /students

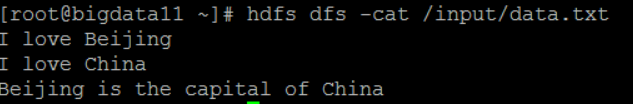

12.-cat 查看文本的内容 hdfs dfs -cat /input/data.txt

13.balancer:平衡操作 如果管理员发现某些DataNode上保存数据过多,某些过少,就可以采取此操作

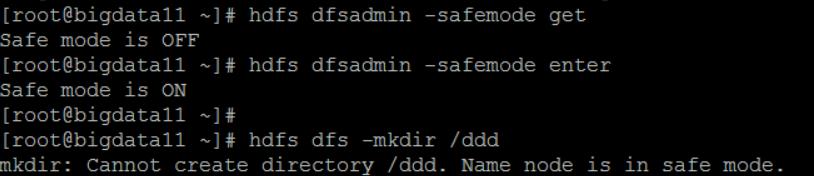

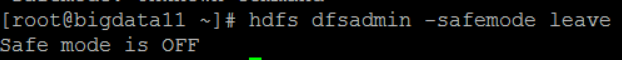

(二)管理命令:hdfs dfsadmin

举例:

1.-report 打印hdfs的报告 hdfs dfsadmin -report

2.-safemode:安全模式(安全模式下对hdfs只能进行只读操作)

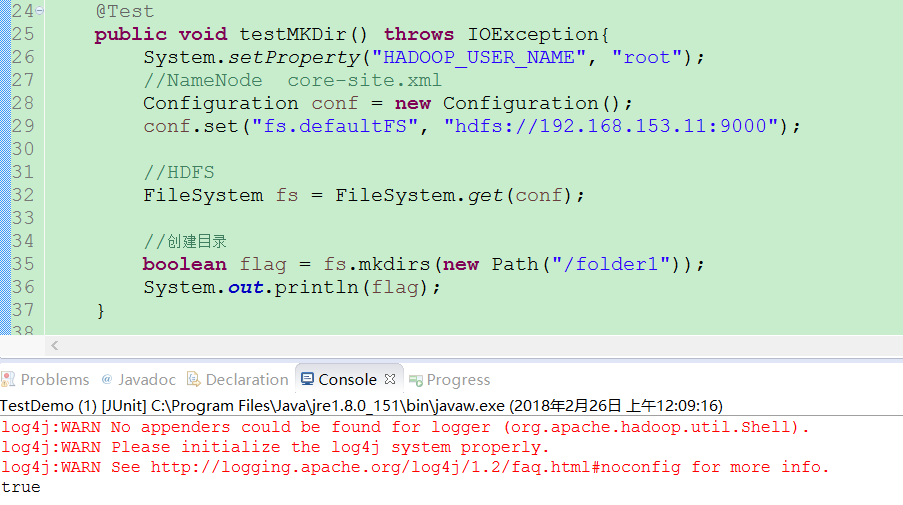

三.JavaAPI

通过HDFS提供的JavaAPI,我们可以完成以下的功能:

(一)在HDFS上创建目录

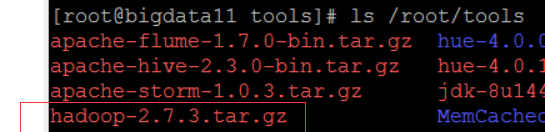

(二)写入数据(上传文件)

import java.io.FileInputStream;

import java.io.IOException;

import java.io.InputStream;

import java.io.OutputStream; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.junit.Test; import com.jcraft.jsch.Buffer; public class TestUpload { @Test

public void testUpload() throws IOException{

System.setProperty("HADOOP_USER_NAME", "root");

//NameNode core.site.xml

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://192.168.153.11:9000"); //构造一个输入流 <---HDFS

FileSystem fs = FileSystem.get(conf); InputStream in = new FileInputStream("D:\\temp\\hadoop-2.7.3.tar.gz"); //构造一个输出流------> HDFS

OutputStream out = fs.create(new Path("/tools/hadoop-2.7.3.tar.gz")); byte[] buffer = new byte[1024];

int len = 0; while ((len=in.read(buffer)) > 0) {

out.write(buffer, 0, len);

} out.flush(); in.close();

out.close(); }

}

(三)通过 FileSystem API 读取数据(下载文件)

(四)查看目录及文件信息

(五)查找某个文件在HDFS集群的位置

(六)删除数据

(七)获取HDFS集群上所有数据节点信息

大数据笔记(四)——操作HDFS的更多相关文章

- 大数据学习——java操作hdfs环境搭建以及环境测试

1 新建一个maven项目 打印根目录下的文件的名字 添加pom依赖 pom.xml <?xml version="1.0" encoding="UTF-8&quo ...

- 大数据系列2:Hdfs的读写操作

在前文大数据系列1:一文初识Hdfs中,我们对Hdfs有了简单的认识. 在本文中,我们将会简单的介绍一下Hdfs文件的读写流程,为后续追踪读写流程的源码做准备. Hdfs 架构 首先来个Hdfs的架构 ...

- Dapper学习(四)之Dapper Plus的大数据量的操作

这篇文章主要讲 Dapper Plus,它使用用来操作大数量的一些操作的.比如插入1000条,或者10000条的数据时,再使用Dapper的Execute方法,就会比较慢了.这时候,可以使用Dappe ...

- 大数据笔记04:大数据之Hadoop的HDFS(基本概念)

1.HDFS是什么? Hadoop分布式文件系统(HDFS),被设计成适合运行在通用硬件(commodity hardware)上的分布式文件系统.它和现有的分布式文件系统有很多共同点. 2.HDFS ...

- 大数据笔记09:大数据之Hadoop的HDFS使用

1. HDFS使用: HDFS内部中提供了Shell接口,所以我们可以以命令行的形式操作HDFS

- 大数据-hadoop生态之-HDFS

一.HDFS初识 hdfs的概念: HDFS,它是一个文件系统,用于存储文件,通过目录树定位文件,其次,他是分布式的,由很多服务器联合起来 实现功能,集群中的服务器各有各自的角色 HDFS设计适合一次 ...

- 大数据 - hadoop基础概念 - HDFS

Hadoop之HDFS的概念及用法 1.概念介绍 Hadoop是Apache旗下的一个项目.他由HDFS.MapReduce.Hive.HBase和ZooKeeper等成员组成. HDFS是一个高度容 ...

- 大数据【二】HDFS部署及文件读写(包含eclipse hadoop配置)

一 原理阐述 1' DFS 分布式文件系统(即DFS,Distributed File System),指文件系统管理的物理存储资源不一定直接连接在本地节点上,而是通过计算机网络与节点相连.该系统架构 ...

- 大数据【四】MapReduce(单词计数;二次排序;计数器;join;分布式缓存)

前言: 根据前面的几篇博客学习,现在可以进行MapReduce学习了.本篇博客首先阐述了MapReduce的概念及使用原理,其次直接从五个实验中实践学习(单词计数,二次排序,计数器,join,分 ...

- 大数据:Hadoop(HDFS 的设计思路、设计目标、架构、副本机制、副本存放策略)

一.HDFS 的设计思路 1)思路 切分数据,并进行多副本存储: 2)如果文件只以多副本进行存储,而不进行切分,会有什么问题 缺点 不管文件多大,都存储在一个节点上,在进行数据处理的时候很难进行并行处 ...

随机推荐

- Linux 最常用命令整理,建议收藏!

Linux是目前应用最广泛的服务器操作系统,基于Unix,开源免费,由于系统的稳定性和安全性,市场占有率很高,几乎成为程序代码运行的最佳系统环境. linux不仅可以长时间的运行我们编写的程序代码,还 ...

- Codeforces 1262E Arson In Berland Forest(二维前缀和+二维差分+二分)

题意是需要求最大的扩散时间,最后输出的是一开始的火源点,那么我们比较容易想到的是二分找最大值,但是我们在这满足这样的点的时候可以发现,在当前扩散时间k下,以这个点为中心的(2k+1)2的正方形块内必 ...

- shell学习笔记3---shell变量

Shell变量的定义.赋值和删除 脚本语言在定义变量时通常不需要指明类型,直接赋值就可以,Shell 变量也遵循这个规则. 在 Bash shell 中,每一个变量的值都是字符串,无论你给变量赋值时有 ...

- 高效编程之 多线程Event

Event 简介 Event 事件 是线程间通信的最简单方法之一,主要用于线程同步. 处理机制 定义一个全局内置标志Flag,如果Flag为False,执行到 event.wait 时程序就会阻塞,如 ...

- Vue切换页面时中断axios请求

一.概述 在Vue单页面开发过程中,遇到这样的情况,当我切换页面时,由于上一页面请求执行时间长,切换到该页面时,还未执行完,这时那个请求仍会继续执行直到请求结束,此时将会影响页面性能,并且可能对现在页 ...

- iOS微信浏览器回退不刷新(监听浏览器回退事件)

兼容性:兼容全部ios系统 $(function(){ pushHistory(); }); function pushHistory(){ window.addEventListener(" ...

- TCP/IP四层协议

1.数据链路层 数据链路层实现了网卡接口的网络驱动程序,处理数据在物理媒介(以太网,令牌环)上的传输,常用协议包含ARP(地址解析协议),RARP(逆地址解析协议)两个协议,他们实现了IP地址和物理地 ...

- Spring基础05——Spring依赖注入的三种方式

Spring支持3种依赖注入的方式:属性注入.构造器注入.工厂 1.属性注入 属性注入即通过setter方法注入Bean的属性或依赖的对象.使用<property>元素,使用name属性指 ...

- mdoc.samples - 用 -mdoc 编写 BSD 手册 的 示范教程

SYNOPSIS (总览) man mdoc.samples DESCRIPTION (描述) 这个 示范教程 用于 编写 BSD 手册页 (manual page), 它 使用了 -mdoc 宏定义 ...

- Win10 + Ubuntu 安装教程(痛苦踩坑)

今天搞了一天,痛苦万分,本文的教程基本适用大部分情况,现在记录下需要主义的几点: 一.制作ubuntu usb安装盘的时候,格式要选saw的,千万不要用usb-HDD+的 二.安装完后使用EasyBC ...