【Python3 爬虫】16_抓取腾讯视频评论内容

上一节我们已经知道如何使用Fiddler进行抓包分析,那么接下来我们开始完成一个简单的小例子

抓取腾讯视频的评论内容

首先我们打开腾讯视频的官网https://v.qq.com/

我们打开【电视剧】这一栏,找到一部比较精彩的电视剧爬取一下,例如:我们就爬取【下一站,别离】这部吧

我们找到这部电视剧的评论如下图:

我们看到上图标记部分【查看更多评论】

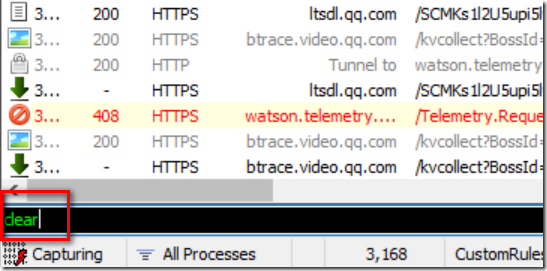

我们首先在Fiddelr中使用命令clear清除之前浏览的记录

输入命令直接回车即可

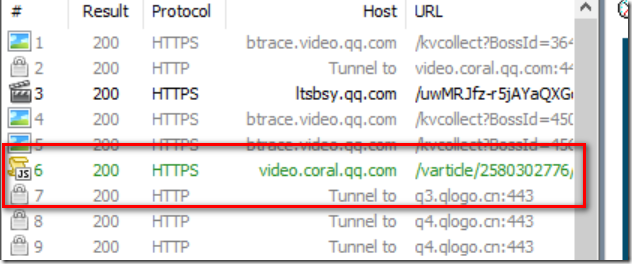

接着我们点击【查看更多评论】,此时再次看Fiddler,我们可以看到【JS】这个小图标

我们右键上图标记部分

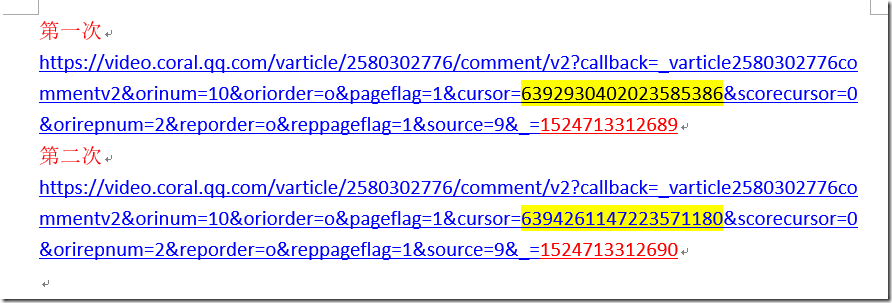

第一次点击

接着【Copy】---【Just Url】

地址为:

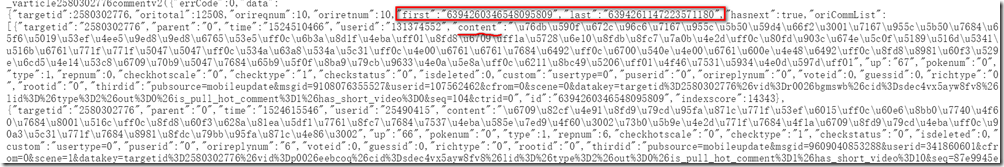

我们将此地址放到浏览器查看效果如何?

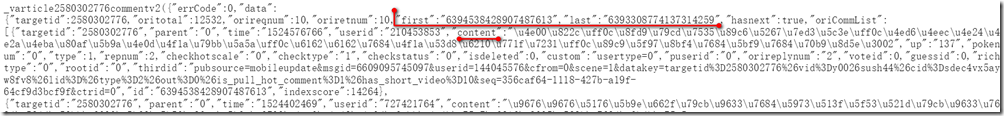

现在我们还没发现什么规律,那我们再点击一次

第二次点击

浏览器显示

我们将上述2个地址放在word进行分析后,分析结果如下:

我们可以看到黄色标记部分没什么规律,最后红色标记是按1递增

那么我们验证下黄色标记部分是否是必须的呢?删除黄色部分放在浏览器执行,查看结果,有没有黄色部分结果一致,那么我们接下来开始代码了

import urllib.request

import re

import urllib.error

headers=("User_Agent","Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36 SE 2.X MetaSr 1.0")

#自定义opener

opener = urllib.request.build_opener()

opener.addheaders = [headers]

urllib.request.install_opener(opener) cursor_id = '6394260346548095809'

v_id =1524402700840

url = "https://video.coral.qq.com/varticle/2580302776/comment/v2?callback=_varticle2580302776commentv2&orinum=10&oriorder=o&pageflag=1&cursor="+cursor_id+"&scorecursor=0&orirepnum=2&reporder=o&reppageflag=1&source=9&_="+str(v_id)

for i in range(0,10):

content = urllib.request.urlopen(url).read().decode("utf-8")

patnext = '"last":"(.*?)"'

nextid = re.compile(patnext).findall(content)[0]

patcomment = '"content":"(.*?)",'

comment_content = re.compile(patcomment).findall(content)

for j in range(1,len(comment_content)):

print("-----第"+str(i)+str(j)+"条评论内容是:")

#print(eval("u"+"\'"+comment_content[j]+"\'"))

try:

t1 = comment_content[j].encode('latin-1').decode('unicode_escape')

print(t1)

except Exception as e:

print("***********该条评论含有有特殊字符************")

url="https://video.coral.qq.com/varticle/2580302776/comment/v2?callback=_varticle2580302776commentv2&orinum=10&oriorder=o&pageflag=1&cursor="+nextid+"&scorecursor=0&orirepnum=2&reporder=o&reppageflag=1&source=9&_="+str(v_id+i)

【Python3 爬虫】16_抓取腾讯视频评论内容的更多相关文章

- Python爬虫实现抓取腾讯视频所有电影【实战必学】

2019-06-27 23:51:51 阅读数 407 收藏 更多 分类专栏: python爬虫 前言本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问 ...

- 用python实现的抓取腾讯视频所有电影的爬虫

1. [代码]用python实现的抓取腾讯视频所有电影的爬虫 # -*- coding: utf-8 -*-# by awakenjoys. my site: www.dianying.atim ...

- java爬虫抓取腾讯漫画评论

package com.eteclab.wodm.utils; import java.io.BufferedWriter; import java.io.File; import java.io.F ...

- 用python 抓取B站视频评论,制作词云

python 作为爬虫利器,与其有很多强大的第三方库是分不开的,今天说的爬取B站的视频评论,其实重点在分析得到的评论化作嵌套的字典,在其中取出想要的内容.层层嵌套,眼花缭乱,分析时应细致!步骤分为以下 ...

- Python爬虫,抓取淘宝商品评论内容!

作为一个资深吃货,网购各种零食是很频繁的,但是能否在浩瀚的商品库中找到合适的东西,就只能参考评论了!今天给大家分享用python做个抓取淘宝商品评论的小爬虫! 思路 我们就拿"德州扒鸡&qu ...

- python 爬取腾讯视频评论

import urllib.request import re import urllib.error headers=('user-agent','Mozilla/5.0 (Windows NT 1 ...

- Python爬虫实战:爬取腾讯视频的评论

前言 本文的文字及图片来源于网络,仅供学习.交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理. 作者: 易某某 PS:如有需要Python学习资料的小伙伴可以加点击下方链 ...

- python爬虫(3)——用户和IP代理池、抓包分析、异步请求数据、腾讯视频评论爬虫

用户代理池 用户代理池就是将不同的用户代理组建成为一个池子,随后随机调用. 作用:每次访问代表使用的浏览器不一样 import urllib.request import re import rand ...

- python 爬取腾讯视频的全部评论

一.网址分析 查阅了网上的大部分资料,大概都是通过抓包获取.但是抓包有点麻烦,尝试了F12,也可以获取到评论.以电视剧<在一起>为例子.评论最底端有个查看更多评论猜测过去应该是 Ajax ...

随机推荐

- 解决Unknown host 'd29vzk4ow07wi7.cloudfront.net'. You may need to adjust the proxy settings in Gradle.

有时候打开AndroidStudio项目,没问题啊,昨天还打开没事的,今天打不开了或者你同步了一下项目,报错了.很无辜有没有.有时候多开机几次,多关几次AS,又莫名好了. 尝试过很多方法无效,这个文章 ...

- 【互动问答分享】第13期决胜云计算大数据时代Spark亚太研究院公益大讲堂

“决胜云计算大数据时代” Spark亚太研究院100期公益大讲堂 [第13期互动问答分享] Q1:tachyon+spark框架现在有很多大公司在使用吧? Yahoo!已经在长期大规模使用: 国内也有 ...

- 二分+Kruskal【p2798】爆弹虐场

Description 某年某月某日,Kiana 结识了一名爆弹虐场的少年. Kiana 仗着自己多学了几年OI,所以还可以勉勉强强给这位少年 讲一些自己擅长的题.具体来说,Kiana 先给这位少年灌 ...

- Jenkins使用SSH远程发布

远程发布需要安装Publish Over SSH插件 比如我们的应用服务器都是通过tomcat用户启动程序,因此,在jenkin服务器上配置免密登录远程服务器tomcat用户 //生成密钥对 ssh- ...

- IDL软件初步了解

软件名称:IDL(交互式数据语言Interactive Data Language) 软件类别:是国产软件,语言类,数据分析类,数据可视化类 语言类别:解释型 作用:可以进行数据处理的可视化等,在大数 ...

- 【树状数组】Codeforces Round #755 D. PolandBall and Polygon

http://codeforces.com/problemset/problem/755/D 每次新画一条对角线的时候,考虑其跨越了几条原有的对角线. 可以用树状数组区间修改点查询来维护多边形的顶点. ...

- 【树链剖分/线段树】BZOJ1036-[ZJOI2008]树的统计Count

[题目大意] 一棵树上有n个节点,编号分别为1到n,每个节点都有一个权值w.我们将以下面的形式来要求你对这棵树完成 一些操作: I. CHANGE u t : 把结点u的权值改为t II. QMAX ...

- 1.3(学习笔记)JSP(Java Server Pages)内置对象

一.内置对象 内置对象又称内建对象.隐式对象,是由服务器自动创建实例化的, 用户在使用时不需要显示的创建,可直接使用. jsp内置对象名称,类型及作用域 Scope代表该内置对象的作用范围,page表 ...

- Scala实战高手****第7课:零基础实战Scala面向对象编程及Spark源码解析

/** * 如果有这些语法的支持,我们说这门语言是支持面向对象的语言 * 其实真正面向对象的精髓是不是封装.继承.多态呢? * --->肯定不是,封装.继承.多态,只不过是支撑面向对象的 * 一 ...

- MyBasic架构

MyBasic架构图 2,架构图解析 (1) (2) (3)