【赵渝强老师】Flink的DataSet算子

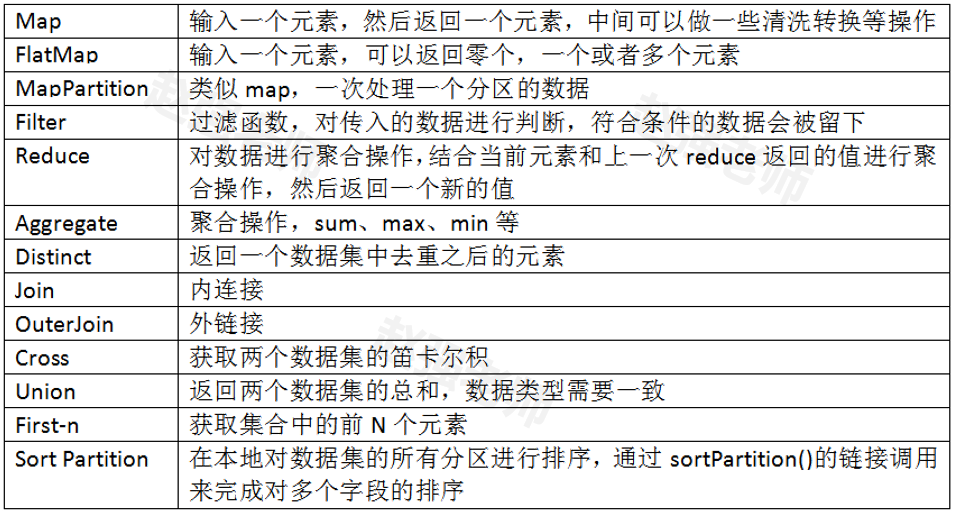

Flink为了能够处理有边界的数据集和无边界的数据集,提供了对应的DataSet API和DataStream API。我们可以开发对应的Java程序或者Scala程序来完成相应的功能。下面举例了一些DataSet API中的基本的算子。

下面我们通过具体的代码来为大家演示每个算子的作用。

1、Map、FlatMap与MapPartition

//获取运行环境

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment(); ArrayList<String> data = new ArrayList<String>();

data.add("I love Beijing");

data.add("I love China");

data.add("Beijing is the capital of China");

DataSource<String> text = env.fromCollection(data); DataSet<List<String>> mapData = text.map(new MapFunction<String, List<String>>() { public List<String> map(String data) throws Exception {

String[] words = data.split(" "); //创建一个List

List<String> result = new ArrayList<String>();

for(String w:words){

result.add(w);

}

return result;

}

});

mapData.print();

System.out.println("*****************************************"); DataSet<String> flatMapData = text.flatMap(new FlatMapFunction<String, String>() { public void flatMap(String data, Collector<String> collection) throws Exception {

String[] words = data.split(" ");

for(String w:words){

collection.collect(w);

}

}

});

flatMapData.print(); System.out.println("*****************************************");

/* new MapPartitionFunction<String, String>

第一个String:表示分区中的数据元素类型

第二个String:表示处理后的数据元素类型*/

DataSet<String> mapPartitionData = text.mapPartition(new MapPartitionFunction<String, String>() { public void mapPartition(Iterable<String> values, Collector<String> out) throws Exception {

//针对分区进行操作的好处是:比如要进行数据库的操作,一个分区只需要创建一个Connection

//values中保存了一个分区的数据

Iterator<String> it = values.iterator();

while (it.hasNext()) {

String next = it.next();

String[] split = next.split(" ");

for (String word : split) {

out.collect(word);

}

}

//关闭链接

}

});

mapPartitionData.print();

2、Filter与Distinct

//获取运行环境

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment(); ArrayList<String> data = new ArrayList<String>();

data.add("I love Beijing");

data.add("I love China");

data.add("Beijing is the capital of China");

DataSource<String> text = env.fromCollection(data); DataSet<String> flatMapData = text.flatMap(new FlatMapFunction<String, String>() { public void flatMap(String data, Collector<String> collection) throws Exception {

String[] words = data.split(" ");

for(String w:words){

collection.collect(w);

}

}

}); //去掉重复的单词

flatMapData.distinct().print();

System.out.println("*********************"); //选出长度大于3的单词

flatMapData.filter(new FilterFunction<String>() { public boolean filter(String word) throws Exception {

int length = word.length();

return length>3?true:false;

}

}).print();

3、Join操作

//获取运行的环境

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment(); //创建第一张表:用户ID 姓名

ArrayList<Tuple2<Integer, String>> data1 = new ArrayList<Tuple2<Integer,String>>();

data1.add(new Tuple2(1,"Tom"));

data1.add(new Tuple2(2,"Mike"));

data1.add(new Tuple2(3,"Mary"));

data1.add(new Tuple2(4,"Jone"));

//创建第二张表:用户ID 所在的城市

ArrayList<Tuple2<Integer, String>> data2 = new ArrayList<Tuple2<Integer,String>>();

data2.add(new Tuple2(1,"北京"));

data2.add(new Tuple2(2,"上海"));

data2.add(new Tuple2(3,"广州"));

data2.add(new Tuple2(4,"重庆")); //实现join的多表查询:用户ID 姓名 所在的程序

DataSet<Tuple2<Integer, String>> table1 = env.fromCollection(data1);

DataSet<Tuple2<Integer, String>> table2 = env.fromCollection(data2); table1.join(table2).where(0).equalTo(0)

/*第一个Tuple2<Integer,String>:表示第一张表

* 第二个Tuple2<Integer,String>:表示第二张表

* Tuple3<Integer,String, String>:多表join连接查询后的返回结果 */

.with(new JoinFunction<Tuple2<Integer,String>, Tuple2<Integer,String>, Tuple3<Integer,String, String>>() {

public Tuple3<Integer, String, String> join(Tuple2<Integer, String> table1,

Tuple2<Integer, String> table2) throws Exception {

return new Tuple3<Integer, String, String>(table1.f0,table1.f1,table2.f1);

} }).print();

4、笛卡尔积

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment(); //创建第一张表:用户ID 姓名

ArrayList<Tuple2<Integer, String>> data1 = new ArrayList<Tuple2<Integer,String>>();

data1.add(new Tuple2(1,"Tom"));

data1.add(new Tuple2(2,"Mike"));

data1.add(new Tuple2(3,"Mary"));

data1.add(new Tuple2(4,"Jone")); //创建第二张表:用户ID 所在的城市

ArrayList<Tuple2<Integer, String>> data2 = new ArrayList<Tuple2<Integer,String>>();

data2.add(new Tuple2(1,"北京"));

data2.add(new Tuple2(2,"上海"));

data2.add(new Tuple2(3,"广州"));

data2.add(new Tuple2(4,"重庆")); //实现join的多表查询:用户ID 姓名 所在的程序

DataSet<Tuple2<Integer, String>> table1 = env.fromCollection(data1);

DataSet<Tuple2<Integer, String>> table2 = env.fromCollection(data2); //生成笛卡尔积

table1.cross(table2).print();

5、First-N

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment(); //这里的数据是:员工姓名、薪水、部门号

DataSet<Tuple3<String, Integer,Integer>> grade =

env.fromElements(new Tuple3<String, Integer,Integer>("Tom",1000,10),

new Tuple3<String, Integer,Integer>("Mary",1500,20),

new Tuple3<String, Integer,Integer>("Mike",1200,30),

new Tuple3<String, Integer,Integer>("Jerry",2000,10)); //按照插入顺序取前三条记录

grade.first(3).print();

System.out.println("**********************"); //先按照部门号排序,在按照薪水排序

grade.sortPartition(2, Order.ASCENDING).sortPartition(1, Order.ASCENDING).print();

System.out.println("**********************"); //按照部门号分组,求每组的第一条记录

grade.groupBy(2).first(1).print();

6、外链接操作

ExecutionEnvironment env = ExecutionEnvironment.getExecutionEnvironment(); //创建第一张表:用户ID 姓名

ArrayList<Tuple2<Integer, String>> data1 = new ArrayList<Tuple2<Integer,String>>();

data1.add(new Tuple2(1,"Tom"));

data1.add(new Tuple2(3,"Mary"));

data1.add(new Tuple2(4,"Jone")); //创建第二张表:用户ID 所在的城市

ArrayList<Tuple2<Integer, String>> data2 = new ArrayList<Tuple2<Integer,String>>();

data2.add(new Tuple2(1,"北京"));

data2.add(new Tuple2(2,"上海"));

data2.add(new Tuple2(4,"重庆")); //实现join的多表查询:用户ID 姓名 所在的程序

DataSet<Tuple2<Integer, String>> table1 = env.fromCollection(data1);

DataSet<Tuple2<Integer, String>> table2 = env.fromCollection(data2); //左外连接

table1.leftOuterJoin(table2).where(0).equalTo(0)

.with(new JoinFunction<Tuple2<Integer,String>, Tuple2<Integer,String>, Tuple3<Integer,String,String>>() { public Tuple3<Integer, String, String> join(Tuple2<Integer, String> table1,

Tuple2<Integer, String> table2) throws Exception {

// 左外连接表示等号左边的信息会被包含

if(table2 == null){

return new Tuple3<Integer, String, String>(table1.f0,table1.f1,null);

}else{

return new Tuple3<Integer, String, String>(table1.f0,table1.f1,table2.f1);

}

}

}).print(); System.out.println("***********************************");

//右外连接

table1.rightOuterJoin(table2).where(0).equalTo(0)

.with(new JoinFunction<Tuple2<Integer,String>, Tuple2<Integer,String>, Tuple3<Integer,String,String>>() { public Tuple3<Integer, String, String> join(Tuple2<Integer, String> table1,

Tuple2<Integer, String> table2) throws Exception {

//右外链接表示等号右边的表的信息会被包含

if(table1 == null){

return new Tuple3<Integer, String, String>(table2.f0,null,table2.f1);

}else{

return new Tuple3<Integer, String, String>(table2.f0,table1.f1,table2.f1);

}

}

}).print(); System.out.println("***********************************"); //全外连接

table1.fullOuterJoin(table2).where(0).equalTo(0)

.with(new JoinFunction<Tuple2<Integer,String>, Tuple2<Integer,String>, Tuple3<Integer,String,String>>() { public Tuple3<Integer, String, String> join(Tuple2<Integer, String> table1, Tuple2<Integer, String> table2)

throws Exception {

if(table1 == null){

return new Tuple3<Integer, String, String>(table2.f0,null,table2.f1);

}else if(table2 == null){

return new Tuple3<Integer, String, String>(table1.f0,table1.f1,null);

}else{

return new Tuple3<Integer, String, String>(table1.f0,table1.f1,table2.f1);

}

} }).print();

【赵渝强老师】Flink的DataSet算子的更多相关文章

- 201871010136—赵艳强《面向对象程序设计(java)》第十三周学习总结

201871010136—赵艳强<面向对象程序设计(java)>第十三周学习总结 博文正文开头格式:(2分) 项目 内容 <面向对象程序设计(java)> https:// ...

- Apache Flink - Batch(DataSet API)

Flink DataSet API编程指南: Flink中的DataSet程序是实现数据集转换的常规程序(例如,过滤,映射,连接,分组).数据集最初是从某些来源创建的(例如,通过读取文件或从本地集合创 ...

- Flink中的算子操作

一.Connect DataStream,DataStream -> ConnectedStream,连接两个保持他们类型的数据流,两个数据流被Connect之后,只是被放在了同一个流中,内部 ...

- Flink的异步算子的原理及使用

1.简介 Flink的特点是高吞吐低延迟.但是Flink中的某环节的数据处理逻辑需要和外部系统交互,调用耗时不可控会显著降低集群性能.这时候就可能需要使用异步算子让耗时操作不需要等待结果返回就可以继续 ...

- 201871010136 -赵艳强《面向对象程序设计(java)》第十六周学习总结

201871010136-赵艳强<面向对象程序设计(java)>第十六周学习总结 项目 内容 这个作业属于哪个课程 <任课教师博客主页链接>https://www.cnbl ...

- flink dataset api使用及原理

随着大数据技术在各行各业的广泛应用,要求能对海量数据进行实时处理的需求越来越多,同时数据处理的业务逻辑也越来越复杂,传统的批处理方式和早期的流式处理框架也越来越难以在延迟性.吞吐量.容错能力以及使用便 ...

- 入门大数据---Flink学习总括

第一节 初识 Flink 在数据激增的时代,催生出了一批计算框架.最早期比较流行的有MapReduce,然后有Spark,直到现在越来越多的公司采用Flink处理.Flink相对前两个框架真正做到了高 ...

- Flink及主流流框架spark,storm比较

干货 | Flink及主流流框架比较 IT刊 百家号17-05-2220:16 引言 随着大数据时代的来临,大数据产品层出不穷.我们最近也对一款业内非常火的大数据产品 - Apache Flink做了 ...

- Flink 灵魂两百问,这谁顶得住?

Flink 学习 https://github.com/zhisheng17/flink-learning 麻烦路过的各位亲给这个项目点个 star,太不易了,写了这么多,算是对我坚持下来的一种鼓励吧 ...

- Flink及Storm、Spark主流流框架比较

转自:http://www.sohu.com/a/142553677_804130 引言 随着大数据时代的来临,大数据产品层出不穷.我们最近也对一款业内非常火的大数据产品 - Apache Flink ...

随机推荐

- Vue入门记录(一)

效果 本文为实现如下前端效果的学习实践记录: 实践 入门的最佳实践我觉得是先去看官网,官网一般都会有快速入门指引. 根据官网的快速上手文档,构建一个新的Vue3+TypeScript,查看新建的项目结 ...

- redis复制replica

通过查看log信息即可观察主机是否与从机正确连接,一般来说主机上有succeeded就是可以了 可以通过info replication查看自己的身份 role:master connected_sl ...

- emojiCTF2024

emojiCTF2024 WEB http 题目: 思路: 修改 UA 头为 EMOJI_CTF_User_Agent_v1.0:User-Agent: EMOJI_CTF_User_Agent_ ...

- 火山引擎VeDI数据技术分享:两个步骤,为Parquet降本提效

更多技术交流.求职机会,欢迎关注字节跳动数据平台微信公众号,回复[1]进入官方交流群 作者:王恩策.徐庆 火山引擎 LAS 团队 火山引擎数智平台 VeDI 是火山引擎推出的新一代企业数据智能平台,基 ...

- 前端RSA密钥生成和加解密——window.crypto使用相关

转自简书,原文地址,本文介绍window.crypto关于RSA方面的API. crypto API支持常用的rsa.aes加解密,这边介绍rsa的应用. 浏览器兼容性 window.crypto需要 ...

- 东北某海滨城市的某高校的某分校区的校园网登录程序,(python3, 模拟浏览器的登入方式)

前些年写过这个登录程序,过了几年系统有所升级,于是做了一定的修改. 新版本的校园网登录程序依然是模拟浏览器去登录校园网. Python3.7编写. #encoding:UTF-8 from urlli ...

- x86_64/aarch64架构下ffpyplayer源码编译

问题来源: 某鱼上挂着pytorch的aarch64架构下的源码编译,遇到某网友提出的要在aarch64架构下的ubuntu上ffpyplayer源码编译,于是有了本文. ============== ...

- 使用pybind11为Python编写一个简单的C语言扩展模块

相关: 为Python编写一个简单的C语言扩展模块 在Pybind11 出现之前为Python编写扩展模块的方法有多种,但是并没有哪种方法被认为一定比其他的好,因此也就变得在为Python编写扩展模块 ...

- .NET电子邮件高效处理解决方案

前言 在日常软件开发中,电子邮件处理是一个不可或缺的功能,无论是用户注册验证.通知推送还是日常的业务沟通,都离不开电子邮件的支持.今天大姚给大家分享2款.NET开源.高效.强大的.NET电子邮件处理库 ...

- 二分答案&前缀和&差分&离散化(简记)

二分答案 基本code int Find(int l,int r) { int ans,mid; while(l<=r) { int mid=l+r>>1; if(Check(mid ...