Hadoop Java Hdfs API

1. 在本地文件系统生成一个文本文件,,读入文件,将其第101-120字节的内容写入HDFS成为一个新文件

2. 在HDFS中生成文本文件,读入这个文件,将其第101-120字节的内容写入本地文件系统成为一个新文件

环境部署:http://www.cnblogs.com/dopeter/p/4630791.html

FileBuilder.java

生成文件的工具类,包含在本地生成文件,在Hadoop生成文件,读取Hadoop指定目录的文件

package story; import java.io.ByteArrayInputStream;

import java.io.ByteArrayOutputStream;

import java.io.FileNotFoundException;

import java.io.FileWriter;

import java.io.IOException;

import java.io.InputStream;

import java.io.OutputStream;

import java.io.PrintWriter;

import java.io.UnsupportedEncodingException;

import java.net.URI; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.util.Progressable; public class FileBuilder { //build default test data

public static String BuildTestFileContent()

{

StringBuilder contentBuilder=new StringBuilder(); for(int loop=0;loop<100;loop++)

contentBuilder.append(String.valueOf(loop)); String content =contentBuilder.toString(); return content;

} //build local file

public static void BuildLocalFile(String buildPath,String content) throws FileNotFoundException, UnsupportedEncodingException

{

/*

FileWriter fileWriter;

try {

fileWriter = new FileWriter(buildPath); fileWriter.write(content);

fileWriter.close();

} catch (IOException e) {

e.printStackTrace();

}

*/ PrintWriter out = new java.io.PrintWriter(new java.io.File(buildPath), "UTF-8");

String text = new java.lang.String(content);

out.print(text);

out.flush();

out.close(); } //upload file to hadoop

public static void BuildHdfsFile(String buildPath,byte[] fileContent) throws IOException

{

//convert to inputstream

InputStream inputStream=new ByteArrayInputStream(fileContent); //hdfs upload

Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create(buildPath), conf);

OutputStream outputStream = fs.create(new Path(buildPath), new Progressable() {

public void progress() {

System.out.print(".");

}

}); IOUtils.copyBytes(inputStream, outputStream, fileContent.length, true);

} //wrapper for upload file

public static void BuildHdfsFile(String buildPath,String fileContent) throws IOException

{

BuildHdfsFile(buildPath,fileContent.getBytes());

} //download file from hadoop

public static byte[] ReadHdfsFile(String readPath)throws IOException

{

byte[] fileBuffer;

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create(readPath), conf);

InputStream in = null;

ByteArrayOutputStream out=new ByteArrayOutputStream();

try {

in = fs.open(new Path(readPath));

IOUtils.copyBytes(in, out, 4096, false); fileBuffer=out.toByteArray();

} finally {

IOUtils.closeStream(in);

} return fileBuffer;

} }

FileContentHandler.java

文件内容的处理类,读取本地文件时设置起始Position与截取的长度,读取从Hadoop下载的文件时设置起始Position与截取的长度

package story; import java.io.IOException;

import java.io.RandomAccessFile;

import java.io.UnsupportedEncodingException; public class FileContentHandler {

public static byte[] GetContentByLocalFile(String filePath,long beginPosition,int readLength)

{

int readBufferSize=readLength;

byte[] readBuffer=new byte[readBufferSize]; RandomAccessFile accessFile;

try {

accessFile=new RandomAccessFile (filePath,"r");

long length=accessFile.length();

System.out.println(length); if(length>beginPosition&&length>beginPosition+readBufferSize)

{

accessFile.seek(beginPosition);

accessFile.read(readBuffer);

accessFile.close();

}

} catch ( IOException e) {

// TODO Auto-generated catch block

e.printStackTrace();

} return readBuffer;

} public static String GetContentByBuffer(byte[] buffer,int beginPosition,int readLength) throws UnsupportedEncodingException

{

String content;

byte[] subBuffer=new byte[readLength];

for(int position=0;position<readLength;position++)

subBuffer[position]=buffer[beginPosition+position]; buffer=null; content=new String(subBuffer,"UTF-8");

System.out.println(content); return content;

} }

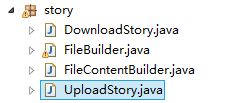

UploadStory.java

1的流程代码

package story;

public class UploadStory {

//public static void main(String[] args) throws Exception {}

public static void main(String[] args) throws Exception {

//also define value of parameter from arguments.

String localFilePath="F:/bulid.txt";

String hdfsFilePath="hdfs://hmaster0:9000/user/14699_000/input/build.txt";

int readBufferSize=20;

long fileBeginReadPosition=101;

//upload story begin.

//build local file

FileBuilder.BuildLocalFile(localFilePath,FileBuilder.BuildTestFileContent());

//read file

byte[] uploadBuffer=FileContentHandler.GetContentByLocalFile(localFilePath, fileBeginReadPosition, readBufferSize);

//upload

if(uploadBuffer!=null&&uploadBuffer.length>0)

FileBuilder.BuildHdfsFile(hdfsFilePath, uploadBuffer);

}

}

DownloadStory.java

2的流程代码

package story;

public class DownloadStory {

//public static void main(String[] args) throws Exception { }

public static void main(String[] args) throws Exception {

//also define value of parameter from arguments.

String localFilePath="F:/bulid.txt";

String hdfsFilePath="hdfs://hmaster0:9000/user/14699_000/input/build2.txt";

int readBufferSize=20;

int fileBeginReadPosition=101;

//build file to hadoop

FileBuilder.BuildHdfsFile(hdfsFilePath, FileBuilder.BuildTestFileContent());

//download file

byte[] readBuffer=FileBuilder.ReadHdfsFile(hdfsFilePath);

//handle buffer

String content=FileContentBuilder.GetContentByBuffer(readBuffer, fileBeginReadPosition, readBufferSize);

//write to local file

FileBuilder.BuildLocalFile(localFilePath, content);

}

}

Hadoop Java Hdfs API的更多相关文章

- Hadoop JAVA HDFS客户端操作

JAVA HDFS客户端操作 通过API操作HDFS org.apache.logging.log4jlog4j-core2.8.2org.apache.hadoophadoop-common${ha ...

- hadoop学习笔记(七):Java HDFS API

一.使用HDFS FileSystem详解 HDFS依赖的第三方包: hadoop 1.x版本: commons-configuration-1.6.jar commons-lang-2.4.jar ...

- Hadoop 之 HDFS API操作

1. 文件上传 @Slf4j public class HDFSClient { @Test public void testCopyFromLocalFile() throws Exception{ ...

- JAVA HDFS API Client 连接HA

如果Hadoop开启HA,那么用Java Client连接Hive的时候,需要指定一些额外的参数 package cn.itacst.hadoop.hdfs; import java.io.FileI ...

- hadoop系列二:HDFS文件系统的命令及JAVA客户端API

转载请在页首明显处注明作者与出处 一:说明 此为大数据系列的一些博文,有空的话会陆续更新,包含大数据的一些内容,如hadoop,spark,storm,机器学习等. 当前使用的hadoop版本为2.6 ...

- hadoop: hdfs API示例

利用hdfs的api,可以实现向hdfs的文件.目录读写,利用这一套API可以设计一个简易的山寨版云盘,见下图: 为了方便操作,将常用的文件读写操作封装了一个工具类: import org.apach ...

- Hadoop Java API 操作 hdfs--1

Hadoop文件系统是一个抽象的概念,hdfs仅仅是Hadoop文件系统的其中之一. 就hdfs而言,访问该文件系统有两种方式:(1)利用hdfs自带的命令行方式,此方法类似linux下面的shell ...

- Hadoop基础-HDFS的API常见操作

Hadoop基础-HDFS的API常见操作 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 本文主要是记录一写我在学习HDFS时的一些琐碎的学习笔记, 方便自己以后查看.在调用API ...

- Hadoop学习之路(十)HDFS API的使用

HDFS API的高级编程 HDFS的API就两个:FileSystem 和Configuration 1.文件的上传和下载 package com.ghgj.hdfs.api; import org ...

随机推荐

- JAVA 数据权限设计

数据权限设计 前言 在各种系统中.要保证数据对象的安全性以及易操作性,使企业的各业务部门.职能部门可以方便并且高效的协同工作,那么一个好的数据权限管理设计就成为一个关键的问题.尽管企业中各个单元的工作 ...

- Nginx Rewrite规则记录

Rewrite 是一种服务器的重写脉冲技术,它可以使得服务器可以支持 URL 重写,是一种最新流行的服务器技术.它还可以实现限制特定IP访问网站的功能.很多情况下,某个 IP 的访问很容易造成 CPU ...

- Ceph更多Mon 更多mds

1.当前状态 watermark/2/text/aHR0cDovL2Jsb2cuY3Nkbi5uZXQvdWpfbW9zcXVpdG8=/font/5a6L5L2T/fontsize/400/fill ...

- C# Windows Phone App 开发,自制LockScreen 锁定画面类别(Class),从【网路图片】、【Assets资源】、【UI】修改锁定画面。

原文:C# Windows Phone App 开发,自制LockScreen 锁定画面类别(Class),从[网路图片].[Assets资源].[UI]修改锁定画面. 一般我们在开发Windows ...

- 冒泡排序算法(Java)

冒泡排序即每次遍历.相邻数字间进行比較,前者大于后者进行交换,不断将最大值后移,直至沉至最后位置:算法关键要点在于确定每次循环的边界. 后面两种算法则是对冒泡排序一定程度上的改良,但相对于其它排 ...

- 解决mongodb设备mongod命令不是内部或外部的命令

1:安装 去mongodb的官网http://www.mongodb.org/downloads下载32bit的包 解压后会出现下面文件 在安装的盘C:下建立mongodb目录,拷贝bin目录到该目录 ...

- 【屌丝程序的口才逆袭演讲稿50篇】第十篇:程序猿们请看看外面的世界吧【张振华.Jack】

演讲稿主题:<程序猿们请看看外面的世界吧> --作者:张振华Jack 大家都知道我是一个程序猿.几年下来认识了最典型的三个程序猿. ...

- 公钥\私人 ssh避password登陆

相关概念以前见过,决不要注意,使用公共密钥管理之前,腾讯云主机的备案机,非常头发的感觉,查了一下相关资料,这里总结下: 字符a:192.168.7.188 (ubuntu) 字符b:192.168.7 ...

- poj 3662 Telephone Lines spfa算法灵活运用

意甲冠军: 到n节点无向图,它要求从一个线1至n路径.你可以让他们在k无条,的最大值.如今要求花费的最小值. 思路: 这道题能够首先想到二分枚举路径上的最大值,我认为用spfa更简洁一些.spfa的本 ...

- JSON小结

在 JSON 中,“Object” 是什么呢? json.org 有很好的解释: 1 .An object is an unordered set of name/value pairs. 2.An ...