Hadoop Java Hdfs API

1. 在本地文件系统生成一个文本文件,,读入文件,将其第101-120字节的内容写入HDFS成为一个新文件

2. 在HDFS中生成文本文件,读入这个文件,将其第101-120字节的内容写入本地文件系统成为一个新文件

环境部署:http://www.cnblogs.com/dopeter/p/4630791.html

FileBuilder.java

生成文件的工具类,包含在本地生成文件,在Hadoop生成文件,读取Hadoop指定目录的文件

package story; import java.io.ByteArrayInputStream;

import java.io.ByteArrayOutputStream;

import java.io.FileNotFoundException;

import java.io.FileWriter;

import java.io.IOException;

import java.io.InputStream;

import java.io.OutputStream;

import java.io.PrintWriter;

import java.io.UnsupportedEncodingException;

import java.net.URI; import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IOUtils;

import org.apache.hadoop.util.Progressable; public class FileBuilder { //build default test data

public static String BuildTestFileContent()

{

StringBuilder contentBuilder=new StringBuilder(); for(int loop=0;loop<100;loop++)

contentBuilder.append(String.valueOf(loop)); String content =contentBuilder.toString(); return content;

} //build local file

public static void BuildLocalFile(String buildPath,String content) throws FileNotFoundException, UnsupportedEncodingException

{

/*

FileWriter fileWriter;

try {

fileWriter = new FileWriter(buildPath); fileWriter.write(content);

fileWriter.close();

} catch (IOException e) {

e.printStackTrace();

}

*/ PrintWriter out = new java.io.PrintWriter(new java.io.File(buildPath), "UTF-8");

String text = new java.lang.String(content);

out.print(text);

out.flush();

out.close(); } //upload file to hadoop

public static void BuildHdfsFile(String buildPath,byte[] fileContent) throws IOException

{

//convert to inputstream

InputStream inputStream=new ByteArrayInputStream(fileContent); //hdfs upload

Configuration conf = new Configuration(); FileSystem fs = FileSystem.get(URI.create(buildPath), conf);

OutputStream outputStream = fs.create(new Path(buildPath), new Progressable() {

public void progress() {

System.out.print(".");

}

}); IOUtils.copyBytes(inputStream, outputStream, fileContent.length, true);

} //wrapper for upload file

public static void BuildHdfsFile(String buildPath,String fileContent) throws IOException

{

BuildHdfsFile(buildPath,fileContent.getBytes());

} //download file from hadoop

public static byte[] ReadHdfsFile(String readPath)throws IOException

{

byte[] fileBuffer;

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create(readPath), conf);

InputStream in = null;

ByteArrayOutputStream out=new ByteArrayOutputStream();

try {

in = fs.open(new Path(readPath));

IOUtils.copyBytes(in, out, 4096, false); fileBuffer=out.toByteArray();

} finally {

IOUtils.closeStream(in);

} return fileBuffer;

} }

FileContentHandler.java

文件内容的处理类,读取本地文件时设置起始Position与截取的长度,读取从Hadoop下载的文件时设置起始Position与截取的长度

package story; import java.io.IOException;

import java.io.RandomAccessFile;

import java.io.UnsupportedEncodingException; public class FileContentHandler {

public static byte[] GetContentByLocalFile(String filePath,long beginPosition,int readLength)

{

int readBufferSize=readLength;

byte[] readBuffer=new byte[readBufferSize]; RandomAccessFile accessFile;

try {

accessFile=new RandomAccessFile (filePath,"r");

long length=accessFile.length();

System.out.println(length); if(length>beginPosition&&length>beginPosition+readBufferSize)

{

accessFile.seek(beginPosition);

accessFile.read(readBuffer);

accessFile.close();

}

} catch ( IOException e) {

// TODO Auto-generated catch block

e.printStackTrace();

} return readBuffer;

} public static String GetContentByBuffer(byte[] buffer,int beginPosition,int readLength) throws UnsupportedEncodingException

{

String content;

byte[] subBuffer=new byte[readLength];

for(int position=0;position<readLength;position++)

subBuffer[position]=buffer[beginPosition+position]; buffer=null; content=new String(subBuffer,"UTF-8");

System.out.println(content); return content;

} }

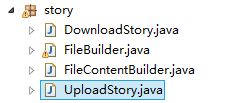

UploadStory.java

1的流程代码

package story;

public class UploadStory {

//public static void main(String[] args) throws Exception {}

public static void main(String[] args) throws Exception {

//also define value of parameter from arguments.

String localFilePath="F:/bulid.txt";

String hdfsFilePath="hdfs://hmaster0:9000/user/14699_000/input/build.txt";

int readBufferSize=20;

long fileBeginReadPosition=101;

//upload story begin.

//build local file

FileBuilder.BuildLocalFile(localFilePath,FileBuilder.BuildTestFileContent());

//read file

byte[] uploadBuffer=FileContentHandler.GetContentByLocalFile(localFilePath, fileBeginReadPosition, readBufferSize);

//upload

if(uploadBuffer!=null&&uploadBuffer.length>0)

FileBuilder.BuildHdfsFile(hdfsFilePath, uploadBuffer);

}

}

DownloadStory.java

2的流程代码

package story;

public class DownloadStory {

//public static void main(String[] args) throws Exception { }

public static void main(String[] args) throws Exception {

//also define value of parameter from arguments.

String localFilePath="F:/bulid.txt";

String hdfsFilePath="hdfs://hmaster0:9000/user/14699_000/input/build2.txt";

int readBufferSize=20;

int fileBeginReadPosition=101;

//build file to hadoop

FileBuilder.BuildHdfsFile(hdfsFilePath, FileBuilder.BuildTestFileContent());

//download file

byte[] readBuffer=FileBuilder.ReadHdfsFile(hdfsFilePath);

//handle buffer

String content=FileContentBuilder.GetContentByBuffer(readBuffer, fileBeginReadPosition, readBufferSize);

//write to local file

FileBuilder.BuildLocalFile(localFilePath, content);

}

}

Hadoop Java Hdfs API的更多相关文章

- Hadoop JAVA HDFS客户端操作

JAVA HDFS客户端操作 通过API操作HDFS org.apache.logging.log4jlog4j-core2.8.2org.apache.hadoophadoop-common${ha ...

- hadoop学习笔记(七):Java HDFS API

一.使用HDFS FileSystem详解 HDFS依赖的第三方包: hadoop 1.x版本: commons-configuration-1.6.jar commons-lang-2.4.jar ...

- Hadoop 之 HDFS API操作

1. 文件上传 @Slf4j public class HDFSClient { @Test public void testCopyFromLocalFile() throws Exception{ ...

- JAVA HDFS API Client 连接HA

如果Hadoop开启HA,那么用Java Client连接Hive的时候,需要指定一些额外的参数 package cn.itacst.hadoop.hdfs; import java.io.FileI ...

- hadoop系列二:HDFS文件系统的命令及JAVA客户端API

转载请在页首明显处注明作者与出处 一:说明 此为大数据系列的一些博文,有空的话会陆续更新,包含大数据的一些内容,如hadoop,spark,storm,机器学习等. 当前使用的hadoop版本为2.6 ...

- hadoop: hdfs API示例

利用hdfs的api,可以实现向hdfs的文件.目录读写,利用这一套API可以设计一个简易的山寨版云盘,见下图: 为了方便操作,将常用的文件读写操作封装了一个工具类: import org.apach ...

- Hadoop Java API 操作 hdfs--1

Hadoop文件系统是一个抽象的概念,hdfs仅仅是Hadoop文件系统的其中之一. 就hdfs而言,访问该文件系统有两种方式:(1)利用hdfs自带的命令行方式,此方法类似linux下面的shell ...

- Hadoop基础-HDFS的API常见操作

Hadoop基础-HDFS的API常见操作 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 本文主要是记录一写我在学习HDFS时的一些琐碎的学习笔记, 方便自己以后查看.在调用API ...

- Hadoop学习之路(十)HDFS API的使用

HDFS API的高级编程 HDFS的API就两个:FileSystem 和Configuration 1.文件的上传和下载 package com.ghgj.hdfs.api; import org ...

随机推荐

- C++经典面试题(二)

近期看一些面试题,认为假设自己被问到了,并不能非常利落的回答出来. 一是从来没有这个意识,二是没有认真的梳理下. 以下对这些题做出分析,哈!个人能力有限,当中难免有疏漏,欢迎大家补充咯. 11.引用与 ...

- Java EE (7) -- Java EE 6 Enterprise Architect Certified Master(1z0-807)

Application Design Concepts and Principles Identify the effects of an object-oriented approach to sy ...

- jenkins集群加入Windows 2012 server作为slave

必须安装.net framework 3.5, 參考: http://technet.microsoft.com/en-us/library/dn482071.aspx 不要在windows 2012 ...

- Form表单中的action路径问题

今天刚接触web,在用jsp和servlet做一个简单的登陆的时候在Form表单action属性和method属性的一些问题: 我遇到的是Form表单提交到servelet处理时遇到的问题: (1 ...

- jspsmart(支持中文下载)

将excel文件从jsp页面导入到数据库,先将文件上传到server,然后读取,最后删除掉上传//要加encType="multipart/form-data"<form a ...

- Struts的ONGL

1.什么是OGNL OGNL它是Object Graphic Navigation Language(对象图导航语言)缩写, 它是一个开源项目. Struts2框架使用OGNL作为默认的表达式语 ...

- iOS的图表显示的实现

在app通常有家居展览的照片,显示广告.或者头条新闻.通常网易新闻client 如图,红框框的位置就是一个典型的图展, 熟悉iOS的人肯定知道,这个是个UIScrollview,里面加几张图片就可以实 ...

- iOS开展-clang: error: unknown argument: '-websockets'解决方案

问题: 昨天莫名其妙Xcode自己主动升级,那么今天之前执行project什么时候,不知怎的,他们都获得了. 错误内容: clang: error: unknown argument: '-webso ...

- Linux 下一个 Mysql error 2002 错误解决

Linux 下一个 Mysql error 2002 错误解决 首先查看 /etc/rc.d/init.d/mysqld status 查看mysql它已开始. 假设启动的的话,先将数 ...

- 理解JavaScript的闭包

在JS这块,免不了被问什么是闭包. 从一个常见的循环问题说起. 有一个ul列表, 里面有5个li标签,我希望点击每个li标签的时候,弹出每个li标签对应的索引值(第一个弹出0,第二个弹出1...). ...