storm并行

Storm并行度

public class WordCountTopology {

private static final String SENTENCE_SPOUT_ID = "sentence-spout";

private static final String SPLIT_BOLT_ID = "split-bolt";

private static final String COUNT_BOLT_ID = "count-bolt";

private static final String REPORT_BOLT_ID = "report-bolt";

private static final String TOPOLOGY_NAME = "word-count-topology";

public static void main(String[] args) throws

Exception {

SentenceSpout spout = new SentenceSpout();

SplitSentenceBolt splitBolt = new

SplitSentenceBolt();

WordCountBolt countBolt = new WordCountBolt();

ReportBolt reportBolt = new ReportBolt();

TopologyBuilder builder = new TopologyBuilder();

builder.setSpout(SENTENCE_SPOUT_ID, spout);

// SentenceSpout --> SplitSentenceBolt

builder.setBolt(SPLIT_BOLT_ID, splitBolt).shuffleGrouping(SENTENCE_SPOUT_ID);

// SplitSentenceBolt --> WordCountBolt

builder.setBolt(COUNT_BOLT_ID, countBolt).fieldsGrouping(

SPLIT_BOLT_ID, new Fields("word"));

// WordCountBolt --> ReportBolt

builder.setBolt(REPORT_BOLT_ID, reportBolt).globalGrouping(COUNT_BOLT_ID);

Config config = new Config();

LocalCluster cluster = new LocalCluster();

cluster.submitTopology(TOPOLOGY_NAME, config,

builder.createTopology());

Utils.sleep(10000);

cluster.killTopology(TOPOLOGY_NAME);

cluster.shutdown();

}

}

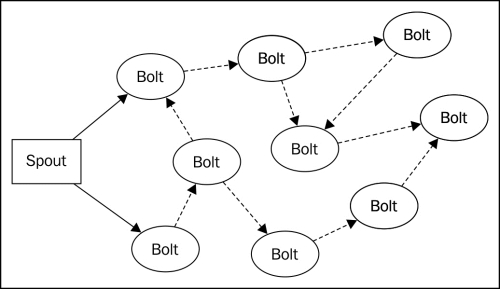

流程:(包括一个spout和三个bolt)

sentence-spout 生成句子

split-bolt 切分句子传入单词

count-bolt 单词统计

report-bolt 结果输出

1、WordCountTopology并行性

2、在拓扑中增加worker

Config config = new Config();

config.setNumWorkers(2);

3、配置executor数和task数

builder.setSpout(SENTENCE_SPOUT_ID, spout, 2);

builder.setBolt(SPLIT_BOLT_ID, splitBolt, 2).setNumTasks(4)

.shuffleGrouping(SENTENCE_SPOUT_ID);

builder.setBolt(COUNT_BOLT_ID, countBolt, 4)

.fieldsGrouping(SPLIT_BOLT_ID, newFields("word"));

--- FINAL COUNTS ---

a : 2726

ate : 2722

beverages : 2723

cold : 2723

cow : 2726

dog : 5445

don't : 5444

fleas : 5451

has : 2723

have : 2722

homework : 2722

i : 8175

like : 5449

man : 2722

my : 5445

the : 2727

think : 2722

--------------

原来的结果:

--- FINAL COUNTS ---

a : 1426

ate : 1426

beverages : 1426

cold : 1426

cow : 1426

dog : 2852

don't : 2851

fleas : 2851

has : 1426

have : 1426

homework : 1426

i : 4276

like : 2851

man : 1426

my : 2852

the : 1426

think : 1425

--------------

Storm流分组

public interface CustomStreamGrouping extends Serializable {

void prepare(WorkerTopologyContext context, GlobalStreamId stream, List<Integer> targetTasks);

List<Integer> chooseTasks(int taskId, List<Object> values);

}

public void nextTuple() {

if(index < sentences.length){

this.collector.emit(new Values(sentences[index]));

index++;

}

Utils.waitForMillis(1);

}

--- FINAL COUNTS ---

a : 2

ate : 2

beverages : 2

cold : 2

cow : 2

dog : 4

don't : 4

fleas : 4

has : 2

have : 2

homework : 2

i : 6

like : 4

man : 2

my : 4

the : 2

think : 2

--------------

原来:

builder.setBolt(COUNT_BOLT_ID, countBolt, 4)

.fieldsGrouping(SPLIT_BOLT_ID, newFields("word"))

改成:

builder.setBolt(COUNT_BOLT_ID, countBolt, 4)

.shuffleGrouping(SPLIT_BOLT_ID);

--- FINAL COUNTS ---

a : 1

ate : 2

beverages : 1

cold : 1

cow : 1

dog : 2

don't : 2

fleas : 1

has : 1

have : 1

homework : 1

i : 3

like : 1

man : 1

my : 1

the : 1

think : 1

--------------

我们计算不正确了,因为CountBolt参数是有状态:它保留一个计数为每个收到的单词的。在这种情况下,我们计算的准确性取决于当组件被并行化基于元组的内容分组的能力。引入的错误我们将只显示如果CountBolt参数大于1的并行性。这强调了测试拓扑与各种并行配置的重要性。

1、Tip

2、消息处理保证

3、Spout的可靠性

public interface ISpout extends Serializable {

void open(Map conf, TopologyContext context, SpoutOutputCollector collector);

void close();

void nextTuple();

void ack(Object msgId);

void fail(Object msgId);

}

collector.emit(new Values("value1", "value2") ,msgId);

4、bolt可靠性

collector.emit(tuple, new Values(word));

collector.emit(new Values(word));

this.collector.ack(tuple);

this.collector.fail(tuple)

5、可靠的word count(修改后的程序)

public class SentenceSpout extends BaseRichSpout {

private ConcurrentHashMap<UUID, Values> pending;

private SpoutOutputCollector collector;

private String[] sentences = {

"my dog has fleas",

"i like cold beverages",

"the dog ate my homework",

"don't have a cow man",

"i don't think i like fleas"

};

private int index = 0;

public void declareOutputFields(OutputFieldsDeclarer declarer) {

declarer.declare(new Fields("sentence"));

}

public void open(Map config, TopologyContext context,

SpoutOutputCollector collector) {

this.collector = collector;

this.pending = new ConcurrentHashMap<UUID, Values>();

}

public void nextTuple() {

Values values = new Values(sentences[index]);

UUID msgId = UUID.randomUUID();

this.pending.put(msgId, values);

this.collector.emit(values, msgId);

index++;

if (index >= sentences.length) {

index = 0;

}

Utils.sleep(1);

}

public void ack(Object msgId) {

this.pending.remove(msgId);

}

public void fail(Object msgId) {

this.collector.emit(this.pending.get(msgId), msgId);

}

}

public class ReliableSplitSentenceBolt extends BaseRichBolt {

private OutputCollector collector;

public void prepare(Map config, TopologyContext

context, OutputCollector collector) {

this.collector = collector;

}

public void execute(Tuple tuple) {

String sentence = tuple.getStringByField("sentence");

String[] words = sentence.split(" ");

for(String word : words){

this.collector.emit(tuple, new Values(word));

}

this.collector.ack(tuple);

}

public void declareOutputFields(OutputFieldsDeclarer declarer) {

declarer.declare(new Fields("word"));

}

}

storm并行的更多相关文章

- storm的并发

1 storm并行的基本概念 storm集群中的一个机器可以运行一个或者多个worker,对应于一个或者多个topologies. 1个worker进程运行1个或多个excutor线程.每个worke ...

- 【Storm篇】--Storm并发机制

一.前述 为了提高Storm的并行能力,通常需要设置并行. 二.具体原理 1. Storm并行分为几个方面: Worker – 进程一个Topology拓扑会包含一个或多个Worker(每个Worke ...

- 【原】理解Storm拓扑的并行

Storm入门教程 1. Storm基础 Storm Storm主要特点 Storm基本概念 Storm调度器 Storm配置 Guaranteeing Message Processing(消息处理 ...

- Storm集群中执行的各种组件及其并行

一.Storm中执行的组件 我们知道,Storm的强大之处就是能够非常easy地在集群中横向拓展它的计算能力,它会把整个运算过程切割成多个独立的tasks在集群中进行并行计算.在Storm中 ...

- 大数据处理框架之Strom: Storm拓扑的并行机制和通信机制

一.并行机制 Storm的并行度 ,通过提高并行度可以提高storm程序的计算能力. 1.组件关系:Supervisor node物理节点,可以运行1到多个worker,不能超过supervisor. ...

- Storm介绍(一)

作者:Jack47 PS:如果喜欢我写的文章,欢迎关注我的微信公众账号程序员杰克,两边的文章会同步,也可以添加我的RSS订阅源. 内容简介 本文是Storm系列之一,介绍了Storm的起源,Storm ...

- Storm构建分布式实时处理应用初探

最近利用闲暇时间,又重新研读了一下Storm.认真对比了一下Hadoop,前者更擅长的是,实时流式数据处理,后者更擅长的是基于HDFS,通过MapReduce方式的离线数据分析计算.对于Hadoop, ...

- Storm介绍及与Spark Streaming对比

Storm介绍 Storm是由Twitter开源的分布式.高容错的实时处理系统,它的出现令持续不断的流计算变得容易,弥补了Hadoop批处理所不能满足的实时要求.Storm常用于在实时分析.在线机器学 ...

- storm 入门原理介绍

1.hadoop有master与slave,Storm与之对应的节点是什么? 2.Storm控制节点上面运行一个后台程序被称之为什么? 3.Supervisor的作用是什么? 4.Topology与W ...

随机推荐

- 我是如何一步步编码完成万仓网ERP系统的(九)产品库设计 5.产品属性项

https://www.cnblogs.com/smh188/p/11533668.html(我是如何一步步编码完成万仓网ERP系统的(一)系统架构) https://www.cnblogs.com/ ...

- python 变量作用域、闭包

先看一个问题: 下面代码输出的结果是0,换句话说,这个fucn2虽然已经用global声明了variable1,但还是没有改变变量的值 def func1(): variable1=0 def fun ...

- 一、NodeJS入门——准备工作(1)——NodeJS的安装

目录 1.介绍 2.nodejs下载 3.nodejs安装 4.nodejs的简单实用 5.nodejs的经典入门:hello world 6.总结 1 介绍 这是一系列的内容主要是关于我在学习 ...

- C# DataTable 转实体对象

DataTable 转实体对象 /// <summary> /// DataTable通过反射获取单个对象 /// </summary> public static T ToS ...

- Java 关于函数式接口与Lambda表达式之间的关系

java是一种面向对象的语言,java中的一切都是对象,即数组,每个类创建的实例也是对象.在java中定义的函数或方法不可能完全独立,也不能将方法函数作为参数或返回值给实例. 在java7及以前,我们 ...

- 路由拨号上网过Drcom

学校校园宽带是Drcom认证的 ,一人一号一设备.用着难受就决定想破解. 开始想着用软路由,但是感觉对电脑不友好,所以就决定买个路由器来搞. 一丶环境说明 学校使用的是Drcom 6.0 P版客户端. ...

- 3.redis 都有哪些数据类型?分别在哪些场景下使用比较合适?

作者:中华石杉 面试题 redis 都有哪些数据类型?分别在哪些场景下使用比较合适? 面试官心理分析 除非是面试官感觉看你简历,是工作 3 年以内的比较初级的同学,可能对技术没有很深入的研究,面试官才 ...

- 团队项目-Alpha版本发布1

此次作业的目的是让同学们在这个星期内完成团队项目α版本的第一次测试和发布,为发布下一次的 α版本做一个准备和前期检验. 1.作业要求: 提交一份α版本冲刺博客 2.博客要求: (1)请大家在作业开头添 ...

- 码云因为认证失败导致推送失败 生成 SSH 密钥对

- 微信H5页面分享获取JS-SDK

https://mp.weixin.qq.com/wiki?t=resource/res_main&id=mp1421141115 微信开发文档: 生成签名之前必须先了解一下jsapi_ti ...