特征值分解与奇异值分解(SVD)

1.使用QR分解获取特征值和特征向量

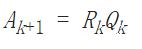

将矩阵A进行QR分解,得到正规正交矩阵Q与上三角形矩阵R。由上可知Ak为相似矩阵,当k增加时,Ak收敛到上三角矩阵,特征值为对角项。

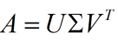

2.奇异值分解(SVD)

其中U是m×m阶酉矩阵;Σ是半正定m×n阶对角矩阵;而V*,即V的共轭转置,是n×n阶酉矩阵。

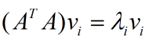

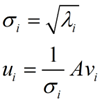

将矩阵A乘它的转置,得到的方阵可用于求特征向量v,进而求出奇异值σ和左奇异向量u。

#coding:utf8

import numpy as np

np.set_printoptions(precision=4, suppress=True) def householder_reflection(A):

"""Householder变换"""

(r, c) = np.shape(A)

Q = np.identity(r)

R = np.copy(A)

for cnt in range(r - 1):

x = R[cnt:, cnt]

e = np.zeros_like(x)

e[0] = np.linalg.norm(x)

u = x - e

v = u / np.linalg.norm(u)

Q_cnt = np.identity(r)

Q_cnt[cnt:, cnt:] -= 2.0 * np.outer(v, v)

R = np.dot(Q_cnt, R) # R=H(n-1)*...*H(2)*H(1)*A

Q = np.dot(Q, Q_cnt) # Q=H(n-1)*...*H(2)*H(1) H为自逆矩阵

return (Q, R) def eig(A, epsilon=1e-10):

'''采用QR分解法计算特征值和特征向量 '''

(q,r_)=householder_reflection(A)

h = np.identity(A.shape[0])

for i in range(50):

B=np.dot(r_,q)

h=h.dot(q)

(q,r)=gram_schmidt(B)

if abs(r.trace()-r_.trace())< epsilon:

print("Converged in {} iterations!".format(i))

break

r_=r

return r,h def svd(A):

'''奇异值分解'''

n, m = A.shape

svd_ = []

k = min(n, m)

v_=eig(np.dot(A.T, A))[1] #np.linalg.eig(np.dot(A.T, A))[1]

for i in range(k):

v=v_.T[i]

u_ = np.dot(A, v)

s = np.linalg.norm(u_)

u = u_ / s

svd_.append((s, u, v))

ss, us, vs = [np.array(x) for x in zip(*svd_)]

return us.T,ss, vs if __name__ == "__main__": mat = np.array([

[2, 5, 3],

[1, 2, 1],

[4, 1, 1],

[3, 5, 2],

[5, 3, 1],

[4, 5, 5],

[2, 4, 2],

[2, 2, 5],

], dtype='float64')

u,s,v = svd(mat)

print u

print s

print v

print np.dot(np.dot(u,np.diag(s)),v)

特征值分解与奇异值分解(SVD)的更多相关文章

- 数学基础系列(六)----特征值分解和奇异值分解(SVD)

一.介绍 特征值和奇异值在大部分人的印象中,往往是停留在纯粹的数学计算中.而且线性代数或者矩阵论里面,也很少讲任何跟特征值与奇异值有关的应用背景. 奇异值分解是一个有着很明显的物理意义的一种方法,它可 ...

- 特征值分解,奇异值分解(SVD)

特征值分解和奇异值分解在机器学习领域都是属于满地可见的方法.两者有着很紧密的关系,我在接下来会谈到,特征值分解和奇异值分解的目的都是一样,就是提取出一个矩阵最重要的特征. 1. 特征值: 如果说一个向 ...

- matlab特征值分解和奇异值分解

特征值分解 函数 eig 格式 d = eig(A) %求矩阵A的特征值d,以向量形式存放d. d = eig(A,B) %A.B为方阵,求广义特征值d,以向量形式存放d. ...

- 讲一下numpy的矩阵特征值分解与奇异值分解

1.特征值分解 主要还是调包: from numpy.linalg import eig 特征值分解: A = P*B*PT 当然也可以写成 A = QT*B*Q 其中B为对角元为A的特征值的对 ...

- 强大的矩阵奇异值分解(SVD)及其应用

版权声明: 本文由LeftNotEasy发布于http://leftnoteasy.cnblogs.com, 本文可以被全部的转载或者部分使用,但请注明出处,如果有问题,请联系wheeleast@gm ...

- 机器学习中的数学-矩阵奇异值分解(SVD)及其应用

转自:http://www.cnblogs.com/LeftNotEasy/archive/2011/01/19/svd-and-applications.html 版权声明: 本文由LeftNotE ...

- 机器学习中的数学(5)-强大的矩阵奇异值分解(SVD)及其应用

版权声明: 本文由LeftNotEasy发布于http://leftnoteasy.cnblogs.com, 本文可以被全部的转载或者部分使用,但请注明出处,如果有问题,请联系wheeleast@gm ...

- 【ML】从特征分解,奇异值分解到主成分分析

1.理解特征值,特征向量 一个对角阵\(A\),用它做变换时,自然坐标系的坐标轴不会发生旋转变化,而只会发生伸缩,且伸缩的比例就是\(A\)中对角线对应的数值大小. 对于普通矩阵\(A\)来说,是不是 ...

- [机器学习笔记]奇异值分解SVD简介及其在推荐系统中的简单应用

本文先从几何意义上对奇异值分解SVD进行简单介绍,然后分析了特征值分解与奇异值分解的区别与联系,最后用python实现将SVD应用于推荐系统. 1.SVD详解 SVD(singular value d ...

随机推荐

- spark与Hadoop区别

2分钟读懂Hadoop和Spark的异同 2016.01.25 11:15:59 来源:51cto作者:51cto ( 0 条评论 ) 谈到大数据,相信大家对Hadoop和Apache Spark ...

- The constness of a method should makes sense from outside the object

C++的encapsulation机制使得我们可以使得一个类的逻辑接口和内部表示有很大的差异,比如下面这个矩形类: class Rectangle { public: int width() cons ...

- android中string.xml引起的常见编译错误

1.遇到如下错误的时候说明你需要在单引号签名加转义字符(\): 1 Description Resource Path Location Type error: Apostrophe not prec ...

- 学习笔记:jquery1.9版本后废弃的函数和方法

jQuery1.9+ 废弃的函数和方法 升级Jquery版本遇到的问题 (转载自:http://www.ppblog.cn/jquery1-9live.html 版权归原作者所有) jQuery1. ...

- Js验证userAgent是否来自手机端

function GetQueryString(name) { var reg = new RegExp("(^|&)" + name + "=([^&] ...

- Smart210学习记录------块设备

转自:http://bbs.chinaunix.net/thread-2017377-1-1.html 本章的目的用尽可能最简单的方法写出一个能用的块设备驱动.所谓的能用,是指我们可以对这个驱动生成的 ...

- 内存回收,Dispose,Close,Finalie(C#中的析构函数)

NET中的资源分托管和非托管,所谓的托管是指CLR(通用语言运行时)中进行管理的资源,它可以由CLR自动进行内存回收. 也就是大家熟知的GC(垃圾回收机制). 而对于 非托管资源,比如数据库连接,CO ...

- SecureCRT rz和sz命令不可用,安装lrzsz

1.从网站下载 lrzsz-x.xx.xx.tar.gz2.解压文件[root@localhost src]# tar zxvf lrzsz-0.12.20.tar.gz3.安装[root@local ...

- 如何使用SnpEff 对SNP结果进行分析

SnpEff is a variant annotation and effect prediction tool. It annotates and predicts the effects of ...

- c# 多语言实现 与 InitializeCulture

在实现多语言的时候,我们会使用GetGlobalResourceObject,在服务器控件中显示多语言文本要使用<%$ Resources:Common, Export %>, 但是在设置 ...