spark 系列之一 RDD的使用

spark中常用的两种数据类型,一个是RDD,一个是DataFrame,本篇主要介绍RDD的一些应用场景见代码

本代码的应用场景是在spark本地调试(windows环境)

/**

* 创建 sparkSession对象

*/

val sparkSession = SparkSession.builder()

.appName("TextFile")

.master("local")

.getOrCreate()

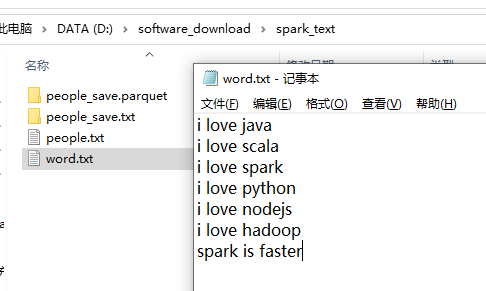

word.txt 的文本内容如下

wordcount:三个算子搞定 flatMap 是把数据打平,map是对打平的数据每个计数一,reduceBykey是按照key进行分类汇总。

/**

* wordCount 程序,三个算子搞定

*/

val peopleRDD1 = sparkSession.sparkContext

.textFile("file:///D:/software_download/spark_text/word.txt")

.flatMap(line=>line.split(" "))

.map(word=>(word,1))

.reduceByKey((a,b)=>a+b) peopleRDD1.foreach(println)

Result:

(scala,1)

(faster,1)

(is,1)

(spark,2)

(hadoop,1)

(love,6)

(i,6)

(python,1)

(nodejs,1)

(java,1)

按照key进行分组

/**

* 分组

*/

val peopleRDD2 = sparkSession.sparkContext

.textFile("file:///D:/software_download/spark_text/word.txt")

.flatMap(line=>line.split(" "))

.map(word=>(word,1))

.groupByKey()

peopleRDD2.foreach(println)

Result:

(scala,CompactBuffer(1))

(spark,CompactBuffer(1, 1))

(is,CompactBuffer(1))

(faster,CompactBuffer(1))

(hadoop,CompactBuffer(1))

(love,CompactBuffer(1, 1, 1, 1, 1, 1))

(i,CompactBuffer(1, 1, 1, 1, 1, 1))

(python,CompactBuffer(1))

(nodejs,CompactBuffer(1))

(java,CompactBuffer(1))

遍历RDD的keys和values,RDD中存放的是一个个对象,这点跟DataFrame不同,RDD中的对象对外的表现是黑盒的,即你不知道RDD中具体的字段是什么。DataFrame则不同,你可以清晰的看到DataFrame中所存放对象的内部结构。

/**

* RDD keys与values的遍历

*/ peopleRDD1.keys.foreach(println)

peopleRDD1.values.foreach(println)

Result:

scala

faster

is

spark

hadoop

love

i

python

nodejs

java

1

1

1

2

1

6

6

1

1

1

RDD 的其它操作,

/**

* 只针对value的值进行操作,以下两种操作等效,都是对key值加1操作

*/

peopleRDD1.sortByKey().map(x=>(x._1,x._2+1)).foreach(println)

peopleRDD1.sortByKey().mapValues(x=>x+1).foreach(println)

//按照value值进行排序

peopleRDD1.sortBy(x=>x._2,ascending = true).foreach(println)

//按照key值进行排序

peopleRDD1.sortByKey(ascending = true).foreach(println)

/**

* RDD之间的join操作

*/

val pairRDD1 = sparkSession.sparkContext.parallelize(Array(("spark",1),("spark",2),("hadoop",3),("hadoop",5)))

val pairRDD2 = sparkSession.sparkContext.parallelize(Array(("spark","fast")))

val RDD1_join_RDD2 = pairRDD1.join(pairRDD2)

RDD1_join_RDD2.foreach(println)

思考题: 求该rdd,按照key进行分组后,value值得平均值,答案如下。

求:写代码

val rdd = sparkSession.sparkContext.parallelize(Array(("spark",2),("hadoop",6),("hadoop",4),("spark",6)))

Result:

(spark,4)

(hadoop,5)

spark 系列之一 RDD的使用的更多相关文章

- Spark RDD概念学习系列之RDD的checkpoint(九)

RDD的检查点 首先,要清楚.为什么spark要引入检查点机制?引入RDD的检查点? 答:如果缓存丢失了,则需要重新计算.如果计算特别复杂或者计算耗时特别多,那么缓存丢失对于整个Job的影响是不容 ...

- Spark RDD概念学习系列之RDD的缓存(八)

RDD的缓存 RDD的缓存和RDD的checkpoint的区别 缓存是在计算结束后,直接将计算结果通过用户定义的存储级别(存储级别定义了缓存存储的介质,现在支持内存.本地文件系统和Tachyon) ...

- Spark RDD概念学习系列之RDD的5大特点(五)

RDD的5大特点 1)有一个分片列表,就是能被切分,和Hadoop一样,能够切分的数据才能并行计算. 一组分片(partition),即数据集的基本组成单位,对于RDD来说,每个分片都会被一个计 ...

- Spark RDD概念学习系列之rdd的依赖关系彻底解密(十九)

本期内容: 1.RDD依赖关系的本质内幕 2.依赖关系下的数据流视图 3.经典的RDD依赖关系解析 4.RDD依赖关系源码内幕 1.RDD依赖关系的本质内幕 由于RDD是粗粒度的操作数据集,每个Tra ...

- Spark系列-核心概念

Spark系列-初体验(数据准备篇) Spark系列-核心概念 一. Spark核心概念 Master,也就是架构图中的Cluster Manager.Spark的Master和Workder节点分别 ...

- Spark深入之RDD

目录 Part III. Low-Level APIs Resilient Distributed Datasets (RDDs) 1.介绍 2.RDD代码 3.KV RDD 4.RDD Join A ...

- Spark系列之二——一个高效的分布式计算系统

1.什么是Spark? Spark是UC Berkeley AMP lab所开源的类Hadoop MapReduce的通用的并行计算框架,Spark基于map reduce算法实现的分布式计算,拥有H ...

- Spark计算模型-RDD介绍

在Spark集群背后,有一个非常重要的分布式数据架构,即弹性分布式数据集(Resilient Distributed DataSet,RDD),它是逻辑集中的实体,在集群中的多台集群上进行数据分区.通 ...

- spark 中的RDD编程 -以下基于Java api

1.RDD介绍: RDD,弹性分布式数据集,即分布式的元素集合.在spark中,对所有数据的操作不外乎是创建RDD.转化已有的RDD以及调用RDD操作进行求值.在这一切的背后,Spark会自动 ...

随机推荐

- UML第一次个人作业

这个作业属于哪个课程 https://api.jihuayu.site/cnblogs 这个作业要求在哪里 https://edu.cnblogs.com/campus/fzzcxy/2018SE1/ ...

- chrome浏览器查看当前页面cookie

方法一:点进去设置--高级--网站设置--权限cookie--查找所有cookie和网站数据,就可以看到所有的cookie信息了,举例: 方法二:键盘F12,找到network--点击Doc(如果没有 ...

- 数据库事务ACID/隔离级别

参考博客 1. 事务的定义 事务是用户定义的一个数据库操作序列.这些操作要么全执行,要么全不执行,是一个不可分割的工作单元.在关系型数据库中,事务可以是一条SQL语句,也可以是一组SQL语句或整个程序 ...

- 注册dll命令

向系统中注册dll的方法,如下(直接回车即可注册): regsvr32

- docker数据持久化/共享---volume,bind-mount,tmpfs-mount

一.将Docker数据挂载到容器 在Docker中,要想实现数据的持久化(所谓Docker的数据持久化即数据不随着Container的结束而结束),需要将数据从宿主机挂载到容器中.目前Docker提供 ...

- Python中使用eval执行下面函数的结果怎么是字符串'10020'?

定义了函数: def add(a,b): s='a+b' c=compile(s,'','eval') gArea,lArea = {},{} gArea['a']=str(a10) gArea['b ...

- MySQL Docker容器实例创建并进入MySQL命令行

首先需要明白的一点是: docker镜像是一个模版,docker容器是一个实例,它可以被启动与关闭. 我们需要先有MySQL的docker镜像,使用命令: docker pull mysql 拉取最新 ...

- js将秒数转换为时分秒格式

function secondToTimeStr(t) { if (!t) return; if (t < 60) return "00:" + ((i = t) < ...

- day105:Mofang:设置页面初始化&更新头像/上传头像&设置页面显示用户基本信息

目录 1.设置页面初始化 2.更新头像 1.点击头像进入更新头像界面 2.更新头像页面初始化 3.更新头像页面CSS样式 4.头像上传来源选择:相册/相机 5.调用api提供的本地接口从相册/相机提取 ...

- Springcloud之gateway配置及swagger集成

前言 关于引入gateway的好处我网上找了下: 性能:API高可用,负载均衡,容错机制. 安全:权限身份认证.脱敏,流量清洗,后端签名(保证全链路可信调用),黑名单(非法调用的限制). 日志:日志记 ...