第三百二十三节,web爬虫,scrapy模块以及相关依赖模块安装

第三百二十三节,web爬虫,scrapy模块以及相关依赖模块安装

当前环境python3.5 ,windows10系统

Linux系统安装

在线安装,会自动安装scrapy模块以及相关依赖模块

pip install Scrapy

手动源码安装,比较麻烦要自己手动安装scrapy模块以及依赖模块

安装以下模块

1、lxml-3.8.0.tar.gz (XML处理库)

2、Twisted-17.5.0.tar.bz2 (用Python编写的异步网络框架)

3、Scrapy-1.4.0.tar.gz (高级web爬行和web抓取框架)

4、pyOpenSSL-17.2.0.tar.gz (OpenSSL库)

5、queuelib-1.4.2.tar.gz (Queuelib是用于Python的持久(基于磁盘的)队列的集合)

6、w3lib-1.17.0.tar.gz (与web相关的函数的Python库)

7、cryptography-2.0.tar.gz (密码学是一种包)

8、pyasn1-0.2.3.tar.gz (ASN类型和编解码器)

9、pyasn1-modules-0.0.9.tar.gz (ASN的集合。基于协议模块)

10、cffi-1.10.0.tar.gz (用于Python调用C代码的外部函数接口)

11、asn1crypto-0.22.0.tar.gz (快速的ASN一个解析器和序列化器)

12、idna-2.5.tar.gz (应用程序中的国际化域名(IDNA))

13、pycparser-2.18.tar.gz (C解析器在Python中)

windows系统安装

windows安装,首先要安装pywin32,根据自己的系统来安装32位还是64位

pywin32-221.win32-py3.5.exe

pywin32-221.win-amd64-py3.5.exe

在线安装

pip install Scrapy

手动源码安装,比较麻烦要自己手动安装scrapy模块以及依赖模块

安装以下模块

1、lxml-3.8.0.tar.gz (XML处理库)

2、Twisted-17.5.0.tar.bz2 (用Python编写的异步网络框架)

3、Scrapy-1.4.0.tar.gz (高级web爬行和web抓取框架)

4、pyOpenSSL-17.2.0.tar.gz (OpenSSL库)

5、queuelib-1.4.2.tar.gz (Queuelib是用于Python的持久(基于磁盘的)队列的集合)

6、w3lib-1.17.0.tar.gz (与web相关的函数的Python库)

7、cryptography-2.0.tar.gz (密码学是一种包)

8、pyasn1-0.2.3.tar.gz (ASN类型和编解码器)

9、pyasn1-modules-0.0.9.tar.gz (ASN的集合。基于协议模块)

10、cffi-1.10.0.tar.gz (用于Python调用C代码的外部函数接口)

11、asn1crypto-0.22.0.tar.gz (快速的ASN一个解析器和序列化器)

12、idna-2.5.tar.gz (应用程序中的国际化域名(IDNA))

13、pycparser-2.18.tar.gz (C解析器在Python中)

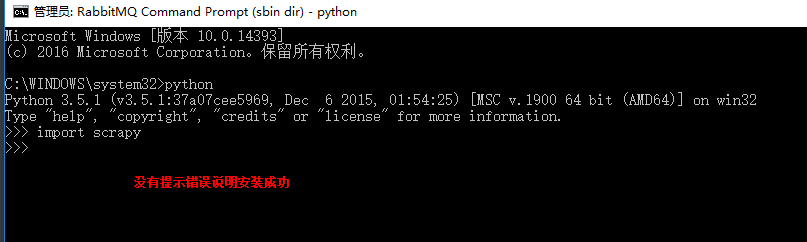

测试是否安装成功

在cmd终端,运行python

然后运行:import scrapy ,没有提示错误说明安装成功

第三百二十三节,web爬虫,scrapy模块以及相关依赖模块安装的更多相关文章

- 第三百二十二节,web爬虫,requests请求

第三百二十二节,web爬虫,requests请求 requests请求,就是用yhthon的requests模块模拟浏览器请求,返回html源码 模拟浏览器请求有两种,一种是不需要用户登录或者验证的请 ...

- 第三百二十九节,web爬虫讲解2—urllib库爬虫—ip代理—用户代理和ip代理结合应用

第三百二十九节,web爬虫讲解2—urllib库爬虫—ip代理 使用IP代理 ProxyHandler()格式化IP,第一个参数,请求目标可能是http或者https,对应设置build_opener ...

- 第三百二十八节,web爬虫讲解2—urllib库爬虫—状态吗—异常处理—浏览器伪装技术、设置用户代理

第三百二十八节,web爬虫讲解2—urllib库爬虫—状态吗—异常处理—浏览器伪装技术.设置用户代理 如果爬虫没有异常处理,那么爬行中一旦出现错误,程序将崩溃停止工作,有异常处理即使出现错误也能继续执 ...

- 第三百二十六节,web爬虫,scrapy模块,解决重复ur——自动递归url

第三百二十六节,web爬虫,scrapy模块,解决重复url——自动递归url 一般抓取过的url不重复抓取,那么就需要记录url,判断当前URL如果在记录里说明已经抓取过了,如果不存在说明没抓取过 ...

- 第三百二十五节,web爬虫,scrapy模块标签选择器下载图片,以及正则匹配标签

第三百二十五节,web爬虫,scrapy模块标签选择器下载图片,以及正则匹配标签 标签选择器对象 HtmlXPathSelector()创建标签选择器对象,参数接收response回调的html对象需 ...

- 第三百二十四节,web爬虫,scrapy模块介绍与使用

第三百二十四节,web爬虫,scrapy模块介绍与使用 Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中.其最初是为了 ...

- 第三百六十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的mget和bulk批量操作

第三百六十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的mget和bulk批量操作 注意:前面讲到的各种操作都是一次http请求操作一条数据,如果想 ...

- 第三百五十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—scrapy的暂停与重启

第三百五十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—scrapy的暂停与重启 scrapy的每一个爬虫,暂停时可以记录暂停状态以及爬取了哪些url,重启时可以从暂停状态开始爬取过的UR ...

- 第三百八十三节,Django+Xadmin打造上线标准的在线教育平台—第三方模块django-simple-captcha验证码

第三百八十三节,Django+Xadmin打造上线标准的在线教育平台—第三方模块django-simple-captcha验证码 下载地址:https://github.com/mbi/django- ...

随机推荐

- 菜鸟学SSH(十三)——Spring容器IOC解析及简单实现

最近一段时间,“容器”两个字一直萦绕在我的耳边,甚至是吃饭.睡觉的时候都在我脑子里蹦来蹦去的.随着这些天一次次的交流.讨论,对于容器的理解也逐渐加深.理论上的东西终归要落实到实践,今天就借助Sprin ...

- Java 虚拟机:互斥同步、锁优化及synchronized和volatile

互斥同步 互斥同步(Mutual Exclusion & Synchronization)是常见的一种并发正确性保证手段.同步是指子啊多个线程并发访问共享数据时,保证共享数据在同一时刻只能被一 ...

- 群主微信sdk说明地址

群主微信sdk说明地址官网地址:http://weixin.senparc.com/ 源代码及最新更新:https://github.com/JeffreySu/WeiXinMPSDK 最新DLL发布 ...

- [Windows Azure] Enabling Diagnostics in Windows Azure

Enabling Diagnostics in Windows Azure Windows Azure Diagnostics enables you to collect diagnostic da ...

- javascript基础拾遗(十三)

1.jQuery的特点 jQuery是目前非常流行的javascript库,理念是"Write Less,Do More" 1)消除浏览器差异 2)简洁的操作DOM方法 3)轻松实 ...

- 序列化ADODataSet, ADOQuery

经过昨天晚上一折腾把做了一个DIOCP直接传递TADOQuery的Demo,在google上找了一系列的资料. 这样服务端可以直接将TADOQuery查询出来的数据直接转换成TStream自己进行传递 ...

- LeetCode: Construct Binary Tree from Inorder and Postorder Traversal 解题报告

Construct Binary Tree from Inorder and Postorder Traversal Given inorder and postorder traversal of ...

- Python实现敏感词过滤替换

[本文出自天外归云的博客园] 问题 最近在网上搜到了一些练习题,对第十二题稍作修改如下: 敏感词文本文件“filtered_words.txt”,里面的内容: 北京人 人大 北京 程序员 公务员 领导 ...

- 查询Oracle性能差的、正在执行或执行过的SQL语句

查找前十条性能差的sql. SELECT * FROM (select PARSING_USER_ID,EXECUTIONS,SORTS, COMMAND_TYPE,DISK_READS,sql_te ...

- 微信小程序学习资料

官方文档 https://mp.weixin.qq.com/debug/wxadoc/dev/ W3CSchool的教程 https://www.w3cschool.cn/weixinapp/ 更多参 ...