第三百二十三节,web爬虫,scrapy模块以及相关依赖模块安装

第三百二十三节,web爬虫,scrapy模块以及相关依赖模块安装

当前环境python3.5 ,windows10系统

Linux系统安装

在线安装,会自动安装scrapy模块以及相关依赖模块

pip install Scrapy

手动源码安装,比较麻烦要自己手动安装scrapy模块以及依赖模块

安装以下模块

1、lxml-3.8.0.tar.gz (XML处理库)

2、Twisted-17.5.0.tar.bz2 (用Python编写的异步网络框架)

3、Scrapy-1.4.0.tar.gz (高级web爬行和web抓取框架)

4、pyOpenSSL-17.2.0.tar.gz (OpenSSL库)

5、queuelib-1.4.2.tar.gz (Queuelib是用于Python的持久(基于磁盘的)队列的集合)

6、w3lib-1.17.0.tar.gz (与web相关的函数的Python库)

7、cryptography-2.0.tar.gz (密码学是一种包)

8、pyasn1-0.2.3.tar.gz (ASN类型和编解码器)

9、pyasn1-modules-0.0.9.tar.gz (ASN的集合。基于协议模块)

10、cffi-1.10.0.tar.gz (用于Python调用C代码的外部函数接口)

11、asn1crypto-0.22.0.tar.gz (快速的ASN一个解析器和序列化器)

12、idna-2.5.tar.gz (应用程序中的国际化域名(IDNA))

13、pycparser-2.18.tar.gz (C解析器在Python中)

windows系统安装

windows安装,首先要安装pywin32,根据自己的系统来安装32位还是64位

pywin32-221.win32-py3.5.exe

pywin32-221.win-amd64-py3.5.exe

在线安装

pip install Scrapy

手动源码安装,比较麻烦要自己手动安装scrapy模块以及依赖模块

安装以下模块

1、lxml-3.8.0.tar.gz (XML处理库)

2、Twisted-17.5.0.tar.bz2 (用Python编写的异步网络框架)

3、Scrapy-1.4.0.tar.gz (高级web爬行和web抓取框架)

4、pyOpenSSL-17.2.0.tar.gz (OpenSSL库)

5、queuelib-1.4.2.tar.gz (Queuelib是用于Python的持久(基于磁盘的)队列的集合)

6、w3lib-1.17.0.tar.gz (与web相关的函数的Python库)

7、cryptography-2.0.tar.gz (密码学是一种包)

8、pyasn1-0.2.3.tar.gz (ASN类型和编解码器)

9、pyasn1-modules-0.0.9.tar.gz (ASN的集合。基于协议模块)

10、cffi-1.10.0.tar.gz (用于Python调用C代码的外部函数接口)

11、asn1crypto-0.22.0.tar.gz (快速的ASN一个解析器和序列化器)

12、idna-2.5.tar.gz (应用程序中的国际化域名(IDNA))

13、pycparser-2.18.tar.gz (C解析器在Python中)

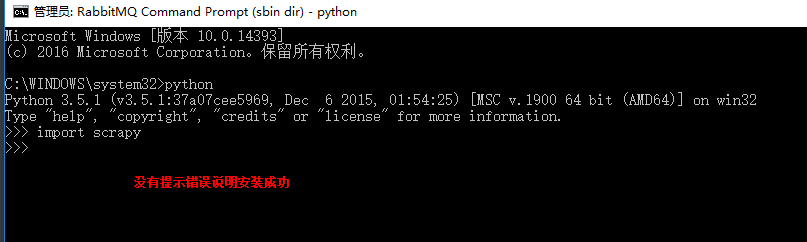

测试是否安装成功

在cmd终端,运行python

然后运行:import scrapy ,没有提示错误说明安装成功

第三百二十三节,web爬虫,scrapy模块以及相关依赖模块安装的更多相关文章

- 第三百二十二节,web爬虫,requests请求

第三百二十二节,web爬虫,requests请求 requests请求,就是用yhthon的requests模块模拟浏览器请求,返回html源码 模拟浏览器请求有两种,一种是不需要用户登录或者验证的请 ...

- 第三百二十九节,web爬虫讲解2—urllib库爬虫—ip代理—用户代理和ip代理结合应用

第三百二十九节,web爬虫讲解2—urllib库爬虫—ip代理 使用IP代理 ProxyHandler()格式化IP,第一个参数,请求目标可能是http或者https,对应设置build_opener ...

- 第三百二十八节,web爬虫讲解2—urllib库爬虫—状态吗—异常处理—浏览器伪装技术、设置用户代理

第三百二十八节,web爬虫讲解2—urllib库爬虫—状态吗—异常处理—浏览器伪装技术.设置用户代理 如果爬虫没有异常处理,那么爬行中一旦出现错误,程序将崩溃停止工作,有异常处理即使出现错误也能继续执 ...

- 第三百二十六节,web爬虫,scrapy模块,解决重复ur——自动递归url

第三百二十六节,web爬虫,scrapy模块,解决重复url——自动递归url 一般抓取过的url不重复抓取,那么就需要记录url,判断当前URL如果在记录里说明已经抓取过了,如果不存在说明没抓取过 ...

- 第三百二十五节,web爬虫,scrapy模块标签选择器下载图片,以及正则匹配标签

第三百二十五节,web爬虫,scrapy模块标签选择器下载图片,以及正则匹配标签 标签选择器对象 HtmlXPathSelector()创建标签选择器对象,参数接收response回调的html对象需 ...

- 第三百二十四节,web爬虫,scrapy模块介绍与使用

第三百二十四节,web爬虫,scrapy模块介绍与使用 Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中.其最初是为了 ...

- 第三百六十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的mget和bulk批量操作

第三百六十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—elasticsearch(搜索引擎)的mget和bulk批量操作 注意:前面讲到的各种操作都是一次http请求操作一条数据,如果想 ...

- 第三百五十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—scrapy的暂停与重启

第三百五十三节,Python分布式爬虫打造搜索引擎Scrapy精讲—scrapy的暂停与重启 scrapy的每一个爬虫,暂停时可以记录暂停状态以及爬取了哪些url,重启时可以从暂停状态开始爬取过的UR ...

- 第三百八十三节,Django+Xadmin打造上线标准的在线教育平台—第三方模块django-simple-captcha验证码

第三百八十三节,Django+Xadmin打造上线标准的在线教育平台—第三方模块django-simple-captcha验证码 下载地址:https://github.com/mbi/django- ...

随机推荐

- django rest_framework入门

1.rest_framework的作用 1)可以对orm和非orm资源序列化 2)支持restful风格编程(POST,PUT,PATCH) 3)使用类视图编写API的view,而不是函数视图,类视图 ...

- Python爬取新浪微博评论数据,写入csv文件中

因为新浪微博网页版爬虫比较困难,故采取用手机网页端爬取的方式 操作步骤如下: 1. 网页版登陆新浪微博 2.打开m.weibo.cn 3.查找自己感兴趣的话题,获取对应的数据接口链接 4.获取cook ...

- 有用的SAP System Administration T-CODE

一,SAP系统管理常用到的事务代码1. SM51 SAP Servers System Monitoring2. SM21 SAP系统日志3. SRZL SAP计算机中心管理系统(CCMS) ...

- python下使用epoll

Reference: http://blog.csdn.net/hehe123456ZXC/article/details/52526670 因为最近想学习如何用epoll写服务器, 于是找到了一篇介 ...

- whatweb tree

. ├── 1.txt ├── addons │ ├── country-scanner │ ├── gggooglescan │ ├── hunter │ └── verify-ni ...

- Oracle 安装报错 [INS-06101] IP address of localhost could not be determined 解决方法

安装Oracle 11gR2,报错:[INS-06101] IP address of localhost could not be determined 出现这种错误是因为主机名和/etc/host ...

- 基于jQuery8款超赞的评分插件

基于jquery8款超赞的评分插件.这是一款基于jquery.barrating插件实现的,该评级小部件可灵活设置CSS样式.具体效果请查看演示.效果图如下: 在线预览 源码下载 实现的代码. h ...

- 关于centos安装后一些命令找不到

刚才遇到那么尴尬的一个情况,输入啥命令都没找到.连ifconfig都不放过. 后分析极可能是以下两种缘故: 1.缺少安装包 [root@Tzhost-170802-FCF0 /]# yum searc ...

- [转]mysql如何利用Navicat 导出和导入数据库

MySql是我们经常用到的数据,无论是开发人员用来练习,还是小型私服游戏服务器,或者是个人软件使用,都十分方便.对于做一些个人辅助软件,选择mysql数据库是个明智的选择,有一个好的工具更是事半功倍, ...

- RabbitMQ文档翻译——Hello World!(下)

Receiving That's it for our sender. Our receiver is pushed messages from RabbitMQ, so unlike the sen ...