activeMq-2 高可用以及集群搭建

Activemq 的集群方法可以有多种实现方式,我们这里使用zookeeper来实现

要搭建集群,请确保已经搭建好zookeeper环境。这里不再演示。

基本原理:

使用ZooKeeper(集群)注册所有的ActiveMQ Broker。只有其中的一个Broker可以对外提供服务(也就是Master节点),其他的Broker处于待机状态,被视为Slave。如果Master因故障而不能提供服务,则利用ZooKeeper的内部选举机制会从Slave中选举出一个Broker充当Master节点,继续对外提供服务。

原理图如下:

首先我们把apache-activemq-5.11.1-bin.tar.gz,上传到我们的一台主节点上去,然后我们在(192.168.0.113一个节点上实现高可用集群即可)这里为了演示方便,我在一台主机上,启动三个实例。

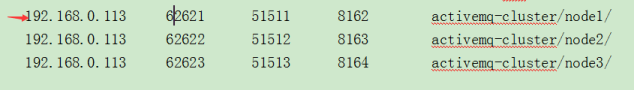

相关端口规划如下

主机IP 集群通信端口 消息端口 控制台端口 节点目录/usr/local/下

192.168.0.113 62621 51511 8162 activemq-cluster/node1/

192.168.0.113 62622 51512 8163 activemq-cluster/node2/

192.168.0.113 62623 51513 8164 activemq-cluster/node3/

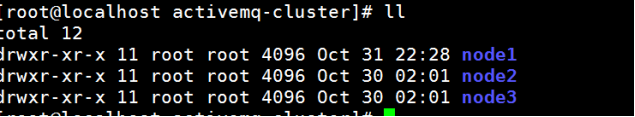

在/usr/local 目录下创建activemq-cluster目录 在activemq-cluster创建node1,node2,node3

如图所示

将上传的apache-activemq-5.11.1-bin.tar.gz,解压到/usr/local/activemq-cluster 然后对解压好的文件改名

命令如下:

tar -zxvf apache-activemq-5.11.1-bin.tar.gz -C /usr/local/activemq-cluster

改名

mv apache-activemq-5.11.1/ node1

再次反复解压apache-activemq-5.11.1-bin.tar.gz文件到/usr/local/activemq-cluster/下,分别改名为node2和node3文件夹

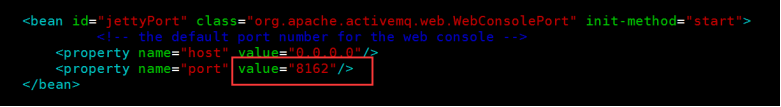

1 修改控制台端口(默认为8161),在mq安装路径下的conf/jetty.xml进行修改

分别修改为8162,8163,8164

2 集群配置文件修改:mq安装路径下的conf/activemq.xml进行修

改其中的持久化适配器,修改其中的bind、zkAddress、hostname、zkPath。

然后也需要修改mq的brokerName,并且每个节点名称都必须相同。

第一处修改:brokerName=”activemq-cluster”(三个节点都需要修改并且相同 名字可以根据需求自己取 )

第二处修改 把<persistenceAdapter> 替换成下面这个

Node1的修改

<persistenceAdapter>

<replicatedLevelDB

directory="${activemq.data}/leveldb"

replicas="3"

bind="tcp://0.0.0.0:62621"

zkAddress="192.168.0.110:2181,192.168.0.111:2181,192.168.0.112:2181"

hostname="cc115"

zkPath="/activemq/leveldb-stores"

/>

</persistenceAdapter>

Node2的修改

<persistenceAdapter>

<replicatedLevelDB

directory="${activemq.data}/leveldb"

replicas="3"

bind="tcp://0.0.0.0:62622"

zkAddress="192.168.0.110:2181,192.168.0.111:2181,192.168.0.112:2181"

hostname="cc115"

zkPath="/activemq/leveldb-stores"

/>

</persistenceAdapter>

Node3的修改

<persistenceAdapter>

<replicatedLevelDB

directory="${activemq.data}/leveldb"

replicas="3"

bind="tcp://0.0.0.0:62623"

zkAddress="192.168.0.110:2181,192.168.0.111:2181,192.168.0.112:2181"

hostname="cc115"

zkPath="/activemq/leveldb-stores"

/>

</persistenceAdapter>

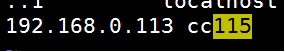

注意:hosename是你在/etc/hosts 绑定的本地ip以及自己域名

第三处修改:修改通信的端口,避免冲突

修改这个文件的通信端口号,三个节点都需要修改(51511,51512,51513)

启动三个节点

/usr/local/activemq-cluster/node1/bin/activemq start(关闭stop)

/usr/local/activemq-cluster/node2/bin/activemq start(关闭stop)

/usr/local/activemq-cluster/node3/bin/activemq start(关闭stop)

查看日志看是否报错

tail -n 100 /usr/local/activemq-cluster/node1/data/activemq.log

tail -n 100 /usr/local/activemq-cluster/node2/data/activemq.log

tail -n 100 /usr/local/activemq-cluster/node3/data/activemq.log

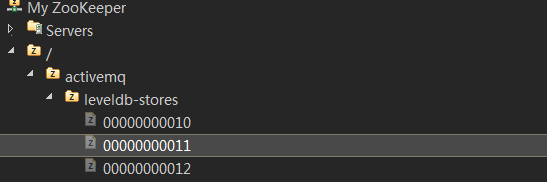

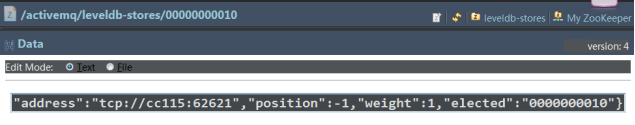

查看zookeeper上的节点信息

三个节点都注册到了 到此主从搭建完毕。

集群就是多个这样的主从在一起工作,也比较简单,这里就不演示了。

可以看到工作的实例的端口是62621

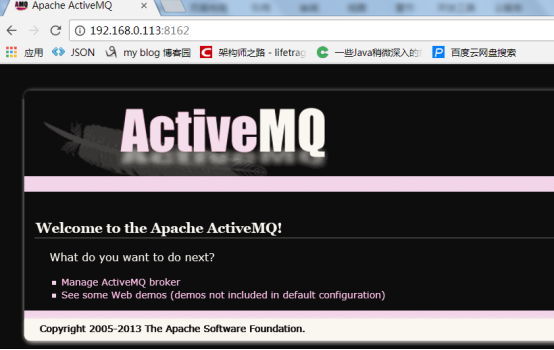

访问下web控制台

那么 java端创建连接工厂的URL怎么写呢?创建url如下

failover:(tcp://192.168.0.113:51511,tcp://192.168.0.113:51512,tcp://192.168.0.113:51513)?Randomize=false

activeMq-2 高可用以及集群搭建的更多相关文章

- Hadoop-HA(高可用)集群搭建

Hadoop-HA集群搭建 一.基础准备工作 1.准备好5台Linux系统虚拟服务器或物理服务器 我这里演示采用虚拟服务器搭建Hadoop-HA集群,各自功能分配如下: NameNode节点:vt-s ...

- 高可用k8s集群搭建

虚拟机选择 Win10 Hyper-V 总体架构 三个master,三个node master的组件 etcd kube-apiserver kube-controller-manager kube- ...

- ElasticSearch 高可用分布式集群搭建,与PHP多线程测试

方案: 使用HAproxy:当其中一台ElasticSearch Master宕掉时,ElasticSearch集群会自动将运行正常的节点提升为Master,但HAproxy不会将失败的请求重新分发到 ...

- 高可用mysql集群搭建

对web系统来说,瓶颈大多在数据库和磁盘IO上面,而不是服务器的计算能力.对于系统伸缩性我们一般有2种解决方案,scale-up(纵向扩展)和scale-out(横向扩展).前者如扩内存,增加单机性能 ...

- 4 种高可用 RocketMQ 集群搭建方案!

背景 笔者所在的业务线,最初化分为三个服务,由于业务初期业务复杂度相对简单,三个业务服务都能很好的独立完成业务功能. 随着产品迭代,业务功能越来越多后慢慢也要面对高并发.业务解耦.分布式事务等问题,所 ...

- Apache tomcat高可用web集群搭建过程配置记录

说明,本文仅作为个人搭建配置保存,问题处理没有一一列出,过程也未见详尽,有问题的朋友可以直接留言给我,会一一回复,谢谢. 小目标: 支持故障转移(或主备,扩展性不佳),保证故障转移后,对前端用户透明, ...

- 搭建高可用mongodb集群(四)—— 分片(经典)

转自:http://www.lanceyan.com/tech/arch/mongodb_shard1.html 按照上一节中<搭建高可用mongodb集群(三)-- 深入副本集>搭建后还 ...

- [转]搭建高可用mongodb集群(四)—— 分片

按照上一节中<搭建高可用mongodb集群(三)—— 深入副本集>搭建后还有两个问题没有解决: 从节点每个上面的数据都是对数据库全量拷贝,从节点压力会不会过大? 数据压力大到机器支撑不了的 ...

- [转]搭建高可用mongodb集群(二)—— 副本集

在上一篇文章<搭建高可用MongoDB集群(一)——配置MongoDB> 提到了几个问题还没有解决. 主节点挂了能否自动切换连接?目前需要手工切换. 主节点的读写压力过大如何解决? 从节点 ...

随机推荐

- FPGA中iic总线上,应答ACK解析

首先要明白一点,有效ACK是指第9位为低电平,第十位,十一位就管不着了,(我写的代码发现第九位为低电平,之后复位为高电平,开始没注意后来搞的很是头痛) 主机发ack和主机检测ack,主机发ack是在从 ...

- Java中的权限修饰符private、protected、public

java中的修饰符分类: 权限修饰符: private, default, protected, public 状态修饰符: static, final 抽象修饰符: abstract 权限修饰符 我 ...

- Shiro+CAS

参考链接: CAS实现单点登录SSO执行原理探究:http://blog.csdn.net/javaloveiphone/article/details/52439613 单点登录CAS技术概述:ht ...

- kubernetes学习笔记之十一:kubernetes dashboard认证及分级授权

第一章.部署dashboard 作为Kubernetes的Web用户界面,用户可以通过Dashboard在Kubernetes集群中部署容器化的应用,对应用进行问题处理和管理,并对集群本身进行管理.通 ...

- Tcp三次挥手和四次挥手

三次握手: (1) 第一次握手:建立连接时,客户端A发送SYN包(SYN=j)到服务器B,并进入SYN_SEND状态,等待服务器B确认 (2) 第二次握手:服务器B收到SYN包,必须确认客户A的S ...

- day40数据库之表的相关操作

数据库之表的相关操作1.表的操作: 1.创建表的语法: create table 表名( id int(10) primary key auto_inc ...

- python-web自动化环境安装

web自动化环境安装 1.安装selenium 命令行使用以下命令安装selenium:pip install -U selenium 2.安装chrome浏览器 3.chromedriver的下载 ...

- TCP的三次握手与四次挥手理解及面试题(很全面)

序列号seq:占4个字节,用来标记数据段的顺序,TCP把连接中发送的所有数据字节都编上一个序号,第一个字节的编号由本地随机产生:给字节编上序号后,就给每一个报文段指派一个序号:序列号seq就是这个报文 ...

- Java 中 Gson的使用

JSON 是一种文本形式的数据交换格式,它比XML更轻量.比二进制容易阅读和编写,调式也更加方便;解析和生成的方式很多,Java中最常用的类库有:JSON-Java.Gson.Jackson.Fast ...

- spark java.lang.OutOfMemoryError: unable to create new native thread

最近迁移集群,在hadoop-2.8.4 的yarn上跑 spark 程序 报了以下错误 java.lang.OutOfMemoryError: unable to create new native ...