Python爬虫教程-13-爬虫使用cookie爬取登录后的页面(人人网)(下)

Python爬虫教程-13-爬虫使用cookie爬取登录后的页面(下)

- 自动使用cookie的方法,告别手动拷贝cookie

- http模块包含一些关于cookie的模块,通过他们我们可以自动的使用cookie

- CookieJar- 管理存储Cookie,向传出的http请求添加cookie

- 这里Cookie存储在内存中,CookieJar实例回收后cookie将消失

- FileCookieJar(filename, delayload=None, policy=None)

- 使用文件管理cookie

- filename是保存cookie的文件

- MozillaCookieJar(filename, delayload=None, policy=None)

- 创建Mocilla浏览器cookie.txt兼容的FileCookieJar实例

-

- 火狐Firefox浏览器需要单独处理

- LwpCookieJar(filename, delayload=None, policy=None)

- 创建于libww-per标准兼容的Set-Cookie3格式的FileCookieJar

- 它们之间的关系: CookieJar-->FileCookieJar-->MozillaCookieJar & LwpCookieJar

利用CookieJar访问人人网

- 自动使用cookie登录,使用步骤:

- 1.打开登录页面后自动通过用户名密码登录

- 2.自动提取反馈回来的cookie

- 3.利用提取的cookie登录个人信息页面

- 创建cookiejar实例

- 生成cookie的管理器

- 创建http请求管理器

- 创建https请求的管理器

- 创建请求管理器

- 通过输入用户名和密码,获取cookie

- 案例13cookiejar文件:https://xpwi.github.io/py/py爬虫/py13cookiejar.py

# 使用cookiejar完整代码

from urllib import request,parse

from http import cookiejar

# 创建cookiejar的实例

cookie = cookiejar.CookieJar()

# 常见cookie的管理器

cookie_handler = request.HTTPCookieProcessor(cookie)

# 创建http请求的管理器

http_handler = request.HTTPHandler()

# 生成https管理器

https_handler = request.HTTPSHandler()

# 创建请求管理器

opener = request.build_opener(http_handler,https_handler,cookie_handler)

def login():

# 负责首次登录,输入用户名和密码,用来获取cookie

url = 'http://www.renren.com/PLogin.do'

id = input('请输入用户名:')

pw = input('请输入密码:')

data = {

# 从input标签的name获取参数的key,value由输入获取

"email": id,

"password": pw

}

# 把数据进行编码

data = parse.urlencode(data)

# 创建一个请求对象

req = request.Request(url,data=data.encode('utf-8'))

# 使用opener发起请求

rsp = opener.open(req)

# 以上代码就可以进一步获取cookie了,cookie在哪呢?cookie在opener里

def getHomePage():

# 地址是用在浏览器登录后的个人信息页地址

url = "http://www.renren.com/967487029/profile"

# 如果已经执行login函数,则opener自动已经包含cookie

rsp = opener.open(url)

html = rsp.read().decode()

with open("rsp1.html", "w", encoding="utf-8")as f:

# 将爬取的页面

print(html)

f.write(html)

if __name__ == '__main__':

login()

getHomePage()

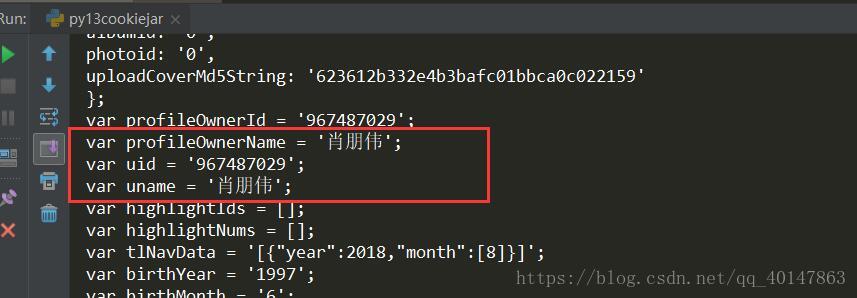

运行结果

看到自己的个人信息就是说明登录成功了

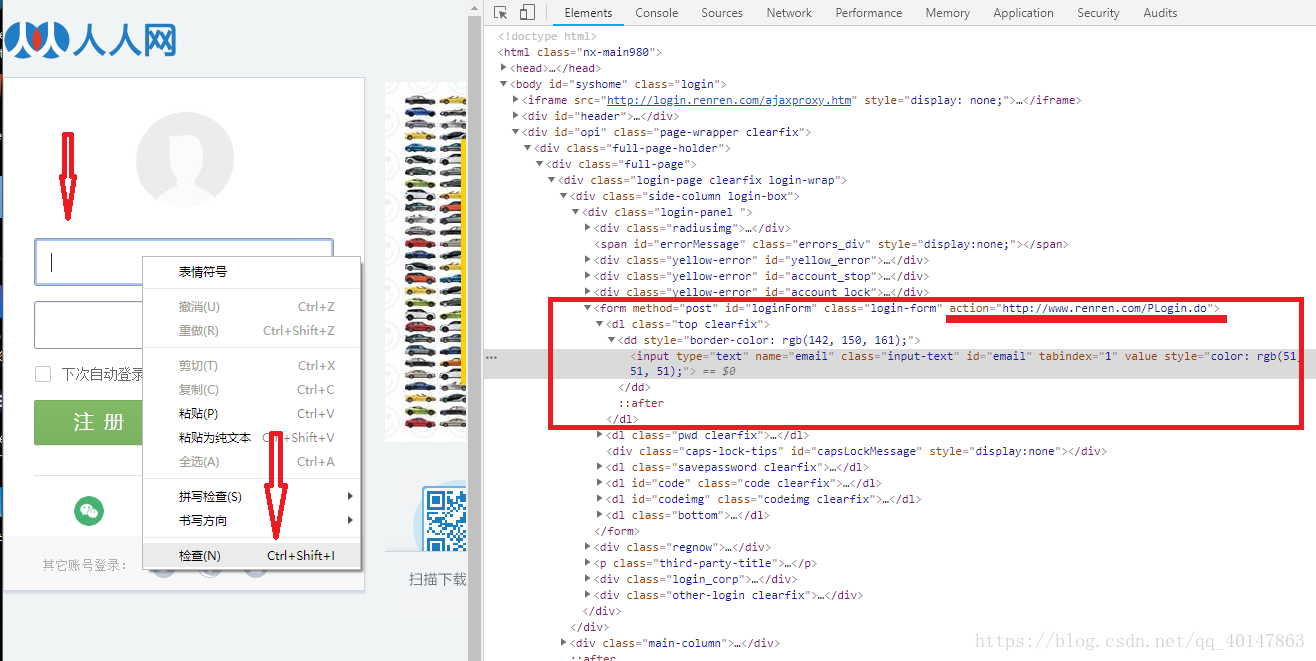

补充:在爬虫代码输入用户名和密码的使用方法

- 1.打开网站首页,登录表单页面

- 2.在输入用户名和密码的地方,【右键检查】,或者查看源代码

- 3.找到登录表单【form标签的action属性】,拷贝地址

- 4.提示:如果不能直接拷贝,【双击】地址,Ctrl+C

- 操作截图:

- 5.找到用户名和密码的【input标签的name属性】,构建参数时使用

- 6.然后在代码中,构建data参数,模拟post请求

# 代码片段

url = 'http://www.renren.com/PLogin.do'

data = {

# 参数使用正确的用户名密码

"email": "18322295195",

"password": "oaix51607991"

}

# 把数据进行编码

data = parse.urlencode(data)

爬虫使用cookie,自动获取cookie解介绍到这里了

更多文章链接:Python 爬虫随笔

- 本笔记不允许任何个人和组织转载

Python爬虫教程-13-爬虫使用cookie爬取登录后的页面(人人网)(下)的更多相关文章

- Python爬虫教程-12-爬虫使用cookie爬取登录后的页面(人人网)(上)

Python爬虫教程-12-爬虫使用cookie(上) 爬虫关于cookie和session,由于http协议无记忆性,比如说登录淘宝网站的浏览记录,下次打开是不能直接记忆下来的,后来就有了cooki ...

- Python之爬虫(二十一) Scrapy爬取所有知乎用户信息(下)

在上一篇文章中主要写了关于爬虫过程的分析,下面是代码的实现,完整代码在:https://github.com/pythonsite/spider items中的代码主要是我们要爬取的字段的定义 cla ...

- 爬虫(二)Python网络爬虫相关基础概念、爬取get请求的页面数据

什么是爬虫 爬虫就是通过编写程序模拟浏览器上网,然后让其去互联网上抓取数据的过程. 哪些语言可以实现爬虫 1.php:可以实现爬虫.php被号称是全世界最优美的语言(当然是其自己号称的,就是王婆 ...

- Python爬虫教程-32-Scrapy 爬虫框架项目 Settings.py 介绍

本篇介绍项目开发的过程中,对 Setting 文件的配置和使用 Python爬虫教程-32-Scrapy 爬虫框架项目 Settings.py 介绍 settings.py 文件的使用 想要详细查看 ...

- Python爬虫教程-30-Scrapy 爬虫框架介绍

从本篇开始学习 Scrapy 爬虫框架 Python爬虫教程-30-Scrapy 爬虫框架介绍 框架:框架就是对于相同的相似的部分,代码做到不出错,而我们就可以将注意力放到我们自己的部分了 常见爬虫框 ...

- python网络爬虫之解析网页的BeautifulSoup(爬取电影图片)[三]

目录 前言 一.BeautifulSoup的基本语法 二.爬取网页图片 扩展学习 后记 前言 本章同样是解析一个网页的结构信息 在上章内容中(python网络爬虫之解析网页的正则表达式(爬取4k动漫图 ...

- Python爬虫实战(2):爬取京东商品列表

1,引言 在上一篇<Python爬虫实战:爬取Drupal论坛帖子列表>,爬取了一个用Drupal做的论坛,是静态页面,抓取比较容易,即使直接解析html源文件都可以抓取到需要的内容.相反 ...

- Python网络爬虫第三弹《爬取get请求的页面数据》

一.urllib库 urllib是Python自带的一个用于爬虫的库,其主要作用就是可以通过代码模拟浏览器发送请求.其常被用到的子模块在Python3中的为urllib.request和urllib. ...

- python网络爬虫《爬取get请求的页面数据》

一.urllib库 urllib是python自带的一个用于爬虫的库,其主要作用就是可以通过代码模拟浏览器发送请求.其常被用到的子模块在python3中的为urllib.request和urllib. ...

随机推荐

- POJ_1990 MooFest 【树状数组】

一.题面 POJ1990 二.分析 一个简单的树状数组运用.首先要把样例分析清楚,凑出57,理解一下.然后可以发现,如果每次取最大的v就可以肆无忌惮的直接去乘以坐标差值就可以了,写代码的时候是反着来的 ...

- error C2955: “std::xx”: 使用 类 模板 需要 模板 参数列表

一般出现这个错误 最可能是一种情况 queue q;//这样写 这样写肯定错 [笑哭] queue<int> q; //正确的 我想静静了

- 基于两阶段提交的分布式事务实现(UP-2PC)

引言:分布式事务是分布式数据库的基础性功能,在2017年上海MySQL嘉年华(IMG)和中国数据库大会(DTCC2018)中作者都对银联UPSQL Proxy的分布式事务做了简要介绍,受限于交流形式难 ...

- 20190430-Bootstrap之旅

写在前面的乱七八糟的前言:当当当,现在是早上9:06,emmm是我是我还是我,(*╹▽╹*)今天讲讲BT这个磨人的小妖精,为什么说磨人呢,因为用的好就不磨人了啊~咳咳就跟我女盆友一样┓( ´∀` )┏ ...

- nodejs之socket.io 私发消息和选择群组发消息

写在前面:其实有的时候忙碌是好的,比如忙碌起来的自己手机可以一天耗费掉只有20%的电,忙碌的自己很专心于一件事情,但是忙碌不等于过度疲劳,本周忙碌有点上脑,迷糊了一天,都在补觉,还是要去平衡下自己一天 ...

- JS支持正则表达式的 String 对象的方法

注意:本文中所有方法的 RegExp 类型的参数,其实都支持传入 String 类型的参数,JS会直接进行字符串匹配. (相当于用一个简单的非全局正则表达式进行匹配,但字符串并没有转换成 RegExp ...

- java跨库事务Atomikos

1:引入额外的jar <dependency> <groupId>com.atomikos</groupId> <artifactId>transact ...

- 【百度之星2014~复赛)解题报告】The Query on the Tree

声明 笔者最近意外的发现 笔者的个人网站http://tiankonguse.com/ 的很多文章被其它网站转载,但是转载时未声明文章来源或参考自 http://tiankonguse.com/ 网站 ...

- Git命令学习笔记

一.本地代码增,删,改,查,提交,找回git checkout . //抛弃工作区所有修改git checkout -- <file> //抛弃工作区& ...

- [PY3]——求TopN/BtmN 和 排序问题的解决

需求 K长的序列,求TopN K长的序列,求BtmN 排序问题 解决 heap.nlargest().heap.nsmallest( ) sorted( )+切片 max( ).min( ) 总结和比 ...