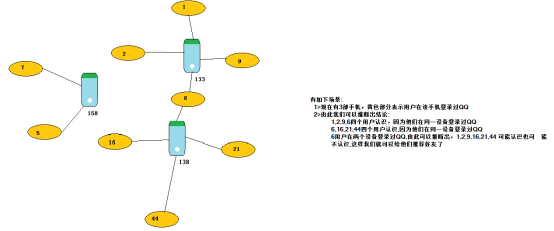

spark graphX作图计算

一、使用graph做好友推荐

import org.apache.spark.graphx.{Edge, Graph, VertexId}

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

//求共同好友

object CommendFriend {

def main(args: Array[String]): Unit = {

//创建入口

val conf: SparkConf = new SparkConf().setAppName("CommendFriend").setMaster("local[*]")

val sc: SparkContext = new SparkContext(conf)

//点的集合

//点

val uv: RDD[(VertexId,(String,Int))] = sc.parallelize(Seq(

(133, ("毕东旭", 58)),

(1, ("贺咪咪", 18)),

(2, ("范闯", 19)),

(9, ("贾璐燕", 24)),

(6, ("马彪", 23)),

(138, ("刘国建", 40)),

(16, ("李亚茹", 18)),

(21, ("任伟", 25)),

(44, ("张冲霄", 22)),

(158, ("郭佳瑞", 22)),

(5, ("申志宇", 22)),

(7, ("卫国强", 22))

))

//边的集合

//边Edge

val ue: RDD[Edge[Int]] = sc.parallelize(Seq(

Edge(1, 133,0),

Edge(2, 133,0),

Edge(9, 133,0),

Edge(6, 133,0),

Edge(6, 138,0),

Edge(16, 138,0),

Edge(44, 138,0),

Edge(21, 138,0),

Edge(5, 158,0),

Edge(7, 158,0)

))

//构建图(连通图)

val graph: Graph[(String, Int), Int] = Graph(uv,ue)

//调用连通图算法

graph

.connectedComponents()

.vertices

.join(uv)

.map{

case (uid,(minid,(name,age)))=>(minid,(uid,name,age))

}.groupByKey()

.foreach(println(_))

//关闭

}

}

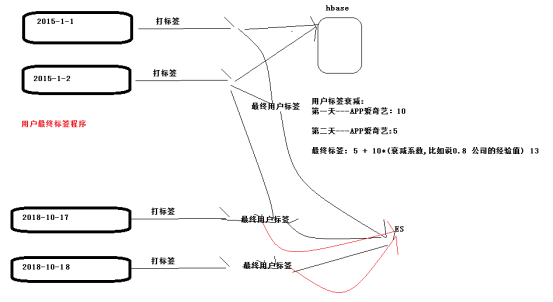

二、用户标签数据合并Demo

测试数据

|

陌上花开 旧事酒浓 多情汉子 APP爱奇艺:10 BS龙德广场:8 多情汉子 满心闯 K韩剧:20 满心闯 喜欢不是爱 不是唯一 APP爱奇艺:10 装逼卖萌无所不能 K欧莱雅面膜:5 |

计算结果数据

|

(-397860375,(List(喜欢不是爱, 不是唯一, 多情汉子, 多情汉子, 满心闯, 满心闯, 旧事酒浓, 陌上花开),List((APP爱奇艺,20), (K韩剧,20), (BS龙德广场,8)))) (553023549,(List(装逼卖萌无所不能),List((K欧莱雅面膜,5)))) |

import org.apache.spark.graphx.{Edge, Graph, VertexId}

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object UserRelationDemo {

def main(args: Array[String]): Unit = {

//创建入口

val conf: SparkConf = new SparkConf().setAppName("CommendFriend").setMaster("local[*]")

val sc: SparkContext = new SparkContext(conf)

//读取数据

val rdd: RDD[String] = sc.textFile("F:\\dmp\\graph")

//点的集合

val uv: RDD[(VertexId, (String, List[(String, Int)]))] = rdd.flatMap(line => {

val arr: Array[String] = line.split(" ")

val tags: List[(String, Int)] = arr.filter(_.contains(":")).map(tagstr => {

val arr: Array[String] = tagstr.split(":")

(arr(0), arr(1).toInt)

}).toList

val filterd: Array[String] = arr.filter(!_.contains(":"))

filterd.map(nickname => {

if(nickname.equals(filterd(0))) {

(nickname.hashCode.toLong, (nickname, tags))

}else{

(nickname.hashCode.toLong, (nickname, List.empty))

}

})

})

//边的集合

val ue: RDD[Edge[Int]] = rdd.flatMap(line => {

val arr: Array[String] = line.split(" ")

val filterd: Array[String] = arr.filter(!_.contains(":"))

filterd.map(nickname => Edge(filterd(0).hashCode.toLong, nickname.hashCode.toLong, 0))

})

//构建图

val graph: Graph[(String, List[(String, Int)]), Int] = Graph(uv,ue)

//连通图算法找关系

graph

.connectedComponents()

.vertices

.join(uv)

.map{

case (uid,(minid,(nickname,list))) => (minid,(List(uid),List(nickname),list))

}

.reduceByKey{

case (t1,t2) =>

(

t1._1++t2._1 distinct ,

t1._2++t2._2 distinct,

t1._3++t2._3.groupBy(_._1).mapValues(_.map(_._2).reduce(_+_))

//.groupBy(_._1).mapValues(_.map(_._2).sum)

// list.groupBy(_._1).mapValues(_.map(_._2).foldLeft(0)(_+_))

)

}

.foreach(println(_))

//关闭

sc.stop()

}

}

三、用户标签数据合并

|

package cn.bw.mock.tags import cn.bw.mock.utils.TagsUtil |

四、用户最终标签和衰减系数

spark graphX作图计算的更多相关文章

- Spark GraphX图计算核心源码分析【图构建器、顶点、边】

一.图构建器 GraphX提供了几种从RDD或磁盘上的顶点和边的集合构建图形的方法.默认情况下,没有图构建器会重新划分图的边:相反,边保留在默认分区中.Graph.groupEdges要求对图进行重新 ...

- Spark GraphX图计算核心算子实战【AggreagteMessage】

一.简介 参考博客:https://www.cnblogs.com/yszd/p/10186556.html 二.代码实现 package graphx import org.apache.log4j ...

- Spark GraphX图计算简单案例【代码实现,源码分析】

一.简介 参考:https://www.cnblogs.com/yszd/p/10186556.html 二.代码实现 package big.data.analyse.graphx import o ...

- Spark GraphX宝刀出鞘,图文并茂研习图计算秘笈与熟练的掌握Scala语言【大数据Spark实战高手之路】

Spark GraphX宝刀出鞘,图文并茂研习图计算秘笈 大数据的概念与应用,正随着智能手机.平板电脑的快速流行而日渐普及,大数据中图的并行化处理一直是一个非常热门的话题.图计算正在被广泛地应用于社交 ...

- 明风:分布式图计算的平台Spark GraphX 在淘宝的实践

快刀初试:Spark GraphX在淘宝的实践 作者:明风 (本文由团队中梧苇和我一起撰写,并由团队中的林岳,岩岫,世仪等多人Review,发表于程序员的8月刊,由于篇幅原因,略作删减,本文为完整版) ...

- 大数据技术之_19_Spark学习_05_Spark GraphX 应用解析 + Spark GraphX 概述、解析 + 计算模式 + Pregel API + 图算法参考代码 + PageRank 实例

第1章 Spark GraphX 概述1.1 什么是 Spark GraphX1.2 弹性分布式属性图1.3 运行图计算程序第2章 Spark GraphX 解析2.1 存储模式2.1.1 图存储模式 ...

- 基于Spark GraphX计算二度关系

关系计算问题描述 二度关系是指用户与用户通过关注者为桥梁发现到的关注者之间的关系.目前微博通过二度关系实现了潜在用户的推荐.用户的一度关系包含了关注.好友两种类型,二度关系则得到关注的关注.关注的好友 ...

- 转载:四两拨千斤:借助Spark GraphX将QQ千亿关系链计算提速20倍

四两拨千斤:借助Spark GraphX将QQ千亿关系链计算提速20倍 时间 2016-07-22 16:57:00 炼数成金 相似文章 (5) 原文 http://www.dataguru.cn/ ...

- Spark GraphX学习资料

<Spark GraphX 大规模图计算和图挖掘> http://book.51cto.com/art/201408/450049.htm http://www.csdn.net/arti ...

随机推荐

- Caused by: java.lang.IllegalArgumentException: Property 'sqlSessionFactory' or 'sqlSessionTemplate' are required [ IDEA mybatis项目报错 ]

今天笔者用Springboot框架整合Mybatis做一个小小的项目: 代码写完,在运行项目时,IDEA给我报了3处错误: org.springframework.beans.factory.Unsa ...

- 20191107-配置 pyqt5+pycharm 环境

因公司需要,今天配置了 pyqt5+pycharm 环境,准备试着写些 UI 界面. 参考资源: 1. Python3+PyQt5+PyCharm 桌面GUI开发环境搭建 https://www.cn ...

- SpringMVC----执行流程+底层解析

SpringMVC流程图如上面所示,根据上图,串联一下底层源码: 1.在DispatcherServlet中找到doDisPatch 2.观察方法体,然后找到getHandler方法 3.点进方法,发 ...

- Spring Boot实战之定制URL匹配规则

本文首发于个人网站:Spring Boot实战之定制URL匹配规则 构建web应用程序时,并不是所有的URL请求都遵循默认的规则.有时,我们希望RESTful URL匹配的时候包含定界符". ...

- vue , debounce 使用

有时候不想直接在methods中的方法前面加debounce, getFullName: debounce(function() { console.log('my fullname is chent ...

- ubuntu中nfs安装

Ubuntu Nfs服务器安装 nfs服务器在嵌入式开发中非常常用,可以实现主机和开发板共享文件. 1.安装软件包 sudo apt-get install nfs-common nfs- ...

- JSON《===》JavaBean的相互转换

1.JSON的作用和好处 在JavaWeb项目中前后端直接的交互,接口之间的对接等等,基本离不开JSON. JSON: 全称JavaScript Object Notation(JavaScript ...

- Class文件结构全面解析(上)

什么是Class文件? 在Java刚刚诞生的时候就提出了一个非常著名的口号:"一次编写,到处运行.(Write Once,Run Anywhere)".为了实现平台无关性,各种不同 ...

- js常用的array方法

1. splice() splice()方法向/从数组中添加/删除项目,然后返回被删除的项目.(注释:该方法会改变原始数组.) arrayObject.splice(index,howmany,i ...

- [Git]Git常用命令速查手册

看的别人的文章,来源:https://mp.weixin.qq.com/s/SGRcE9EPOu4Tph65tzPzQw