caffe中 softmax 函数的前向传播和反向传播

1.前向传播:

template <typename Dtype>

void SoftmaxLayer<Dtype>::Forward_cpu(const vector<Blob<Dtype>*>& bottom,

const vector<Blob<Dtype>*>& top) {

const Dtype* bottom_data = bottom[]->cpu_data();

Dtype* top_data = top[]->mutable_cpu_data();

Dtype* scale_data = scale_.mutable_cpu_data();

int channels = bottom[]->shape(softmax_axis_);

int dim = bottom[]->count() / outer_num_; //dim表示要分类的类别数,count()得到的是总共的输入Blob数,outer_num_得到的是是每一类的Blob数

caffe_copy(bottom[]->count(), bottom_data, top_data); //先将输入拷贝到输出缓冲区

// We need to subtract the max to avoid numerical issues, compute the exp,

// and then normalize,减去最大值,避免数值问题,计算指数,归一化

for (int i = ; i < outer_num_; ++i) {

// 初始化scale_的data域为第一个平面,其中scale用来存放临时计算结果

caffe_copy(inner_num_, bottom_data + i * dim, scale_data);

for (int j = ; j < channels; j++) {

for (int k = ; k < inner_num_; k++) {

scale_data[k] = std::max(scale_data[k],

bottom_data[i * dim + j * inner_num_ + k]);

}

}

// 输出缓冲区减去最大值

caffe_cpu_gemm<Dtype>(CblasNoTrans, CblasNoTrans, channels, inner_num_,

, -., sum_multiplier_.cpu_data(), scale_data, ., top_data);

// exponentiation

caffe_exp<Dtype>(dim, top_data, top_data);

// sum after exp

caffe_cpu_gemv<Dtype>(CblasTrans, channels, inner_num_, .,

top_data, sum_multiplier_.cpu_data(), ., scale_data);

// division

for (int j = ; j < channels; j++) {

caffe_div(inner_num_, top_data, scale_data, top_data);

top_data += inner_num_;

}

}

}

一般的我们有top[0]来存放数据,top[1]来存放标签(对于bottom也一样)

2.反向传播:

template <typename Dtype>

void SoftmaxLayer<Dtype>::Backward_cpu(const vector<Blob<Dtype>*>& top,

const vector<bool>& propagate_down,

const vector<Blob<Dtype>*>& bottom) {

const Dtype* top_diff = top[]->cpu_diff();

const Dtype* top_data = top[]->cpu_data();

Dtype* bottom_diff = bottom[]->mutable_cpu_diff();

Dtype* scale_data = scale_.mutable_cpu_data();

int channels = top[]->shape(softmax_axis_);

int dim = top[]->count() / outer_num_;

caffe_copy(top[]->count(), top_diff, bottom_diff); //先用top_diff初始化bottom_diff

for (int i = ; i < outer_num_; ++i) {

// 计算top_diff和top_data的点积,然后从bottom_diff中减去该值

for (int k = ; k < inner_num_; ++k) {

scale_data[k] = caffe_cpu_strided_dot<Dtype>(channels,

bottom_diff + i * dim + k, inner_num_,

top_data + i * dim + k, inner_num_);

}

// 减值

caffe_cpu_gemm<Dtype>(CblasNoTrans, CblasNoTrans, channels, inner_num_, ,

-., sum_multiplier_.cpu_data(), scale_data, ., bottom_diff + i * dim);

}

// 逐点相乘

caffe_mul(top[]->count(), bottom_diff, top_data, bottom_diff);

}

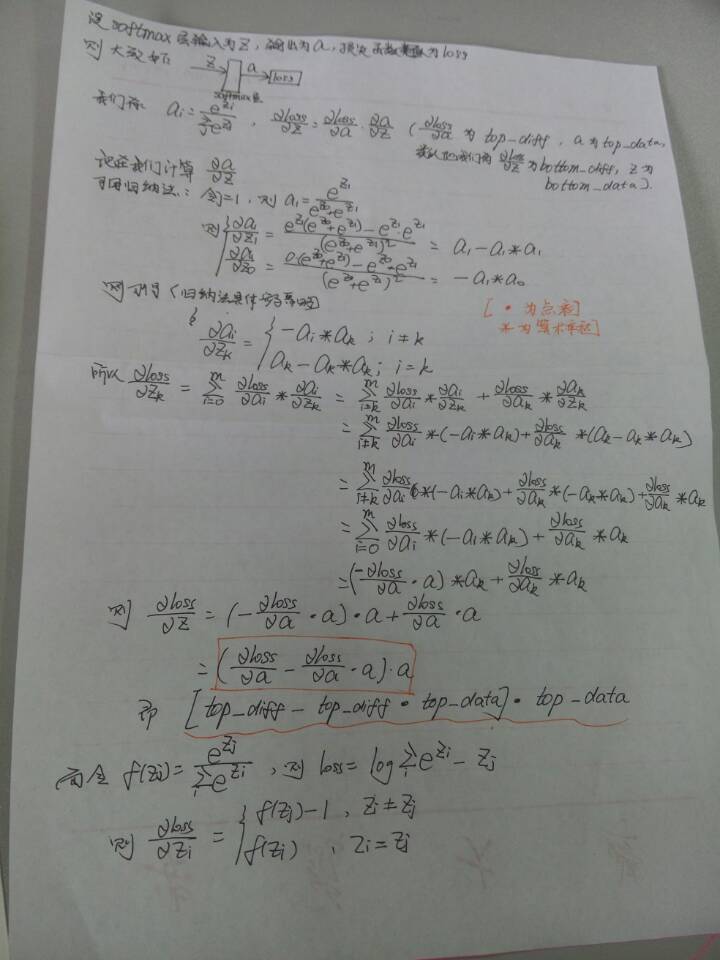

解释:

补充:最后部分,Zi!=Zj和Zi=Zj部分写反了,大家注意一下~

caffe中 softmax 函数的前向传播和反向传播的更多相关文章

- 机器学习(ML)八之正向传播、反向传播和计算图,及数值稳定性和模型初始化

正向传播 正向传播的计算图 通常绘制计算图来可视化运算符和变量在计算中的依赖关系.下图绘制了本节中样例模型正向传播的计算图,其中左下角是输入,右上角是输出.可以看到,图中箭头方向大多是向右和向上,其中 ...

- 小白学习之pytorch框架(6)-模型选择(K折交叉验证)、欠拟合、过拟合(权重衰减法(=L2范数正则化)、丢弃法)、正向传播、反向传播

下面要说的基本都是<动手学深度学习>这本花书上的内容,图也采用的书上的 首先说的是训练误差(模型在训练数据集上表现出的误差)和泛化误差(模型在任意一个测试数据集样本上表现出的误差的期望) ...

- caffe中的前向传播和反向传播

caffe中的网络结构是一层连着一层的,在相邻的两层中,可以认为前一层的输出就是后一层的输入,可以等效成如下的模型 可以认为输出top中的每个元素都是输出bottom中所有元素的函数.如果两个神经元之 ...

- caffe中softmax源码阅读

(1) softmax函数 (1) 其中,zj 是softmax层的bottom输入, f(zj)是softmax层的top输 ...

- BP原理 - 前向计算与反向传播实例

Outline 前向计算 反向传播 很多事情不是需要聪明一点,而是需要耐心一点,踏下心来认真看真的很简单的. 假设有这样一个网络层: 第一层是输入层,包含两个神经元i1 i2和截距b1: 第二层是隐含 ...

- 反向传播算法(前向传播、反向传播、链式求导、引入delta)

参考链接: 一文搞懂反向传播算法

- caffe中softmax loss源码阅读

(1) softmax loss <1> softmax loss的函数形式为: (1) zi为softmax的输入,f(zi)为softmax的输出. <2> sof ...

- 前向传播和反向传播实战(Tensor)

前面在mnist中使用了三个非线性层来增加模型复杂度,并通过最小化损失函数来更新参数,下面实用最底层的方式即张量进行前向传播(暂不采用层的概念). 主要注意点如下: · 进行梯度运算时,tensorf ...

- caffe中python接口的使用

下面是基于我自己的接口,我是用来分类一维数据的,可能不具通用性: (前提,你已经编译了caffe的python的接口) 添加 caffe塻块的搜索路径,当我们import caffe时,可以找到. 对 ...

随机推荐

- 自学Zabbix9.1 Network Discovery 网络发现原理

点击返回:自学Zabbix之路 点击返回:自学Zabbix4.0之路 点击返回:自学zabbix集锦 自学Zabbix9.1 Network Discovery 网络发现原理 1. 网络发现简介 网络 ...

- emwin之GUIBuilder使用控件命名技巧

@2018-07-30 使用emwin-GUIBuilder布局界面时,各控件命名技巧及规则如下图所示(遵循此规则在写代码时好处多多) > 如上图所示所使用的第一组控件分别为 Text.Edit ...

- SQLite 学习笔记(一)

(1)创建数据库 在命令行中切换到sqlite.exe所在的文件夹 在命令中键入sqlite3 test.db;即可创建了一个名为test.db的数据库 由于此时的数据库中没有任何表及 ...

- Bash: about .bashrc, .bash_profile, .profile, /etc/profile, etc/bash.bashrc and others

Some interesting excerpts from the bash manpage:When bash is invoked as an interactive login shell, ...

- 【洛谷P1486】郁闷的出纳员

题目大意:维护一个平衡树,支持插入一个数,删除小于一个值的所有数,K 大值查询,每个节点权值加减一个数. 题解:所有节点权值加减操作可以考虑直接维护一个全局标记,删除小于一个值的所有数字为一个二分的过 ...

- react实现删除输入框内容

react中实现删除输入框中的内容 import React,{Component} from 'react' class Clear extends Component{ constructor(p ...

- apigateway-kong(六)认证

到上游服务(API或微服务)的流量通常由各种Kong认证插件的应用程序和配置来控制.由于Kong的服务实体(Service Entity)代表自己的上游服务的1对1映射,最简单的方案是在选择的服务上配 ...

- Python基础学习(四)

菜鸟咀嚼python基础之继续. 一.返回函数 第三章已经简单操作了Python的高阶函数,目前继续练手函数作为返回值的特效:通常,高阶函数除了可以接收函数作为参数外,还可以把函数作为结果值返回. 案 ...

- 斯坦福大学公开课机器学习:梯度下降运算的特征缩放(gradient descent in practice 1:feature scaling)

以房屋价格为例,假设有两个特征向量:X1:房子大小(1-2000 feets), X2:卧室数量(1-5) 关于这两个特征向量的代价函数如下图所示: 从上图可以看出,代价函数是一个又瘦又高的椭圆形轮廓 ...

- 异常处理(throw,throws,try,catch,finally)

一.异常 1.定义:程序在运行时出现的不正确的情况. 2.由来:问题也是生活中的事物,也可以被Java描述,并被封装成对象. 其实就是Java对不正常情况进行描述后的对象体现. 3.划分:Java对于 ...