从0开始学爬虫3之xpath的介绍和使用

从0开始学爬虫3之xpath的介绍和使用

Xpath:一种HTML和XML的查询语言,它能在XML和HTML的树状结构中寻找节点

安装xpath:

pip install lxml

HTML

超文本标记语言(HyperText Mark-up Language),是一种规范,一种标准,是构成网页文档的主要语言

URL

统一资源定位器(Uniform Resource Locator),互联网上的每个文件都有一个唯一的URL,它包含的信息之处文件的位置以及浏览器应该怎么处理它

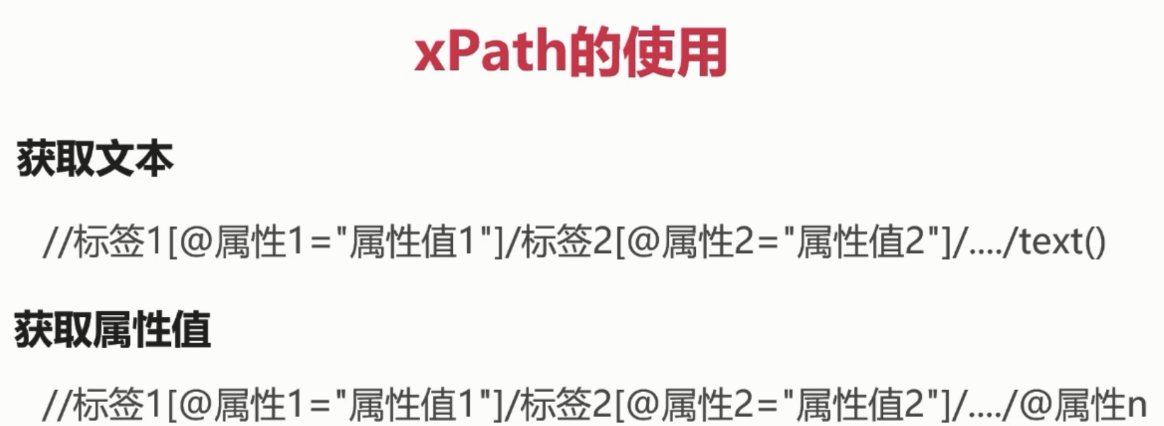

Xpath的使用语法:

获取文本:

//标签1[@属性1=”属性值1”]/标签2[@属性2=”属性值2”]/…/text()

获取属性值

//标签1[@属性1=”属性值1”]/标签2[@属性2=”属性值2”]/…/@属性n

使用pycharm虚拟环境安装xpath模块

Xpath使用示例

用来进行xpath测试的网页 static/index.html

<!DOCTYPE html>

<html>

<head>

<meta charset="utf-8">

<meta http-equiv="X-UA-Compatible" content="IE=edge">

<title>网页测试</title>

<link rel="stylesheet" href="">

</head>

<body>

<h3>标题</h3>

<ul>

<li>内容1</li>

<li>内容2</li>

<li class="important">内容3important</li>

<li>内容4</li>

<li>内容5</li> </ul>

<div>

内容未知

</div>

<p>

段落内容 from p

</p>

<div id="container">

段落文字

<a href="http://www.baidu.com" title="超链接">跳转到百度首页</a>

<p class="content">

区块内容1

</p>

<p class="content">

区块内容2

</p>

<p class="content">

区块内容3

</p>

<p class="content">

区块内容4

</p>

<p class="content-block">

区块内容5 from block

</p>

<p class="content-block">

区块内容6 末尾内容

</p>

<a href="http://www.so.com" title="超链接">跳转到360搜索首页</a>

</div>

<p>

最后一段文字

</p>

</body>

</html>

xpath使用示例

#coding=utf-8

from lxml import html def parse():

"""将html文件中的内容,使用xpath进行提取"""

# 读取文件中的内容

f = open('./static/index.html', 'r', encoding='utf-8')

s = f.read() selector = html.fromstring(s)

# 解析H3标题

h3 = selector.xpath('/html/body/h3/text()')

print(h3[0])

# 解析ul下面的内容

# ul = selector.xpath('/html/body/ul/li')

# 双斜线语法

ul = selector.xpath("//ul/li")

print(len(ul))

for li in ul:

print(li.xpath('text()')[0]) # 解析ul指定的元素值

ul2 = selector.xpath('/html/body/ul/li[@class="important"]/text()')

print(ul2) # 解析a标签的内容,拆分的方式

# a = selector.xpath('//div[@id="container"]/a')

# 标签内的内容

# print(a[0].xpath("text()")[0])

# 得到标签的属性

# print(a[0].xpath("@href")[0])

# div[id="container"] 的第二个a标签内容

# print(a[1].xpath("text()"))

# print(a[1].xpath("@href")[0]) # 解析a标签的内容,一次性解析的方式

a1 = selector.xpath('//div[@id="container"]/a/text()')

# 标签内容

print(a1[0])

# 标签数学

alink = selector.xpath('//div[@id="container"]/a/@href')

print(alink[0]) # 解析p标签

p = selector.xpath('/html/body/p[last()]/text()')

print(p[0])

f.close() if __name__ == "__main__":

parse()

当我们在页面中找不到xpath的时候可以使用chrome的copy xpath进行参考

从0开始学爬虫3之xpath的介绍和使用的更多相关文章

- 从0开始学爬虫2之json的介绍和使用

从0开始学爬虫2之json的介绍和使用 Json 一种轻量级的数据交换格式,通用,跨平台 键值对的集合,值的有序列表 类似于python中的dict Json中的键值如果是字符串一定要用双引号 jso ...

- 从0开始学爬虫12之使用requests库基本认证

从0开始学爬虫12之使用requests库基本认证 此处我们使用github的token进行简单测试验证 # coding=utf-8 import requests BASE_URL = " ...

- 从0开始学爬虫11之使用requests库下载图片

从0开始学爬虫11之使用requests库下载图片 # coding=utf-8 import requests def download_imgage(): ''' demo: 下载图片 ''' h ...

- 从0开始学爬虫9之requests库的学习之环境搭建

从0开始学爬虫9之requests库的学习之环境搭建 Requests库的环境搭建 环境:python2.7.9版本 参考文档:http://2.python-requests.org/zh_CN/l ...

- 从0开始学爬虫8使用requests/pymysql和beautifulsoup4爬取维基百科词条链接并存入数据库

从0开始学爬虫8使用requests和beautifulsoup4爬取维基百科词条链接并存入数据库 Python使用requests和beautifulsoup4爬取维基百科词条链接并存入数据库 参考 ...

- 从0开始学爬虫4之requests基础知识

从0开始学爬虫4之requests基础知识 安装requestspip install requests get请求:可以用浏览器直接访问请求可以携带参数,但是又长度限制请求参数直接放在URL后面 P ...

- 从0开始学爬虫10之urllib和requests库与github/api的交互

urllib库的使用 # coding=utf-8 import urllib2 import urllib # htpbin模拟的环境 URL_IP="http://10.11.0.215 ...

- 从0开始学爬虫7之BeautifulSoup模块的简单介绍

参考文档: https://www.crummy.com/software/BeautifulSoup/bs4/doc.zh/ # 安装 beautifulsoup4 (pytools) D:\pyt ...

- 一起学爬虫——使用selenium和pyquery爬取京东商品列表

layout: article title: 一起学爬虫--使用selenium和pyquery爬取京东商品列表 mathjax: true --- 今天一起学起使用selenium和pyquery爬 ...

随机推荐

- scp 服务器之间远程复制

从本地服务器复制到远程服务器: (1) 复制文件: 命令格式: scp local_file remote_username@remote_ip:remote_folder 或者 scp local_ ...

- 微信小程序API~用户信息

UserInfo 用户信息 属性 string nickName 用户昵称 string avatarUrl 用户头像图片的 URL.URL 最后一个数值代表正方形头像大小(有 0.46.64.96. ...

- Ecshop漏洞通杀0day【最新入侵手法】

昨晚上翻阅一本技术书籍中,找到灵感,发现的ECshop漏洞. 搜索关键字:关键字:powered by ecshop 方法一: 普通代码: user.php?act=order_query&o ...

- Mongodb设置用户权限(整理版)

本文是基于windows 下 MongoDB 4.0编写,据了解MongoDB在3.0以后的版本中权限设置有变化. 1. 创建超级用户 安装完之后,打开命令行,进入mongodb安装目录,在bin目录 ...

- docker创建Webvirtmgr容器

链接:https://hub.docker.com/r/unws/webvirtmgr/ Webvirtmgr Dockerfile 拉起镜像并创建webvirtmgr用户和组(注意uid和guid必 ...

- 开启idea自动Build功能

修改Intellij IDEA的配置两步:1.setting -> Compile -> Build project automatically --> 选中 2.CTRL + SH ...

- [JSOI2018]战争

题目描述 九条可怜是一个热爱读书的女孩子. 在她最近正在读的一本小说中,描述了两个敌对部落之间的故事.第一个部落有 nnn 个人,第二个部落有 mmm 个人,每一个人的位置可以抽象成二维平面上坐标为 ...

- javamail: UrlDataSource获取网络文件作为邮件的附件|javamail发送二进制流附件的问题

https://www.cnblogs.com/younldeace/p/5193103.html 最近做个邮件发送功能,要内嵌图片并有附件. 需求很奇怪,图片和附件文件是放在ftp服务器上的,查了下 ...

- neo4j 启动与关闭

neo4j开启与关闭 进入neo4j目录bin下. cd到bin目录下,执行启动命令: ./neo4j stop 另外neo4j还有其他命令,执行方式相同: neo4j { console | sta ...

- GreenPlum failover,primary和mirror切换实验 -- 重要

GP failover,primary和mirror切换实验 http://blog.sina.com.cn/s/blog_9869114e0101k1nc.html 一.恢复失败的segment出现 ...