从0开始学爬虫12之使用requests库基本认证

从0开始学爬虫12之使用requests库基本认证

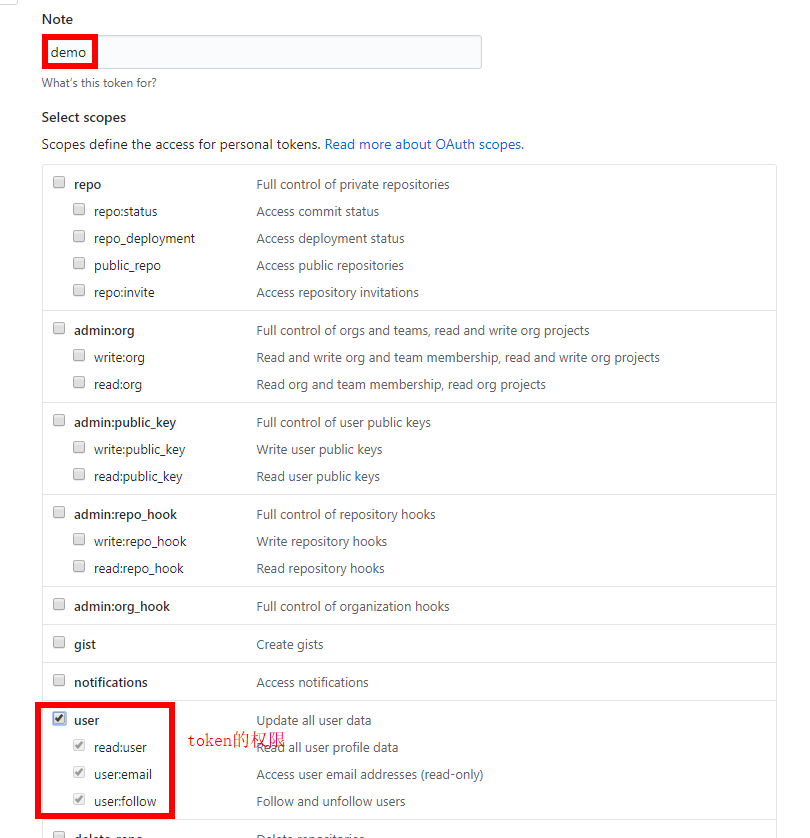

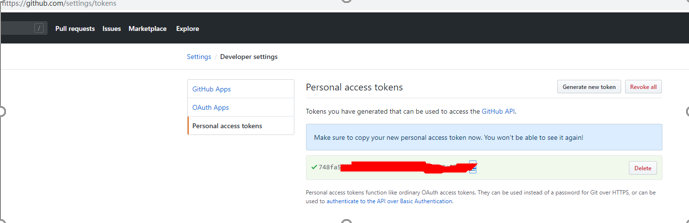

此处我们使用github的token进行简单测试验证

# coding=utf-8 import requests BASE_URL = "https://api.github.com" def construct_url(endpoint):

return '/'.join([BASE_URL, endpoint]) def basic_auth():

'''

基本认证

:return:

''' response = requests.get(construct_url('user'), auth=('reblue520','reblue520'))

print response.text

print response.status_code

print response.request.headers def basic_oauth():

# 添加github中添加的token认证

headers = {'Authorization': 'token 748fa57d10'}

# user/emails

response = requests.get(construct_url('user/emails'), headers=headers)

print response.request.headers

print response.text

print response.status_code from requests.auth import AuthBase class GithubAuth(AuthBase):

# 自定义auth,对aut进行优化

def __init__(self, token):

self.token = token def __call__(self, r):

# requests 加 headers信息

r.headers['Authorization'] = ' '.join(['token', self.token])

return r def oath_advanced():

auth = GithubAuth('748fa57d10')

response = requests.get(construct_url('user/emails'), auth=auth)

print response.text if __name__ == '__main__':

# basic_auth()

# basic_oauth()

oath_advanced()

从0开始学爬虫12之使用requests库基本认证的更多相关文章

- 从0开始学爬虫11之使用requests库下载图片

从0开始学爬虫11之使用requests库下载图片 # coding=utf-8 import requests def download_imgage(): ''' demo: 下载图片 ''' h ...

- 从0开始学爬虫9之requests库的学习之环境搭建

从0开始学爬虫9之requests库的学习之环境搭建 Requests库的环境搭建 环境:python2.7.9版本 参考文档:http://2.python-requests.org/zh_CN/l ...

- 从0开始学爬虫8使用requests/pymysql和beautifulsoup4爬取维基百科词条链接并存入数据库

从0开始学爬虫8使用requests和beautifulsoup4爬取维基百科词条链接并存入数据库 Python使用requests和beautifulsoup4爬取维基百科词条链接并存入数据库 参考 ...

- 从0开始学爬虫4之requests基础知识

从0开始学爬虫4之requests基础知识 安装requestspip install requests get请求:可以用浏览器直接访问请求可以携带参数,但是又长度限制请求参数直接放在URL后面 P ...

- 从0开始学爬虫3之xpath的介绍和使用

从0开始学爬虫3之xpath的介绍和使用 Xpath:一种HTML和XML的查询语言,它能在XML和HTML的树状结构中寻找节点 安装xpath: pip install lxml HTML 超文本标 ...

- 从0开始学爬虫2之json的介绍和使用

从0开始学爬虫2之json的介绍和使用 Json 一种轻量级的数据交换格式,通用,跨平台 键值对的集合,值的有序列表 类似于python中的dict Json中的键值如果是字符串一定要用双引号 jso ...

- Python爬虫利器一之Requests库的用法

前言 之前我们用了 urllib 库,这个作为入门的工具还是不错的,对了解一些爬虫的基本理念,掌握爬虫爬取的流程有所帮助.入门之后,我们就需要学习一些更加高级的内容和工具来方便我们的爬取.那么这一节来 ...

- (转)Python爬虫利器一之Requests库的用法

官方文档 以下内容大多来自于官方文档,本文进行了一些修改和总结.要了解更多可以参考 官方文档 安装 利用 pip 安装 $ pip install requests 或者利用 easy_install ...

- 网络爬虫必备知识之requests库

就库的范围,个人认为网络爬虫必备库知识包括urllib.requests.re.BeautifulSoup.concurrent.futures,接下来将结对requests库的使用方法进行总结 1. ...

随机推荐

- elementUI 控制 DatePicker组件 不能选择 设定的日期

<el-date-picker v-model="date" type="daterange" range-separator="至" ...

- 创建型模式(过渡模式) 简单工厂模式(Simple Factory)

简单工厂模式(Simple Factory Pattern)属于类的创建型模式,又叫静态工厂方法模式(Static FactoryMethod Pattern) 是通过专门定义一个类来负责创建其他类的 ...

- Codeforces Round #604 (Div. 2) D. Beautiful Sequence(构造)

链接: https://codeforces.com/contest/1265/problem/D 题意: An integer sequence is called beautiful if the ...

- Hbase表结构

1.Hbase表结构:可以看成map,里面有行键,行键是按照字母顺序排序.行键下面是列族,每个列族可以有不同数量的列甚至是没有列.每个列里面包含着不同时间版本的列的值. 行键:是按照字母的顺序排序的, ...

- kafka的HA机制

1.kafka的HA机制:副本机制+消息同步+leader选举. 每个topic有多个partition,每个partition又有多个副本,这些副本当中也存在不同的角色,leader.followe ...

- Maximal Square II

Description Given a 2D binary matrix filled with 0's and 1's, find the largest square which diagonal ...

- git 在 A 项目中引用 B 项目

git 在 A 项目中引用 B 项目 场景: 需要在项目calcDLL(http://XXX/XXXA.git) 中 引用 项目libindex(http://XXX/XXXB.git). 解决方 ...

- (尚006)Vue计算属性之set与get

test004.html <!DOCTYPE html><html lang="en"><head> <meta charset=&quo ...

- Shell脚本之sed的使用

1.sed命令:主要作用是查找:新增 删除 和修改替换. user.txt daokr#cat user.txt ID Name Sex Age zhang M wang G cheng M huah ...

- 【转】跟我一起写 Makefile

概述—— 什么是makefile?或许很多Winodws的程序员都不知道这个东西,因为那些Windows的IDE都为你做了这个工作,但我觉得要作一个好的和professional的程序员,makefi ...